Clear Sky Science · de

Erweiterte Bildverschlüsselung mit tiefen generativen Modellen unter Einsatz eines Self‑Attention‑Mechanismus

Warum das Verbergen medizinischer Bilder wichtig ist

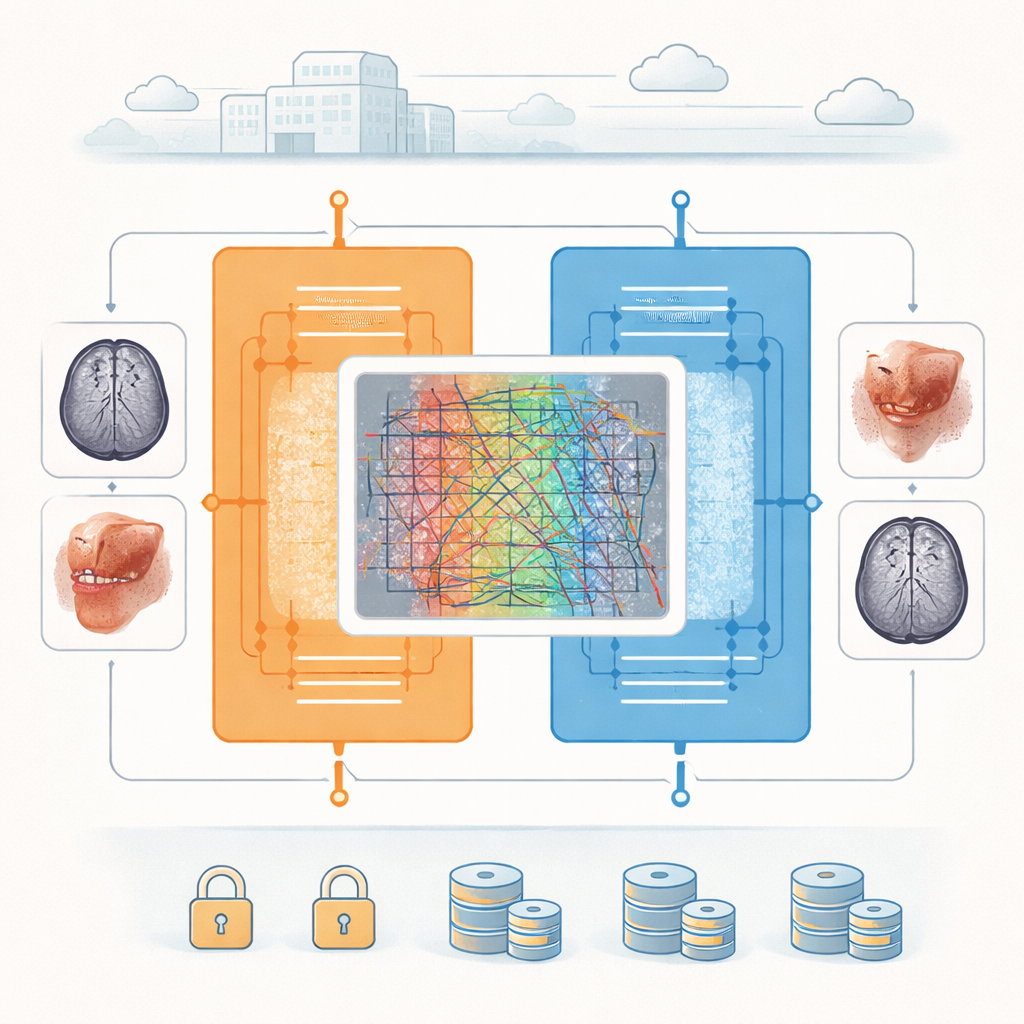

Krankenhäuser senden und speichern heute täglich Millionen medizinischer Bilder – von Hirnscans bis zu Hautfotos – über Netzwerke. Diese Bilder können intime Details über die Gesundheit einer Person offenbaren und müssen daher vor neugierigen Blicken geschützt werden, zugleich aber ausreichend klar bleiben, damit Ärzte sie auswerten können. In diesem Beitrag wird eine neue Methode vorgestellt, medizinische Bilder mithilfe moderner künstlicher Intelligenz zu verschlüsseln, sodass gestohlene Daten für Angreifer nutzlos werden, während entschlüsselte Bilder scharf genug für Diagnosen bleiben.

Ein klügeres Schloss für digitale Bilder

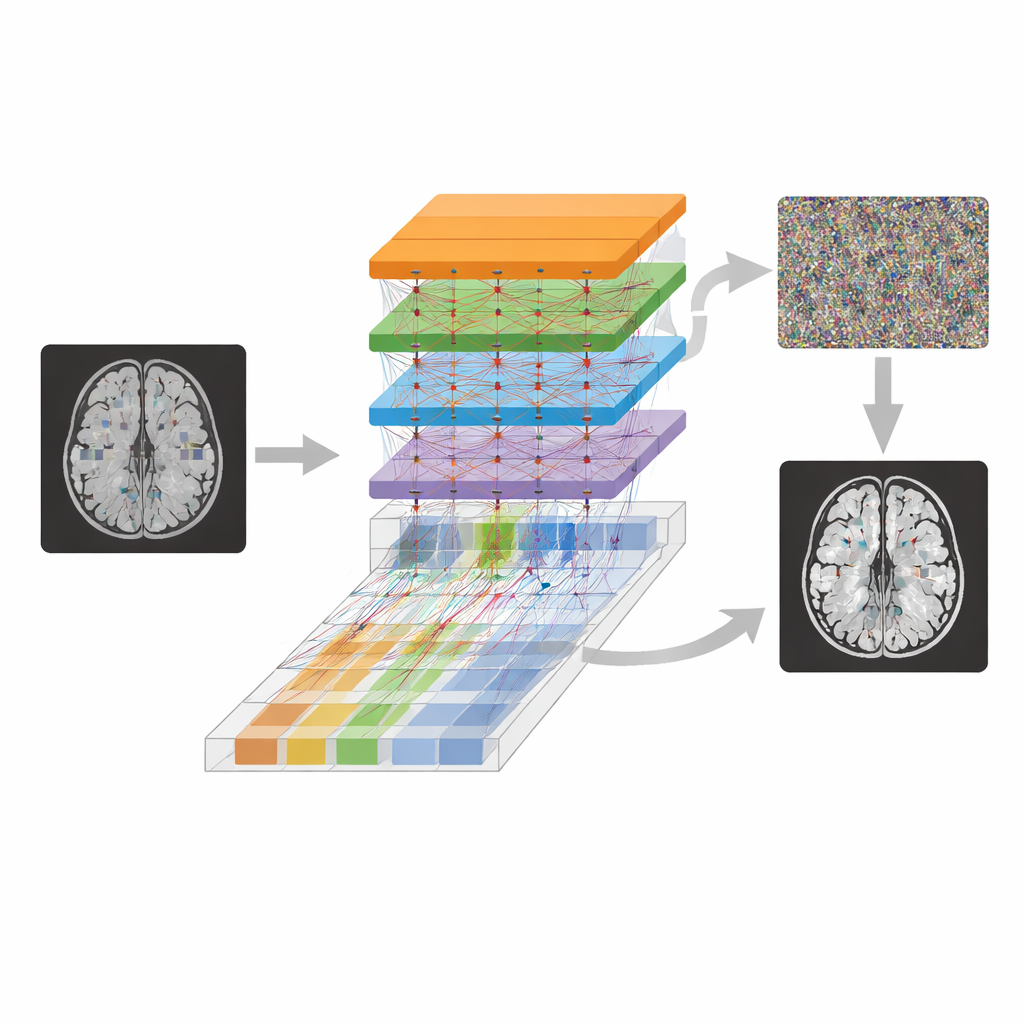

Die Autoren bauen ihr Schutzsystem auf einer Familie von Deep‑Learning‑Modellen auf, den generativen Netzwerken, die darauf ausgelegt sind, zu lernen, wie Bilder aussehen, und dann neue zu erzeugen. Ihre Architektur verwendet ein Paar neuronaler Netze, die wie Schloss und Schlüssel zusammenarbeiten: Ein Netzwerk verschlüsselt ein normales medizinisches Bild so, dass es wie zufälliges Rauschen aussieht, und ein zweites Netzwerk kehrt den Prozess um, um das Original wiederherzustellen. Zwei weitere Netzwerke fungieren als Kritiker und beurteilen ständig, ob die verschlüsselten Bilder unähnlich zu echten Scans sind und ob die entschlüsselten Bilder den Originalen hinreichend nahekommen. Dieses Zug‑und‑Drück‑Training zwingt das System dazu, sensible Details zu verbergen und gleichzeitig die Fähigkeit zu bewahren, sie getreu zurückzubringen.

Das Netzwerk aufmerksam machen

Um sowohl Sicherheit als auch Bildqualität zu stärken, fügen die Forscher dem Kern des Modells einen Mechanismus namens Self‑Attention hinzu. Anstatt nur kleine Pixelnachbarschaften zu betrachten, erlaubt das Attention‑Modul dem System, entfernte Bereiche eines Bildes zu verknüpfen – zum Beispiel einen Teil eines Hirnscans mit einem weit entfernten anderen. Mehrere Attention‑»Köpfe« untersuchen das Bild aus verschiedenen Perspektiven und kombinieren dann ihre Erkenntnisse. Dieser globale Blick hilft, Informationen über das gesamte verschlüsselte Bild zu verteilen, wodurch die engen Pixel‑zu‑Pixel‑Beziehungen aufgehoben werden, die Angreifer oft ausnutzen, während die Strukturen erhalten bleiben, die bei der späteren Wiederherstellung wichtig sind.

Gelernte Gewichte als geheime Schlüssel

Bei herkömmlicher Verschlüsselung steuert ein kurzer numerischer Schlüssel, wie Daten verschleiert werden. Hier übernimmt die Rolle des Schlüssels die Gesamtheit der gelernten Gewichte der neuronalen Netze, die genau bestimmen, wie Bilder transformiert werden. Die beiden Hauptgeneratoren enthalten zusammen mehrere zehn Millionen anpassbarer Werte, und die Kritiker fügen noch Millionen hinzu. Während des Trainings an großen Mengen von Gehirn‑MRT‑Scans und Hautkrebssbildern werden diese Parameter schrittweise so angepasst, dass Verschlüsselung und Entschlüsselung gut funktionieren. Die schiere Anzahl der Werte erzeugt einen enormen Schlüsselraum, sodass es für einen Angreifer praktisch unmöglich ist, ohne Zugriff auf die in einer Krankenhausumgebung sicher gespeicherten trainierten Modelle die richtige Konfiguration zu erraten oder durch Brute‑Force zu finden.

Das System auf die Probe stellen

Das Team unterzieht seine Methode einer breiten Palette von Tests, die reale Bedrohungen widerspiegeln. Statistisch betrachtet wirken die verschlüsselten Bilder fast perfekt zufällig: Maße wie Entropie liegen nahe ihrem theoretischen Maximum, und benachbarte Pixel verlieren die starken Korrelationen, die in natürlichen Szenen vorkommen. Wenn dasselbe Bild mit zwei nahezu identischen Schlüsseln verschlüsselt wird, unterscheiden sich die Ergebnisse dramatisch, was zeigt, dass schon kleinste Schlüsseländerungen zu sehr unterschiedlichen Chiffren führen. Gleichzeitig stimmen die entschlüsselten Bilder eng mit den Originalen überein und erreichen hohe Werte in gängigen Qualitätsmetriken, die Rauschen und strukturelle Ähnlichkeit messen. Das System schneidet auch gut ab, wenn Teile des verschlüsselten Bildes blockiert oder beschädigt sind; bis zu moderaten Ausfällen bleiben die rekonstruierten Scans visuell zuverlässig. Schließlich vergleichen die Autoren ihren Ansatz mit mehreren früheren, auf Deep Learning basierenden Verschlüsselungsschemata und stellen fest, dass ihr Entwurf ein ungewöhnlich starkes Gleichgewicht erreicht: Er bietet nahezu maximale Zufälligkeit und Widerstandskraft gegen differentielle Angriffe, während medizinische Details erhalten bleiben.

Was das für den Datenschutz von Patienten bedeutet

Für Nicht‑Spezialisten lautet die Kernbotschaft: Die Autoren haben ein KI‑gestütztes Schloss entwickelt, das medizinische Bilder stark verschlüsseln kann und sie dennoch mit nahezu originaler Klarheit wiederherstellt. Indem sie Self‑Attention in ein Paar generativer Netzwerke einweben und die gelernten Modellparameter als massive geheime Schlüssel behandeln, macht ihre Methode es Außenstehenden extrem schwer, Patientenbilder aus abgefangenen Daten zu rekonstruieren. Obwohl der Ansatz rechenintensiver ist als leichte Verfahren für winzige Geräte, eignet er sich gut für Krankenhausserver und medizinische Gateways, wo Sicherheit und diagnostische Qualität am wichtigsten sind. Wenn solche Systeme reifen und effizienter werden, könnten sie ein zentraler Baustein dafür sein, wie künftige Krankenhäuser sensible Scans schützen, ohne die Informationen zu opfern, die Ärzte zur Versorgung ihrer Patienten benötigen.

Zitation: Karmouni, I., Ghouate, N.E., Tahiri, M.A. et al. Enhanced image encryption with deep generative models using a self-attention mechanism. Sci Rep 16, 11200 (2026). https://doi.org/10.1038/s41598-026-38780-5

Schlüsselwörter: Verschlüsselung medizinischer Bilder, Sicherheit im Deep Learning, generative Modelle, Self‑Attention, Privatsphäre von Gesundheitsdaten