Clear Sky Science · de

Ausnutzung von dunstbewussten Merkmalen für verbesserte Bildklarheit und Erkennungsgenauigkeit mit einem optimierten DCNN-YOLOv8-Netzwerk

Warum klare Sicht bei Nebel wichtig ist

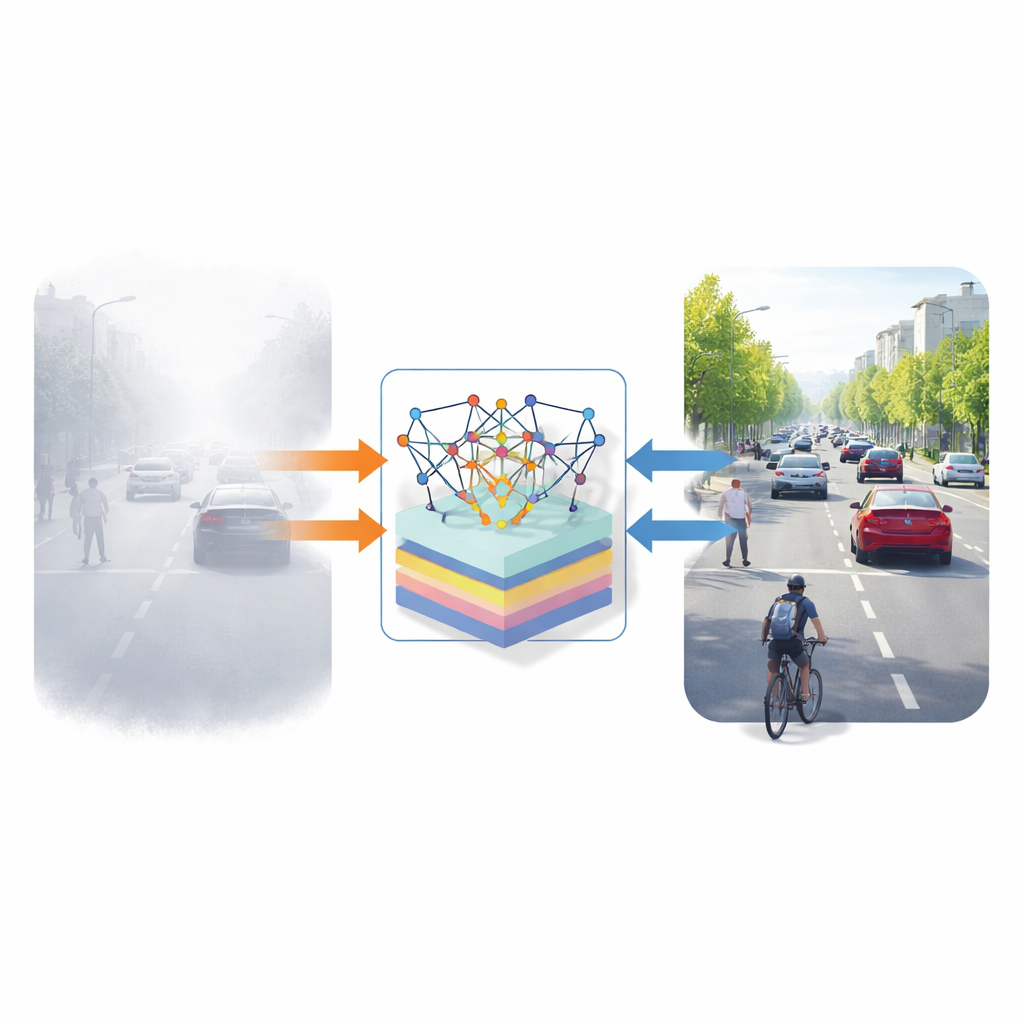

Ob man an einem nebligen Morgen fährt oder ein verschwommenes Video einer Überwachungskamera betrachtet – wir spüren instinktiv, wie gefährlich verdeckte Fahrzeuge oder Fußgänger sein können. Viele moderne Systeme – selbstfahrende Autos, Verkehrsüberwachung, sogar Satellitenkartierung – sind auf Computer angewiesen, die „klar sehen“ können. Dunst und Nebel verwirren jedoch heutige Sichtalgorithmen und lassen sie wichtige Objekte übersehen. Dieser Artikel stellt einen neuen Ansatz vor, der Computern nicht nur beibringt, verrauschte Bilder zu bereinigen, sondern auch zu bewerten, wie gut die Bereinigung ist, und anschließend Objekte bei widrigen Wetterbedingungen zuverlässiger zu erkennen.

Durch den Dunst hindurchsehen

Außenaufnahmen bei Dunst leiden unter stumpfen Farben, geringem Kontrast und unscharfen Kanten, weil feine Partikel in der Luft Licht streuen und absorbieren. Das führt dazu, dass entfernte Autos in den Hintergrund verblassen und Verkehrsschilder schwer zu unterscheiden sind. Zahlreiche Methoden zur Bildentzischung wurden vorgeschlagen, doch die Leistung in der Praxis ist nach wie vor uneinheitlich: Manche Verfahren stellen zwar den Kontrast wieder her, verfälschen dabei aber die Farben; andere schärfen Details, bleiben jedoch über wechselndes Wetter oder unterschiedliche Einsatzorte hinweg unzuverlässig. Ein wesentlicher fehlender Baustein ist eine robuste Methode, mit der der Computer selbst die visuelle Qualität entzischter Bilder einschätzen kann – insbesondere wenn kein perfekt klares Referenzbild verfügbar ist.

Dem Computer beibringen, wie ein gutes Bild aussieht

Die Autoren gehen dieses Problem an, indem sie eine Pipeline entwickeln, die mit dunstbewusster Merkmalsextraktion speziell für neblige Szenen beginnt. Für jedes Eingangsbild berechnet das System einen neuen Typ von Deskriptor, genannt Haze aware Structural Pixel Neighbor (HSPN)-Merkmale, die zusammenfassen, wie jeder Pixel in Bezug auf Helligkeit und Textur zu seinen Nachbarn steht. Diese werden mit Messgrößen der durchschnittlichen Helligkeit, lokalen Variation und Farb-Balance sowie mit Statistiken kombiniert, die erfassen, wie Dunst die natürliche Verteilung von Bildintensitäten verändert. Zusammen liefern diese Merkmale eine kompakte, zugleich reichhaltige Beschreibung dafür, wie stark Dunst Struktur und Farbe in einer Szene beeinträchtigt.

Eine schlauere Lernmaschine unter der Haube

Diese dunstbewussten Merkmale werden in ein tiefes Faltungsnetzwerk (DCNN) eingespeist, das für jedes Bild eine objektive „Qualitätsbewertung“ vorhersagt. Um dieses Netzwerk effektiv zu trainieren, führen die Autoren eine neue Optimierungsstrategie ein, die Chronological Chimp Optimization Algorithm (CChOA) genannt wird. Vom Gruppenjagdverhalten von Schimpansen inspiriert und mit einem zeitbewussten Mechanismus erweitert, steuert CChOA den Trainingsprozess mithilfe vergangener und gegenwärtiger Kandidatenlösungen und hilft dem Netzwerk, in schlechten lokalen Optima nicht stecken zu bleiben. In der Praxis bedeutet das, dass das Qualitätsvorhersagenetzwerk schneller konvergiert, geringere Trainingsfehler erreicht und stabiler ist als bei Verwendung standardmäßiger Optimierer oder der ursprünglichen schimpansenbasierten Methode.

Von besseren Bildern zu besserer Erkennung

Sobald das System Bilder verbessert und deren Qualität bewertet hat, werden die verbesserten Bilder an eine angepasste Version von YOLOv8 weitergegeben, einem schnellen Netzwerk zur Objekterkennung. Die Autoren passen YOLOv8 speziell an neblige Bedingungen an, indem sie die Verlustfunktion verfeinern, um kleine, überlappende Objekte präziser zu lokalisieren, ein Inception-ähnliches Modul hinzufügen, das Details auf mehreren Skalen erfasst, und einen Spatial Pyramid Pooling-Block einfügen, der dem Netzwerk hilft, sowohl lokale Details als auch den größeren Kontext zu verstehen. Getestet und trainiert auf zwei gängigen Dunst-Datensätzen (RESIDE und FRIDA) liefert die integrierte Pipeline klarere Bilder und zuverlässigere Erkennungsergebnisse als mehrere bestehende Entzischungs- und Qualitätsbewertungsverfahren und übertrifft zudem das Baseline-YOLOv8 in der Erkennungsgenauigkeit bei Nebel.

Was das für reale Visionsysteme bedeutet

Einfach gesagt zeigt die Studie, dass Computer Objekte im Nebel deutlich besser erkennen können, wenn sie zunächst lernen, wie gute Bildqualität unter diesen Bedingungen aussieht, und wenn ihr Lernprozess sorgfältig optimiert wird. Durch die Kombination dunstbewusster Merkmale, einer zeitabhängigen Optimierungsstrategie und eines abgestimmten Erkennungsnetzwerks erhöht das vorgeschlagene System die Klarheit und die Erkennungswerte in Standardmetriken deutlich. Ein solcher integrierter Ansatz könnte Überwachungskameras, Fahrerassistenzsysteme und Fernerkundungsinstrumente bei schlechtem Wetter sicherer und verlässlicher machen.

Zitation: Saini, A., Gill, N.S. & Gulia, P. Leveraging haze-aware features for improved image clarity and detection accuracy with an optimized DCNN-YOLOv8 network. Sci Rep 16, 14213 (2026). https://doi.org/10.1038/s41598-026-38265-5

Schlüsselwörter: Bildentzischung, Objekterkennung, Tiefes Lernen, Computer Vision im Nebel, YOLOv8