Clear Sky Science · de

Energieoptimierte Planung in drahtlosen Sensornetzwerken (WSNs) mittels hybridem, bio-inspiriertem Reinforcement-Learning-Ansatz

Intelligentere Sensoren für eine vernetzte Welt

Von Ackerflächen bis zu Fabrikhallen überwachen drahtlose Sensoren still und leise Stromnetze, Ernten, Brücken und sogar Katastrophengebiete. Es gibt jedoch einen Haken: Diese winzigen Geräte laufen mit kleinen Batterien und sind oft an schwer zugänglichen Stellen verteilt. Das Austauschen leerer Batterien in tausenden Sensoren ist teuer oder unmöglich. Dieser Artikel untersucht eine neue Methode, um zu entscheiden, welche Sensoren aktiv sein sollten und welche gefahrlos schlafen können, sodass das gesamte Netzwerk länger hält, zuverlässig bleibt und so wenig Energie wie möglich verbraucht.

Die Herausforderung ständiger Überwachung

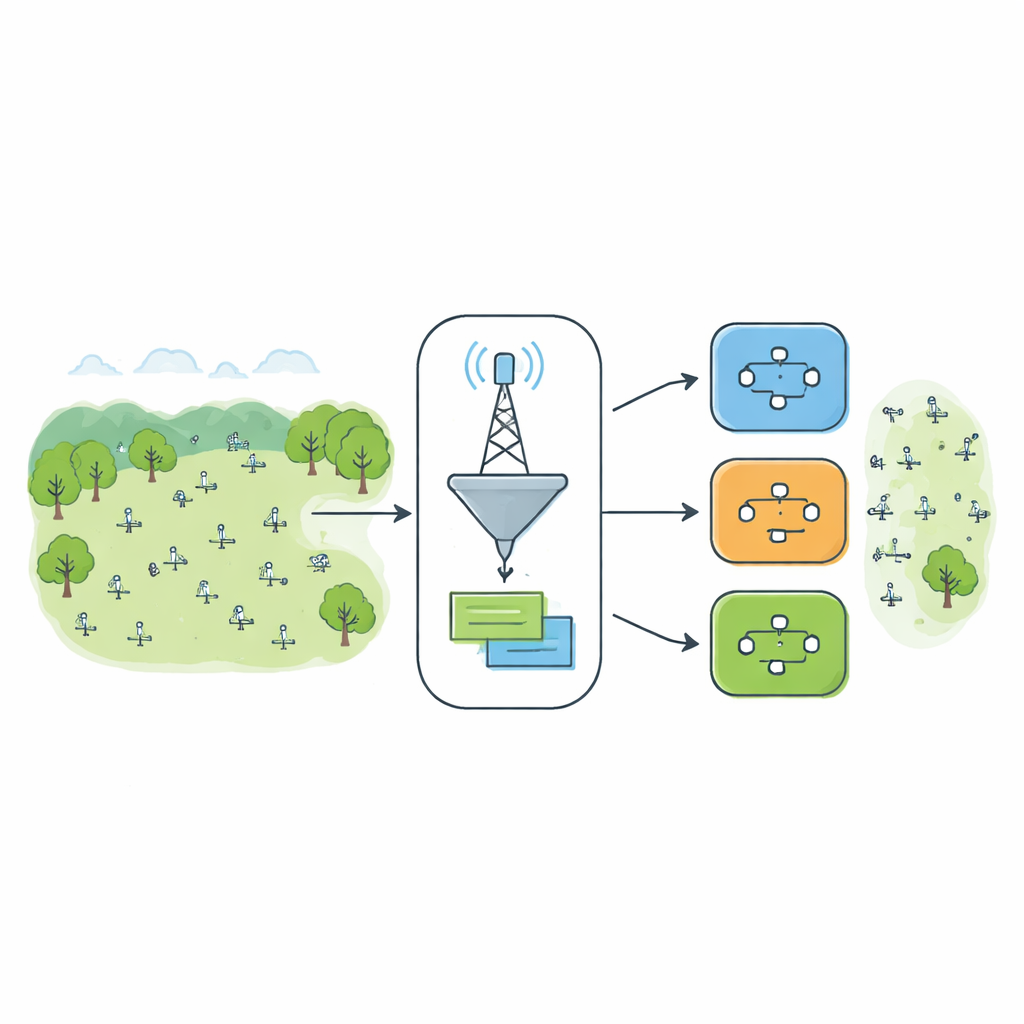

Drahtlose Sensornetzwerke sind wie unsichtbare Decken, die ein Gebiet abdecken und Temperatur, Bewegung, Verschmutzung oder andere Signale abtasten und an eine Basisstation senden. Wenn jeder Sensor dauerhaft eingeschaltet bleibt, ist die Decke dicht, aber kurzlebig: Batterien entleeren sich schnell und das Netzwerk stirbt früh. Sind zu viele Sensoren ausgeschaltet, wird die Abdeckung lückenhaft und Nachrichten erreichen möglicherweise nicht mehr die Basisstation. Die zentrale Herausforderung besteht darin, gerade genug Sensoren aktiv zu halten, an den richtigen Orten und zur richtigen Zeit, um eine gute Abdeckung und Konnektivität zu gewährleisten und gleichzeitig die Batterielebensdauer so weit wie möglich zu strecken.

Von Ameisen, Vögeln und Erfahrung lernen

Forscher entlehnen seit langem Ideen aus der Natur, um solche Probleme anzugehen. Ameiseninspirierte Methoden senden virtuelle „Ameisen“ durchs Netzwerk und verstärken allmählich gute Pfade, ähnlich wie echte Ameisen Pheromonspuren hinterlassen. Vogelinspirierte Methoden behandeln jede mögliche Anordnung aktiver Sensoren als ein „Partikel“ in einem Schwarm, das sich im Laufe der Zeit zu besseren Lösungen bewegt. Diese Ansätze funktionieren in vielen Szenarien gut, haben aber Schwierigkeiten, wenn sich das Netzwerk verändert — wenn Batterien schwinden, Sensoren ausfallen oder die Anordnung sich verschiebt. Sie neigen dazu, festen Regeln zu folgen und können ihr Verhalten nicht leicht anpassen, sobald die Umgebung von dem abweicht, wofür sie optimiert wurden.

Ein hybrides Gehirn, das Strategien wechselt

Die Autoren schlagen einen hybriden Ansatz namens RL-HAPSO vor, der eine neue Wendung einbringt: Er nutzt nicht nur ameisen- und vogelähnliche Suche, sondern lernt auch, wann welche Methode eingesetzt werden sollte. In einer Offline-Phase wählt ein Systemteil eine Menge energieeffizienter Sensoren aus, die aktiviert werden sollen, während ein anderer Teil die Art und Weise neu anordnet, wie diese aktiven Sensoren die Arbeit teilen, um Überlappungen zu reduzieren und die Abdeckung zu erhalten. Darüber hinaus beobachtet ein Lernmodul, wie gut das Netzwerk arbeitet — wie groß der abgedeckte Bereich ist, wie viel Energie noch vorhanden ist und wie viel Redundanz besteht. Basierend auf dieser Momentaufnahme entscheidet es bei jedem Planungsschritt, ob hauptsächlich die ameisenähnliche Suche, die vogelähnliche Verfeinerung oder die kombinierte Hybridstrategie angewendet werden soll. Im Laufe der Zeit entdeckt dieser Meta-Learner, welche Wahl unter welchen Bedingungen tendenziell am besten funktioniert.

Das System auf die Probe stellen

Um herauszufinden, ob dieser lerngetriebene Scheduler mehr als nur eine elegante Idee ist, führten die Forscher umfangreiche Simulationen mit Netzwerken in unterschiedlichen Aufstellungen durch: zufällig verteilte Sensoren, regelmäßige Gitter und gruppierte Cluster, die reale Einsätze nachahmen. Sie verglichen rein ameisenbasierte, rein vogelbasierte, eine feste Hybridvariante der beiden und ihr neues lerngeführtes Hybridmodell. Gemessen wurde, wie viel Energie jede Methode verbrauchte, wie gut sie den Bereich abdeckte, wie schnell sie ein stabiles Muster fand und wie konsistent die Ergebnisse über viele Wiederholungen waren. Die lerngeführte Methode erreichte nicht nur schneller gute Lösungen, sondern lieferte auch geringere Gesamtkosten — das heißt bessere Abdeckung bei weniger Energieverschwendung — und hielt die Leistung stabil, selbst wenn Knoten ausfielen oder die Energielevels sanken.

Was das für Alltagstechnologie bedeutet

Einfach ausgedrückt zeigt die Studie, dass sich drahtlose Sensornetzwerke intelligenter selbst verwalten können, wenn ihre eigenen Planungsregeln als etwas betrachtet werden, das gelernt werden kann und nicht im Voraus festgelegt ist. RL-HAPSO agiert wie ein kluger Dirigent für ein unsichtbares Orchester von Sensoren, entscheidet, welche Instrumente spielen und welche ruhen sollen, und sogar welche Entscheidungsweise in einem gegebenen Moment am besten passt. Dadurch können Sensornetzwerke länger durchhalten, auf wechselnde Bedingungen reagieren und dennoch vertrauenswürdige Daten für Anwendungen wie Smart Farming, Überwachung kritischer Infrastrukturen und Notfallreaktion liefern. Mit der Ausbreitung des Internet der Dinge weisen Ansätze wie dieser den Weg zu Sensorsystemen, die nicht nur verbunden, sondern wirklich adaptiv und ressourcenbewusst sind.

Zitation: Sarobin, M.V.R., Akil, S., Shalu, S.B. et al. Energy optimized scheduling in wireless sensor networks (WSNs) using hybrid bio-inspired reinforcement learning approach. Sci Rep 16, 13109 (2026). https://doi.org/10.1038/s41598-026-35077-5

Schlüsselwörter: drahtlose Sensornetzwerke, energieeffiziente Planung, Reinforcement Learning, bio-inspirierte Optimierung, Internet der Dinge