Clear Sky Science · de

Data-In-situ-Computing mit One-Pixel-Multiple-Memristor-Architektur für neuromorphe sequentielle Sicht

Warum schnellere Sicht wichtig ist

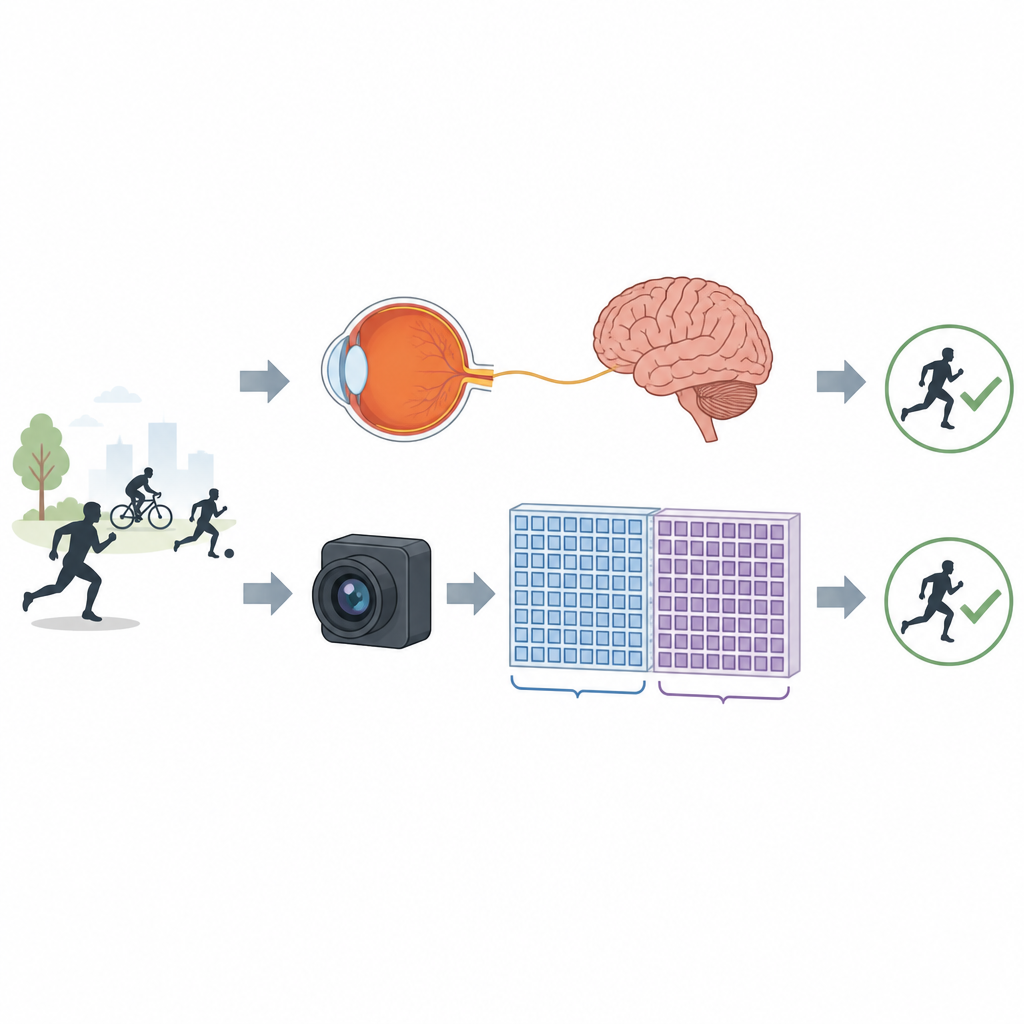

Jedes Mal, wenn eine Kamera in einem Telefon, einem Roboter oder einem autonomen Fahrzeug die Welt aufnimmt, muss sie zunächst Bilder erfassen und diese dann an einen separaten Chip zur Analyse schicken. Dieses Hin und Her kostet Zeit und Energie, besonders bei Videoströmen. Die Studie hinter diesem Artikel untersucht eine neue Art von elektronischem „Auge“, das visuelle Informationen nahezu dort speichern und verarbeiten kann, wo das Licht zuerst auftrifft, und sich dabei von der Art inspirieren lässt, wie das menschliche Gehirn bewegte Szenen verarbeitet.

Wie Auge und Gehirn Bewegung verarbeiten

Beim Menschen wandelt das Auge Licht in winzige elektrische Impulse um, die über Nerven zum Gehirn laufen. Dort hält eine Art visuelles Kurzzeitgedächtnis jüngste Bilder bereit und führt eine erste Vorselektion durch, bevor eine tiefere Erkennung stattfindet. Diese frühe Filterung reduziert die Menge an Information, die bewegt werden muss, und hilft dem Gehirn, schnell und energieeffizient zu bleiben. Die neue Arbeit übernimmt diese Idee, mit dem Ziel, künstlichen Seh-Systemen ein lokales visuelles Arbeitsgedächtnis zu geben.

Eine neue Partnerschaft zwischen Pixel und Speicher

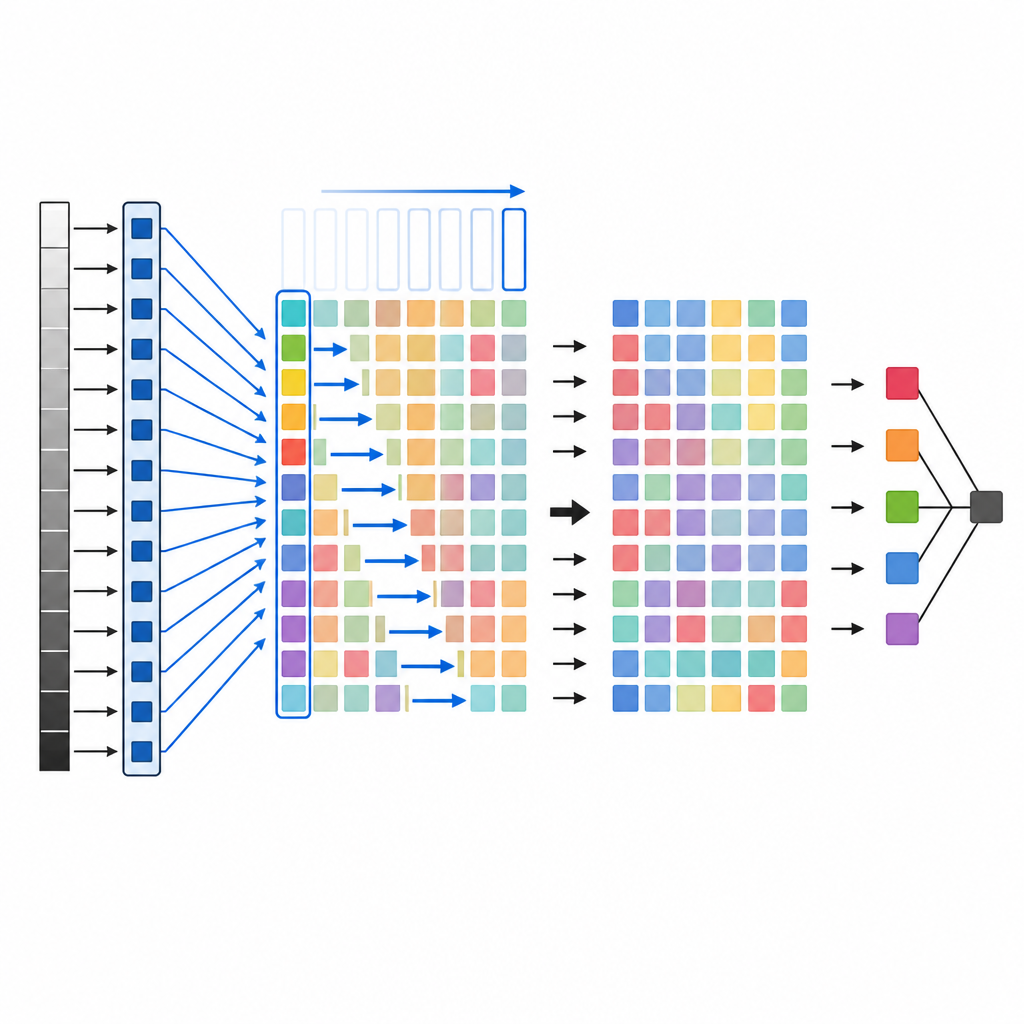

Die Forscher bauten ein Hardware-System, in dem jedes lichtempfindliche Pixel mit vielen winzigen Speicherelementen auf einem Chip verbunden ist. Diese Elemente, Memristoren genannt, können einen Bereich von Werten speichern, nicht nur einfache Ein/Aus-Zustände, und eignen sich daher gut, Helligkeitsnuancen zu halten. Im Entwurf wandelt ein einfacher analoger Schaltkreis das Lichtsignal des Pixels in eine Spannung um, die gleichzeitig mehrere Memristoren programmiert. Diese One-Pixel-zu-vielen-Memristoren-Anordnung erzeugt eine kompakte Abbildung der Szene direkt im Speicher-Gitter, ähnlich wie sich Nervenfasern von der Netzhaut auf viele Gehirnzellen verteilen.

Schnelles „Durchrollen“ der Bilder

Um bewegte Bilder effizient zu erfassen, führte das Team eine „rollende Belichtung“-Strategie ein. Statt einen gesamten Frame zu erfassen und wegzuschicken, schreibt das System eine Pixelspalte nach der anderen in das Memristor-Array und fährt schnell zur nächsten Spalte, bis das komplette Bild gespeichert ist. Eine spezielle Ein-Puls-Methode programmiert viele Memristoren parallel und tauscht dabei einen kleinen Teil Präzision gegen einen großen Gewinn an Geschwindigkeit ein. Tests mit einfachen Silhouetten menschlicher Aktionen und einem Portraitbild zeigen, dass die aus dem Chip wiederhergestellten Bilder die wichtigen Formen und Gesichter ausreichend deutlich erhalten, um eine zuverlässige Erkennung zu ermöglichen, obwohl geringe Störungen vorhanden sind.

Denken dort, wo die Bilder liegen

Die meisten aktuellen smarten Sehhardware-Lösungen trennen nach wie vor Sensorik, Speicher und Rechenoperationen. Im Gegensatz dazu führt dieses System einen Teil des „Denkens“ direkt innerhalb desselben Memristor-Arrays aus, das das Bild hält. Die Forscher legen sorgfältig gewählte Spannungsmuster über das gespeicherte Bild, sodass das Gitter selbst die grundlegenden Rechenschritte eines neuronalen Netzes ausführt. Nur die verdichteten Ergebnisse werden dann zu einem zweiten Memristor-Block geschickt, der die Klassifizierung abschließt. In Tests mit einem bekannten Datensatz menschlicher Aktionen erkannte die Hardware Bewegungen wie Laufen, Springen und Gehen mit 95,7 Prozent Genauigkeit, nahe an den Computersimulationen.

Warum dieser Ansatz Maschinenaugen verändern könnte

Weil Sensorik, Kurzzeitspeicherung und frühe Verarbeitung eng miteinander verwoben sind, reduziert die neue Architektur den Bedarf, Daten zwischen separaten Chips hin- und herzuschicken, drastisch. Die Autoren schätzen, dass ihr Design die Verzögerungszeit für Erfassung und Speicherung von Bildern um etwa das Zweitausendfache senken und den Energiebedarf für Bildverarbeitung im Vergleich zu einem typischen digitalen System mit Standard-Speicher um etwa das 160-fache verringern kann. Für Alltagsanwender könnte das eines Tages kleinere, kühlere und reaktionsschnellere Kameras und visiongeführte Geräte bedeuten, die die Welt eher so beobachten wie wir und nur das aus jedem Moment extrahieren, was wirklich nötig ist.

Zitation: Sun, Y., Tong, P., Shen, J. et al. Data-In-situ Computing with One-Pixel-Multiple-Memristor Architecture for Neuromorphic Sequential Vision. Nat Commun 17, 4244 (2026). https://doi.org/10.1038/s41467-026-70860-y

Schlüsselwörter: neuromorphe Sicht, Memristor, In-Memory-Computing, sequentielle Bilder, energieeffiziente KI