Clear Sky Science · de

Intelligente Erkennung von bestickten Täschchenmustern: Vergleich der YOLO‑Serie und RT‑DETR

Warum alte bestickte Täschchen heute wichtig sind

In ganz China trugen kleine bestickte Täschchen einst Kräuter, Amulette und Wünsche für Glück. Heute überleben viele nur noch in Museumsschubladen und Privatsammlungen. Jede winzige gestickte Blume oder jeder Drache kodiert Geschichten über Glauben, Mode und Alltagsleben. Das Digitalisieren und Katalogisieren dieser reich verzierten Objekte von Hand ist jedoch quälend langsam. Diese Studie untersucht, wie moderne künstliche Intelligenz automatisch die Muster auf diesen Täschchen erkennen kann, um Museen und Gemeinschaften beim Erhalt eines wichtigen Teils des immateriellen Kulturerbes im digitalen Zeitalter zu unterstützen.

Von Hand und Auge zur intelligenten Erkennung

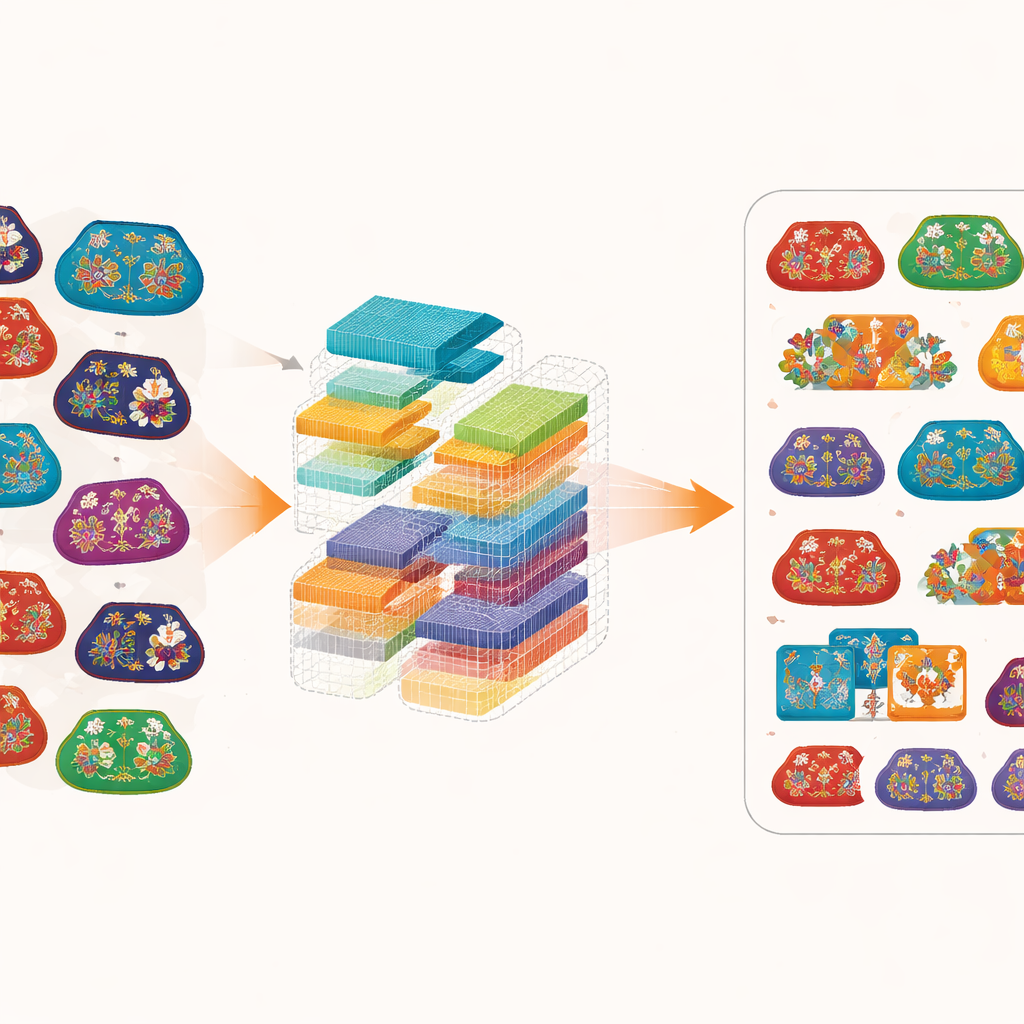

Traditionell identifizierten Expertinnen und Experten Täschchendesigns durch sorgfältige Inspektion von Fotografien und den Abgleich mit Nachschlagewerken. Dieser Ansatz skaliert nicht auf Zehntausende von Objekten, die über Archive verstreut sind. Die Forschenden stellten stattdessen eine spezialisierte Bildsammlung von 783 bestickten Täschchen zusammen, entnommen aus Büchern und dem digitalen Archiv eines großen Museums. Sie definierten acht gebräuchliche Motivkategorien – darunter Pflanzen und Blumen, Vögel und Tiere, Insekten und Wassertiere, Landschaften und Gebäude, Symbole und Schriftzeichen, Figuren und Erzählungen, Artefakte und Antiquitäten sowie geometrische Muster – und zogen dann sorgfältig Begrenzungsrahmen um jedes Muster in jedem Bild. Um der geringen Datengröße entgegenzuwirken, spiegelten, rotierten, aufhellten, abdunkelten und verwischten sie die Bilder digital und vergrößerten dadurch das Trainingsmaterial mehr als vervierfacht, wobei die Labels sowohl mit Software als auch mit Fachleuten für Kulturerbe überprüft wurden.

Beliebte KI‑Werkzeuge im Vergleich

Mit diesem kuratierten Datensatz verglich das Team zwei Familien von Objekterkennungssystemen. Die eine Familie, bekannt als YOLO, wird häufig für schnelle Aufgaben wie das Erkennen von Fußgängern oder Autos in Videos eingesetzt. Diese Modelle betrachten das Bild in einem Durchgang und verlassen sich stark auf lokale Bildbereiche. Das andere, neuere Design namens RT‑DETR kombiniert konventionelle Bildfilter mit transformerartiger Aufmerksamkeit, die winzige Stiche mit der Gesamtszene verbinden kann. Die Autorinnen und Autoren passten zunächst mehrere YOLO‑Varianten an und wählten YOLOv5m als starken Ausgangspunkt. Es erzielte in einigen Kategorien akzeptable Leistungen – insbesondere bei komplexen erzählerischen Szenen unter „Figuren und Erzählungen“ – hatte aber Probleme, wenn die Motive klein, stark überlappend oder im Hintergrund verblasst waren. In solchen Fällen konnten Blumen verschwinden, geometrische Bordüren falsch gelesen werden und Bildbereiche fälschlich als leerer Hintergrund klassifiziert werden.

Wie ein hybrider Transformer die Stiche sieht

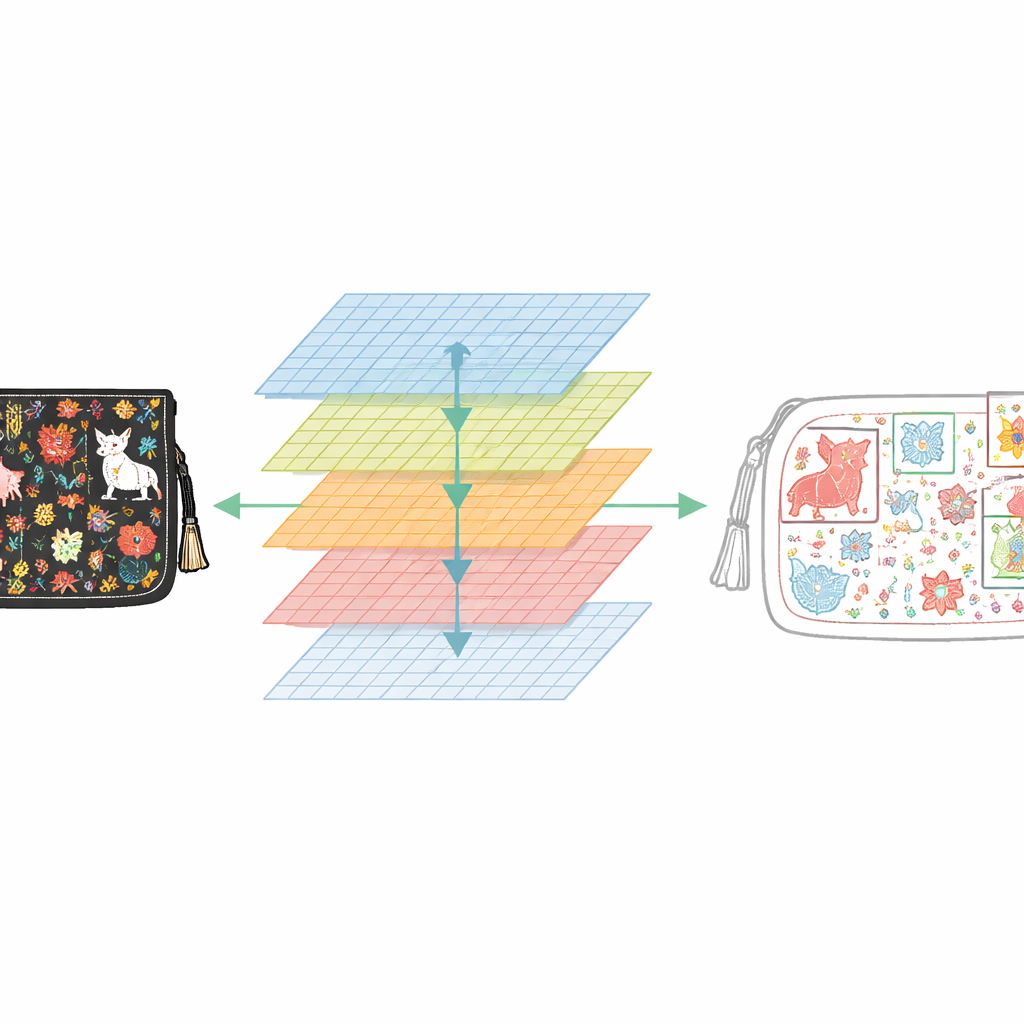

Die Forschenden konzentrierten sich anschließend darauf, RT‑DETR für diese ungewöhnliche visuelle Herausforderung aufzurüsten. Sie ersetzten dessen Standard‑Backbone durch ConvNeXt‑Large, ein modernes Faltungsnetzwerk, das darauf ausgelegt ist, feine Texturen zu erfassen und gleichzeitig das größere Bild zu sehen. Außerdem übernahmen sie eine Trainingsstrategie namens Focal Loss, die dem Modell sagt, besonders schwierigen, leicht verwechselbaren Beispielen mehr Aufmerksamkeit zu schenken, statt sich auf die einfachen zu verlassen. Innerhalb von RT‑DETR werden Merkmale aus dem Taschenbild in mehreren Skalen extrahiert und verschmolzen, während ein Aufmerksamkeitsmechanismus entfernte, aber verwandte Regionen verbindet, etwa passende Tierpaare oder wiederkehrende Bordüren. Durch sorgfältige Ablationsstudien und schrittweises Abstimmen von Lernplänen und Regularisierung gelangten die Autorinnen und Autoren zu einer optimierten Konfiguration, die Genauigkeit und Stabilität über viele Trainingsläufe ausbalanciert.

Was das verbesserte System tatsächlich erreicht

Gemessen an Standard‑Objekterkennungsmetriken übertraf das verbesserte RT‑DETR deutlich die YOLO‑Modelle. Seine Hauptgenauigkeitsmetrik, mAP@0.5, erreichte 0,5433 – etwa eine 33‑%ige Verbesserung gegenüber dem YOLOv5m‑Baseline – mit statistischen Auswertungen, die zeigen, dass dieser Gewinn kaum zufällig ist. Das System war besonders erfolgreich bei komplexen erzählerischen Szenen und erreichte eine durchschnittliche Präzision von 0,833 für „Figuren und Erzählungen“. Es stellte viele Motive wieder her, die YOLO verpasst hatte, insbesondere in spärlichen oder unterrepräsentierten Kategorien wie Landschaften und geometrischen Bordüren. Außerdem zeigte es sich in wiederholten Experimenten konsistenter, was auf zuverlässiges Verhalten statt auf fragiles Überanpassen an eine einzelne Trainings‑Test‑Aufteilung hindeutet. Der Kompromiss ist die Größe: Das beste RT‑DETR‑Modell ist deutlich größer und schwerer als seine YOLO‑Pendants, was die Bereitstellung auf leichten Geräten einschränken könnte.

Was das für das Kulturerbe bedeutet

Für Nicht‑Fachleute ist die Kernbotschaft, dass Computer nicht nur lernen, Autos und Gesichter zu finden, sondern die Sprache traditionellen Handwerks zu lesen. Indem gezeigt wird, dass ein transformerbasierter Detektor, sorgfältig angepasst und trainiert, dichte, überlappende Stickmotive genauer erkennt als populäre Echtzeitmodelle, setzt diese Arbeit einen Referenzpunkt für künftige Werkzeuge. Museen und Kultureinrichtungen könnten solche Systeme schließlich nutzen, um große Fotosammlungen nach Motiven zu durchsuchen, nachzuverfolgen, wie sich bestimmte Symbole entwickelt haben, oder Handwerkern beim Wiederbeleben alter Designs zu helfen. Die Autorinnen und Autoren betonen, dass die Leistung weiterhin moderat ist und weitere Verfeinerungen – einschließlich leichterer Modelle sowie der Ergänzung durch kulturelles Wissen und Textbeschreibungen – nötig sind, bevor eine großflächige Anwendung möglich ist. Dennoch markiert die Studie einen bedeutenden Schritt hin zu einer intelligenten, respektvollen digitalen Bewahrung des Erbes bestickter Täschchen.

Zitation: Yang, H., Sui, Q., Xie, H. et al. Intelligent recognition of embroidered purse patterns: comparing YOLO series and RT-DETR. npj Herit. Sci. 14, 251 (2026). https://doi.org/10.1038/s40494-026-02518-3

Schlüsselwörter: Erkennung von Stickmustern, immaterielles Kulturerbe, Objekterkennung, transformatorbasierte Vision, digitale Bewahrung