Clear Sky Science · sv

Finmaskig representationsinlärning för detektion av lågresurs Yi-skrift och konstruktion av dataset

Bevara ett bräckligt skriftligt kulturarv

Yi-folket i sydvästra Kina har bevarat en rik skriftlig tradition i århundraden, där medicin, astronomi, religion och vardagsliv skrevs ner i deras egen skrift. Många av dessa manuskript bleknar dock, är fläckiga eller på annat sätt skadade, och skriften i sig är visuellt komplex. Manuell transkribering av hundratusentals tecken är långsam och kostsam. Denna artikel presenterar ett nytt datorvisionssystem särskilt utformat för att hitta och isolera Yi-tecken i digitala bilder av gamla dokument, vilket lägger grunden för storskalig digitalisering och bevarande av detta hotade skrivna arv.

Varför denna skrift är så svår för datorer

Till skillnad från det mer bekanta latinska alfabetet eller även modern tryckt kinesiska byggs Yi-tecken av täta, kurviga streck som ofta slingrar sig runt varandra. Många olika tecken ser mycket lika ut, och samma tecken kan förekomma i något olika former över tid och mellan manuskript. Historiska sidor använder ofta täta flerspaltiga layouter, med oregelbundna mellanrum och överlappande streck. Dessutom kan bläcket vara blekt, sidorna skeva och bakgrunden fläckig. Äldre detektionsmetoder som förlitar sig på fasta regler om avstånd eller generiska textdetektionsmodeller tenderar att slå samman närliggande tecken, missa svaga streck eller förväxla bakgrundsbrus med skrift. Författarna hävdar att Yi-manuskript utgör ett slags "värsta fall" för textdetektion, och att lösning av detta problem kan hjälpa många andra lågresurs-skrifter.

Ett nytt sätt att se fina detaljer

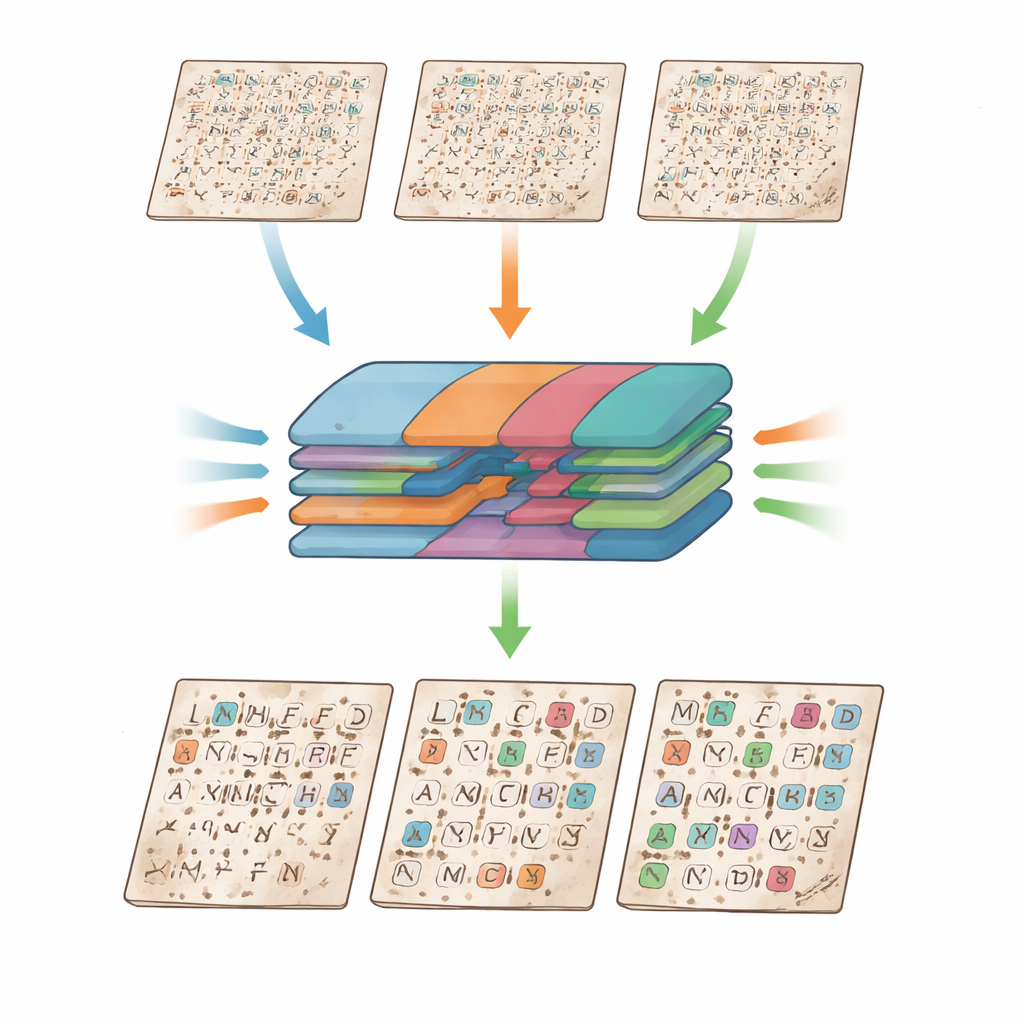

För att tackla dessa utmaningar utformar forskarna ett specialiserat neuralt nätverk kallat FGRL-YiNet (Fine-Grained Representation Learning Network for Yi). I dess kärna finns en variant av standardkonvolutionella lager, som är ryggraden i modern bildigenkänning. Istället för att använda ett fast filtermönster överallt använder FGRL-YiNet dynamisk konvolution: flera kandidatfilter arbetar parallellt och en liten styrmodul avgör för varje region i bilden hur mycket som ska förlitas på respektive filter. Detta gör att systemet subtilt kan justera sitt "receptiva fält" efter lokala streckmönster, och fånga ömtåliga kurvor och korsningar bättre utan att störas av rörig bakgrund eller sidskador. Byggt på en kompakt ResNet-18-ryggrad hålls modellen medvetet måttlig i storlek så att den kan lära effektivt från den relativt begränsade mängd annoterad Yi-data.

Kombinera skalor och rensa upp sidan

Att detektera tecken på en hel manuskriptsida kräver också att man förstår mönster i flera storlekar samtidigt — från små krumbukter i ett enda streck till layouten för en hel spalt. FGRL-YiNet introducerar en Adaptive Multi-Scale Fusion (AMSF)-modul för detta. Nätverket extraherar först funktioner i flera upplösningar och använder sedan en gemensam uppmärksamhetsmekanism för att avgöra vilken skala och vilka kanaler som är viktigast på varje plats. En del av denna uppmärksamhet fokuserar på "var" i bilden fina detaljer är viktiga, medan en annan del fokuserar på "vilken" typ av funktion som är användbar — till exempel en viss streckbredd eller en liten ögla inuti ett tecken. Parallellt lär sig en differentiabel binariseringsterm att skilja bläck från bakgrund genom att förutsäga både en sannolikhetskarta och en lokalt varierande tröskel. Eftersom detta steg är inbyggt i nätverket och tränas end-to-end kan det bevara svaga streck som traditionell svartvit konvertering skulle tvätta bort, samtidigt som prickar och fläckar dämpas.

Bygga ett benchmark för en sällsynt skrift

Ett stort hinder för alla specialiserade skriftsystem är data: det finns få högkvalitativa digitaliserade Yi-manuskript, och ännu färre med precisa etiketter för varje tecken. Teamet tar itu med detta genom att konstruera datasetet YiPrint-694 från Liangshan Yi-klassiker, vilket resulterar i nästan 347 000 märkta tecken över 694 sidbilder och 1 165 teckenkategorier. De kombinerar noggrann förbehandling — brusreduktion, kantförstärkning och binarisering — med en semi-automatisk segmenteringspipeline och mödosam manuell kontroll av Yi-språkexperter. För att efterlikna utseendet hos äldre, missfärgade sidor skapar de ytterligare bilder med gulfärgade och bruna bakgrunder. Denna kurerade samling blir både träningsunderlaget för FGRL-YiNet och ett offentligt benchmark för framtida forskning om Yi och närliggande skriftsystem.

Hur väl systemet presterar

När det testas mot ett brett urval av toppmoderna textdetektorer, inklusive välanvända modeller som Faster R-CNN, DBNet++ och PSENet, uppnår FGRL-YiNet de bästa sammanlagda poängen på YiPrint-694. Det detekterar tecken med ett högt f-värde på 94,7 %, drivet av mycket hög precision (98,4 %) och stark återkallning (91,3 %), vilket betyder att det sällan förväxlar bakgrund med text samtidigt som det hittar de flesta tecken på sidan. Ablationsstudier, där enskilda komponenter tas bort, visar att varje innovation — dynamisk konvolution, adaptiv multi-scale fusion och differentiabel binarisering — bidrar med mätbara förbättringar, och att de fungerar bäst tillsammans. Modellen överförs också väl till det större MTHv2-datasetet med historiska kinesiska buddhistiska texter, där den presterar konkurrenskraftigt med ledande allmänna detektorer, vilket lyfter fram dess bredare potential.

Vad detta betyder för kulturbevarande

För icke-specialister är huvudsakliga budskapet att omsorgsfull, målinriktad design kan hjälpa datorer att läsa några av världens mest utmanande skriftsystem, även när träningsdata är begränsade. Genom att kombinera adaptiva filter, smart multi-scale fusion och inbyggd rengöring av degraderade sidor kan FGRL-YiNet pålitligt lokalisera enskilda Yi-tecken i trånga, skadade manuskript. Det gör det mycket enklare att bygga sökbara digitala arkiv, stödja lingvistisk och historisk forskning och skydda Yi-folkets skriftliga arv. Författarna ser sin arkitektur och sitt dataset som en ritning för att ta itu med andra eftersatta skriftsystem i världen och visar att framsteg inom artificiell intelligens kan spela en direkt roll i att bevara bräckligt kulturarv för kommande generationer.

Citering: Sun, H., Ding, X., Yu, H. et al. Fine grained representation learning for low resource Yi script detection and dataset construction. npj Herit. Sci. 14, 183 (2026). https://doi.org/10.1038/s40494-026-02418-6

Nyckelord: Yi-skrift, historiska manuskript, textdetektion, digitalt kulturarv, djuplärande