Clear Sky Science · pl

Porównawcza ocena metod uczenia maszynowego i głębokiego uczenia do przewidywania wytrzymałości na ściskanie betonu geopolimerowego

Nowy sposób projektowania bardziej ekologicznego betonu

Beton stanowi kręgosłup współczesnych miast, jednak produkcja tradycyjnego cementu wiąże się z emisją dużych ilości dwutlenku węgla. Beton geopolimerowy oferuje czystszą alternatywę, jednak inżynierowie wciąż mają trudności z przewidywaniem jego wytrzymałości po stwardnieniu. W badaniu pokazano, jak współczesne narzędzia danych, w tym metody uczenia maszynowego i głębokiego, potrafią uczyć się na podstawie setek wcześniejszych eksperymentów, aby prognozować wytrzymałość mieszanek betonu geopolimerowego i wspierać bardziej ekologiczne budownictwo przy mniejszej liczbie kosztownych prób.

Dlaczego trudniej osiągnąć ekologiczny beton

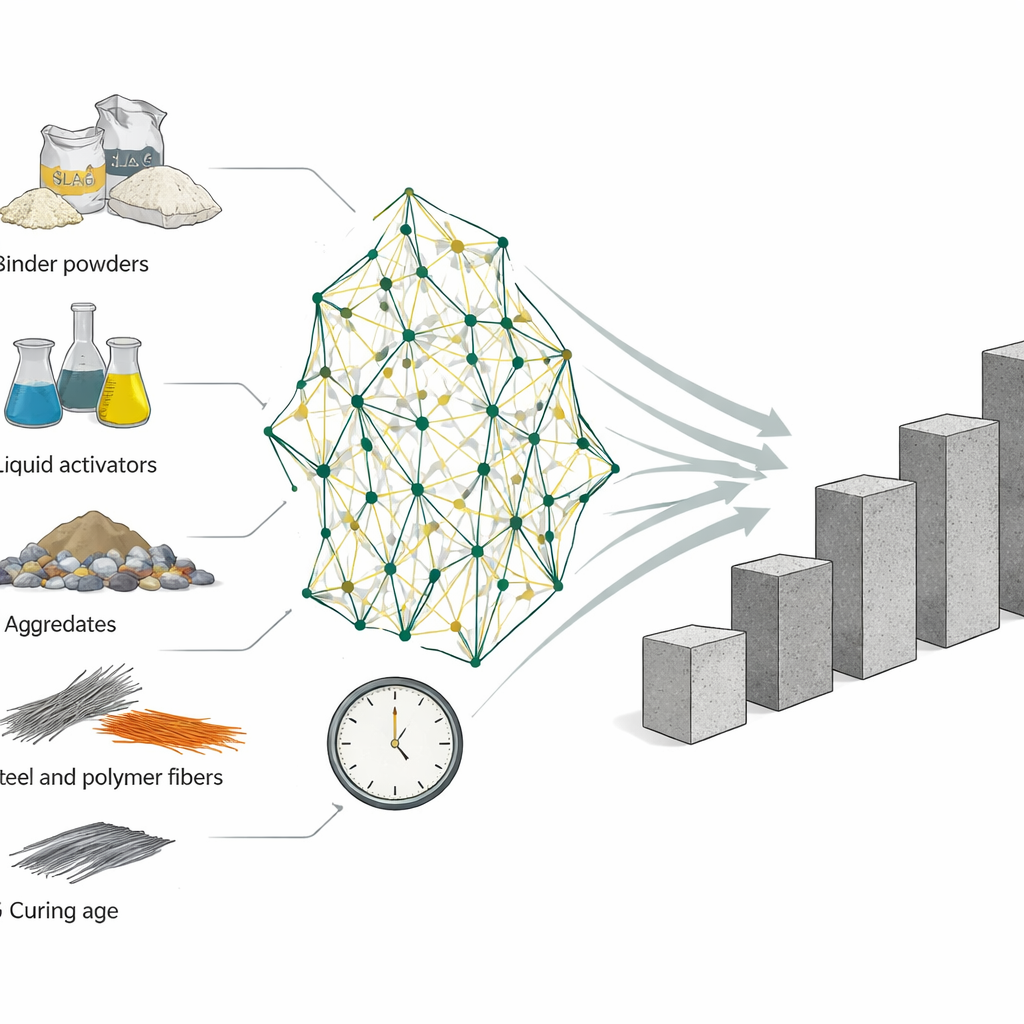

Beton geopolimerowy zastępuje dużą część zwykłego cementu produktami ubocznymi przemysłu, takimi jak popiół lotny, żużel, metakaolin i dym krzemionkowy. Te proszki reagują z alkalicznymi cieczami, tworząc stały, kamienny materiał, który może dorównywać lub przewyższać wytrzymałość standardowego betonu, jednocześnie redukując emisje CO2 nawet o około 70 procent. Jednak ta bardziej ekologiczna receptura jest wrażliwa: wytrzymałość zależy od wielu powiązanych czynników, w tym rodzaju i ilości proszków, dawkowania i stężenia cieczy alkalicznych, ilości wody i dodatków chemicznych, ziaren piasku i kruszywa, włókien dodanych dla wytrzymałości oraz czasu i warunków dojrzewania. Ponieważ wszystkie te składniki wchodzą w złożone, nieliniowe interakcje, proste równania nie wystarczą do przewidzenia wytrzymałości nowej mieszanki.

Tworzenie obszernych, spójnych zbiorów danych

Aby sprostać tej złożoności, autorzy zebrali duży, zunifikowany zestaw danych z 19 opublikowanych badań, obejmujący 594 różnych mieszanek betonu geopolimerowego. Każdy rekord opisuje kluczowe składniki, takie jak ilości popiołu lotnego, żużla, metakaolinu, pyłu krzemionkowego, piasku, kruszywa, wody, cieczy alkalicznych i superplastyfikatora, wraz z włóknami stalowymi i polipropylenowymi oraz wiekiem dojrzewania w dniach. Zespół starannie oczyścił dane: usunął duplikaty, ujednolicił jednostki i nazwy zmiennych oraz zachował tylko te mieszanki, dla których informacje były kompletne. W efekcie powstał zróżnicowany, ale spójny zbiór obejmujący szeroki zakres wytrzymałości — od relatywnie słabych po betony o bardzo wysokich parametrach — odzwierciedlający rzeczywiste rozpiętości obserwowane w wielu laboratoriach.

Pozwolenie maszynom uczyć się na podstawie wcześniejszych mieszanek

Z takim zbiorem danych badacze wytrenowali zestaw modeli prognostycznych. W klasycznym podejściu zastosowali kilka metod uczenia maszynowego, w tym drzewa decyzyjne, lasy losowe oraz zaawansowane techniki „boostingu”, które łączą wiele słabszych modeli w silniejszego predyktora. W obszarze głębokiego uczenia przetestowali dwie sieci neuronowe o różnej głębokości oraz nowoczesny model tabularny o nazwie TabNet, wykorzystujący mechanizm uwagi do skupienia się na najbardziej informatywnych składnikach. Dane podzielono tak, że 80 procent mieszanek służyło do nauki modeli, a pozostałe 20 procent odłożono do testów, aby ocenić, jak dobrze każda metoda potrafi przewidzieć nieznane wyniki przy użyciu standardowych miar błędu i dopasowania.

Które modele sprawdziły się najlepiej i dlaczego

Wyraźnym zwycięzcą wśród metod uczenia maszynowego okazała się metoda boostingu o nazwie CatBoost, która dostarczyła bardzo dokładnych prognoz wytrzymałości i dobrze odwzorowała dane testowe w całym zakresie wartości. Innym modelem boostingowym, XGBoost, zajął bliskie drugie miejsce. Wśród narzędzi głębokiego uczenia najlepsze wyniki osiągnął TabNet, skutecznie rywalizując z najlepszym modelem uczenia maszynowego, podczas gdy głębsza sieć neuronowa o większej liczbie warstw wypadła gorzej — prawdopodobnie dlatego, że rozmiar zestawu danych był zbyt umiarkowany dla tak złożonej struktury. Aby uczynić te „czarne skrzynki” bardziej przejrzystymi, autorzy użyli narzędzia wyjaśniającego SHAP, które przypisuje każdemu wejściu miarę ważności. Analizy wykazały, że zawartość żużla oraz wiek dojrzewania konsekwentnie dominują w przewidywaniu wytrzymałości, a następnie istotne są inne składniki spoiwa, dawki alkaliczne i ilości kruszywa, podczas gdy włókna stalowe i plastikowe odgrywają tylko rolę drugorzędną dla wytrzymałości na ściskanie, mimo że mogą silnie wpływać na pękanie i odporność na rozciąganie.

Co to oznacza dla przyszłego budownictwa

Mówiąc krótko, praca ta pokazuje, że komputery mogą uczyć się na podstawie setek wcześniejszych przepisów na beton geopolimerowy, dostarczając szybkich i wiarygodnych estymacji wytrzymałości nowej, przyjaznej środowisku mieszanki. Zamiast odlewać i kruszyć dużą liczbę próbnych walców, inżynierowie mogą użyć tych modeli, aby zawęzić obiecujące kombinacje proszków spoiwa, cieczy aktywujących i czasów dojrzewania przed przejściem do laboratorium. Badanie podkreśla też, które składniki mają największe znaczenie, dając praktyczne wskazówki: właściwe dobranie zawartości żużla, poziomów aktywatora i warunków dojrzewania ma znacznie większe znaczenie dla wytrzymałości na ściskanie niż dopracowywanie ilości włókien. Choć modele wciąż wymagają walidacji na większych i bardziej ustandaryzowanych zbiorach danych, ramy te stanowią istotny krok w kierunku projektowania betonu o niższym śladzie węglowym, wspieranego danymi.

Cytowanie: Ezz, H., Bakr, S.M. Comparative evaluation of machine learning and deep learning approaches for compressive strength prediction of geopolymer concrete. Sci Rep 16, 14652 (2026). https://doi.org/10.1038/s41598-026-50705-w

Słowa kluczowe: beton geopolimerowy, uczenie maszynowe, głębokie uczenie, przewidywanie wytrzymałości na ściskanie, zrównoważone budownictwo