Clear Sky Science · pl

Komplementarne podejście łączenia lokalizacji wzrokowej i mapowania dotykowego do percepcji robotycznej obiektów o rozmiarach milimetrowych z nieregularnymi powierzchniami

Roboty, które widzą i czują

W wielu niebezpiecznych miejscach — od stacji kosmicznych po tereny awarii jądrowych — ludzie polegają na robotach, które obsługują małe przełączniki, pigułki, śrubki i przyciski. Jednak standardowe „oczy” robotów często zawodzą przy słabym oświetleniu lub gdy obiekty są bardzo małe i nierówne. W artykule przedstawiono system sensoryczny robota łączący wzrok i dotyk, inspirowany sposobem, w jaki ludzie najpierw oglądają obiekt, a następnie badają go opuszkami palców.

Dlaczego sam wzrok nie wystarczy

Większość nowoczesnych robotów polega na kamerach i czujnikach głębi, by rozpoznawać obiekty i decydować o ruchu. Narzędzia te działają dobrze w czystych, dobrze oświetlonych fabrykach, ale mają problemy, gdy scena jest ciemna, zatłoczona lub częściowo zasłonięta. Autorzy pokazują, że nawet zaawansowane systemy kamer mogą stracić ślad małych przedmiotów lub nie zauważyć drobnych cech powierzchni, szczególnie przy słabym świetle lub odblaskach. W takich przypadkach robot może znać przybliżone położenie czegoś, ale nie wiedzieć, czy na powierzchni są maleńkie wypukłości, wgłębienia lub nieregularne krawędzie kluczowe do precyzyjnego chwytu czy naciśnięcia.

Budowa palca, który wyczuwa drobne detale

Aby rozwiązać ten problem, badacze skonstruowali miękki, przypominający skórę czujnik dotykowy działający bardziej jak ludzki opuszek palca. Za pomocą druku atramentowego nanieśli elastyczne ścieżki metalowe na rozciągliwy, gumopodobny materiał, tworząc siatkę pikseli czułych na nacisk. Pomiędzy warstwami metalu umieszczono teksturowaną folię wykonaną z zwykłego papieru ściernego, nadającą czujnikowi drobną, nieregularną strukturę zwiększającą jego czułość. Gdy czujnik naciska na obiekt, jego sygnał elektryczny zmienia się w zależności od nacisku, co pozwala wykrywać bardzo delikatne dotknięcia — aż do poziomu ziarenka ryżu — oraz wytrzymać tysiące cykli dociskania i zwalniania bez utraty wydajności.

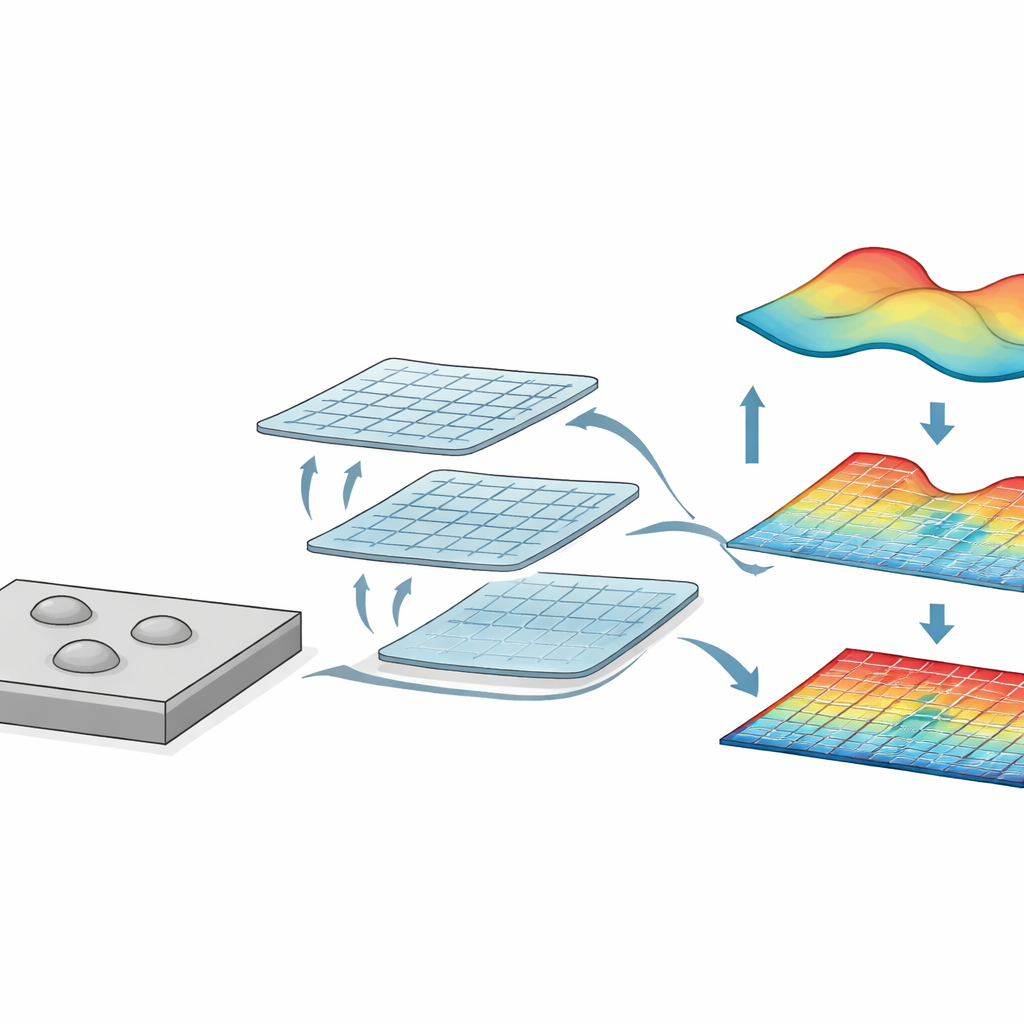

Przekształcanie dotyku w mapy kształtu

Miękki czujnik został następnie rozszerzony do niewielkiej matrycy, która może rejestrować rozkłady nacisku na pewnym obszarze, podobnie jak obraz o niskiej rozdzielczości. Gdy zespół przykładł do czujnika obiekty w kształcie pierścieni lub inne skomplikowane kształty, powstałe mapy nacisku wyraźnie uwidaczniały ich kontury i puste przestrzenie, pokazując, że czujnik potrafi „widzieć” kształty poprzez dotyk. Symulacje komputerowe potwierdziły, że miękki materiał lokalizuje naprężenia podobnie jak ludzka skóra, co pomaga wychwytywać subtelne różnice wysokości i tekstury na cechach rzędu milimetrów, takich jak drobne wypukłości lub występy na powierzchni.

Pozwolenie wzrokowi i dotykowi na współpracę

Kompletny system wykorzystuje kamerę RGB-Depth do odnajdywania położenia obiektu w przestrzeni oraz miękką podkładkę dotykową do badania jego powierzchni. Najpierw kamera ocenia pozycję obiektu i jego ogólny kształt z dystansu, podobnie jak człowiek rzucający okiem na stół przed sięgnięciem. Gdy informacje wzrokowe stają się zawodn e — z powodu cieni, odblasków lub problemów z ostrością — robot zbliża czujnik dotykowy do obiektu. Skanując podkładkę po różnych częściach powierzchni i składując dane o nacisku, system rekonstruuje trójwymiarowy profil cech o rozmiarach zaledwie kilku milimetrów, takich jak wypukłe kopułki tabletek w blistrze czy drobne nierówności na panelu sterowania.

Co to oznacza dla przyszłych robotów

Poprzez połączenie lokalizacji opartej na kamerze z szczegółowym mapowaniem dotykowym, praca ta pokazuje, jak roboty mogą obsługiwać małe, nieregularne obiekty nawet wtedy, gdy nie mogą w pełni polegać na „wzroku”. Badanie wykazuje, że prosty, tani czujnik drukowany może zarówno wspierać, jak i — gdy zachodzi potrzeba — zastępować wzrok. To tworzy podstawy pod przyszłe roboty, które dostosowują się do zmieniających się warunków, łącząc wzrok i dotyk tak jak ludzie, aby wykonywać precyzyjne zadania w nieporządnych, nieprzewidywalnych lub niebezpiecznych środowiskach.

Cytowanie: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Słowa kluczowe: roboty humanoidalne, czucie dotykowe, percepcja multimodalna, micromanipulacja, wizja RGB-głębia