Clear Sky Science · nl

Complementaire visuele lokalisatie en tactische maattiling voor robotwaarneming van millimetergrote objecten met onregelmatige oppervlakken

Robots die kunnen zien en voelen

Op veel gevaarlijke locaties — van ruimtestations tot kernrampterreinen — zijn mensen afhankelijk van robots om kleine schakelaars, pillen, schroeven en knoppen te hanteren. Maar gewone robot"ogen" falen vaak wanneer de verlichting slecht is of objecten zeer klein en ruw van oppervlak zijn. Dit artikel introduceert een robotsensorsysteem dat zicht en aanraking combineert, geïnspireerd op de manier waarop mensen eerst naar een object kijken en het vervolgens met hun vingertoppen verkennen.

Waarom alleen visie niet genoeg is

De meeste moderne robots vertrouwen op camera's en dieptesensoren om objecten te herkennen en te beslissen hoe ze moeten bewegen. Deze visuele hulpmiddelen werken goed in schone, goed verlichte fabrieken, maar hebben moeite wanneer de scène donker, druk of gedeeltelijk verborgen is. De auteurs tonen aan dat zelfs krachtige camerasystemen kleine voorwerpen kunnen verliezen of fijne oppervlakdetails missen, vooral bij weinig licht of hinderlijke schittering. In zulke gevallen kan een robot ongeveer weten waar iets zich bevindt, maar niet of het kleine bultjes, holtes of onregelmatige randen heeft die cruciaal zijn voor precies grijpen of indrukken.

Een vinger bouwen die kleine details kan voelen

Om dit probleem aan te pakken, bouwden de onderzoekers een zachte, huidachtige voel-sensor die meer als een menselijke vingerpunt gedraagt. Met inkjetprinten brachten ze flexibele metalen banen aan op een rekbaar, rubberachtig materiaal en vormden zo een raster van druksensitieve pixels. Tussen de metalen lagen bevindt zich een getextureerde film gemaakt met gewoon schuurpapier, wat de sensor een fijne, onregelmatige structuur geeft die de gevoeligheid vergroot. Wanneer de sensor tegen een object wordt gedrukt, verandert zijn elektrische signaal met de druk, waardoor hij zeer lichte aanrakingen kan detecteren — tot aan het niveau van een klein rijstkorreltje — en duizenden indruk- en loslaatcycli kan doorstaan zonder prestatieverlies.

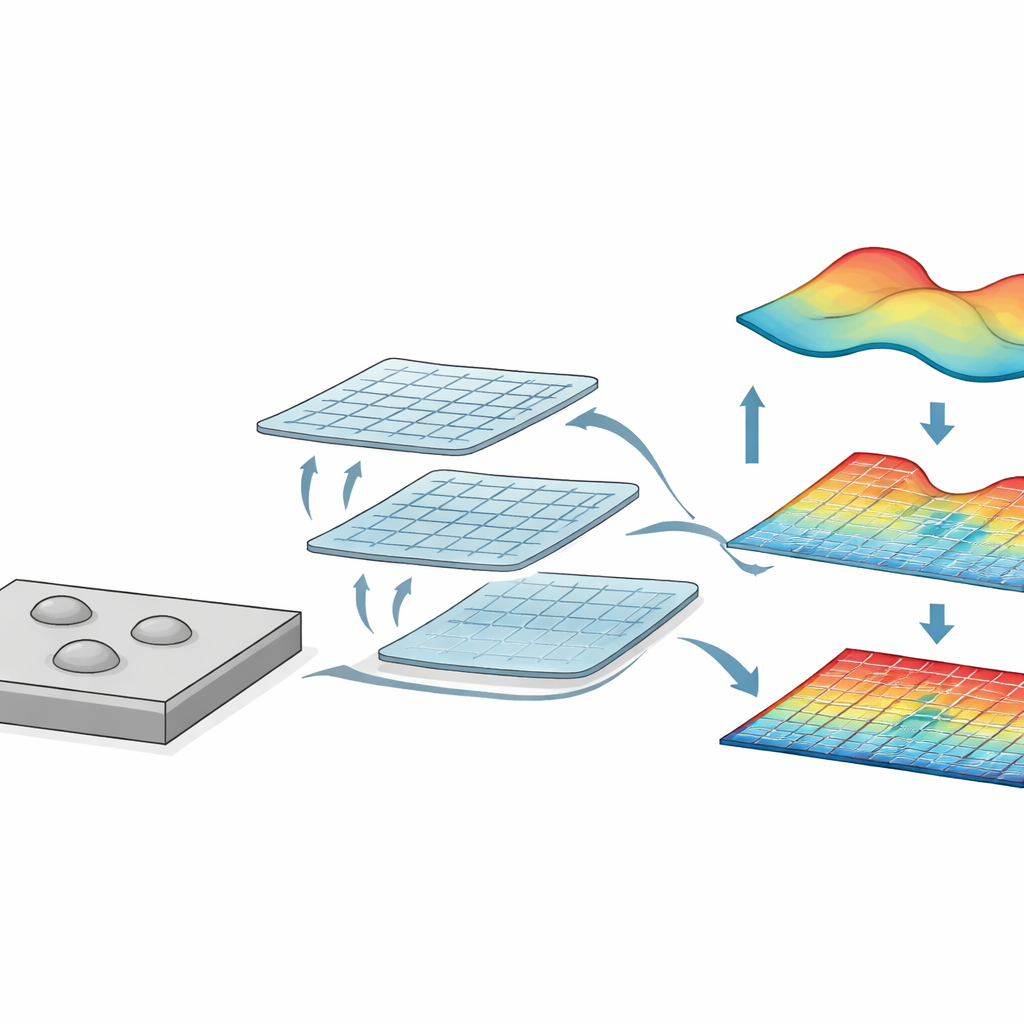

Aanraking omzetten in vormkaarten

De zachte sensor werd vervolgens uitgebreid tot een klein array dat drukpatronen over een gebied kan vastleggen, vergelijkbaar met een beeld met lage resolutie. Wanneer het team ringvormige of andere complexe objecten op de sensor drukte, onthulden de resulterende drukkaarten duidelijk hun omtrekken en holle ruimten, wat aantoonde dat de sensor vormen via aanraking kan "zien". Computersimulaties bevestigden dat het zachte materiaal spanningen lokaal concentreert, vergelijkbaar met menselijke huid, wat helpt fijne hoogte- en textuurverschillen op millimetergrote kenmerken zoals kleine bultjes of uitstekende delen op een oppervlak op te pikken.

Visie en aanraking laten samenwerken

Het volledige systeem gebruikt een RGB-dieptecamera om te bepalen waar een object zich in de ruimte bevindt en een zachte tactiele pad om het oppervlak te verkennen. Eerst schat de camera de positie en de algemene vorm van het object op afstand, vergelijkbaar met hoe een persoon vluchtig naar een tafel kijkt voordat hij reikt. Wanneer visuele informatie onbetrouwbaar wordt — door schaduwen, schittering of scherpstelproblemen — brengt de robot zijn tactiele sensor in contact met het object. Door het pad over verschillende delen van het oppervlak te scannen en de drukgegevens aan elkaar te plakken, reconstrueert het systeem een driedimensionaal profiel van kenmerken van slechts een paar millimeter, zoals de verhoogde koepeltjes van pillen in een stripverpakking of kleine bultjes op een bedieningspaneel.

Wat dit betekent voor toekomstige robots

Door cameragebaseerde lokalisatie te combineren met gedetailleerde aanraking-gebaseerde mapping toont dit werk aan hoe robots kleine, onregelmatige objecten kunnen hanteren, zelfs wanneer ze niet volledig op hun "ogen" kunnen vertrouwen. De studie laat zien dat een eenvoudige, goedkope geprinte sensor zowel kan ondersteunen als, wanneer nodig, kan optreden in plaats van visie. Dit legt de basis voor toekomstige robots die zich aanpassen aan veranderende omstandigheden en zicht en aanraking combineren zoals mensen doen om precieze taken uit te voeren in rommelige, onvoorspelbare of gevaarlijke omgevingen.

Bronvermelding: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Trefwoorden: humanoïde robots, tactiele sensing, multimodale perceptie, micromanipulatie, RGB-diepte visie