Clear Sky Science · nl

Fijnkorrelige representatieleren voor detectie van het Yi-schrift met weinig bronnen en datasetconstructie

Het bewaren van een kwetsbaar geschreven erfgoed

Het Yi-volk in het zuidwesten van China heeft al eeuwenlang een rijke geschreven traditie behouden, waarin geneeskunde, sterrenkunde, religie en het dagelijks leven in hun eigen schrift zijn vastgelegd. Veel van deze manuscripten vervagen echter, zijn bevlekt of anderszins beschadigd, en het schrift zelf is visueel complex. Honderdduizenden tekens handmatig transcriberen is langzaam en duur. Dit artikel presenteert een nieuw computerzichtsysteem dat specifiek is ontworpen om Yi-tekens in digitale afbeeldingen van oude documenten te vinden en te isoleren, en legt daarmee de basis voor grootschalige digitalisering en het behoud van dit bedreigde geschreven erfgoed.

Waarom dit schrift zo moeilijk is voor computers

In tegenstelling tot het meer vertrouwde Latijnse alfabet of zelfs modern gedrukt Chinees, bestaan Yi-tekens uit dichte, gebogen streken die vaak om elkaar heen lopen. Veel verschillende tekens lijken extreem op elkaar, en hetzelfde teken kan in kleine variaties voorkomen tussen tijdperken en manuscripten. Historische pagina’s gebruiken vaak strakke meerkolomlay-outs, met onregelmatige ruimtes en overlappende streken. Daarbovenop kan de inkt vervagen, kunnen pagina’s vervormen en kunnen achtergronden vlekkerig zijn. Oudere detectiemethoden, die vertrouwen op vaste regels over afstand of op generieke tekstdetectiemodellen, hebben de neiging aangrenzende tekens samen te voegen, zwakke strepen te missen of achtergrondruis voor schrift aan te zien. De auteurs stellen dat Yi-manuscripten een soort "worst case" vormen voor tekstdetectie, en dat het oplossen van dit probleem veel andere schaarse schriften kan helpen.

Een nieuwe manier om fijne details te zien

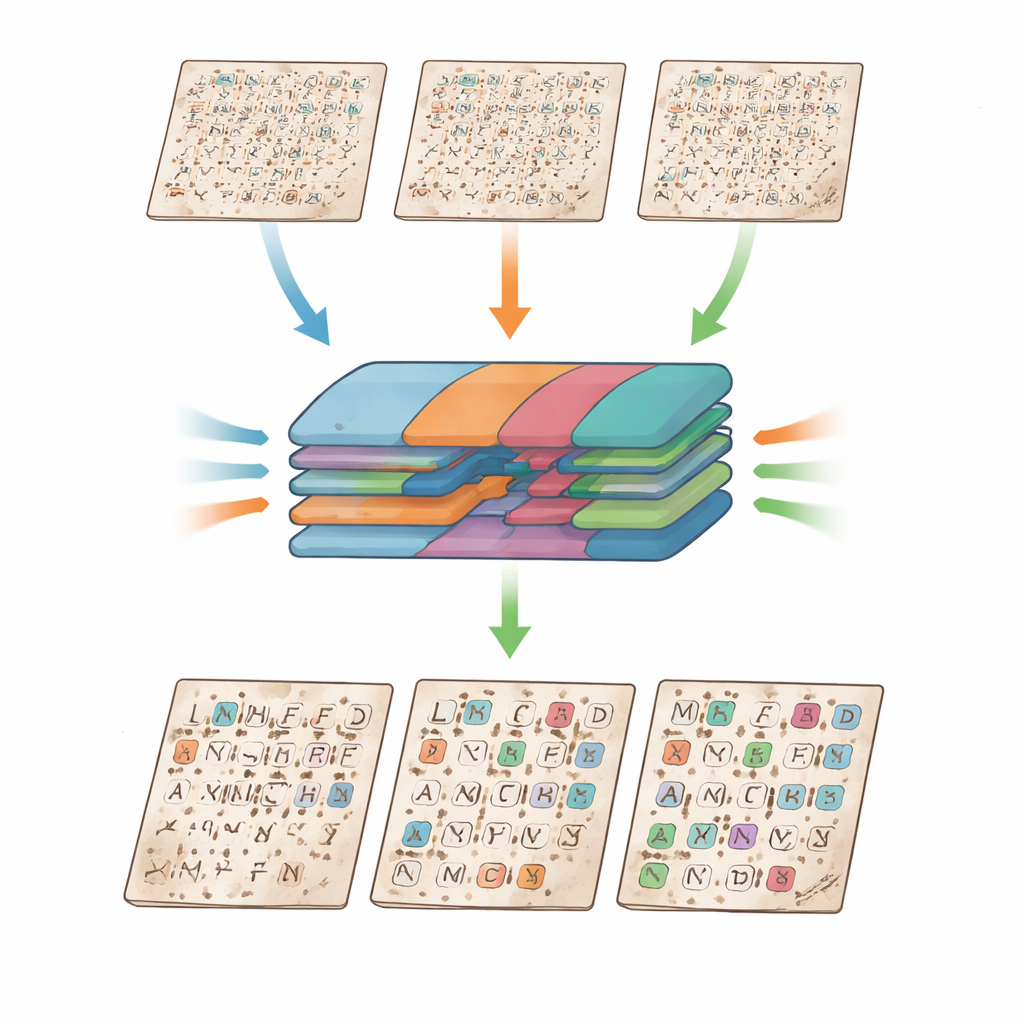

Om deze uitdagingen aan te pakken, ontwerpen de onderzoekers een gespecialiseerd neuraal netwerk genaamd FGRL-YiNet (Fine-Grained Representation Learning Network for Yi). De kern is een variant op standaard convolutionele lagen, de ruggengraat van moderne beeldherkenning. In plaats van overal één vast filterpatroon te gebruiken, past FGRL-YiNet dynamische convolutie toe: meerdere kandidaatfilters werken parallel en een kleine gating-module beslist voor elk regio van de afbeelding hoeveel op elk filter te vertrouwen. Dit stelt het systeem in staat zijn "receptieve veld" subtiel aan te passen aan lokale strekpatronen, wat delicate krommingen en knooppunten beter vastlegt zonder te worden verstoord door rommelige achtergronden of papierschade. Gebouwd op een compacte ResNet-18 backbone, is het model bewust matig in omvang gehouden zodat het effectief kan leren van de relatief kleine hoeveelheid geannoteerde Yi-data.

Schalen combineren en de pagina opschonen

Het detecteren van tekens op een volledige manuscriptpagina vereist ook begrip van patronen op meerdere groottes tegelijk — van kleine kronkels in een enkele streep tot de lay-out van een hele kolom. FGRL-YiNet introduceert een Adaptive Multi-Scale Fusion (AMSF)-module om dit op te lossen. Het netwerk extraheert eerst kenmerken op verschillende resoluties en gebruikt vervolgens een gezamenlijke attentie-mechanisme om te beslissen welke schaal en welke kanalen op elke locatie het belangrijkst zijn. Een deel van deze attentie richt zich op "waar" in de afbeelding fijne details belangrijk zijn, terwijl een ander deel zich richt op "wat" voor type kenmerk nuttig is — zoals een bepaalde streepdikte of een kleine lus in een teken. Parallel daaraan leert een differentieerbaar binariseringshoofd inkt van achtergrond te scheiden door zowel een waarschijnlijkheidskaart als een lokaal variërende drempel te voorspellen. Omdat deze stap in het netwerk is ingebouwd en end-to-end wordt getraind, kan het vervaagde strepen behouden die traditionele zwart-witconversie zou wegwassen, terwijl het vlekjes en vlekken onderdrukt.

Een benchmark opbouwen voor een zeldzaam schrift

Een groot obstakel voor elk gespecialiseerd schrift is data: er zijn weinig hoogkwalitatieve gedigitaliseerde Yi-manuscripten en nog minder met precieze labels voor elk teken. Het team pakt dit aan door de YiPrint-694 dataset te construeren op basis van Liangshan Yi-klassieken, resulterend in bijna 347.000 gelabelde tekens verdeeld over 694 pagina-afbeeldingen en 1.165 tekencategorieën. Ze combineren zorgvuldige preprocessing — ruisreductie, randversterking en binarisatie — met een semi-automatische segmentatiepijplijn en nauwgezet handmatig controleren door Yi-taalexperts. Om het uiterlijk van oudere, verkleurde pagina’s na te bootsen, creëren ze extra afbeeldingen met vergeelde en verbrande achtergronden. Deze gecureerde collectie dient zowel als trainingsgrond voor FGRL-YiNet als een openbare benchmark voor toekomstig onderzoek naar Yi en verwante schriften.

Hoe goed het systeem presteert

Getest tegen een brede set van state-of-the-art tekendetectors, waaronder veelgebruikte modellen als Faster R-CNN, DBNet++ en PSENet, behaalt FGRL-YiNet de beste totaalscores op YiPrint-694. Het detecteert tekens met een hoge f-score van 94,7%, gedreven door zeer hoge precisie (98,4%) en sterke recall (91,3%), wat betekent dat het zelden achtergrond voor tekst aanziet en toch de meeste tekens op de pagina vindt. Ablatie-experimenten, waarbij afzonderlijke componenten worden verwijderd, tonen aan dat elke innovatie — dynamische convolutie, adaptieve multi-scale fusie en differentieerbare binarisatie — meetbare winst oplevert en dat ze het beste samen werken. Het model transferreert ook goed naar de grotere MTHv2-dataset van historische Chinese boeddhistische teksten, waar het concurrerend presteert met toonaangevende algemene detectors, wat de bredere potentie benadrukt.

Wat dit betekent voor cultureel behoud

Voor niet-specialisten is de kernboodschap dat zorgvuldige, gerichte ontwerpkeuzes computers kunnen helpen enkele van de meest uitdagende schriften ter wereld te lezen, zelfs wanneer alleen beperkte trainingsdata beschikbaar zijn. Door adaptieve filters, slimme multi-scale fusie en ingebouwde opschoning van aangetaste pagina’s te combineren, kan FGRL-YiNet betrouwbaar individuele Yi-tekens lokaliseren in drukke, beschadigde manuscripten. Dit maakt het veel eenvoudiger om doorzoekbare digitale archieven op te bouwen, taalkundig en historisch onderzoek te ondersteunen en het geschreven erfgoed van het Yi-volk te beschermen. De auteurs zien hun architectuur en dataset als een blauwdruk voor het aanpakken van andere onderbediende schriften wereldwijd, en tonen aan dat vooruitgang in kunstmatige intelligentie een directe rol kan spelen bij het behouden van kwetsbaar cultureel erfgoed voor toekomstige generaties.

Bronvermelding: Sun, H., Ding, X., Yu, H. et al. Fine grained representation learning for low resource Yi script detection and dataset construction. npj Herit. Sci. 14, 183 (2026). https://doi.org/10.1038/s40494-026-02418-6

Trefwoorden: Yi-schrift, historische manuscripten, tekstdetectie, digitaal erfgoed, deep learning