Clear Sky Science · it

Tecniche di deep learning per la classificazione delle colture in paesaggi agricoli complessi

Perché contano mappe colturali più intelligenti

Con i cambiamenti climatici, la scarsità d’acqua e la crescente domanda di cibo che esercitano pressione sugli agricoltori, sapere esattamente cosa cresce dove e in che stato si trova è diventato essenziale. Questo studio mostra come una nuova combinazione di immagini satellitari e avanzate tecniche di deep learning possa distinguere con maggiore accuratezza le diverse colture in campi affollati e misti. Insegnando ai computer a prestare una «attenzione» speciale ai momenti chiave dello sviluppo della pianta, i ricercatori compiono un passo verso il monitoraggio delle colture a livello di campo in tempo reale, a supporto di rese migliori e di pratiche agricole più sostenibili.

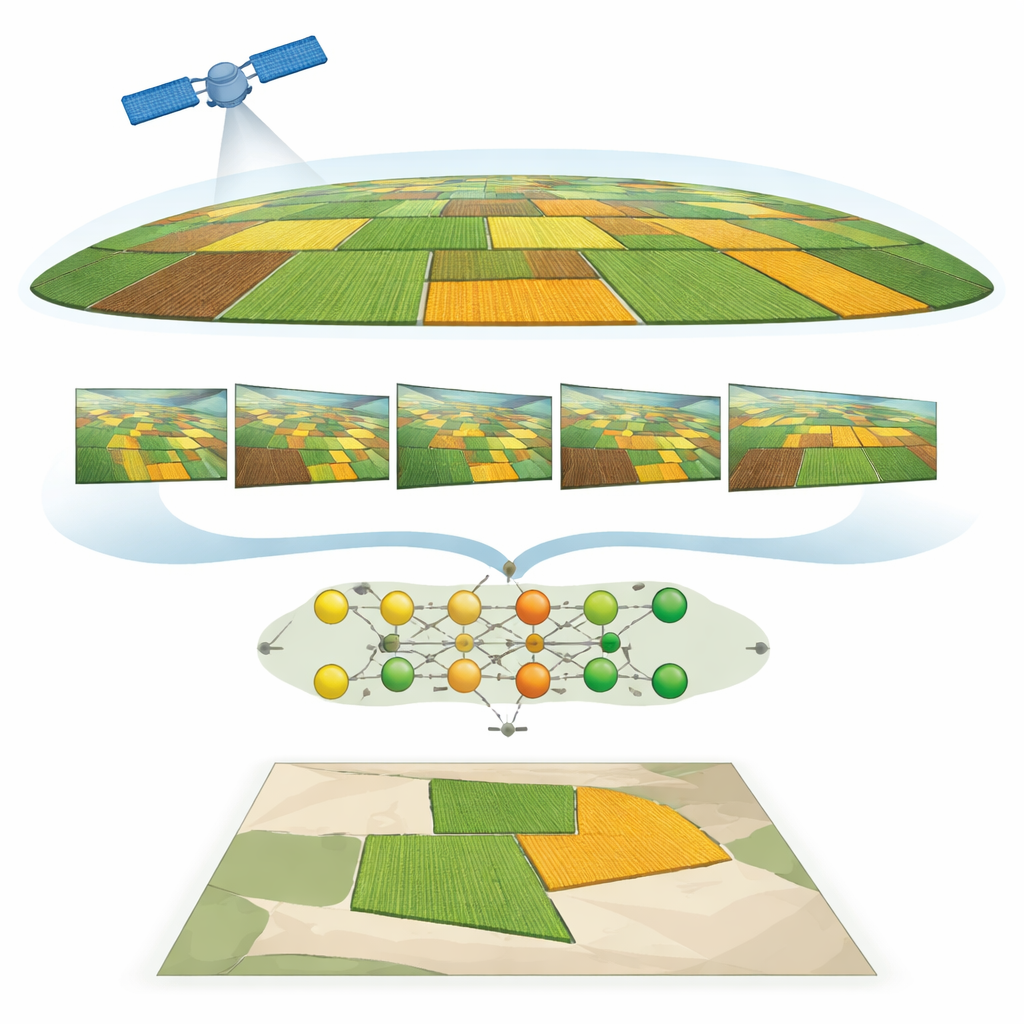

Osservare i campi dallo spazio nel tempo

Il lavoro si concentra su aziende agricole intorno a Hoskote, vicino a Bengaluru, India, dove due colture principali — ragi (miglio delle dita) e fagioli — spesso crescono in un mosaico di piccoli appezzamenti. La mappatura tradizionale fatica in questi contesti perché i campi sono piccoli, il paesaggio è vario e le colture possono apparire molto simili, soprattutto nelle prime fasi della stagione vegetativa. Per affrontare il problema, il team ha utilizzato immagini satellitari ad alta risoluzione PlanetScope acquisite più volte tra ottobre e gennaio. Ogni immagine cattura più bande dello spettro, incluse parti che l’occhio umano non vede ma che le piante riflettono intensamente, offrendo indizi sullo stato di salute e sulla fase di crescita.

Trasformare la luce in segnali di salute della pianta

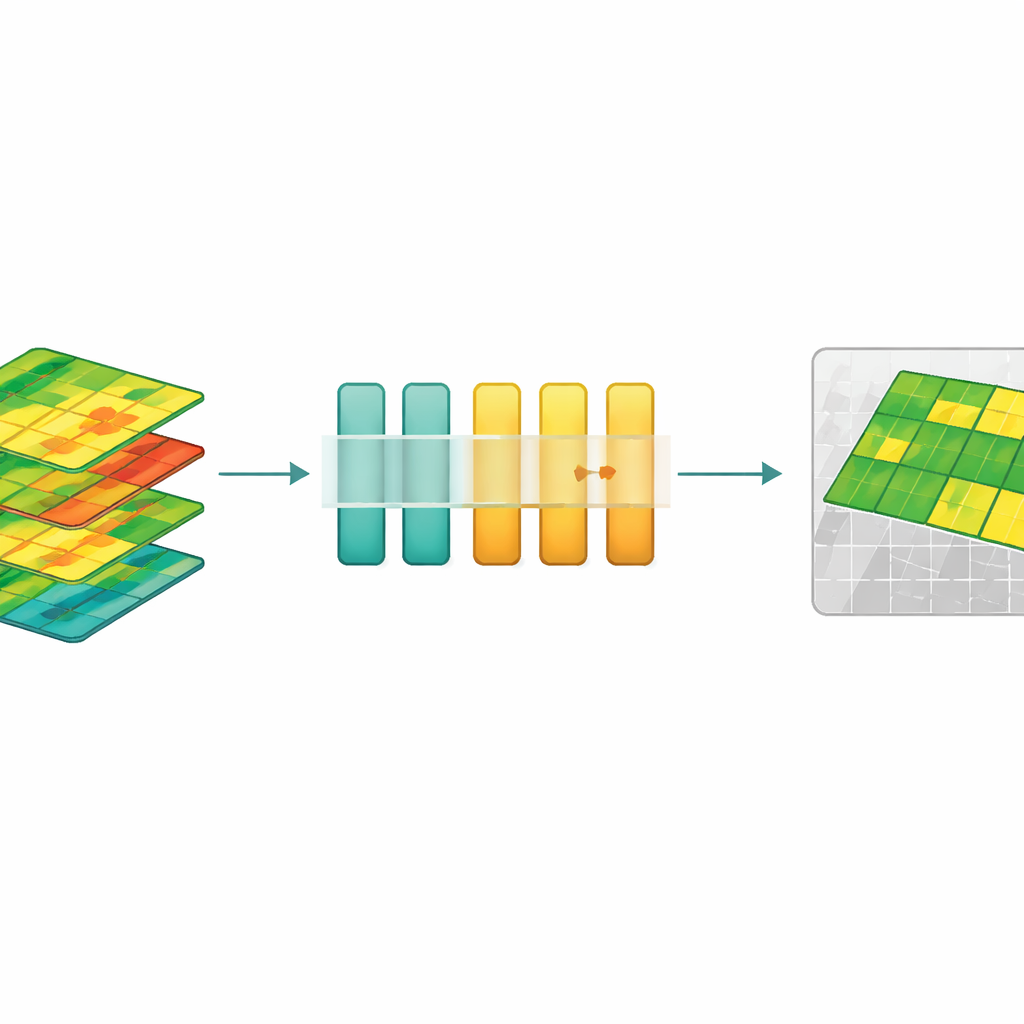

Invece di lavorare solo con i colori grezzi delle immagini satellitari, i ricercatori hanno trasformato i dati in «indici di vegetazione» che sintetizzano quanto le piante sono verdi, dense e vigorose. Indici ben noti come NDVI, EVI, GNDVI, NDRE e MCARI convertono combinazioni di luce rossa, verde, blu, vicino infrarosso e red‑edge in misure numeriche collegate alla clorofilla fogliare, alla densità della chioma e alla fase di crescita. Impilando questi indici su più date, il team ha costruito un ritratto in time‑lapse di come il segnale di salute di ogni campo sale e scende durante lo sviluppo della coltura. Questo rende più semplice distinguere le colture in base al loro andamento nel tempo, non solo all’aspetto in un giorno singolo.

Insegnare al modello su cosa concentrarsi

Per leggere questi «film» della salute delle piante, lo studio utilizza un modello di deep learning basato su un tipo di rete chiamata LSTM, adatta a gestire sequenze. Soprattutto, gli autori hanno aggiunto diverse forme di meccanismi di «attenzione» — strumenti matematici che permettono al modello di decidere quali istanti temporali sono più importanti per la classificazione. Un’innovazione chiave è una versione di self‑attention che utilizza la funzione di attivazione tanh. Questo design attenua i valori estremi e aiuta la rete a catturare variazioni sottili ma significative nelle curve di salute della pianta. Il sistema include anche un’attenta preelaborazione: allineamento delle immagini, correzione delle condizioni di illuminazione, filtraggio delle aree non vegetate e normalizzazione di tutte le caratteristiche in modo che nessun indice domini il modello.

Mappe più nitide e meno falsi allarmi

Quando sono state confrontate le diverse varianti di attenzione, la self‑attention basata su tanh è risultata la migliore, raggiungendo l’88,89% di accuratezza nel separare ragi da fagioli — un miglioramento di oltre otto punti percentuali rispetto a un solido baseline Random Forest basato su oggetti e superiore ad altre tipologie di attenzione come quella moltiplicativa, globale e soft. Il modello ha dato buone prestazioni per entrambe le colture, con precisione e richiamo bilanciati, e ha gestito meglio delle precedenti metodologie il problema dei campi simili nelle prime fasi di crescita. Una soglia di confidenza ha garantito che i pixel con predizioni incerte venissero etichettati come sfondo anziché forzare una scelta, riducendo le classificazioni errate di circa il 12%. Un semplice filtraggio spaziale ha poi levigato le mappe in modo che il risultato assomigliasse a campi realistici piuttosto che a rumore puntiforme.

Cosa significa per l’agricoltura futura

In termini pratici, lo studio dimostra che insegnare alle reti neurali non solo a vedere ma anche a prestare attenzione ai momenti di crescita rilevanti porta a mappe colturali dallo spazio molto più affidabili. Sebbene il lavoro si concentri su ragi e fagioli in una regione e in una stagione specifica, lo stesso approccio potrebbe essere esteso ad altre colture, climi e sistemi satellitari. Per agricoltori, enti e assicuratori, questi strumenti promettono informazioni più precoci e precise su cosa è stato piantato dove e come sta andando, permettendo una pianificazione migliore, input più mirati e una maggiore sicurezza alimentare con un impatto ambientale ridotto.

Citazione: Sharma, M., Kumar, A., Muthuraman, S. et al. Deep learning techniques for crop classification in complex agricultural landscapes. Sci Rep 16, 8831 (2026). https://doi.org/10.1038/s41598-026-37806-2

Parole chiave: telerilevamento, mappatura delle colture, deep learning, agricoltura di precisione, indici di vegetazione