Clear Sky Science · it

Un nuovo algoritmo a gradiente distribuito per l'ottimizzazione vincolata composita su reti dirette

Decisioni più intelligenti senza un capo centrale

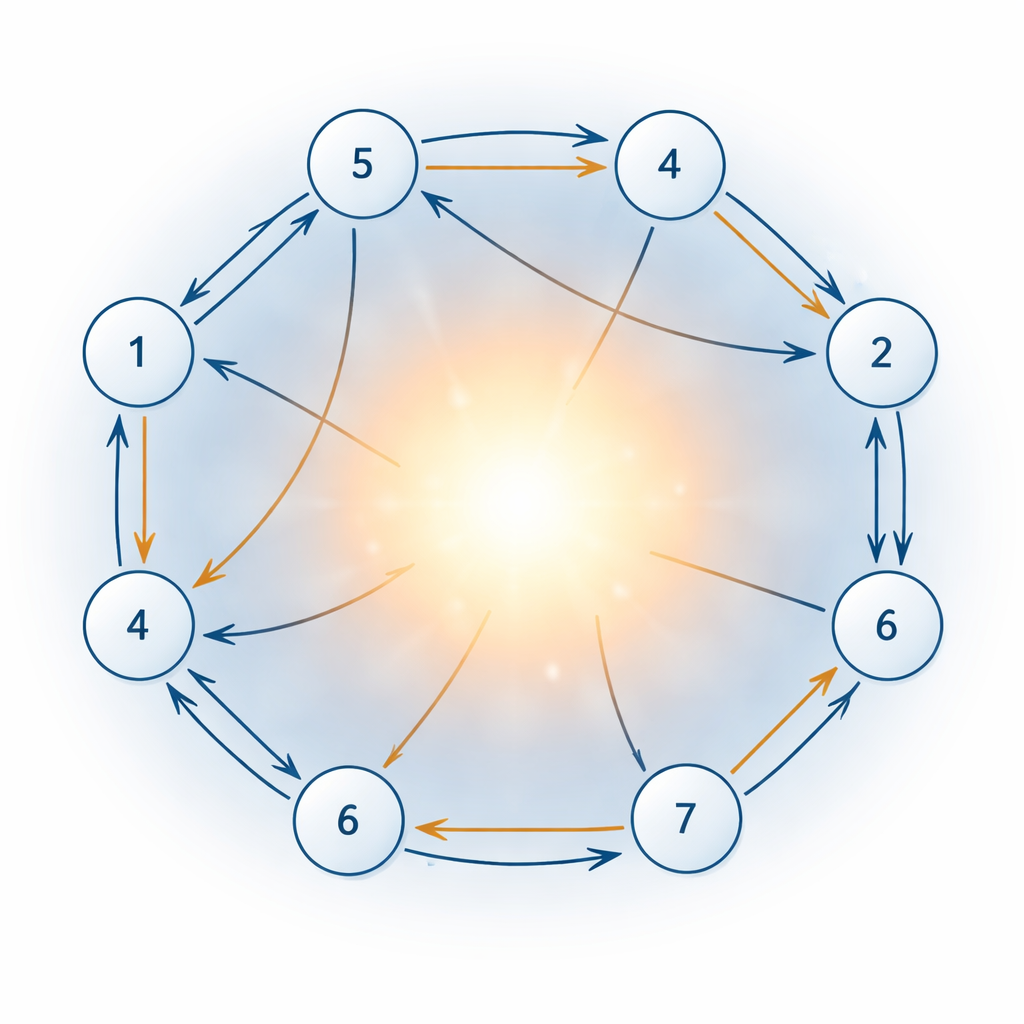

Le tecnologie moderne — dalle reti elettriche e reti di sensori alle flotte di droni — spesso si basano su molti dispositivi che collaborano senza un singolo controllore centrale. Ogni dispositivo osserva solo una parte dell'intero sistema, eppure il gruppo deve concordare un punto operativo buono e sicuro. Questo articolo presenta un nuovo modo per sistemi distribuiti di prendere decisioni congiunte in modo efficiente e affidabile, anche quando i collegamenti di comunicazione sono unidirezionali e il problema include vincoli difficili e punti di costo “taglienti”.

Perché molte intelligenze piccole battono una sola grande

L'ottimizzazione centralizzata — dove un calcolatore potente raccoglie tutti i dati, risolve un grande problema e invia comandi — è fragile e difficile da scalare. Può fallire se l'unità centrale si guasta, o restare congestionata dai ritardi di comunicazione in sistemi di grandi dimensioni. L'ottimizzazione distribuita ribalta questo quadro: ogni nodo (o agente) mantiene i propri dati, aggiorna la propria decisione locale e scambia solo informazioni limitate con i vicini. La sfida è progettare regole di aggiornamento tali che, nonostante la comunicazione parziale e unidirezionale, tutti i nodi raggiungano comunque un accordo su una soluzione che sia globalmente ottima per la rete.

Problemi difficili con angoli netti e limiti reali

Gli autori si concentrano su una classe esigente di problemi in cui il costo totale combina termini lisci (che variano dolcemente) con termini non lisci (che possono creare spigoli netti), come il popolare termine l1. Queste parti non lisce sono fondamentali per promuovere la sparsità e la robustezza in applicazioni come compressed sensing, denoising del segnale e fitting di modelli. Inoltre, ogni nodo deve rispettare vincoli locali di uguaglianza e disuguaglianza e rimanere entro limiti consentiti. Il tutto deve essere gestito su una rete di comunicazione diretta, dove l'informazione può fluire da A a B ma non necessariamente in senso opposto. I metodi esistenti solitamente assumono collegamenti non diretti, vincoli più semplici o passi fissi difficili da tarare e meno flessibili.

Un nuovo modo per parlare e trovare un accordo tra nodi

Per affrontare queste difficoltà, l'articolo propone un nuovo algoritmo distribuito basato sul gradiente, pensato per problemi compositi e vincolati su reti dirette. Ogni nodo aggiusta ripetutamente la propria decisione locale seguendo un passo di gradiente proiettato: si muove in direzione di diminuzione del costo complessivo, quindi proietta il risultato nello spazio ammissibile in modo che i vincoli restino soddisfatti. Variabili supplementari svolgono una funzione di contabilità interna, aiutando la rete a imporre vincoli di uguaglianza e disuguaglianza e a gestire il termine non liscio l1. Un'innovazione chiave è un meccanismo di correzione che compensa lo squilibrio causato dai collegamenti unidirezionali, utilizzando solo pesi riga-stocastici — cioè ogni nodo deve conoscere solo come riceve informazione, non a chi invia.

Passi flessibili con convergenza garantita

Un altro tratto distintivo del metodo è l'uso di passi variabili nel tempo ma costanti per ciascun nodo: ogni agente può scegliere il proprio passo all'interno di un intervallo dimostrabilmente sicuro, invece di condividere un unico valore fisso. Questa flessibilità semplifica la taratura in pratica e permette all'algoritmo di adattarsi meglio alle condizioni locali. Usando strumenti dalla teoria della stabilità, gli autori costruiscono una funzione di Lyapunov — una specie di misura energetica matematica — e dimostrano che diminuisce a ogni iterazione, purché i passi rispettino un chiaro limite superiore. Questo garantisce che, da qualunque punto di partenza, le decisioni di tutti i nodi convergano alla stessa soluzione globalmente ottima, anche in presenza di termini non lisci e vincoli misti.

Mettere il metodo alla prova

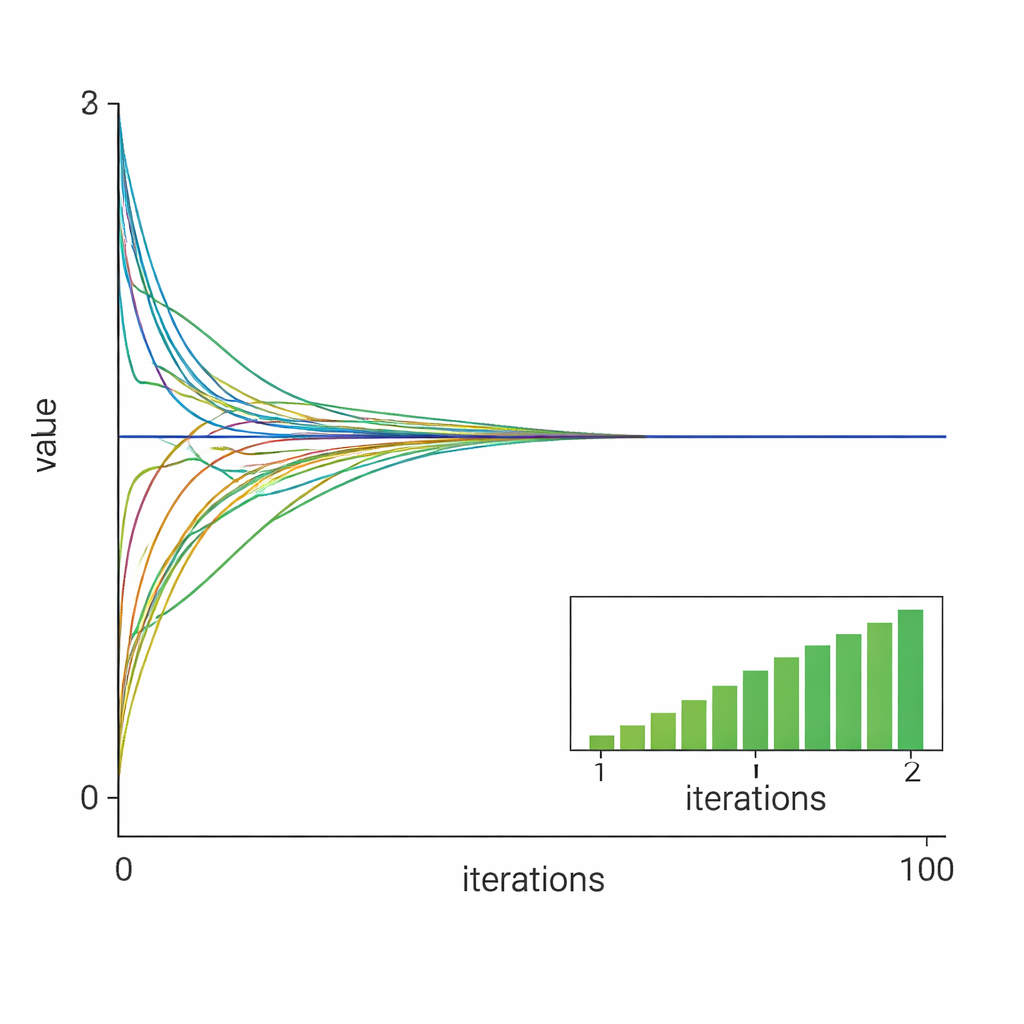

I ricercatori convalidano la teoria con due casi numerici. Nel primo, dieci nodi risolvono cooperativamente un problema quadratico vincolato con regolarizzazione l1, simile a compiti di allocazione di risorse o fusione di sensori. I risultati mostrano che tutte le variabili locali si allineano rapidamente con la soluzione ottimale centralizzata e che usare un passo costante scelto appropriatamente porta a una convergenza più rapida, quasi lineare, rispetto a un passo decrescente. Nel secondo caso, il metodo affronta un problema ill-condizionato di deviazione assoluta minima (least absolute deviation), noto per essere difficile per i risolutori standard. Anche qui, con soli cinque nodi e dati fortemente sbilanciati, l'algoritmo dirige in modo affidabile tutti gli agenti verso la soluzione corretta.

Cosa significa per i sistemi reali

In termini pratici, l'articolo fornisce una ricetta robusta per gruppi di dispositivi in rete per risolvere insieme problemi di ottimizzazione complessi senza un controllore centrale, rispettando limiti pratici e operando su collegamenti di comunicazione unidirezionali. Il metodo può essere applicato a sistemi elettrici, reti di sensori e compiti di apprendimento distribuito dove vincoli e sparsità sono importanti. Poiché richiede solo informazioni locali sui vicini e offre regole chiare per scegliere i passi, è ben adattato a implementazioni reali. Gli autori propongono di estendere l'approccio a reti tempo-varianti come prossimo passo, avvicinandosi a scenari di comunicazione realistici e in continuo cambiamento.

Citazione: Ou, M., Zhang, H., Yan, Z. et al. A novel distributed gradient algorithm for composite constrained optimization over directed network. Sci Rep 16, 5185 (2026). https://doi.org/10.1038/s41598-026-36058-4

Parole chiave: ottimizzazione distribuita, reti dirette, sistemi multi-agente, regolarizzazione sparsa, problemi convessi vincolati