Clear Sky Science · it

Approccio complementare di localizzazione visiva e mappatura tattile per la percezione robotica di oggetti millimetrici con superfici irregolari

Robot che Possono Vedere e Sentire

In molti luoghi pericolosi — dalle stazioni spaziali ai siti di incidenti nucleari — gli esseri umani si affidano ai robot per maneggiare interruttori, pillole, viti e pulsanti di piccole dimensioni. Ma i normali “occhi” robotici spesso falliscono quando l’illuminazione è scarsa o gli oggetti sono molto piccoli e irregolari. Questo articolo presenta un sistema di sensori per robot che combina vista e tatto, ispirato al modo in cui le persone prima guardano un oggetto e poi lo esplorano con le punta delle dita.

Perché la Visione da Sola Non Basta

La maggior parte dei robot moderni dipende da telecamere e sensori di profondità per riconoscere gli oggetti e decidere come muoversi. Questi strumenti visivi funzionano bene in fabbriche pulite e ben illuminate, ma arrancano quando la scena è buia, affollata o parzialmente ostruita. Gli autori mostrano che anche sistemi di telecamere potenti possono perdere il tracciamento di oggetti piccoli o non rilevare dettagli superficiali fini, soprattutto in condizioni di scarsa illuminazione o abbagliamento. In tali casi, un robot potrebbe sapere approssimativamente dov’è un oggetto, ma non se presenta piccole protuberanze, recessi o bordi irregolari che sono cruciali per afferrare o premere con precisione.

Costruire un Dito che Può Percepire Minimi Dettagli

Per affrontare questo problema, i ricercatori hanno costruito un sensore di contatto morbido, simile alla pelle, che si comporta più come la punta di un dito umano. Mediante stampa a getto d’inchiostro hanno depositato tracce metalliche flessibili su un materiale elastico simile alla gomma, formando una griglia di pixel sensibili alla pressione. Tra gli strati metallici è inserita una pellicola testurizzata realizzata con carta vetrata comune, conferendo al sensore una struttura fine e irregolare che ne aumenta la sensibilità. Quando il sensore viene premuto contro un oggetto, il segnale elettrico cambia in funzione della pressione, permettendo di rilevare tocchi molto leggeri — fino all’ordine di un piccolo chicco di riso — e di sopportare migliaia di cicli di pressione e rilascio senza perdere prestazioni.

Trasformare il Tatto in Mappe di Forma

Il sensore morbido è stato poi esteso in una piccola matrice in grado di catturare pattern di pressione su un’area, molto simile a un’immagine a bassa risoluzione. Quando il team ha premuto oggetti ad anello o altre forme complesse sul sensore, le mappe di pressione risultanti rivelavano chiaramente i loro profili e le regioni vuote, dimostrando che il sensore può “vedere” le forme tramite il tatto. Simulazioni al calcolatore hanno confermato che il materiale morbido concentra lo stress localmente, similmente alla pelle umana, il che lo aiuta a cogliere sottili differenze di altezza e texture su caratteristiche millimetriche come piccole protuberanze o rilievi su una superficie.

Far Collaborare Visione e Tatto

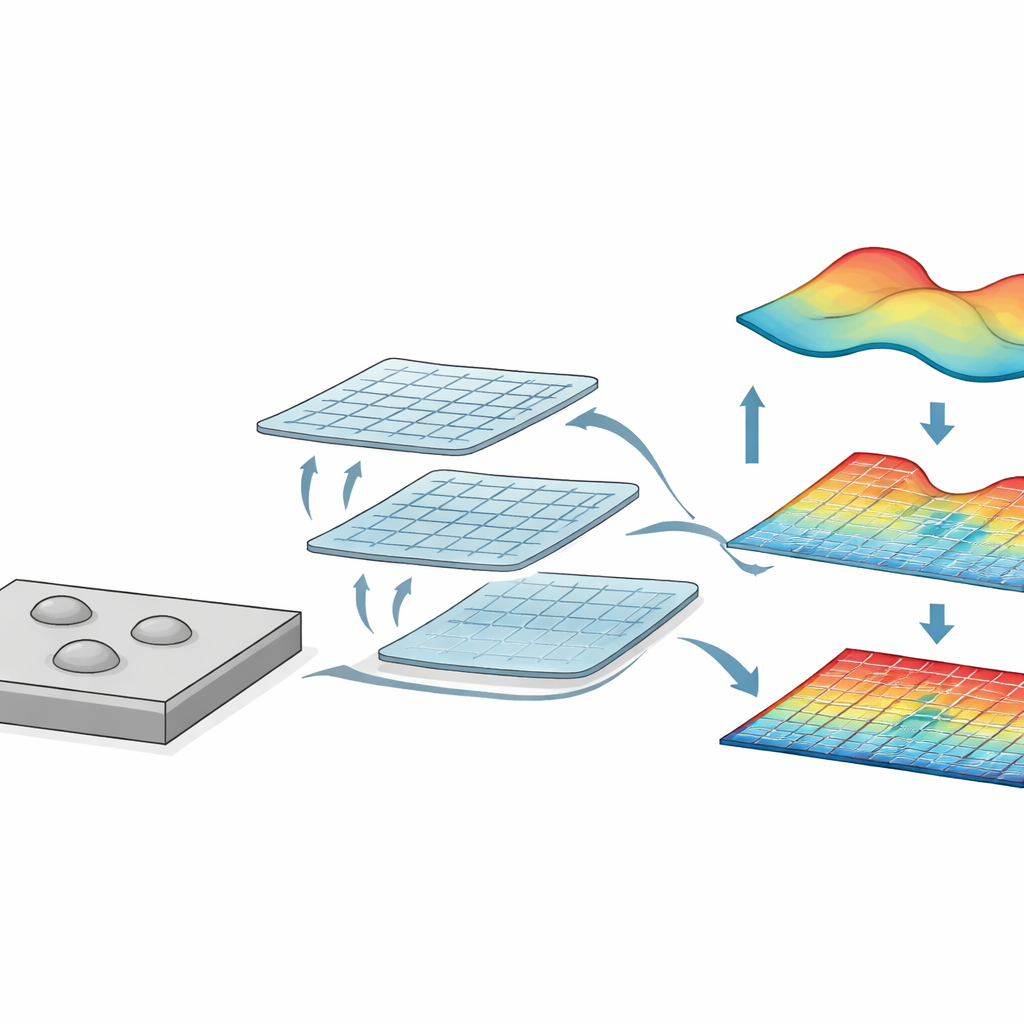

Il sistema completo utilizza una camera RGB-profondità per trovare la posizione di un oggetto nello spazio e un pad tattile morbido per esplorarne la superficie. Innanzitutto la telecamera stima la posizione dell’oggetto e la sua forma generale a distanza, proprio come una persona che guarda distrattamente un tavolo prima di allungare la mano. Quando le informazioni visive diventano inaffidabili — a causa di ombre, riflessi o problemi di messa a fuoco — il robot avvicina il sensore tattile all’oggetto. Scansionando il pad su diverse parti della superficie e unendo i dati di pressione, il sistema ricostruisce un profilo tridimensionale di caratteristiche di appena pochi millimetri, come le cupole rialzate delle pillole in una confezione blister o piccole asperità su un pannello di controllo.

Cosa Significa per i Robot del Futuro

Fusione della localizzazione basata su telecamera con una mappatura tattile dettagliata, questo lavoro mostra come i robot possano maneggiare oggetti piccoli e irregolari anche quando non possono fare pieno affidamento sui loro “occhi”. Lo studio dimostra che un sensore stampato semplice e a basso costo può sia supportare che, quando necessario, sostituire la visione. Ciò pone le basi per robot futuri che si adattano a condizioni variabili, combinando vista e tatto come fanno gli esseri umani per eseguire compiti precisi in ambienti disordinati, imprevedibili o pericolosi.

Citazione: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Parole chiave: robot umanoidi, sensazione tattile, percezione multimodale, micromanipolazione, visione RGB-profondità