Clear Sky Science · it

Apprendimento di rappresentazioni fine-grain per il rilevamento della scrittura Yi a risorse limitate e la costruzione di un dataset

Salvare un patrimonio scritto fragile

Il popolo Yi del sud-ovest della Cina ha conservato per secoli una ricca tradizione scritta, registrando medicina, astronomia, religione e vita quotidiana nella propria scrittura. Molti di questi manoscritti però stanno sbiadendo, sono macchiati o danneggiati, e la scrittura stessa è visivamente complessa. Trascrivere manualmente centinaia di migliaia di caratteri è lento e costoso. Questo articolo presenta un nuovo sistema di visione artificiale progettato specificamente per trovare e isolare i caratteri Yi nelle immagini digitali di documenti antichi, ponendo le basi per una digitalizzazione su larga scala e la conservazione di questo patrimonio scritto in pericolo.

Perché questa scrittura è così difficile per i computer

Diversamente dall’alfabeto latino più familiare o persino dal cinese moderno stampato, i caratteri Yi sono composti da tratti densi e curvi che spesso si intrecciano. Molti caratteri diversi appaiono estremamente simili, e lo stesso carattere può presentarsi in forme leggermente diverse nel tempo e tra i manoscritti. Le pagine storiche spesso usano layout a colonne fitte, con spazi irregolari e tratti sovrapposti. Inoltre, l’inchiostro può essere sbiadito, le pagine deformate e gli sfondi macchiati. I metodi di rilevamento più vecchi, che si basano su regole fisse riguardo gli spazi o su modelli generici di rilevamento del testo, tendono a fondere caratteri vicini, perdere tratti deboli o confondere rumore di sfondo con scrittura. Gli autori sostengono che i manoscritti Yi rappresentino un caso limite per il rilevamento del testo e che risolvere questo problema potrebbe aiutare molti altri sistemi di scritture a risorse limitate.

Un nuovo modo di cogliere i dettagli fini

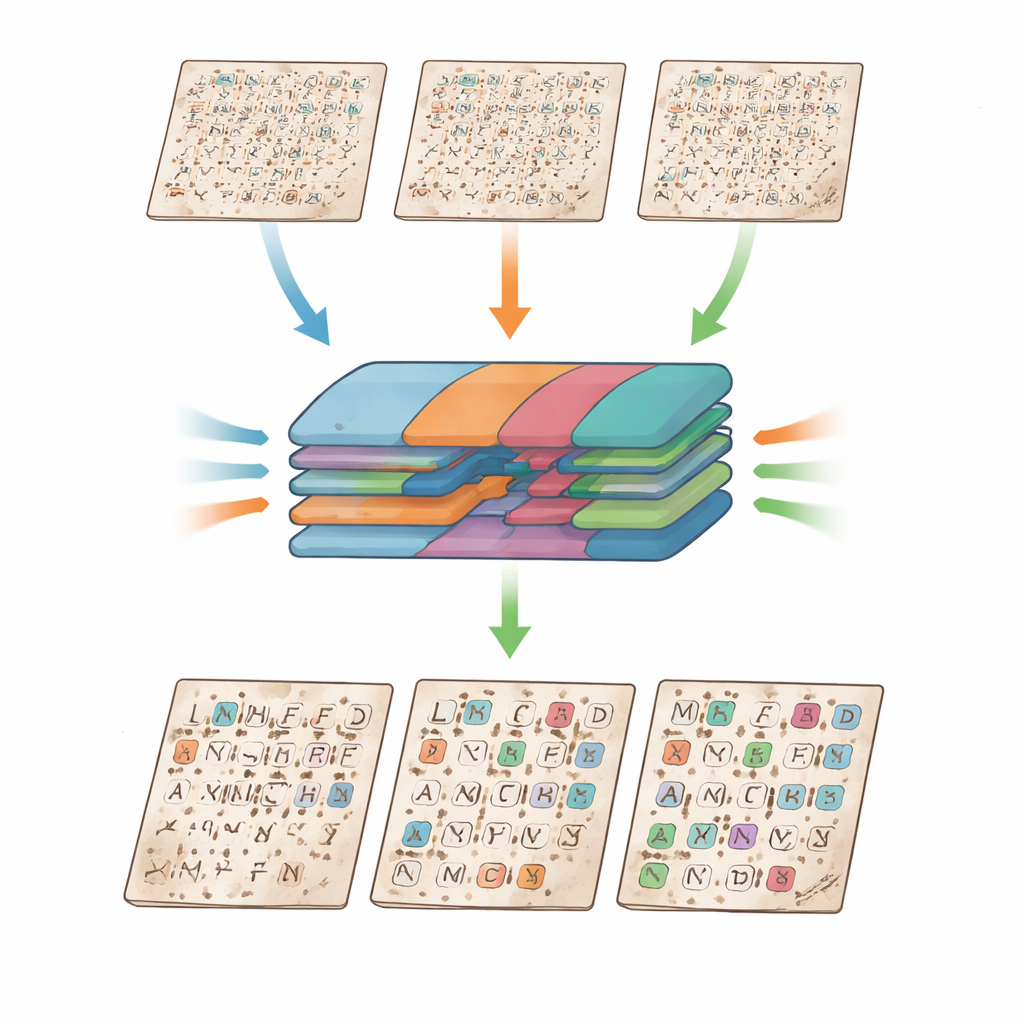

Per affrontare queste sfide, i ricercatori progettano una rete neurale specializzata chiamata FGRL-YiNet (Fine-Grained Representation Learning Network for Yi). Al centro c’è una variante degli strati convoluzionali standard, il pilastro del riconoscimento d’immagine moderno. Invece di usare un unico filtro fisso ovunque, FGRL-YiNet impiega convoluzione dinamica: diversi filtri candidati lavorano in parallelo e un piccolo modulo di gating decide, per ogni regione dell’immagine, quanto affidarsi a ciascuno. Questo permette al sistema di adattare sottilmente il proprio “campo recettivo” ai motivi locali dei tratti, catturando meglio curve delicate e giunzioni senza essere disorientato da sfondi affollati o pagine danneggiate. Costruito su una backbone ResNet-18 compatta, il modello è deliberatamente mantenuto di dimensioni moderate in modo da poter apprendere efficacemente dai relativamente pochi dati Yi annotati.

Combinare le scale e pulire la pagina

Rilevare i caratteri su una pagina completa richiede anche di comprendere i motivi a più dimensioni contemporaneamente — dalle piccole ondulazioni di un singolo tratto alla disposizione di un’intera colonna. FGRL-YiNet introduce un modulo di Adaptive Multi-Scale Fusion (AMSF) per risolvere questo aspetto. La rete prima estrae caratteristiche a diverse risoluzioni, poi usa un meccanismo di attenzione congiunta per decidere quale scala e quali canali sono più importanti in ogni posizione. Una parte di questa attenzione si concentra sul “dove” nell’immagine i dettagli fini sono rilevanti, mentre un’altra si concentra sul “che cosa” della caratteristica utile — come una specifica larghezza del tratto o un piccolo anello all’interno di un carattere. In parallelo, una testa di binarizzazione differenziabile impara a separare l’inchiostro dallo sfondo prevedendo sia una mappa di probabilità sia una soglia localmente variabile. Poiché questo passaggio è integrato nella rete e addestrato end-to-end, può preservare tratti deboli che una conversione bianco-nero tradizionale avrebbe cancellato, riducendo al contempo puntini e macchie.

Costruire un benchmark per una scrittura rara

Un ostacolo importante per qualsiasi scrittura specializzata è il dato: ci sono pochi manoscritti Yi digitalizzati di alta qualità e ancor meno con etichette precise per ogni carattere. Il team affronta questo problema costruendo il dataset YiPrint-694 tratto dai classici Yi di Liangshan, ottenendo quasi 347.000 caratteri etichettati distribuiti su 694 immagini di pagina e 1.165 categorie di carattere. Combinano un preprocessing accurato — riduzione del rumore, miglioramento dei bordi e binarizzazione — con una pipeline di segmentazione semi-automatica e un controllo manuale meticoloso da parte di esperti della lingua Yi. Per imitare l’aspetto di pagine più vecchie e ingiallite, creano immagini aggiuntive con sfondi ingialliti e bruni. Questa collezione curata diventa sia il terreno di addestramento per FGRL-YiNet sia un benchmark pubblico per ricerche future su Yi e scritture affini.

Quanto bene si comporta il sistema

Testato contro un ampio insieme di rivelatori di testo all’avanguardia, inclusi modelli ampiamente usati come Faster R-CNN, DBNet++ e PSENet, FGRL-YiNet ottiene i migliori punteggi complessivi su YiPrint-694. Rileva i caratteri con un elevato f-score del 94,7%, guidato da una precisione molto alta (98,4%) e un solido richiamo (91,3%), il che significa che raramente confonde lo sfondo con il testo pur individuando la maggior parte dei caratteri sulla pagina. Esperimenti di ablation, in cui componenti individuali vengono rimossi, mostrano che ogni innovazione — convoluzione dinamica, fusione adattiva multi-scala e binarizzazione differenziabile — contribuisce a guadagni misurabili e che funzionano meglio in concerto. Il modello si trasferisce bene anche al più ampio dataset MTHv2 di testi buddhisti storici cinesi, dove si comporta in modo competitivo rispetto ai migliori rivelatori generali, evidenziando il suo potenziale più ampio.

Cosa significa questo per la conservazione culturale

Per i non specialisti, il messaggio centrale è che un progetto accurato e mirato può aiutare i computer a leggere alcune delle scritture più difficili al mondo, anche quando esistono solo dati di addestramento limitati. Combinando filtri adattivi, una fusione multi-scala intelligente e una pulizia integrata delle pagine degradate, FGRL-YiNet può individuare in modo affidabile singoli caratteri Yi in manoscritti affollati e danneggiati. Questo rende molto più semplice costruire archivi digitali ricercabili, supportare ricerche linguistiche e storiche e salvaguardare il patrimonio scritto del popolo Yi. Gli autori vedono la loro architettura e il dataset come un modello per affrontare altre scritture poco servite nel mondo, dimostrando che i progressi nell’intelligenza artificiale possono svolgere un ruolo diretto nella conservazione di patrimoni culturali fragili per le generazioni future.

Citazione: Sun, H., Ding, X., Yu, H. et al. Fine grained representation learning for low resource Yi script detection and dataset construction. npj Herit. Sci. 14, 183 (2026). https://doi.org/10.1038/s40494-026-02418-6

Parole chiave: scrittura Yi, manoscritti storici, rilevamento del testo, patrimonio digitale, deep learning