Clear Sky Science · fr

Techniques d'apprentissage profond pour la classification des cultures dans des paysages agricoles complexes

Pourquoi des cartes des cultures plus intelligentes comptent

Alors que le changement climatique, les pénuries d'eau et la hausse de la demande alimentaire exercent une pression sur les agriculteurs, connaître exactement ce qui pousse où et comment cela évolue est devenu essentiel. Cette étude montre comment un nouveau mélange d'images satellitaires et d'apprentissage profond avancé permet de distinguer plus précisément différentes cultures dans des parcelles mélangées et encombrées. En apprenant aux ordinateurs à porter une « attention » particulière aux moments clés du développement des plantes, les chercheurs se rapprochent d'une surveillance des cultures au niveau des parcelles en quasi‑temps réel, capable de soutenir de meilleurs rendements et une agriculture plus durable.

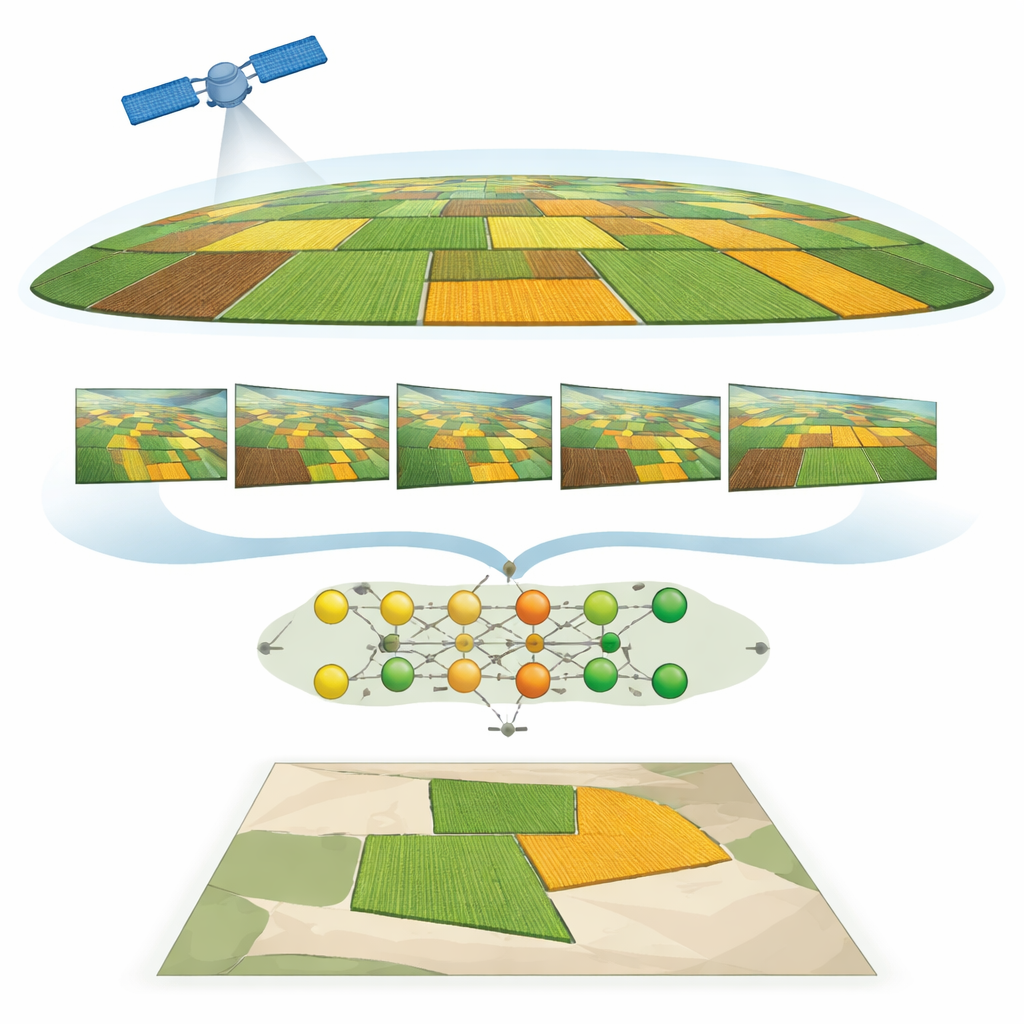

Observer les champs depuis l'espace au fil du temps

Le travail se concentre sur des exploitations autour de Hoskote, près de Bengaluru en Inde, où deux cultures de base — le ragi (mil des doigts) et les haricots — poussent souvent dans un patchwork de petites parcelles. La cartographie traditionnelle peine ici car les champs sont petits, le paysage est varié et les cultures peuvent se ressembler, surtout au début de la saison de croissance. Pour y remédier, l'équipe a utilisé des images haute résolution de PlanetScope prises à plusieurs reprises entre octobre et janvier. Chaque image capture plusieurs bandes du spectre lumineux, y compris des longueurs d'onde invisibles à l'œil humain mais fortement réfléchies par les plantes, fournissant des indices sur la santé et le stade de développement des cultures.

Transformer la lumière en signaux de santé des plantes

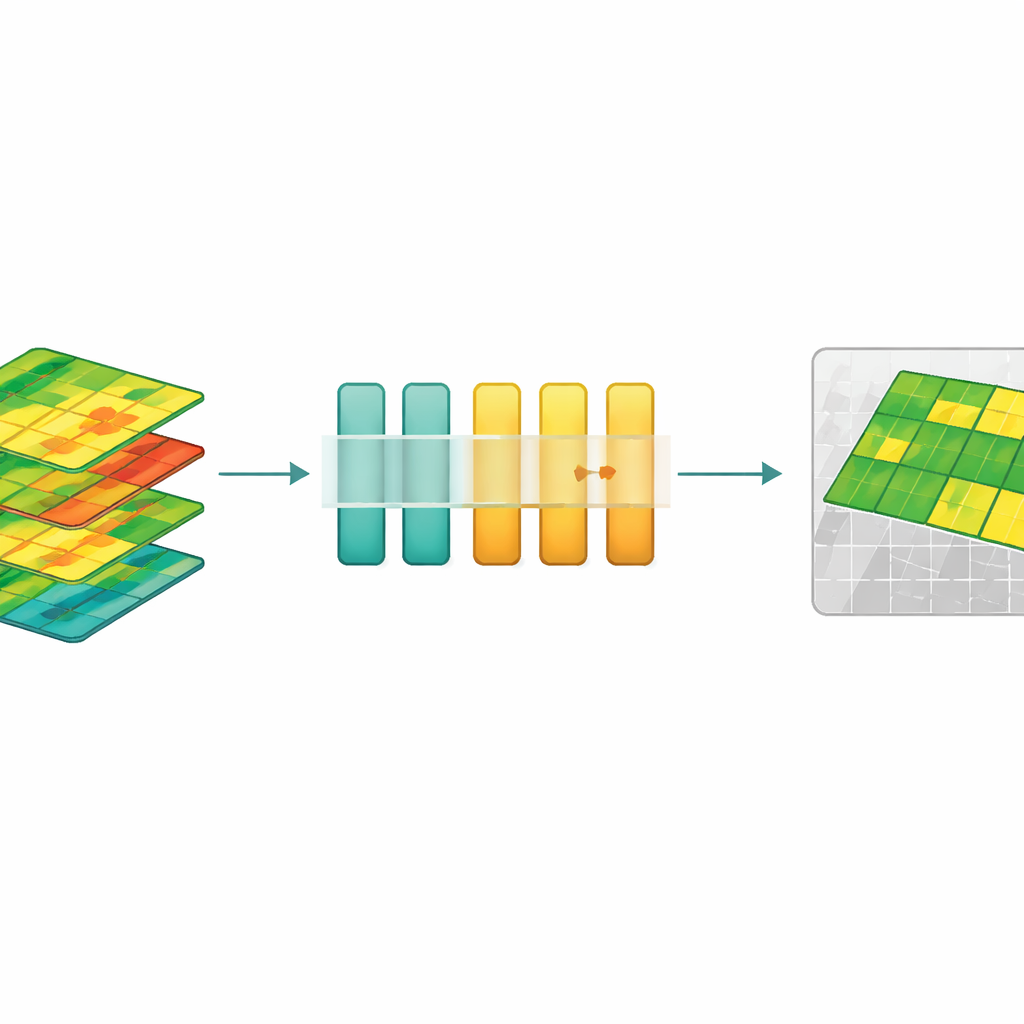

Plutôt que de travailler uniquement avec les couleurs brutes des satellites, les chercheurs ont transformé les données en « indices de végétation » qui résument le degré de verdure, la densité et la vigueur des plantes. Des indices bien connus tels que NDVI, EVI, GNDVI, NDRE et MCARI convertissent des combinaisons de rouge, vert, bleu, proche‑infrarouge et red‑edge en mesures numériques liées à la chlorophylle foliaire, la densité du couvert et le stade de croissance. En empilant ces indices sur plusieurs dates, l'équipe a construit un portrait en accéléré de l'évolution du signal de santé de chaque parcelle, montrant comment il monte et descend au fil du développement de la culture. Cela facilite la distinction entre les cultures en se basant sur leur dynamique de croissance plutôt que sur leur apparence à une date unique.

Apprendre au modèle où se concentrer

Pour lire ces « films » de santé des plantes, l'étude utilise un modèle d'apprentissage profond basé sur un type de réseau appelé LSTM, adapté au traitement de séquences. Par dessus, les auteurs ont ajouté plusieurs formes de mécanismes d'« attention » — des outils mathématiques qui permettent au modèle de décider quels instants temporels sont les plus importants pour la décision. Une innovation clé est une version d'auto‑attention utilisant la fonction d'activation tanh. Ce choix atténue les valeurs extrêmes et aide le réseau à capter des variations subtiles mais significatives dans les courbes de santé des plantes. Le système inclut également un prétraitement soigné : alignement des images, correction de l'éclairement, filtrage des non‑végétaux et normalisation de toutes les caractéristiques pour éviter qu'un indice ne domine les autres.

Des cartes plus nettes et moins de fausses alertes

Lorsque les différentes variantes d'attention ont été comparées, l'auto‑attention basée sur tanh est arrivée en tête, atteignant 88,89 % de précision pour séparer le ragi des haricots — une amélioration de plus de huit points de pourcentage par rapport à une robuste référence basée sur un Random Forest orienté objet, et devant d'autres types d'attention comme l'attention multiplicative, globale et soft. Le modèle a bien performé pour les deux cultures, avec une précision et un rappel équilibrés, et a mieux géré le défi des parcelles ressemblantes en début de croissance que les méthodes précédentes. Un seuil de confiance a permis d'étiqueter les pixels aux prédictions incertaines comme arrière‑plan plutôt que de forcer un choix, réduisant les erreurs de classification d'environ 12 %. Un simple filtrage spatial a ensuite lissé les cartes pour que le résultat ressemble à des parcelles réalistes plutôt qu'à du bruit en points.

Ce que cela signifie pour l'agriculture de demain

En termes clairs, l'étude montre qu'apprendre aux réseaux neuronaux non seulement à voir mais aussi à porter attention aux bons moments de croissance conduit à des cartes des cultures issues de l'espace beaucoup plus fiables. Bien que le travail porte sur le ragi et les haricots dans une région et une saison données, la même approche pourrait être étendue à d'autres cultures, climats et systèmes satellitaires. Pour les agriculteurs, les agences et les assureurs, de tels outils promettent des informations plus précoces et plus précises sur ce qui est planté où et sur la performance des cultures, permettant une meilleure planification, des intrants plus ciblés et une sécurité alimentaire améliorée avec un moindre impact environnemental.

Citation: Sharma, M., Kumar, A., Muthuraman, S. et al. Deep learning techniques for crop classification in complex agricultural landscapes. Sci Rep 16, 8831 (2026). https://doi.org/10.1038/s41598-026-37806-2

Mots-clés: télédétection, cartographie des cultures, apprentissage profond, agriculture de précision, indices de végétation