Clear Sky Science · fr

Approche complémentaire de localisation visuelle et de cartographie tactile pour la perception robotique d’objets millimétriques à surfaces irrégulières

Des robots qui voient et ressentent

Dans de nombreux lieux dangereux — des stations spatiales aux sites d’accidents nucléaires — les humains comptent sur des robots pour manipuler de petits interrupteurs, des comprimés, des vis et des boutons. Mais les « yeux » habituels des robots échouent souvent lorsque l’éclairage est insuffisant ou que les objets sont très petits et irréguliers. Cet article présente un système de détection robotique qui combine la vue et le toucher, inspiré de la façon dont les personnes regardent d’abord un objet puis l’explorent du bout des doigts.

Pourquoi la vision seule ne suffit pas

La plupart des robots modernes dépendent de caméras et de capteurs de profondeur pour reconnaître les objets et décider comment se mouvoir. Ces outils visuels fonctionnent bien dans des usines propres et bien éclairées, mais peinent lorsque la scène est sombre, encombrée ou partiellement masquée. Les auteurs montrent que même des systèmes de caméra performants peuvent perdre la trace de petits objets ou manquer des détails fins de surface, en particulier en faible luminosité ou en cas d’éblouissement. Dans de tels cas, un robot peut savoir à peu près où se trouve un objet, mais pas s’il présente de petites bosses, des creux ou des arêtes irrégulières essentielles pour saisir ou presser avec précision.

Fabriquer un doigt capable de sentir les détails infimes

Pour résoudre ce problème, les chercheurs ont construit un capteur tactile souple, de type peau, qui se comporte davantage comme un doigt humain. Par impression jet d’encre, ils ont déposé des traces métalliques flexibles sur un matériau élastique, formant une grille de pixels sensibles à la pression. Entre les couches métalliques se trouve un film texturé réalisé à l’aide de papier abrasif ordinaire, conférant au capteur une structure fine et irrégulière qui renforce sa sensibilité. Lorsqu’on appuie le capteur contre un objet, son signal électrique varie en fonction de la pression, ce qui lui permet de détecter des contacts très légers — jusqu’au niveau d’un petit grain de riz — et de supporter des milliers de cycles pression-relâche sans perte de performance.

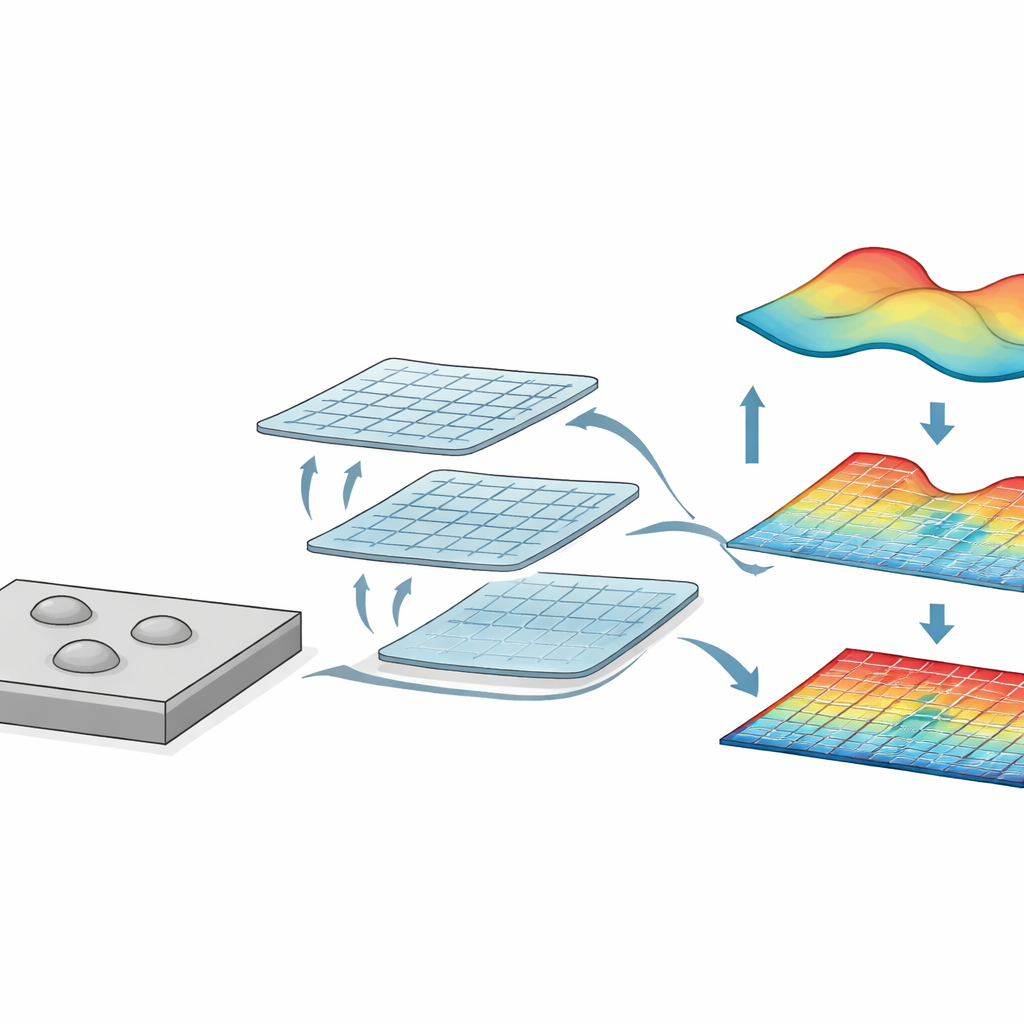

Transformer le toucher en cartes de forme

Le capteur souple a ensuite été étendu en une petite matrice capable de capturer des motifs de pression sur une surface, un peu comme une image basse résolution. Lorsque l’équipe a appuyé des objets annelés ou d’autres formes complexes sur le capteur, les cartes de pression obtenues révélaient clairement leurs contours et leurs parties creuses, montrant que le capteur peut « voir » des formes par le toucher. Des simulations informatiques ont confirmé que le matériau souple concentre localement les contraintes, de manière semblable à la peau humaine, ce qui l’aide à percevoir de fines différences de hauteur et de texture sur des caractéristiques millimétriques comme de petites bosses ou des protubérances à la surface.

Faire travailler la vision et le toucher ensemble

Le système complet utilise une caméra RGB-profondeur pour localiser un objet dans l’espace et un tampon tactile souple pour explorer sa surface. D’abord, la caméra estime la position et la forme générale de l’objet à distance, à la manière d’une personne qui jette un coup d’œil à une table avant d’atteindre un objet. Lorsque l’information visuelle devient peu fiable — en raison d’ombres, d’éblouissement ou de problèmes de mise au point — le robot amène son capteur tactile au contact de l’objet. En balayant le tampon sur différentes parties de la surface et en assemblant les données de pression, le système reconstruit un profil tridimensionnel de caractéristiques de quelques millimètres seulement, comme les dômes saillants des comprimés dans une plaquette ou de petites aspérités sur un panneau de commande.

Ce que cela implique pour les robots du futur

En fusionnant la localisation basée sur la caméra avec une cartographie tactile détaillée, ce travail montre comment les robots peuvent manipuler de petits objets irréguliers même lorsqu’ils ne peuvent pas entièrement compter sur leurs « yeux ». L’étude démontre qu’un capteur imprimé simple et peu coûteux peut à la fois compléter et, lorsque nécessaire, remplacer la vision. Cela ouvre la voie à des robots futurs capables de s’adapter à des conditions changeantes, combinant vue et toucher comme le font les humains pour accomplir des tâches précises dans des environnements sales, imprévisibles ou dangereux.

Citation: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Mots-clés: robots humanoïdes, capteur tactile, perception multimodale, micromanipulation, vision RGB-profondeur