Clear Sky Science · fr

Apprentissage de représentations fines pour la détection de l’écriture Yi en ressources limitées et construction de jeu de données

Sauver un patrimoine écrit fragile

Le peuple Yi du sud‑ouest de la Chine a conservé pendant des siècles une riche tradition écrite, consignant la médecine, l’astronomie, la religion et la vie quotidienne dans sa propre écriture. Pourtant, beaucoup de ces manuscrits s’effacent, se tachent ou sont endommagés, et l’écriture elle‑même est visuellement complexe. La transcription manuelle de centaines de milliers de caractères est lente et coûteuse. Cet article présente un nouveau système de vision par ordinateur conçu spécialement pour repérer et isoler les caractères Yi dans des images numériques de documents anciens, jetant les bases d’une numérisation à grande échelle et de la préservation de ce patrimoine écrit en danger.

Pourquoi cette écriture est si difficile pour les ordinateurs

Contrairement à l’alphabet latin plus familier ou même au chinois imprimé moderne, les caractères Yi sont constitués de traits denses et courbes qui s’entrelacent souvent. De nombreux caractères se ressemblent énormément, et un même caractère peut prendre des formes légèrement différentes selon les époques et les manuscrits. Les pages historiques utilisent fréquemment des mises en page en colonnes serrées, avec des espacements irréguliers et des traits qui se chevauchent. De plus, l’encre peut être estompée, les pages gondolées et les fonds tachetés. Les anciennes méthodes de détection, qui reposent sur des règles fixes concernant l’espacement ou sur des modèles génériques de détection de texte, ont tendance à fusionner des caractères voisins, à manquer des traits faibles ou à confondre des bruits de fond avec de l’écriture. Les auteurs soutiennent que les manuscrits Yi constituent un « pire cas » pour la détection de texte, et que résoudre ce problème pourrait bénéficier à de nombreuses autres écritures peu dotées en ressources.

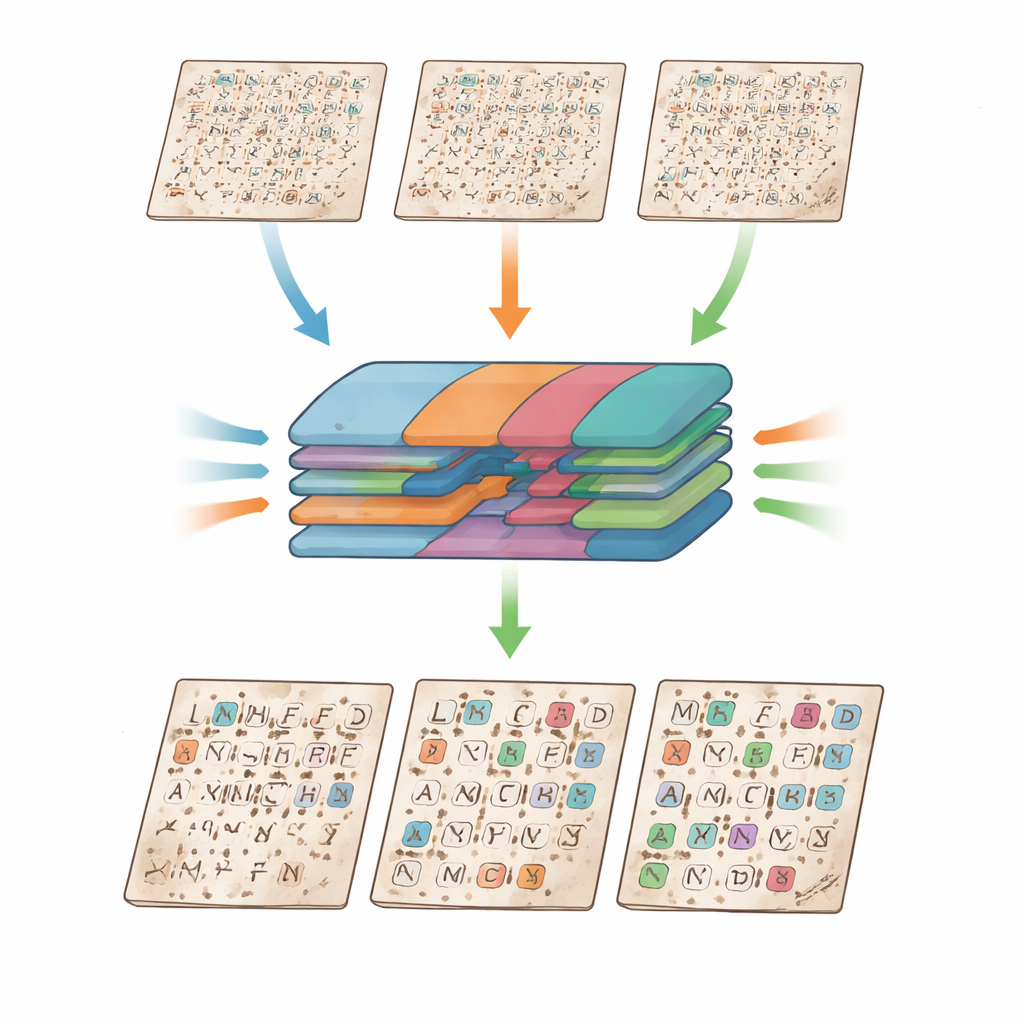

Une nouvelle façon de voir les détails fins

Pour relever ces défis, les chercheurs conçoivent un réseau neuronal spécialisé appelé FGRL‑YiNet (Fine‑Grained Representation Learning Network for Yi). Au cœur du modèle se trouve une variante des couches convolutionnelles standard, l’outil de base de la reconnaissance d’images moderne. Plutôt que d’utiliser un seul motif de filtre fixe partout, FGRL‑YiNet emploie une convolution dynamique : plusieurs filtres candidats opèrent en parallèle, et un petit module de gating décide, pour chaque région de l’image, dans quelle mesure s’appuyer sur chacun d’eux. Cela permet au système d’ajuster subtilement son « champ réceptif » aux motifs locaux des traits, capturant mieux les courbes délicates et les jonctions sans être perturbé par des arrière‑plans encombrés ou des dommages sur la page. Bâti sur une architecture ResNet‑18 compacte, le modèle est volontairement de taille modérée afin d’apprendre efficacement à partir de la quantité relativement faible de données Yi annotées.

Combiner les échelles et nettoyer la page

La détection des caractères sur une page complète de manuscrit nécessite aussi la compréhension de motifs à plusieurs échelles simultanément — depuis les petites ondulations d’un seul trait jusqu’à la disposition d’une colonne entière. FGRL‑YiNet introduit un module de Fusion Multi‑Échelle Adaptative (AMSF) pour répondre à cela. Le réseau extrait d’abord des caractéristiques à plusieurs résolutions, puis utilise un mécanisme d’attention conjoint pour décider quelle échelle et quels canaux sont les plus pertinents à chaque endroit. Une partie de cette attention se concentre sur le « où » dans l’image les détails fins sont importants, tandis qu’une autre se focalise sur le « quoi » — le type de caractéristique utile, comme une épaisseur de trait particulière ou une petite boucle à l’intérieur d’un caractère. En parallèle, une tête de binarisation différentiable apprend à séparer l’encre du fond en prédisant à la fois une carte de probabilités et un seuil localement variable. Parce que cette étape est intégrée au réseau et entraînée de bout en bout, elle peut préserver des traits faibles que la conversion noir‑et‑blanc traditionnelle effacerait, tout en supprimant les taches et les bruits ponctuels.

Construire une référence pour une écriture rare

Un obstacle majeur pour toute écriture spécialisée est la donnée : il existe peu de manuscrits Yi numérisés de haute qualité, et encore moins avec des étiquettes précises pour chaque caractère. L’équipe répond à ce problème en construisant le jeu de données YiPrint‑694 à partir des classiques Yi de Liangshan, aboutissant à près de 347 000 caractères étiquetés répartis sur 694 images de pages et 1 165 catégories de caractères. Ils combinent un prétraitement soigné — réduction du bruit, renforcement des contours et binarisation — avec un pipeline de segmentation semi‑automatique et une vérification manuelle minutieuse par des experts de la langue Yi. Pour imiter l’aspect des pages anciennes et décolorées, ils créent des images supplémentaires aux fonds jaunis et brunis. Cette collection soignée devient à la fois le terrain d’entraînement de FGRL‑YiNet et une référence publique pour les recherches futures sur l’écriture Yi et les écritures apparentées.

Performance du système

Testé contre un large ensemble de détecteurs de texte à la pointe, incluant des modèles largement utilisés comme Faster R‑CNN, DBNet++ et PSENet, FGRL‑YiNet obtient les meilleurs scores globaux sur YiPrint‑694. Il détecte les caractères avec un F‑score élevé de 94,7 %, porté par une très grande précision (98,4 %) et un rappel solide (91,3 %), ce qui signifie qu’il confond rarement le fond avec le texte tout en trouvant la plupart des caractères sur la page. Des expériences d’ablation, où des composants individuels sont retirés, montrent que chaque innovation — convolution dynamique, fusion multi‑échelle adaptative et binarisation différentiable — apporte des gains mesurables, et qu’elles fonctionnent mieux combinées. Le modèle se transfère également bien au plus grand jeu de données MTHv2 de textes bouddhiques historiques en chinois, où il est compétitif par rapport aux meilleurs détecteurs généralistes, soulignant son potentiel plus large.

Ce que cela signifie pour la préservation culturelle

Pour les non‑spécialistes, le message central est que des conceptions ciblées et soignées peuvent aider les ordinateurs à lire certaines des écritures les plus difficiles au monde, même lorsque seules des données d’entraînement limitées sont disponibles. En combinant des filtres adaptatifs, une fusion multi‑échelle intelligente et un nettoyage intégré des pages dégradées, FGRL‑YiNet peut repérer de manière fiable des caractères Yi individuels dans des manuscrits encombrés et abîmés. Cela facilite grandement la constitution d’archives numériques consultables, le soutien aux recherches linguistiques et historiques, et la sauvegarde du registre écrit du peuple Yi. Les auteurs voient leur architecture et leur jeu de données comme une feuille de route pour aborder d’autres écritures insuffisamment servies dans le monde, montrant que les avancées en intelligence artificielle peuvent jouer un rôle direct dans la préservation d’un patrimoine culturel fragile pour les générations futures.

Citation: Sun, H., Ding, X., Yu, H. et al. Fine grained representation learning for low resource Yi script detection and dataset construction. npj Herit. Sci. 14, 183 (2026). https://doi.org/10.1038/s40494-026-02418-6

Mots-clés: écriture Yi, manuscrits historiques, détection de texte, patrimoine numérique, apprentissage profond