Clear Sky Science · es

Un banco de pruebas a gran escala para evaluar modelos de lenguaje grandes en respuesta a preguntas médicas en rumano

Por qué esto importa para la salud y la tecnología

Muchas personas recurren ahora a herramientas en línea y chatbots para obtener información sobre salud, pero la mayoría de estos sistemas funcionan mejor en inglés y tienen dificultades con las historias clínicas locales. Este artículo aborda esa brecha para Rumanía, donde los médicos redactan resúmenes de casos largos y complejos en rumano y necesitan ayudantes digitales fiables que respondan con rapidez a preguntas sobre pacientes con cáncer. Los autores presentan MedQARo, un nuevo recurso que permite a los investigadores evaluar y mejorar de forma rigurosa los modelos de lenguaje grandes para que comprendan mejor las notas clínicas reales en rumano.

Un nuevo banco de preguntas construido a partir de pacientes reales

El núcleo del estudio es MedQARo, una colección muy amplia de 105.880 pares pregunta–respuesta vinculados a 1.242 pacientes con cáncer. En lugar de traducir datos en inglés, el equipo partió de cero con resúmenes de casos originales en rumano, mayoritariamente de cáncer de mama y de pulmón, además de varios otros tipos tumorales. Siete especialistas y residentes en oncología dedicaron cerca de 3.000 horas a leer estos documentos y redactar respuestas a preguntas médicas cuidadosamente diseñadas. Algunas preguntas son de sí/no, otras extraen detalles concretos y algunas requieren combinar pistas para inferir estadios o cronologías de tratamiento. Todos los datos de los pacientes fueron completamente anonimizados y contaron con la aprobación de comités de ética.

Evaluando la IA con lenguaje médico local

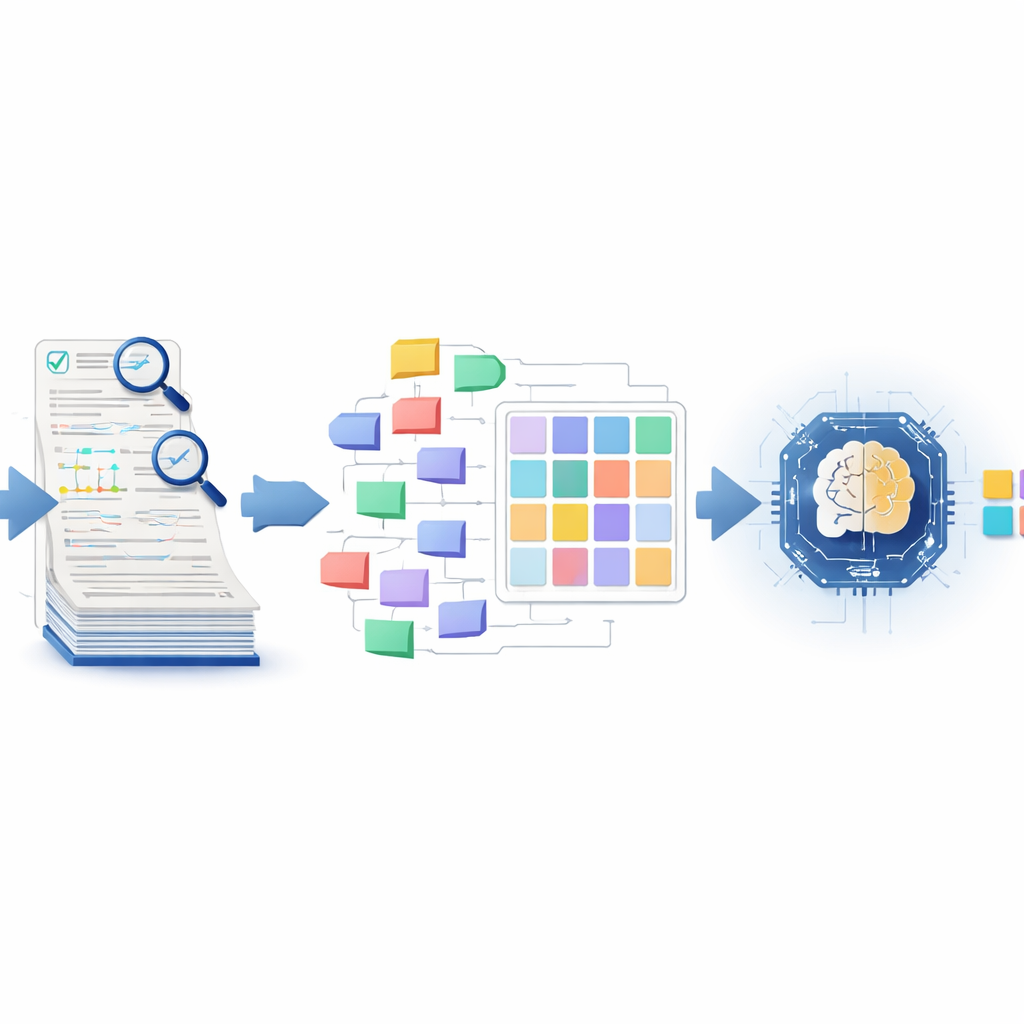

Usando MedQARo, los autores evaluaron varias familias de modelos de lenguaje grandes, incluidas dos ajustadas para el rumano en general, una diseñada para manejar textos muy largos y otra entrenada con material médico en inglés. También las compararon con dos potentes modelos comerciales accesibles mediante APIs de pago. Cada modelo debía leer la pregunta y un extracto del resumen clínico y luego generar la respuesta. Los investigadores analizaron no solo coincidencias exactas, sino también con qué frecuencia los modelos capturaban las palabras clave y cómo manejaban la flexibilidad del lenguaje rumano, empleando cuatro medidas de puntuación diferentes.

Modelos afinados superan a los gigantes “lista para usar”

En general, los modelos usados tal cual “out of the box” rindieron mal en MedQARo, incluso cuando eran potentes en inglés o tenían cierta exposición al rumano. Baselines sencillos que siempre adivinaban la respuesta más común a veces se acercaban al desempeño de estos sistemas sin ajuste. Sin embargo, una vez que los investigadores afinaron los modelos en el nuevo conjunto de datos, el rendimiento aumentó de forma drástica. El mejor sistema, un modelo adaptado al rumano llamado RoMistral‑7B, alcanzó una puntuación F1 de aproximadamente 0,67 en tipos de cáncer y hospitales familiares, superando claramente a todos los demás modelos de código abierto y comerciales. Aun así, este líder respondió incorrectamente a más de un tercio de las preguntas, lo que evidencia lo exigente que es el benchmark.

Poniendo a prueba la generalización entre clínicas y tipos de cáncer

Para comprobar si estos sistemas podían afrontar situaciones nuevas, el equipo construyó un conjunto de prueba más duro procedente de otro centro médico y de tipos de cáncer no vistos durante el entrenamiento. En este escenario cruzado, el rendimiento de todos los modelos cayó, a menudo de forma pronunciada, y el mejor modelo afinado acertó con claridad en menos de la mitad de los casos. Los modelos entrenados con textos biomédicos en inglés no se transfirieron automáticamente bien a las notas en rumano, y proporcionar a los modelos una porción mucho más larga del documento clínico no ayudó demasiado. De hecho, centrarse en la primera parte del resumen funcionó con frecuencia mejor que alimentar el registro largo completo, lo que sugiere que más contexto puede confundir en lugar de aclarar.

Qué implica esto para la IA clínica futura

Para un lector general, la conclusión es que construir IA médica segura y útil en idiomas como el rumano requiere algo más que conectar datos locales a un chatbot grande centrado en el inglés. Benchmarks específicos y bien diseñados para cada lengua, como MedQARo, revelan tanto el potencial como los límites de los sistemas actuales. Muestran que modelos pequeños y de código abierto, cuando se afinan con datos locales de alta calidad, pueden superar a modelos generales mucho más grandes alojados en la nube. Al mismo tiempo, las puntuaciones moderadas, especialmente en hospitales y tipos de cáncer nuevos, advierten de que las herramientas de hoy no están listas para reemplazar el juicio humano. En su lugar, MedQARo ofrece una base sólida para la próxima generación de asistentes clínicos que puedan ayudar a los médicos rumanos a navegar registros complejos de cáncer, manteniendo la seguridad y la privacidad de los pacientes en el centro.

Cita: Rogoz, AC., Ionescu, R.T., Anghel, AV. et al. A large-scale benchmark for evaluating large language models on medical question answering in Romanian. npj Digit. Med. 9, 268 (2026). https://doi.org/10.1038/s41746-026-02465-0

Palabras clave: respuesta a preguntas médicas, IA en idioma rumano, historias clínicas de cáncer, modelos de lenguaje a gran escala, benchmark MedQARo