Clear Sky Science · es

Técnicas de aprendizaje profundo para la clasificación de cultivos en paisajes agrícolas complejos

Por qué importan mapas de cultivos más inteligentes

A medida que el cambio climático, la escasez de agua y la creciente demanda de alimentos presionan a los agricultores, conocer con precisión qué crece dónde y cómo se está desarrollando se ha vuelto esencial. Este estudio muestra cómo una nueva combinación de imágenes satelitales y aprendizaje profundo avanzado puede distinguir con mayor exactitud entre distintos cultivos en parcelas mixtas y densas. Al enseñar a las computadoras a prestar especial “atención” a momentos clave del crecimiento de la planta, los investigadores avanzan hacia una monitorización de cultivos a nivel de parcela en tiempo casi real que puede apoyar mejores rendimientos y una agricultura más sostenible.

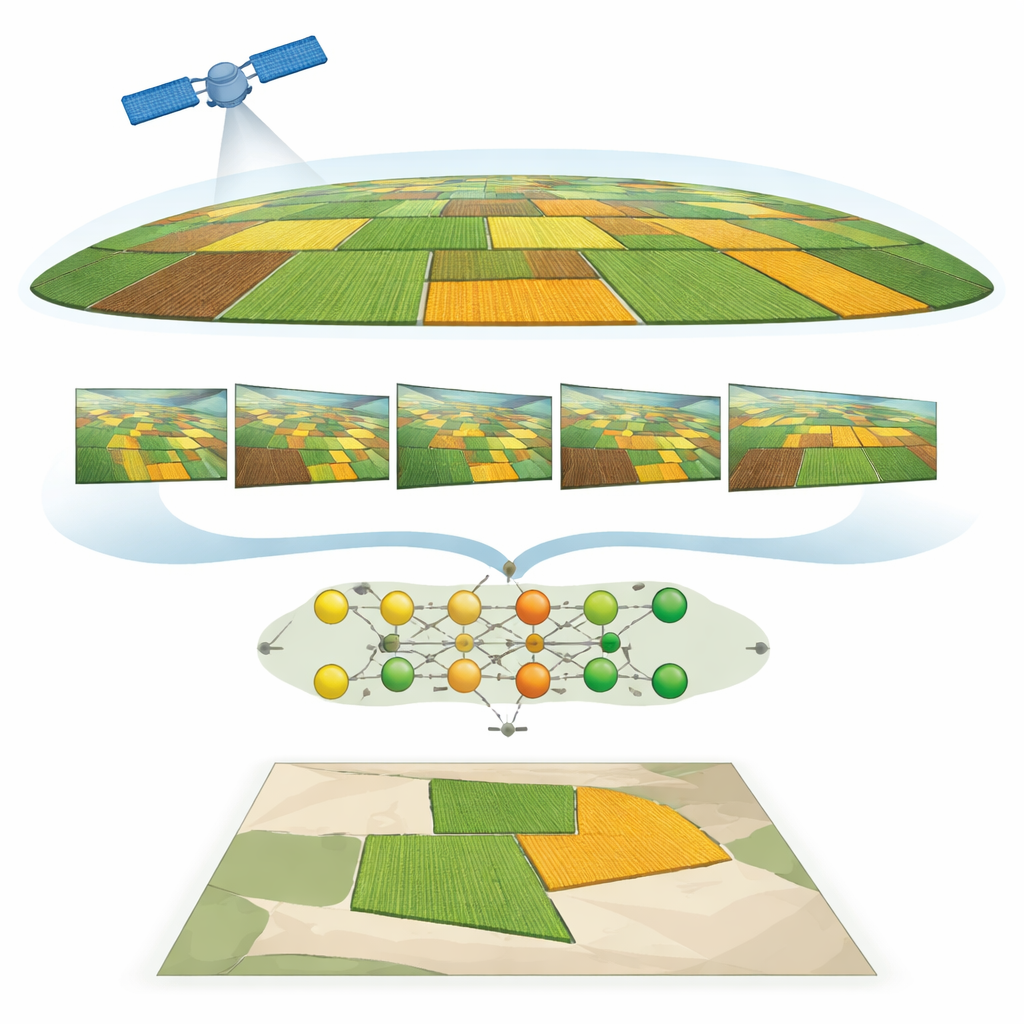

Vigilar los campos desde el espacio a lo largo del tiempo

El trabajo se centra en explotaciones alrededor de Hoskote, cerca de Bengaluru, India, donde dos cultivos básicos—ragi (mijo dedo) y frijoles—a menudo crecen en un mosaico de pequeñas parcelas. El mapeo tradicional dificulta la tarea aquí porque los campos son pequeños, el paisaje es variado y los cultivos pueden parecer muy similares, especialmente al inicio de la temporada. Para enfrentar esto, el equipo usó imágenes de alta resolución de PlanetScope tomadas varias veces entre octubre y enero. Cada imagen captura múltiples bandas del espectro, incluidas partes que el ojo humano no ve pero que las plantas reflejan con fuerza, proporcionando pistas sobre la salud y la etapa de crecimiento de la planta.

Convertir la luz en señales de salud vegetal

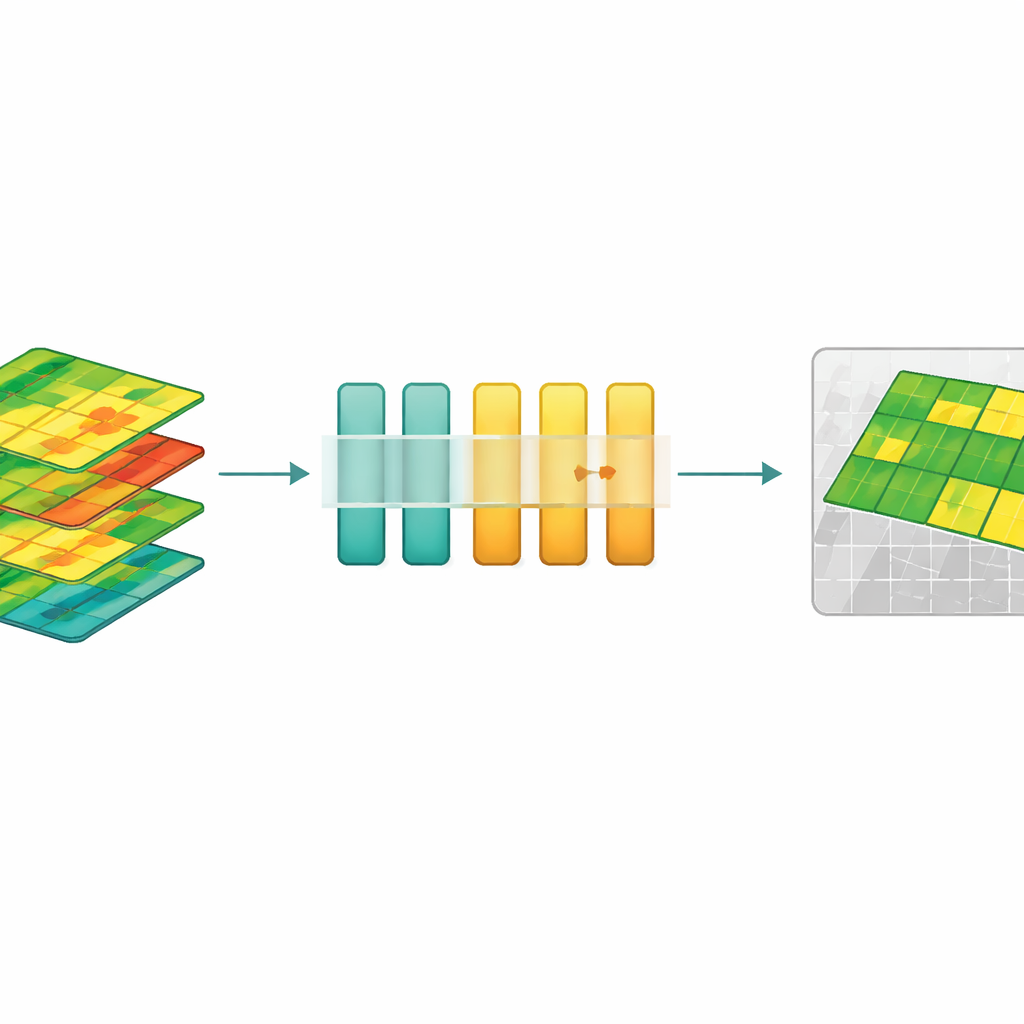

En lugar de trabajar solo con los colores en bruto de los satélites, los investigadores transformaron los datos en “índices de vegetación” que resumen cuán verdes, densas y vigorosas están las plantas. Índices bien conocidos como NDVI, EVI, GNDVI, NDRE y MCARI convierten combinaciones de rojo, verde, azul, infrarrojo cercano y red‑edge en medidas numéricas vinculadas a la clorofila foliar, la densidad del dosel y la etapa de desarrollo. Al apilar estos índices a lo largo de varias fechas, el equipo construyó un retrato en lapso temporal de cómo la señal de salud de cada parcela sube y baja conforme el cultivo se desarrolla. Esto facilita diferenciar cultivos en función de su evolución en el tiempo, no solo por su aspecto en un día concreto.

Enseñar al modelo en qué concentrarse

Para leer estas “películas” de salud vegetal, el estudio emplea un modelo de aprendizaje profundo construido alrededor de un tipo de red llamado LSTM, que funciona bien con secuencias. Sobre esta base, los autores añadieron varias formas de mecanismos de “atención”, herramientas matemáticas que permiten al modelo decidir qué instantes temporales son más importantes para tomar una decisión. Una innovación clave es una versión de auto‑atención que utiliza la función de activación tanh. Este diseño amortigua valores extremos y ayuda a la red a captar cambios sutiles pero relevantes en las curvas de salud vegetal. El sistema también incluye un preprocesado cuidadoso: alineación de imágenes, corrección de iluminación, filtrado de no‑vegetación y normalización de todas las características para que ningún índice domine.

Mapas más nítidos y menos falsas alarmas

Cuando se compararon las distintas variantes de atención, la auto‑atención basada en tanh resultó superior, alcanzando un 88,89% de exactitud en la separación de ragi y frijoles—una mejora de más de ocho puntos porcentuales respecto a una sólida línea base basada en Random Forest orientado a objetos y por delante de otros tipos de atención como multiplicativa, global y soft. El modelo ofreció buen desempeño para ambos cultivos, con precisión y recall equilibrados, y manejó mejor que métodos previos el desafío de parcelas que se parecen durante el crecimiento temprano. Un umbral de confianza aseguró que los píxeles con predicciones inciertas se etiquetaran como fondo en lugar de forzar una clasificación, reduciendo las malas clasificaciones en alrededor de un 12%. Un filtrado espacial sencillo luego suavizó los mapas para que el resultado pareciera campos realistas en lugar de ruido salpicado.

Qué significa esto para la agricultura futura

En términos claros, el estudio demuestra que enseñar a las redes neuronales no solo a ver, sino también a prestar atención a los momentos de crecimiento relevantes, conduce a mapas de cultivos desde el espacio mucho más fiables. Aunque el trabajo se centra en ragi y frijoles en una región y una temporada concretas, el mismo enfoque podría extenderse a otros cultivos, climas y sistemas satelitales. Para agricultores, organismos y aseguradoras, estas herramientas prometen información más temprana y precisa sobre qué se ha sembrado dónde y cómo está rindiendo, permitiendo una mejor planificación, insumos más dirigidos y mayor seguridad alimentaria con menor impacto ambiental.

Cita: Sharma, M., Kumar, A., Muthuraman, S. et al. Deep learning techniques for crop classification in complex agricultural landscapes. Sci Rep 16, 8831 (2026). https://doi.org/10.1038/s41598-026-37806-2

Palabras clave: teledetección, mapeo de cultivos, aprendizaje profundo, agricultura de precisión, índices de vegetación