Clear Sky Science · es

Enfoque complementario de localización visual y mapeo táctil para la percepción robótica de objetos de tamaño milimétrico con superficies irregulares

Robots que pueden ver y sentir

En muchos lugares peligrosos —desde estaciones espaciales hasta zonas de accidentes nucleares— los humanos dependen de robots para manipular pequeños interruptores, pastillas, tornillos y botones. Pero los “ojos” habituales de los robots a menudo fallan cuando la iluminación es deficiente o los objetos son muy pequeños y rugosos. Este artículo presenta un sistema de sensado robótico que combina vista y tacto, inspirado en la forma en que las personas primero observan un objeto y luego lo exploran con las yemas de los dedos.

Por qué la visión por sí sola no es suficiente

La mayoría de los robots modernos dependen de cámaras y sensores de profundidad para reconocer objetos y decidir cómo moverse. Estas herramientas visuales funcionan bien en fábricas limpias y bien iluminadas, pero tienen dificultades cuando la escena está oscura, abarrotada o parcialmente oculta. Los autores muestran que incluso sistemas de cámaras potentes pueden perder el rastro de pequeños objetos o pasar por alto detalles finos de la superficie, especialmente con poca luz o con reflejos. En tales casos, un robot puede saber aproximadamente dónde está algo, pero no si tiene pequeñas protuberancias, hendiduras o cantos irregulares que son cruciales para agarrar o presionar con precisión.

Construir un dedo que pueda sentir detalles minúsculos

Para abordar este problema, los investigadores construyeron un sensor táctil blando, similar a la piel, que se comporta más como la yema de un dedo humano. Mediante impresión por inyección de tinta, depositaron trazas metálicas flexibles sobre un material elástico parecido a la goma, formando una rejilla de píxeles sensibles a la presión. Entre las capas metálicas hay una película texturada fabricada con lija común, que aporta una estructura fina e irregular que aumenta la sensibilidad del sensor. Cuando el sensor se presiona contra un objeto, su señal eléctrica cambia con la presión, lo que le permite detectar toques muy leves —hasta el tamaño de un pequeño grano de arroz— y resistir miles de ciclos de presión y liberación sin perder rendimiento.

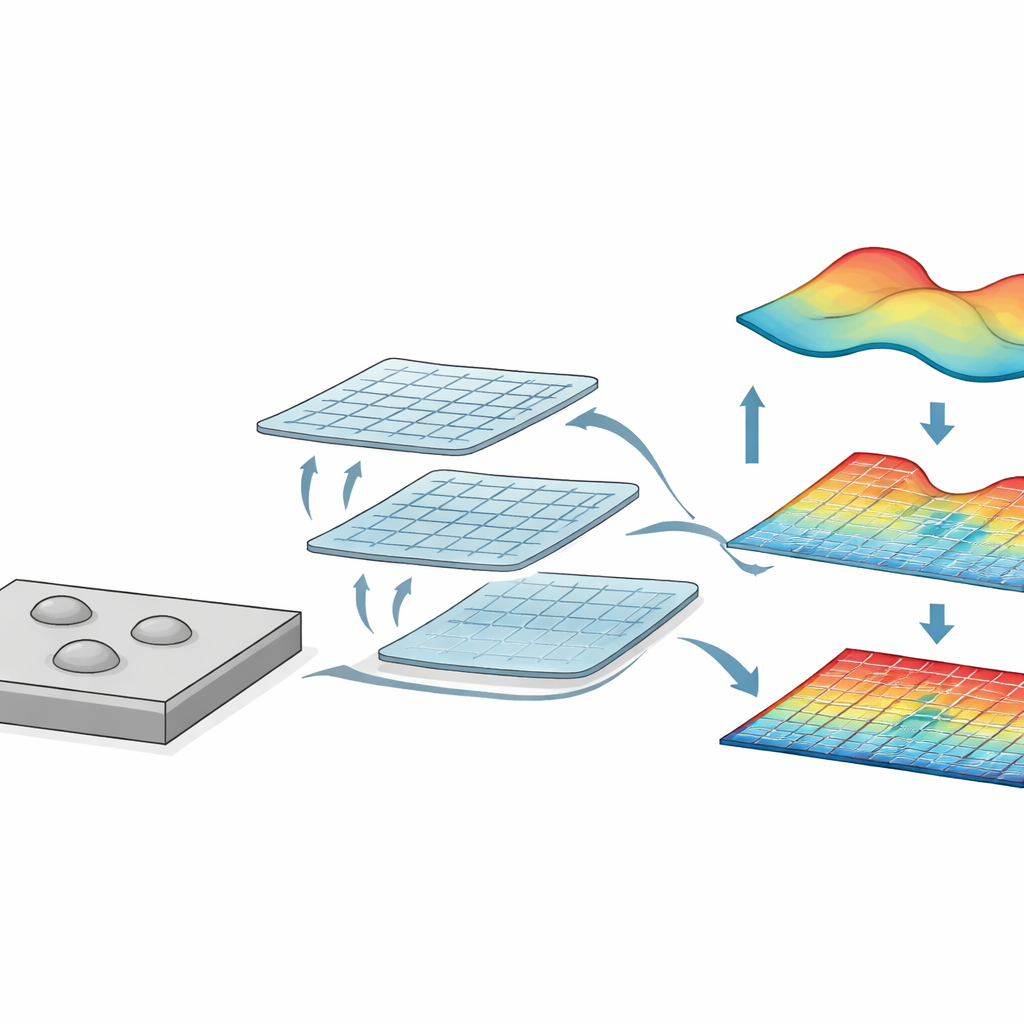

Convertir el tacto en mapas de forma

El sensor blando se amplió luego a una pequeña matriz capaz de capturar patrones de presión sobre un área, de manera similar a una imagen de baja resolución. Cuando el equipo presionó objetos en forma de anillo u otras formas complejas sobre el sensor, los mapas de presión resultantes revelaron claramente sus contornos y regiones huecas, mostrando que el sensor puede “ver” formas mediante el tacto. Las simulaciones por computadora confirmaron que el material blando concentra el esfuerzo de forma local, similar a la piel humana, lo que le ayuda a captar diferencias finas de altura y textura en características de tamaño milimétrico, como pequeñas protuberancias o salientes en una superficie.

Poner a trabajar la visión y el tacto en conjunto

El sistema completo utiliza una cámara RGB‑Profundidad para localizar un objeto en el espacio y una almohadilla táctil blanda para explorar su superficie. Primero, la cámara estima la posición y la forma general del objeto desde la distancia, al igual que una persona que mira una mesa antes de extender la mano. Cuando la información visual se vuelve poco fiable —por sombras, reflejos o problemas de enfoque— el robot acerca su sensor táctil al objeto. Al escanear la almohadilla sobre distintas partes de la superficie y coser los datos de presión, el sistema reconstruye un perfil tridimensional de rasgos de apenas unos milímetros de tamaño, como las cúpulas elevadas de pastillas en un blíster o pequeñas protuberancias en un panel de control.

Qué significa esto para los robots del futuro

Al fusionar la localización basada en cámaras con el mapeo táctil detallado, este trabajo muestra cómo los robots pueden manejar objetos diminutos e irregulares incluso cuando no pueden confiar plenamente en sus “ojos”. El estudio demuestra que un sensor impreso simple y de bajo coste puede tanto respaldar como, cuando es necesario, reemplazar a la visión. Esto sienta las bases para robots futuros que se adapten a condiciones cambiantes, combinando vista y tacto como lo hacen los humanos para realizar tareas precisas en entornos desordenados, impredecibles o peligrosos.

Cita: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Palabras clave: robots humanoides, sensado táctil, percepción multimodal, micromanipulación, visión RGB‑profundidad