Clear Sky Science · de

Ein Bilderkennungsalgorithmus für feingranulare Hochfrequenz‑Werkstücke basierend auf einer Multi‑Branch‑Netzwerkarchitektur

Schlauere Augen für Fabrikteile

Moderne Fabriken sind auf Kameras und Rechner angewiesen, die tausende nahezu identische Metallteile mit hoher Geschwindigkeit sortieren. Wenn sich diese Teile nur in winzigen Oberflächendetails unterscheiden, gerät selbst fortgeschrittene Bilderkennungssoftware leicht in Verlegenheit — das führt zu Fehlsortierungen, Produktionsverzögerungen und zusätzlichen Kosten. Diese Studie stellt einen neuen Ansatz vor, mit dem Maschinen solche ähnlich aussehenden Bauteile besser „sehen“ und unterscheiden können, was zuverlässigere, flexiblere und effizientere automatisierte Fertigungsprozesse verspricht.

Warum ähnliche Teile schwer zu unterscheiden sind

In vielen Fertigungsstraßen müssen sogenannte Hochfrequenz‑Werkstücke — flache Metallteile, die in großen Stückzahlen gefertigt werden — in Dutzende Kategorien eingeordnet werden. Die Schwierigkeit liegt darin, dass Teile innerhalb derselben Kategorie komplexe Oberflächentexturen zeigen können, während Teile aus verschiedenen Kategorien von oben betrachtet fast gleich aussehen. Änderungen in der Beleuchtung und Variationen in der Positionierung vor der Kamera erschweren das Problem weiter. Diese Aufgabe gehört zu dem, was Informatiker feingranulare Erkennung nennen: nicht einfach ein Auto von einer Person zu unterscheiden, sondern ein sehr ähnliches Teil anhand subtiler Hinweise von einem anderen zu trennen.

Zwei Pfade, um jedes Teil zu betrachten

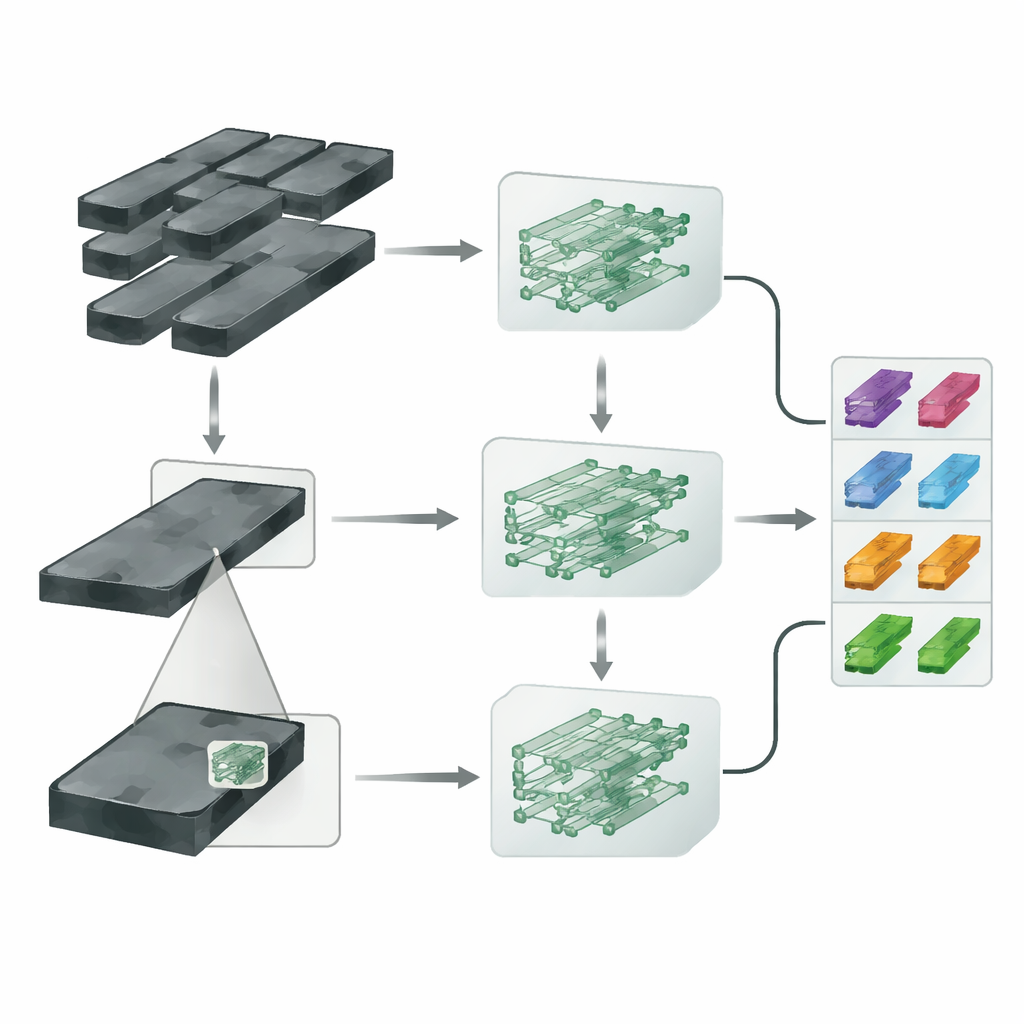

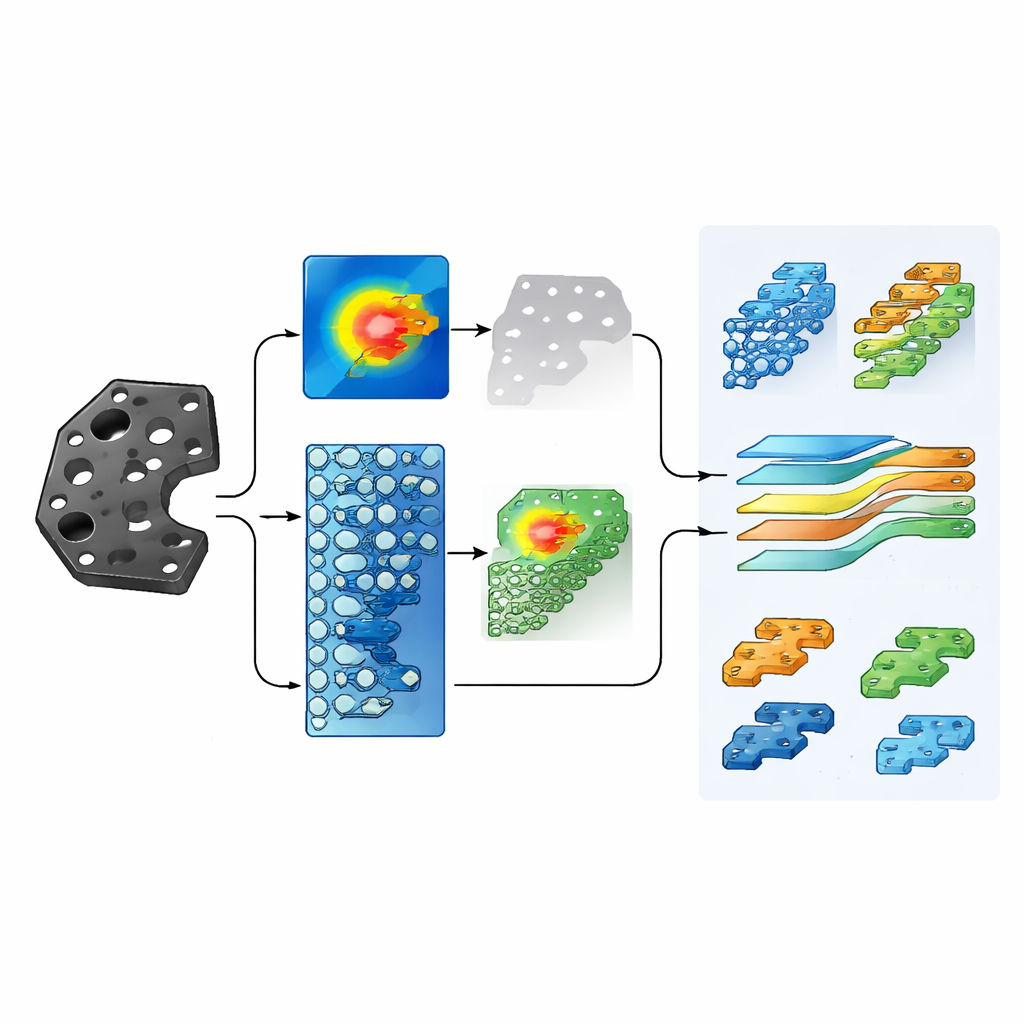

Die Forschenden bauen auf einem kompakten neuronalen Netz namens EfficientNet‑B0 auf und verwandeln es in ein Multi‑Branch‑System, das sie MBEN nennen. Anstatt dem Netzwerk nur das Gesamtbild eines Teils zu geben, lassen sie das Modell zunächst grob ermitteln, welcher Bildbereich die unterscheidungsstärksten Informationen trägt. Ein speziell schwach überwachte Regionenerkennungsmodul erzeugt eine Art Heatmap, die wahrscheinliche Schlüsselzonen hervorhebt, und schneidet dann einen kleineren Bildausschnitt um diesen Bereich aus. Das Vollbild läuft durch einen Zweig des Netzwerks (den globalen Zweig), während die vergrößerte Nahaufnahme durch einen anderen Zweig (den lokalen Zweig) läuft. Dieses Design erlaubt dem System, sowohl das Gesamtbild als auch die winzigen, lokalisierten Unterschiede zu lernen, die einen Teiltyp vom anderen trennen.

Dem Modell beibringen, worauf es wirklich ankommt

Zwei Ansichten allein reichen nicht aus; das Netzwerk muss außerdem darauf trainiert werden, sich auf die richtigen Unterscheidungsmerkmale zu konzentrieren. Dazu entwerfen die Autorinnen und Autoren ein Verlust‑Augmentationsmodul — Regeln, die steuern, wie sich das Netzwerk während des Trainings anpasst. Ein Teil dieses Moduls veranlasst das System, Kategorien, die es derzeit verwirrend findet, besonders zu beachten, damit es sich nicht bei einfachen Fällen übermäßig sicher fühlt und schwierige vernachlässigt. Ein anderer Teil fördert, dass Bilder desselben Werkstücktyps in der internen Repräsentation des Netzwerks nahe beieinander liegen, während unterschiedliche Typen weiter auseinander gedrängt werden. Zusammen formen diese Mechanismen eine klarere interne Karte der Teilkategorien und erhöhen die Wahrscheinlichkeit, dass neue, ungesehene Bilder korrekt klassifiziert werden.

Das Gesamtbild mit der Nahaufnahme verbinden

Nachdem der globale und der lokale Zweig jeweils eigene Vorhersagen erzeugt haben, kombiniert ein Zweig‑Fusion‑Modul diese zu einer finalen Entscheidung. Die Forschenden justieren, wie viel jeder Zweig beitragen soll, und stellen fest, dass eine etwas stärkere Gewichtung des Globalbildes bei gleichzeitig starker Berücksichtigung der Nahaufnahme am besten funktioniert. Sie prüfen ihre Methode an einem maßgeschneiderten Datensatz mit 20 Arten von Hochfrequenz‑Werkstücken, fotografiert unter realistischen Fabrikbedingungen, mit Tausenden von Bildern, die durch Daten‑Augmentation wie Rotationen und zufällige Ausschnitte erweitert wurden. Das MBEN‑System erreicht eine Genauigkeit von 98,75 % — mehrere Prozentpunkte besser als eine Reihe bestehender feingranularer Erkennungsverfahren — und verwendet dabei vergleichsweise moderate Rechenressourcen.

Was das für die reale Produktion bedeutet

Die Studie zeigt, dass die Kombination aus Kontext des Gesamtbildes, automatisch entdeckten Detailausschnitten und sorgfältig gestalteten Trainingsregeln die Maschinenvision für schwierige Industrieaufgaben deutlich verlässlicher macht. Für Hersteller könnten solche Verbesserungen weniger Sortierfehler, weniger manuelle Nachkontrollen und größere Flexibilität beim Wechsel zwischen vielen ähnlichen Produkttypen bedeuten. Obwohl die Arbeit noch nicht das Problem unausgewogener Real‑World‑Daten adressiert, bei denen manche Teiltypen deutlich seltener sind als andere, deuten die Ergebnisse darauf hin, dass schlauere, selektivere digitale „Augen“ mit immer präziseren und vielfältigeren Produktionslinien Schritt halten können.

Zitation: Deng, J., Sun, C., Lin, J. et al. An image recognition agorithm for fine-grained high-frequency workpieces based on a multi-branch network architecture. Sci Rep 16, 11067 (2026). https://doi.org/10.1038/s41598-026-41639-4

Schlüsselwörter: industrielle Bilderkennung, feingranulare Klassifikation, automatisierte Qualitätskontrolle, Computer Vision in der Fertigung, Neuronale Netze