Clear Sky Science · de

Ein leichtgewichtiges Multi-Skalen-Erkennungsframework für Röntgenbilder mit überwachtem kontrastivem Lernen

Warum intelligentere Röntgenkontrollen wichtig sind

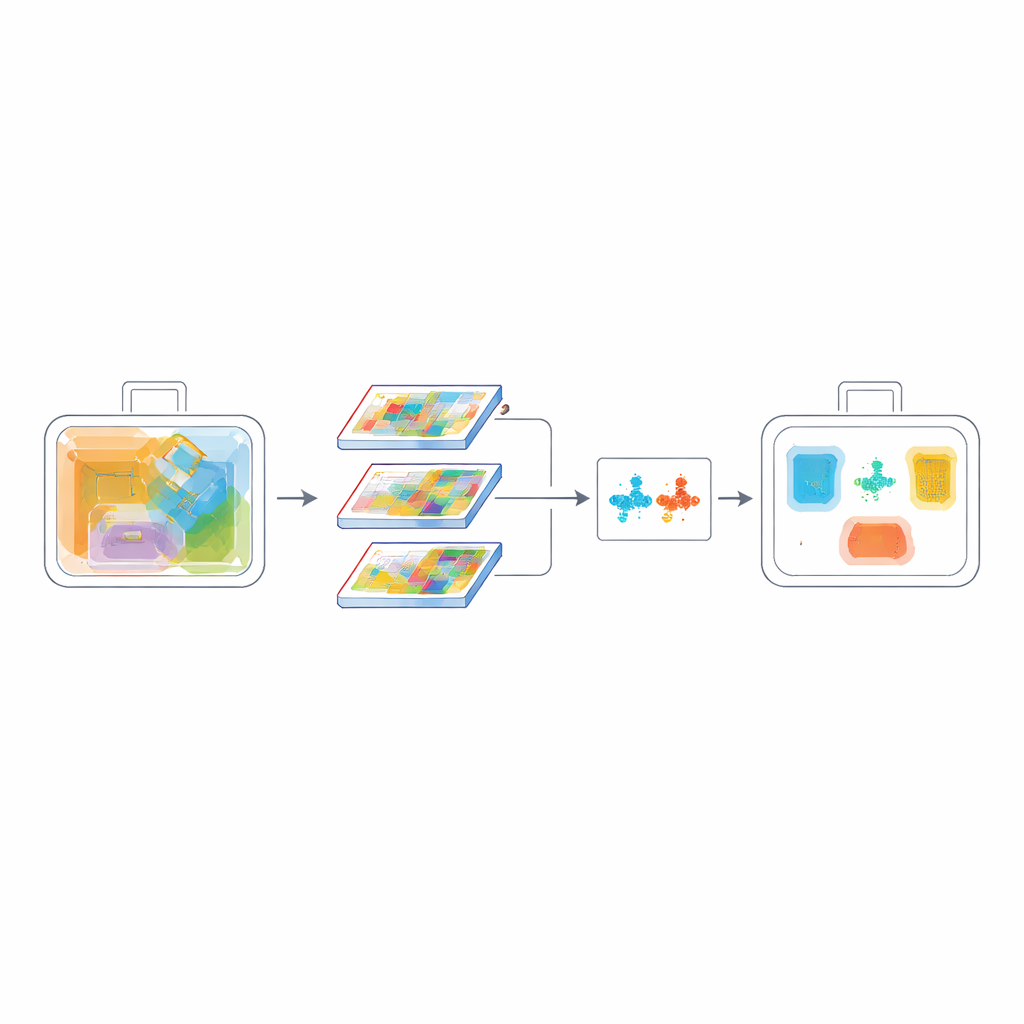

Wer sich bereits durch die Sicherheitskontrolle am Flughafen geschoben hat, weiß: Jede Tasche muss schnell und zuverlässig gescannt werden. Röntgenbilder sind dabei alles andere als einfach zu interpretieren: Messer, Flaschen, Laptops und Ladegeräte liegen übereinander, und gefährliche Gegenstände können sich leicht im Durcheinander verbergen. Dieses Papier stellt eine neue Methode der künstlichen Intelligenz (KI) vor, die Röntgengeräten dabei hilft, kleine oder überlappende Gefahren zuverlässiger zu erkennen und gleichzeitig schnell genug für stark frequentierte Kontrollpunkte zu bleiben.

Die Herausforderung, sich durch das Durcheinander zu sehen

Röntgensicherheitssysteme sind die erste Verteidigungslinie in Flughäfen, U-Bahn-Stationen und anderen stark frequentierten öffentlichen Räumen. Traditionelle manuelle Inspektion ist langsam und ermüdend, was das Risiko übersehener Gegenstände erhöht. Moderne KI-Detektoren wie die YOLO-Familie haben die automatisierte Kontrolle verbessert, wurden aber ursprünglich für Alltagsfotos entwickelt, nicht für geisterhafte, kontrastarme Röntgenansichten. In diesen Scans überlagern sich Objekte häufig, erscheinen halbtransparent und variieren stark in der Größe. Kleine Klingen oder Flaschen können zwischen harmlosen Gegenständen vergraben sein, und viele aktuelle Algorithmen übersehen sie oder benötigen hohe Rechenleistung, die sich nur schwer auf kompakten, kostengünstigen Geräten einsetzen lässt.

Ein schlankeres „Gehirn“ für Röntgengeräte

Die Autoren bauen auf dem populären YOLOv8-Detektor auf und gestalten ihn speziell für Röntgenbilder neu. Ihr erster Schritt ist die Verschlankung des Netzwerks durch "depthwise separable"-Convolutions — fachlich ausgedrückt eine sparsamere Betrachtung von Mustern. Statt große, teure Filter auf alle Kanäle des Bildes gleichzeitig anzuwenden, wird die Operation in günstigere Einzelschritte unterteilt. Diese Änderung reduziert die Anzahl der Berechnungen um etwa ein Viertel bis zwei Fünftel, erhält aber dennoch die feinen Details, die nötig sind, um kleine, teilweise verdeckte Objekte zu erkennen. Das Ergebnis ist ein leichteres digitales "Gehirn", das in Echtzeit auf bescheidener Hardware laufen kann, etwa auf eingebetteten Prozessoren in Scannern.

Dem Modell helfen, sich auf Wesentliches zu konzentrieren

Das Netzwerk kleiner zu machen ist nicht genug; es muss zudem selektiver werden. Zu diesem Zweck führen die Forscher ein Channel-Spatial Attention Fusion (CSAF)-Modul ein. Ein Zweig dieses Moduls lernt, welche Arten visueller Merkmale — Kanten, Formen oder Materialhinweise — insgesamt am informativsten sind, während ein anderer Zweig lernt, wo im Bild die relevanten Bereiche liegen. Anstatt diese Aufmerksamkeiten nacheinander anzuwenden, verarbeitet CSAF sie parallel und verschmilzt sie anschließend, sodass das System gleichzeitig sowohl das „Was“ als auch das „Wo“ berücksichtigen kann. Diese Attention-Einheiten sind in ein Multi-Skalen-Design eingebettet, das grobe und feine Blickwinkel der Szene kombiniert — besonders nützlich beim Erkennen winziger, überlappender Gegenstände in überfüllten Taschen.

Dem System beibringen, ähnliche Erscheinungsbilder zu unterscheiden

Eine weitere Schwierigkeit bei Röntgenscans ist, dass viele Gegenstände ähnlich aussehen: Eine Dose und ein Sprühbehälter oder verschiedene Messertypen können nahezu identische Konturen haben. Um das Modell besser darin zu machen, solche Kategorien auseinanderzuhalten, fügen die Autoren ein kontrastives Lernziel hinzu. Während des Trainings wird das Netzwerk dazu angeleitet, Beispiele derselben Klasse in seiner internen Darstellung näher zusammenzubringen und gleichzeitig unterschiedliche Klassen weiter auseinanderzustoßen. Parallel dazu hilft eine pixelgenaue Überlappungsmetrik namens PIoU, die Platzierung und Form der vorhergesagten Begrenzungsrahmen fein abzustimmen — wichtig, wenn Objekte geneigt, überfüllt oder nur teilweise sichtbar sind. Zusammen lehren diese Verluste das Modell nicht nur, wo sich ein Objekt befindet, sondern auch, was es von verwirrenden Nachbarn unterscheidet.

Leistungsnachweis in realistischen Tests

Das Team bewertet seinen Ansatz an zwei anspruchsvollen Röntgendatensätzen, die reale Kontrollpunkte und synthetische Gepäckszenen mit mehreren Gefahrenkategorien enthalten. Im Vergleich zur Standard-YOLOv8-Basis erreicht ihr Modell bei strikten Überlappungsmaßen höhere Genauigkeit, während es weniger Parameter und weniger Rechenaufwand benötigt. Es hält sehr hohe Erkennungsraten für scharfe Objekte aufrecht und verbessert die Erkennung transparenter oder verformbarer Gegenstände wie Flaschen und Getränkekartons. Precision–Confidence- und Recall–Confidence-Kurven zeigen, dass seine Vorhersagen selbst bei angehobenen Schwellenwerten stabil bleiben, was weniger Fehlalarme und weniger übersehene Gefahren bedeutet. Tests an einem zweiten, anderweitig gesammelten Datensatz bestätigen, dass das System gut generalisiert — eine wichtige Voraussetzung für den Einsatz in der Praxis, wo Tascheninhalte und Aufnahmebedingungen variieren.

Was das für Reisende im Alltag bedeutet

Für Laien lautet die Quintessenz: Diese Arbeit bietet eine intelligentere, schlankere Methode zum Scannen von Gepäck. Indem ein moderner KI-Detektor sowohl leichtgewichtig als auch besser unterscheidungsfähig gestaltet wird, ermöglichen die Autoren Röntgengeräte, die schnell auf erschwinglicher Hardware laufen und dennoch kleine, überlappende oder ähnlich aussehende Gefahren erkennen. Wenn solche Methoden in der Praxis übernommen werden, könnten sie Warteschlangen verkürzen, unnötige Taschenkontrollen reduzieren und — am wichtigsten — die Wahrscheinlichkeit erhöhen, dass wirklich gefährliche Gegenstände entdeckt werden, bevor sie das Gate erreichen.

Zitation: Diao, Q., Chan, W., Zain, A.M. et al. A lightweight multi-scale detection framework for X-ray images with supervised contrastive learning. Sci Rep 16, 8635 (2026). https://doi.org/10.1038/s41598-026-38000-0

Schlüsselwörter: Röntgen-Sicherheit, Objekterkennung, Tiefes Lernen, Flughafenkontrolle, Computer Vision