Clear Sky Science · de

Deep-Learning-Techniken zur Klassifizierung von Feldfrüchten in komplexen Agrarlandschaften

Warum intelligentere Erntekarten wichtig sind

Da Klimawandel, Wassermangel und steigende Nahrungsnachfrage den Druck auf Landwirtinnen und Landwirte erhöhen, ist es entscheidend zu wissen, was genau wo wächst und wie die Pflanzen gedeihen. Diese Studie zeigt, wie eine neue Kombination aus Satellitenbildern und fortgeschrittenem Deep Learning unterschiedliche Feldfrüchte in dicht gemischten Beständen genauer unterscheiden kann. Indem man Computern beibringt, auf wichtige Zeitpunkte im Pflanzenwachstum besondere "Aufmerksamkeit" zu richten, rücken die Forschenden einen Schritt näher an eine feldgenaue, nahezu Echtzeit-Überwachung — ein Werkzeug zur Unterstützung besserer Erträge und nachhaltigerer Bewirtschaftung.

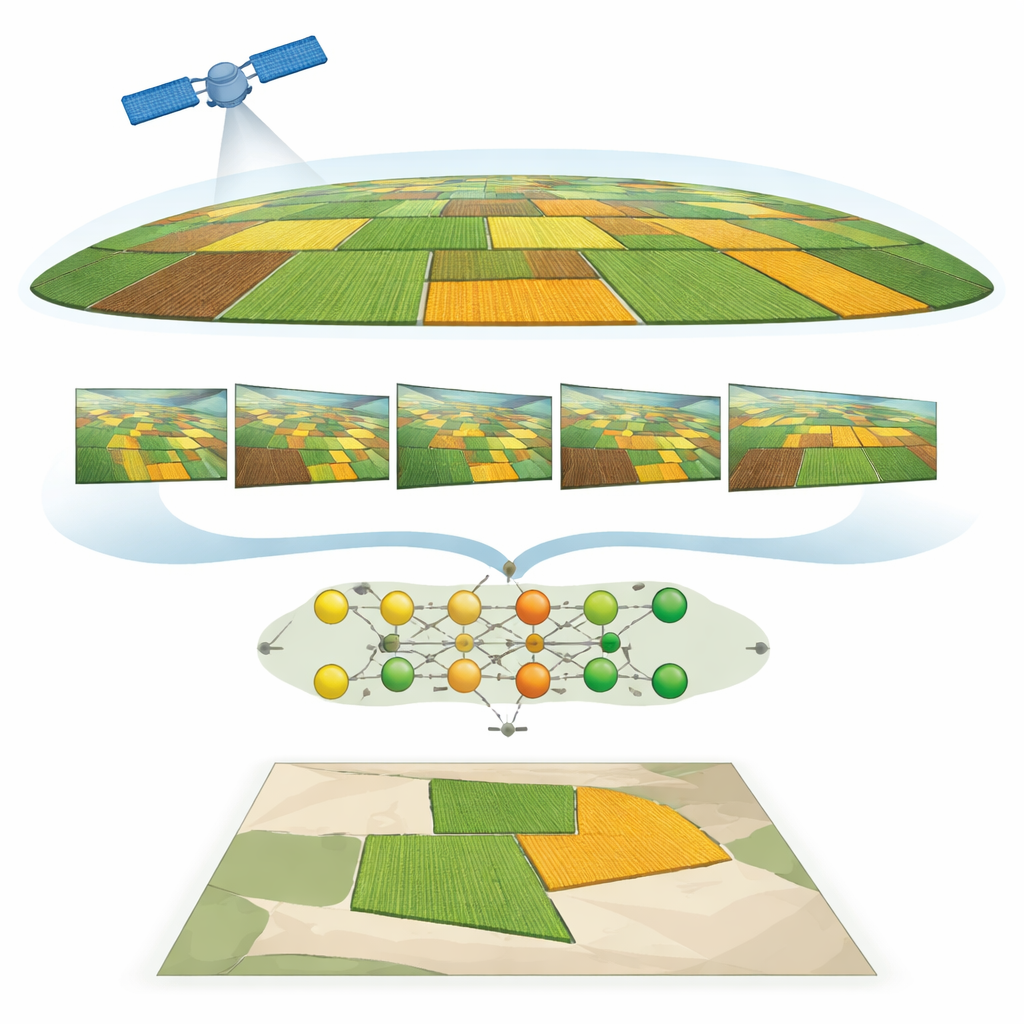

Felder aus dem Weltraum im Zeitverlauf beobachten

Die Arbeit konzentriert sich auf landwirtschaftliche Betriebe um Hoskote in der Nähe von Bengaluru, Indien, wo zwei Grundnahrungsmittel — Ragi (Fingerhirse) und Bohnen — häufig in einem Flickenteppich kleiner Parzellen nebeneinander wachsen. Herkömmliche Kartierungen stoßen hier an ihre Grenzen, weil die Felder klein, die Landschaft heterogen und die Pflanzen besonders in frühen Wachstumsphasen sehr ähnlich aussehen können. Zur Bewältigung dieser Herausforderungen nutzte das Team hochauflösende PlanetScope-Satellitenbilder, die mehrfach zwischen Oktober und Januar aufgenommen wurden. Jedes Bild erfasst mehrere Lichtfarben, einschließlich Spektralbereiche, die das menschliche Auge nicht wahrnimmt, die Pflanzen aber stark reflektieren und Hinweise auf Gesundheitszustand und Entwicklungsstadium liefern.

Licht in Pflanzenzustandssignale verwandeln

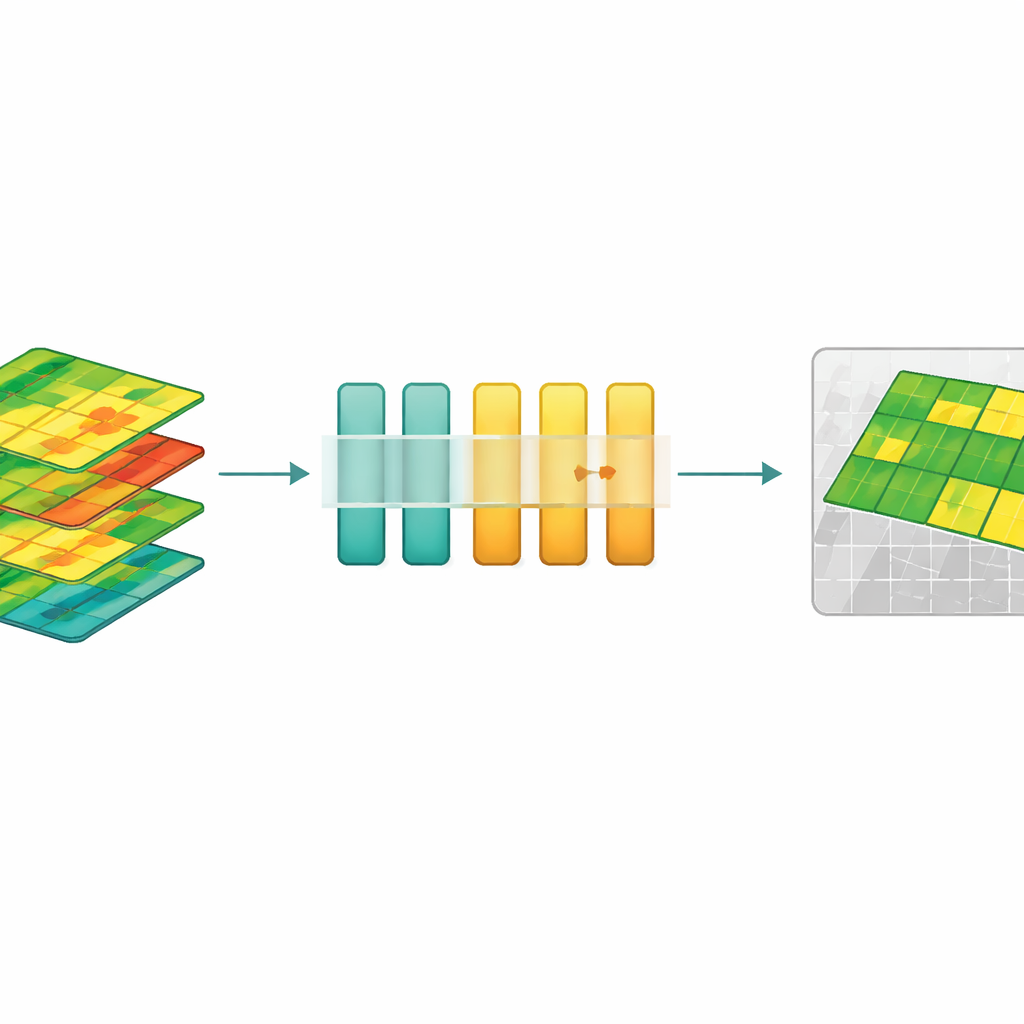

Statt nur mit rohen Satellitenfarben zu arbeiten, wandelten die Forschenden die Daten in "Vegetationsindizes" um, die komprimiert Auskunft darüber geben, wie grün, dicht und vital die Pflanzen sind. Bekanntere Indizes wie NDVI, EVI, GNDVI, NDRE und MCARI setzen Kombinationen aus Rot, Grün, Blau, Nahinfrarot und Rotkante in numerische Werte um, die mit Blattchlorophyll, Kronendichte und Entwicklungsstadium korrelieren. Indem diese Indizes über mehrere Termine gestapelt wurden, entstand ein Zeitraffer-Porträt davon, wie das Gesundheitsignal jedes Feldes im Verlauf des Wachstums an- und abschwillt. So lassen sich Feldfrüchte leichter anhand ihres zeitlichen Wachstumsverlaufs unterscheiden und nicht nur anhand ihres Erscheinungsbildes an einem einzelnen Tag.

Dem Modell beibringen, worauf es achten soll

Um diese "Pflanzenvideos" zu lesen, verwendet die Studie ein Deep-Learning-Modell, das auf einer Netzarchitektur vom Typ LSTM basiert, die gut mit Sequenzen umgehen kann. Darauf aufbauend fügten die Autorinnen und Autoren mehrere Formen von "Attention"-Mechanismen hinzu — mathematische Werkzeuge, die dem Modell erlauben, zu entscheiden, welche Zeitpunkte für eine Klassifikation am wichtigsten sind. Eine zentrale Innovation ist eine Form der Selbst-Attention, die die tanh-Aktivierungsfunktion nutzt. Diese Gestaltung dämpft extreme Werte und hilft dem Netzwerk, subtile, aber aussagekräftige Veränderungen in den Pflanzengesundheitskurven zu erfassen. Das System umfasst außerdem sorgfältige Vorverarbeitungsschritte: Bildausrichtung, Beleuchtungskorrektur, Herausfiltern nicht-vegetativer Flächen und Normalisierung aller Merkmale, sodass kein einzelner Index dominiert.

Scharfere Karten und weniger Fehlalarme

Beim Vergleich der verschiedenen Attention-Varianten schnitt die auf tanh basierende Selbst-Attention am besten ab und erreichte eine Genauigkeit von 88,89 % bei der Unterscheidung von Ragi und Bohnen — ein Gewinn von mehr als acht Prozentpunkten gegenüber einem starken objektbasierten Random-Forest-Basismodell und besser als andere Attention-Typen wie multiplikative, globale und soft-Attention. Das Modell zeigte für beide Kulturen eine ausgewogene Präzision und Vollständigkeit (Precision und Recall) und meisterte die Herausforderung ähnlich aussehender Felder in frühen Wachstumsphasen besser als frühere Methoden. Eine Konfidenzschwelle sorgte dafür, dass Pixel mit unsicheren Vorhersagen als Hintergrund gekennzeichnet wurden, anstatt gewaltsam einer Klasse zugewiesen zu werden, was Fehlklassifikationen um etwa 12 % reduzierte. Einfache räumliche Filter glätteten die Karten anschließend, sodass das Ergebnis wie realistische Parzellen und nicht wie punktiertes Rauschen wirkt.

Was das für die Landwirtschaft der Zukunft bedeutet

Einfach gesagt zeigt die Studie, dass es einen erheblichen Gewinn bei der Zuverlässigkeit satellitengestützter Erntekarten bringt, wenn neuronale Netze nicht nur lernen zu sehen, sondern auch den richtigen Wachstumszeitpunkten Aufmerksamkeit schenken. Obwohl die Arbeit sich auf Ragi und Bohnen in einer Region und einer Saison konzentriert, lässt sich derselbe Ansatz auf andere Kulturen, Klimazonen und Satellitensysteme übertragen. Für Landwirtinnen und Landwirte, Behörden und Versicherer versprechen solche Werkzeuge frühere und genauere Informationen darüber, was wo gepflanzt ist und wie es sich entwickelt — was bessere Planung, gezieltere Betriebsmittelverwendung und eine verbesserte Ernährungssicherheit bei geringerem Umweltfußabdruck ermöglicht.

Zitation: Sharma, M., Kumar, A., Muthuraman, S. et al. Deep learning techniques for crop classification in complex agricultural landscapes. Sci Rep 16, 8831 (2026). https://doi.org/10.1038/s41598-026-37806-2

Schlüsselwörter: Fernerkundung, Erntekartierung, Deep Learning, Präzisionslandwirtschaft, Vegetationsindizes