Clear Sky Science · de

Komplementärer visueller Lokalisierungs- und taktiler Abbildungsansatz für die robotische Wahrnehmung millimetergroßer Objekte mit unregelmäßigen Oberflächen

Roboter, die sehen und fühlen können

In vielen gefährlichen Umgebungen – von Raumstationen bis hin zu nuklearen Unfallstellen – verlassen sich Menschen auf Roboter, um winzige Schalter, Pillen, Schrauben und Tasten zu bedienen. Doch herkömmliche Roboter-„Augen“ versagen oft bei schwacher Beleuchtung oder wenn Objekte sehr klein und unregelmäßig sind. Diese Arbeit stellt ein robotisches Sensorsystem vor, das Sehen und Tasten kombiniert, inspiriert von der Art und Weise, wie Menschen zuerst ein Objekt betrachten und es dann mit den Fingerspitzen erkunden.

Warum alleiniges Sehen nicht ausreicht

Die meisten modernen Roboter verlassen sich auf Kameras und Tiefensensoren, um Objekte zu erkennen und Bewegungen zu planen. Diese visuellen Werkzeuge funktionieren gut in sauberen, gut beleuchteten Fabriken, kämpfen jedoch in dunklen, überfüllten oder teilweise verdeckten Szenen. Die Autorinnen und Autoren zeigen, dass selbst leistungsfähige Kamerasysteme kleine Gegenstände aus den Augen verlieren oder feine Oberflächendetails übersehen können, insbesondere bei schlechten Lichtverhältnissen oder Blendung. In solchen Fällen weiß ein Roboter vielleicht grob, wo sich etwas befindet, nicht jedoch, ob es winzige Erhebungen, Vertiefungen oder unregelmäßige Kanten hat, die für präzises Greifen oder Drücken entscheidend sind.

Ein Finger, der winzige Details ertasten kann

Um dieses Problem zu lösen, bauten die Forscher einen weichen, hautähnlichen Tastsensor, der sich mehr wie eine menschliche Fingerspitze verhält. Mittels Inkjet-Druck trugen sie flexible Metallbahnen auf ein dehnbares, gummiähnliches Material auf und bildeten so ein Raster von druckempfindlichen Pixeln. Zwischen den Metallschichten befindet sich eine strukturierte Folie, hergestellt mit gewöhnlichem Schleifpapier, die dem Sensor eine feine, unregelmäßige Oberfläche verleiht und seine Empfindlichkeit erhöht. Wenn der Sensor gegen ein Objekt gedrückt wird, ändert sich das elektrische Signal mit dem Druck, sodass sehr leichte Berührungen wahrgenommen werden können – bis hinunter zur Größe eines Reiskorns – und der Sensor tausende Druckzyklen übersteht, ohne an Leistung zu verlieren.

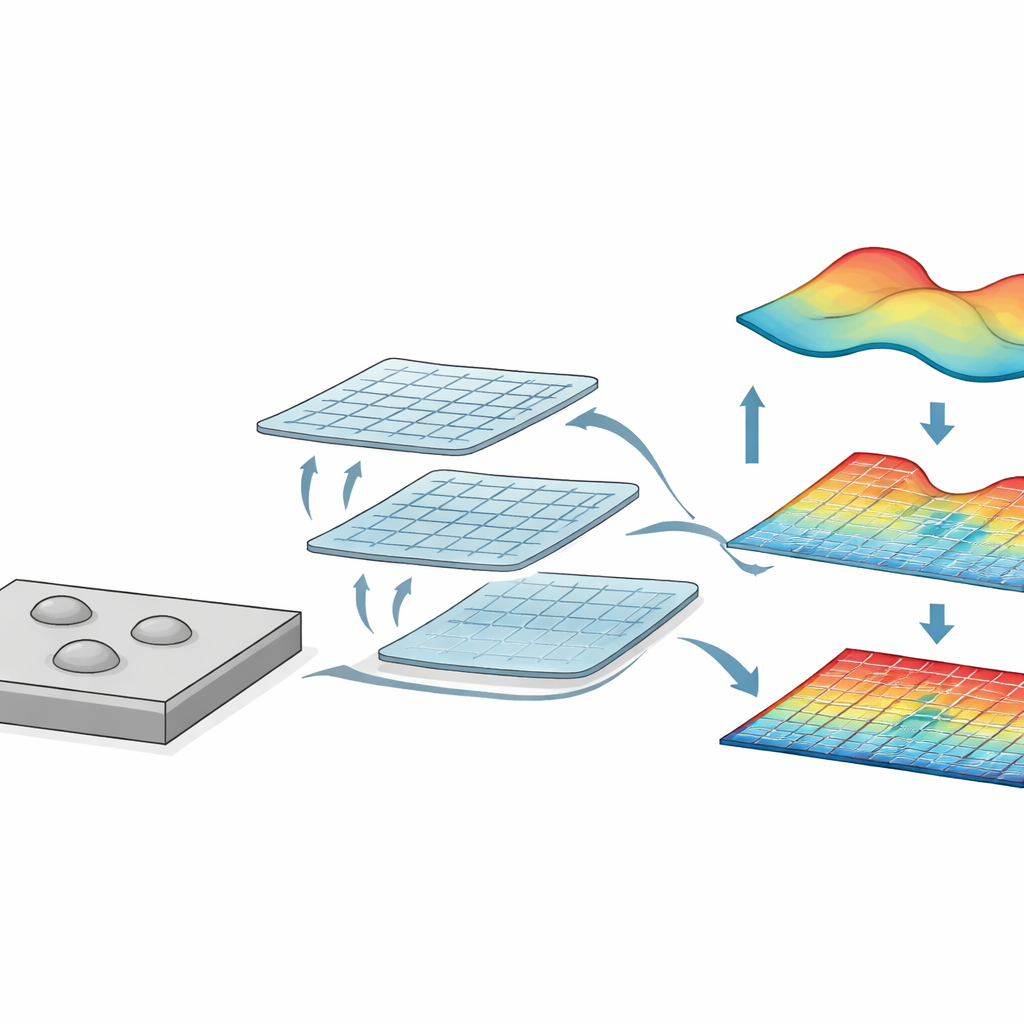

Berührung in Formkarten verwandeln

Der weiche Sensor wurde anschließend zu einem kleinen Array erweitert, das Druckmuster über eine Fläche erfassen kann, ähnlich einem Bild mit niedriger Auflösung. Wenn das Team ringförmige oder andere komplexe Objekte auf den Sensor drückte, zeigten die resultierenden Druckkarten deutlich deren Umrisse und Hohlräume, was beweist, dass der Sensor Formen durch Tasten „sehen“ kann. Computersimulationen bestätigten, dass das weiche Material Spannungen lokal konzentriert, ähnlich wie menschliche Haut, was ihm hilft, feine Höhen- und Texturunterschiede an millimetergroßen Strukturen wie kleinen Erhebungen oder Vorsprüngen auf einer Oberfläche zu erfassen.

Vision und Tastsinn zusammenwirken lassen

Das komplette System nutzt eine RGB-Depth-Kamera, um die Position eines Objekts im Raum zu ermitteln, und ein weiches taktiles Pad, um seine Oberfläche zu erkunden. Zuerst schätzt die Kamera aus der Ferne Lage und grobe Form des Objekts, ähnlich wie eine Person, die einen Tisch anschaut, bevor sie zugreift. Wenn visuelle Informationen unzuverlässig werden – durch Schatten, Blendung oder Fokussierungsprobleme – bringt der Roboter seinen taktilen Sensor in Kontakt mit dem Objekt. Durch das Abtasten des Pads über verschiedene Bereiche der Oberfläche und das Zusammensetzen der Druckdaten rekonstruiert das System ein dreidimensionales Profil von Merkmalen nur wenige Millimeter groß, etwa die erhabenen Kuppeln von Tabletten in einer Blisterpackung oder kleine Unebenheiten auf einem Bedienfeld.

Was das für zukünftige Roboter bedeutet

Durch die Verschmelzung kamerabasierter Lokalisierung mit detailreicher, taktiler Kartierung zeigt diese Arbeit, wie Roboter winzige, unregelmäßige Objekte handhaben können, selbst wenn sie sich nicht vollständig auf ihr „Sehen“ verlassen können. Die Studie demonstriert, dass ein einfacher, kostengünstig gedruckter Sensor sowohl die visuelle Wahrnehmung unterstützen als, wenn nötig, auch ersetzen kann. Das legt die Grundlage für zukünftige Roboter, die sich ändernden Bedingungen anpassen und Sehen und Tasten so kombinieren, wie Menschen es tun, um präzise Aufgaben in unordentlichen, unvorhersehbaren oder gefährlichen Umgebungen auszuführen.

Zitation: Jang, J., Park, BS., Oh, K.T. et al. Complementary visual localization and tactile mapping approach for robotic perception of millimeter-sized objects with irregular surfaces. Microsyst Nanoeng 12, 91 (2026). https://doi.org/10.1038/s41378-026-01190-8

Schlüsselwörter: humanoide Roboter, taktiles Fühlen, multimodale Wahrnehmung, Mikromanipulation, RGB-Tiefen-Vision