Clear Sky Science · de

Fein granuläres Repräsentationslernen zur Erkennung der Yi-Schrift bei geringen Ressourcen und zur Datensatzerstellung

Erhalt eines fragilen schriftlichen Erbes

Die Yi im Südwesten Chinas haben über Jahrhunderte eine reichhaltige schriftliche Tradition bewahrt, in der Medizin, Astronomie, Religion und Alltagsleben in ihrer eigenen Schrift dokumentiert sind. Viele dieser Manuskripte verblassen jedoch, sind verschmutzt oder anderweitig beschädigt, und die Schrift selbst ist visuell komplex. Hundertetausend Zeichen manuell zu transkribieren ist langsam und teuer. Dieses Papier stellt ein neues Computer-Vision-System vor, das speziell dafür entwickelt wurde, Yi-Zeichen in digitalen Bildern alter Dokumente zu finden und zu isolieren und damit die Grundlage für eine groß angelegte Digitalisierung und den Erhalt dieses bedrohten schriftlichen Erbes legt.

Warum diese Schrift für Computer so schwer ist

Im Gegensatz zum bekannteren lateinischen Alphabet oder sogar zum modernen gedruckten Chinesisch bestehen Yi-Zeichen aus dichten, gebogenen Strichen, die oft umeinander gewunden sind. Viele unterschiedliche Zeichen sehen einander sehr ähnlich, und dasselbe Zeichen kann in verschiedenen Zeiten und Manuskripten leicht unterschiedliche Formen annehmen. Historische Seiten verwenden häufig enge Mehrspaltensätze mit unregelmäßigen Abständen und überlappenden Strichen. Hinzu kommen verblasste Tinte, verzogene Seiten und fleckige Hintergründe. Ältere Erkennungsmethoden, die auf festen Regeln zu Abständen oder auf allgemeinen Textdetektionsmodellen beruhen, neigen dazu, benachbarte Zeichen zu verschmelzen, schwache Striche zu übersehen oder Hintergrundrauschen mit Schrift zu verwechseln. Die Autoren argumentieren, dass Yi-Manuskripte eine Art „Worst-Case“-Szenario für Texterkennung darstellen und dass die Lösung dieses Problems vielen anderen ressourcenarmen Schriften helfen könnte.

Eine neue Art, feine Details zu sehen

Um diese Herausforderungen anzugehen, entwerfen die Forscher ein spezialisiertes neuronales Netzwerk namens FGRL-YiNet (Fine-Grained Representation Learning Network for Yi). Im Kern steht eine Variation der standardmäßigen Faltungs-Schichten, dem Arbeitspferd moderner Bildverarbeitung. Anstatt überall ein festes Filtermuster zu verwenden, arbeitet FGRL-YiNet mit dynamischer Faltung: Mehrere Kandidatenfilter wirken parallel, und ein kleines Gate-Modul entscheidet für jede Region des Bildes, wie stark auf jedes einzelne zu vertrauen ist. Das ermöglicht dem System, sein „Rezeptivfeld“ subtil an lokale Strichmuster anzupassen und feine Kurven und Verzweigungen besser zu erfassen, ohne von unruhigen Hintergründen oder Seitenschäden irritiert zu werden. Aufgebaut auf einem kompakten ResNet-18-Backbone bleibt das Modell bewusst moderat in der Größe, damit es effektiv aus der vergleichsweise geringen Menge annotierter Yi-Daten lernen kann.

Skalen kombinieren und die Seite säubern

Die Erkennung von Zeichen auf einer ganzen Manuskriptseite erfordert zudem das Verständnis von Mustern auf mehreren Größenskalen — von winzigen Wellen in einem einzelnen Strich bis hin zur Anordnung einer gesamten Spalte. FGRL-YiNet führt dafür ein Adaptive Multi-Scale Fusion (AMSF)-Modul ein. Das Netzwerk extrahiert zunächst Merkmale auf mehreren Auflösungen und verwendet dann einen gemeinsamen Aufmerksamkeitsmechanismus, um an jedem Ort zu entscheiden, welche Skala und welche Kanäle am wichtigsten sind. Ein Teil dieser Aufmerksamkeit konzentriert sich darauf, „wo“ im Bild feine Details relevant sind, während ein anderer Teil darauf abzielt, „welche“ Art von Merkmal nützlich ist — etwa eine bestimmte Strichbreite oder eine kleine Schleife innerhalb eines Zeichens. Parallel dazu lernt ein differenzierbarer Binarisierungs-Kopf, Tinte vom Hintergrund zu trennen, indem er sowohl eine Wahrscheinlichkeitskarte als auch einen lokal variierenden Schwellenwert vorhersagt. Da dieser Schritt in das Netzwerk integriert und end-to-end trainiert wird, kann er schwache Striche erhalten, die bei herkömmlicher Schwarz-Weiß-Umwandlung verloren gingen, und zugleich Sprenkel und Flecken unterdrücken.

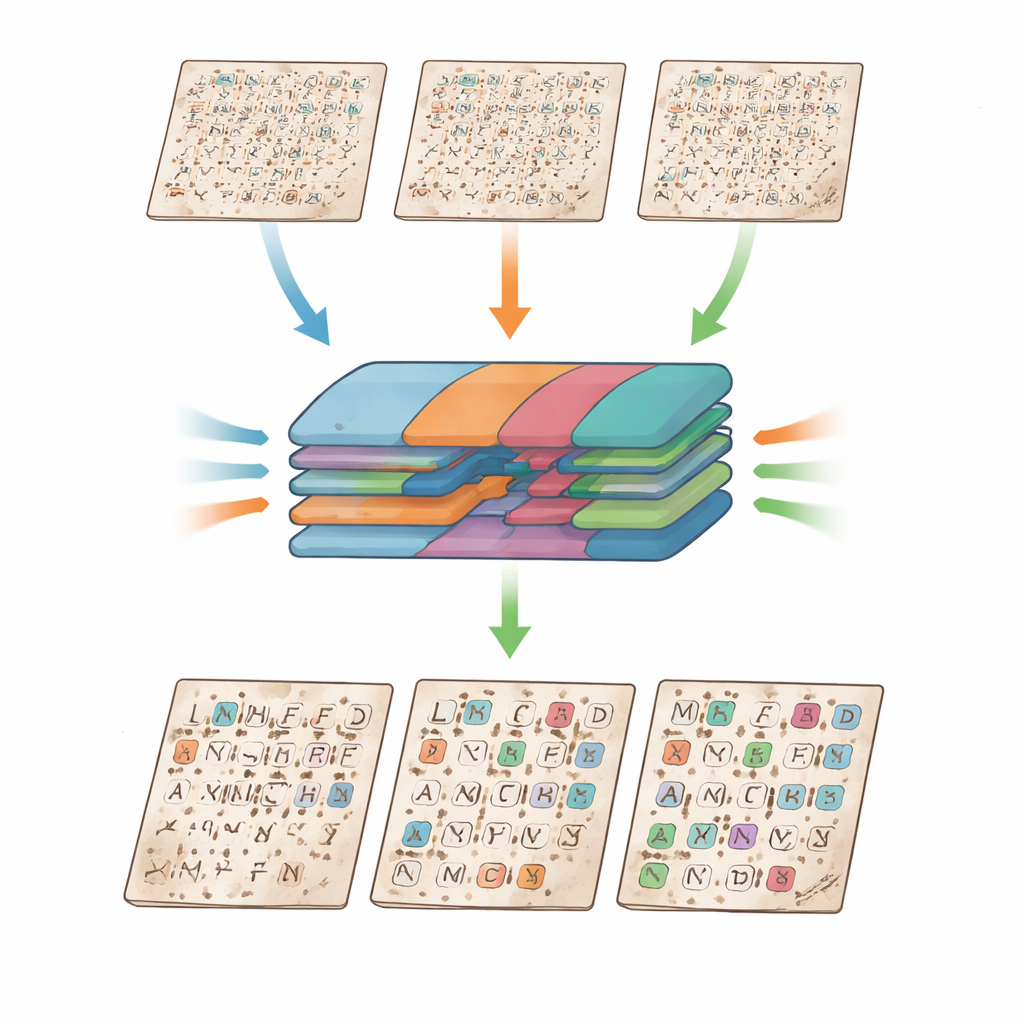

Aufbau eines Benchmarks für eine seltene Schrift

Ein großes Hindernis für jede spezialisierte Schrift ist die Datenlage: Es gibt nur wenige qualitativ hochwertige digitalisierte Yi-Manuskripte und noch weniger mit präzisen Labels für jedes Zeichen. Das Team begegnet dem, indem es den Datensatz YiPrint-694 aus Liangshan-Yi-Klassikern erstellt, was zu fast 347.000 gelabelten Zeichen in 694 Seitenbildern und 1.165 Zeichenkategorien führt. Sie kombinieren sorgfältige Vorverarbeitung — Rauschreduzierung, Kantenschärfung und Binarisierung — mit einer semiautomatischen Segmentierungspipeline und penibler manueller Überprüfung durch Yi-Sprachexpert*innen. Um das Aussehen älterer, verfärbter Seiten zu simulieren, erzeugen sie zusätzliche Bilder mit vergilbten und bräunlichen Hintergründen. Diese kuratierte Sammlung wird sowohl Trainingsgrundlage für FGRL-YiNet als auch ein öffentlicher Benchmark für künftige Forschung an der Yi- und verwandten Schriften.

Wie gut das System funktioniert

Getestet gegen eine breite Palette moderner Texterkennungsmodelle, einschließlich weitverbreiteter Modelle wie Faster R-CNN, DBNet++ und PSENet, erzielt FGRL-YiNet die besten Gesamtwerte auf YiPrint-694. Es erkennt Zeichen mit einem hohen F-Score von 94,7 %, angetrieben von sehr hoher Präzision (98,4 %) und starker Sensitivität (Recall 91,3 %), was bedeutet, dass es selten Hintergrund mit Text verwechselt und dennoch die meisten Zeichen auf der Seite findet. Ablationsstudien, bei denen einzelne Komponenten entfernt werden, zeigen, dass jede Innovation — dynamische Faltung, adaptive Multi-Scale-Fusion und differenzierbare Binarisierung — messbare Verbesserungen beiträgt und dass sie gemeinsam am besten wirken. Das Modell überträgt sich auch gut auf den größeren MTHv2-Datensatz historischer chinesischer buddhistischer Texte, wo es konkurrenzfähig mit führenden allgemeinen Detektoren ist und so sein breiteres Potenzial unterstreicht.

Was das für den Kulturerhalt bedeutet

Für Nicht-Spezialisten lautet die zentrale Botschaft, dass sorgfältiges, zielgerichtetes Design Computern helfen kann, einige der anspruchsvollsten Schriften der Welt zu lesen, selbst wenn nur begrenzte Trainingsdaten vorhanden sind. Durch die Kombination adaptiver Filter, intelligenter Multi-Scale-Fusion und integrierter Säuberung degradierter Seiten kann FGRL-YiNet zuverlässig einzelne Yi-Zeichen in dichten, beschädigten Manuskripten lokalisieren. Das erleichtert den Aufbau durchsuchbarer digitaler Archive, unterstützt linguistische und historische Forschung und hilft, die schriftlichen Aufzeichnungen des Yi-Volkes zu sichern. Die Autoren sehen ihre Architektur und ihren Datensatz als Blaupause für die Bewältigung anderer unterversorgter Schriften weltweit und zeigen, dass Fortschritte in der künstlichen Intelligenz eine direkte Rolle beim Erhalt fragiler Kulturerbestücke für kommende Generationen spielen können.

Zitation: Sun, H., Ding, X., Yu, H. et al. Fine grained representation learning for low resource Yi script detection and dataset construction. npj Herit. Sci. 14, 183 (2026). https://doi.org/10.1038/s40494-026-02418-6

Schlüsselwörter: Yi-Schrift, historische Manuskripte, Texterkennung, digitales Kulturerbe, Deep Learning