Clear Sky Science · zh

使用大型语言模型在成瘾护理临床记录中检测污名化语言

你的病历用词为何重要

随着越来越多的患者可以在线查看自己的病历,临床医生的用语不再隐匿于医院系统之中——它会被诊断对象本人看到。对于有成瘾问题的患者,一句诸如“吸毒者”之类的表述可能悄然加深羞耻感、破坏信任,甚至影响其获得的医疗照护。本研究提出了一个及时的问题:现代人工智能能否帮助医院在伤害患者之前,识别并减少临床记录中的污名化语言?

隐匿在日常记录中的有害标签

医疗护理中的污名不仅体现在目光或语气上,也深深镶嵌于书面记录中。电子健康记录包含数以百万计的病历,这些记录伴随患者在各个门诊与医院之间流转。诸如“酗酒”或“寻药行为”等术语,可能在急诊或住院之后很长时间内影响后续医务人员对某人的看法。研究者聚焦于涉及物质使用问题的重症监护病房记录——在这里,利害关系高且记录密集。他们以国家层面的指南为出发点,这些指南倡导尊重的以人为本的用语,如使用“患有物质使用障碍的人”而非“瘾君子”,并基于这些理念创建了一个大型的标注数据集,将病历标记为污名化或非污名化。

教AI懂得察言观色

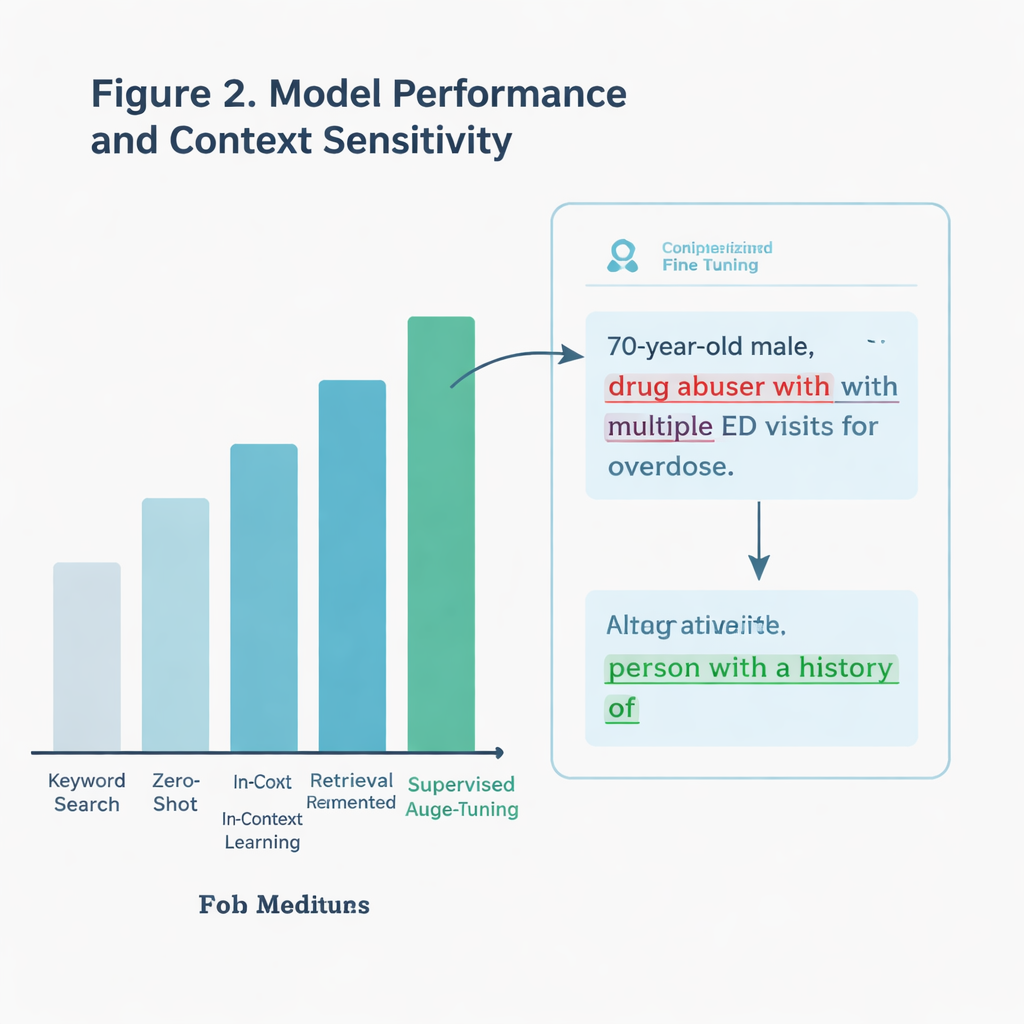

团队并不满足于简单地搜索“敏感词”,而是希望构建能理解上下文的AI系统。例如,记录中可能引用患者自述“我喝醉了”的话,这与临床医生将该标签强加于患者不同。作者比较了几种方法,这些方法都基于大型语言模型(一类用于处理和生成文本的人工智能)。一种基础方法仅根据指南中列出的关键词进行匹配。更先进的方法则直接让AI对每条记录做出判断:可以在没有额外示例的情况下判断、在附加沟通指南提示的情况下判断,或在经过数千条已标注ICU记录“微调”训练后进行判断。

在真实世界中哪种方法表现最好

经过微调的模型表现最为出色。在一个包含1.1万多条病历的留出测试集上,它约97%的时间能正确识别污名化语言,远优于简单的关键词搜索。它在一组尤其棘手的记录上也表现更稳健,这些记录包含可能带有情绪色彩的术语但并不总是以有害方式使用。该模型能够区分真正带有评判意味的短语与中性或引用性的用法,而粗糙的搜索方法会失败。当研究团队将系统应用于另一个医疗体系的记录——近30万条来自另一个州的ICU病历——它仍然优于关键词方法,尽管在该真实样本中污名化语言本身较为罕见。

发现临床人员忽视的新问题短语

研究者进一步要求AI解释它为何标记某些记录。一位成瘾专家随后审查了这些解释。在数十个案例中,模型指出了人类标注者最初忽略的真正污名性用语,其中包括现有指南中未列出的短语。示例包括“寻药行为”的描述或对“酒精性肝硬化”的随意提及,这类表述微妙地将责任归咎于个人而非疾病。这表明,设计良好的AI工具不仅可以执行现有的最佳实践,还可能随着临床写作的演变,帮助扩展我们对有害语言形态的认知。

从研究工具走向床旁助手

研究还权衡了实际问题。关键词搜索速度极快但深度有限。最准确的AI模型需要在强劲的图形处理器上训练数小时,但一旦训练完成,每条记录的筛查只需几秒钟——对搜索引擎来说偏慢,但对于在医院系统中作为后台助手来说是可以接受的。另一种较少定制的方法仅依赖精心设计的提示语,在无需额外训练的情况下也能取得相当不错的效果,这为技术资源较少的诊所提供了更轻量的选项。总体来看,这些发现指向可以实时标记风险措辞并在临床医生输入时建议更为尊重的替代表达的系统。

迈向更尊重的照护

对普通读者而言,主要结论很简单:病历中的用词不仅仅是技术术语;它们会影响你所受到的对待。该研究表明,大型语言模型能够可靠地识别重症监护病历中与成瘾相关的多种污名化语言,即便问题较为微妙。虽然没有系统是完美的,但此类工具可以作为始终运行的编辑器,推动临床人员采用将人视为超越其诊断的用语。从长远来看,这种从指责到尊重的转变,可能对康复的重要性不亚于任何药物或设备。

引用: Sethi, R., Caskey, J., Gao, Y. et al. Detecting stigmatizing language in clinical notes with large language models for addiction care. npj Health Syst. 3, 15 (2026). https://doi.org/10.1038/s44401-026-00069-0

关键词: 成瘾污名, 临床记录, 大型语言模型, 电子健康记录, 以人为本的语言