Clear Sky Science · zh

用于神经 PDE 求解器和算子学习中基于残差的自适应性的变分框架

更聪明的 AI,攻克难题方程

当今许多科学突破——从气候建模到新材料设计——都依赖于求解描述流体流动、波动传播或化学前沿运动等复杂方程。神经网络近来成为解决这些方程的有力工具,但在物理表现复杂时它们往往难以胜任:尖锐激波、微小结构和长期预测常导致模型失效。本文提出了一种系统化的方法,使这些 AI 求解器将精力集中到最困难的区域,从而同时提高速度与精度。

为何神经网络需要引导

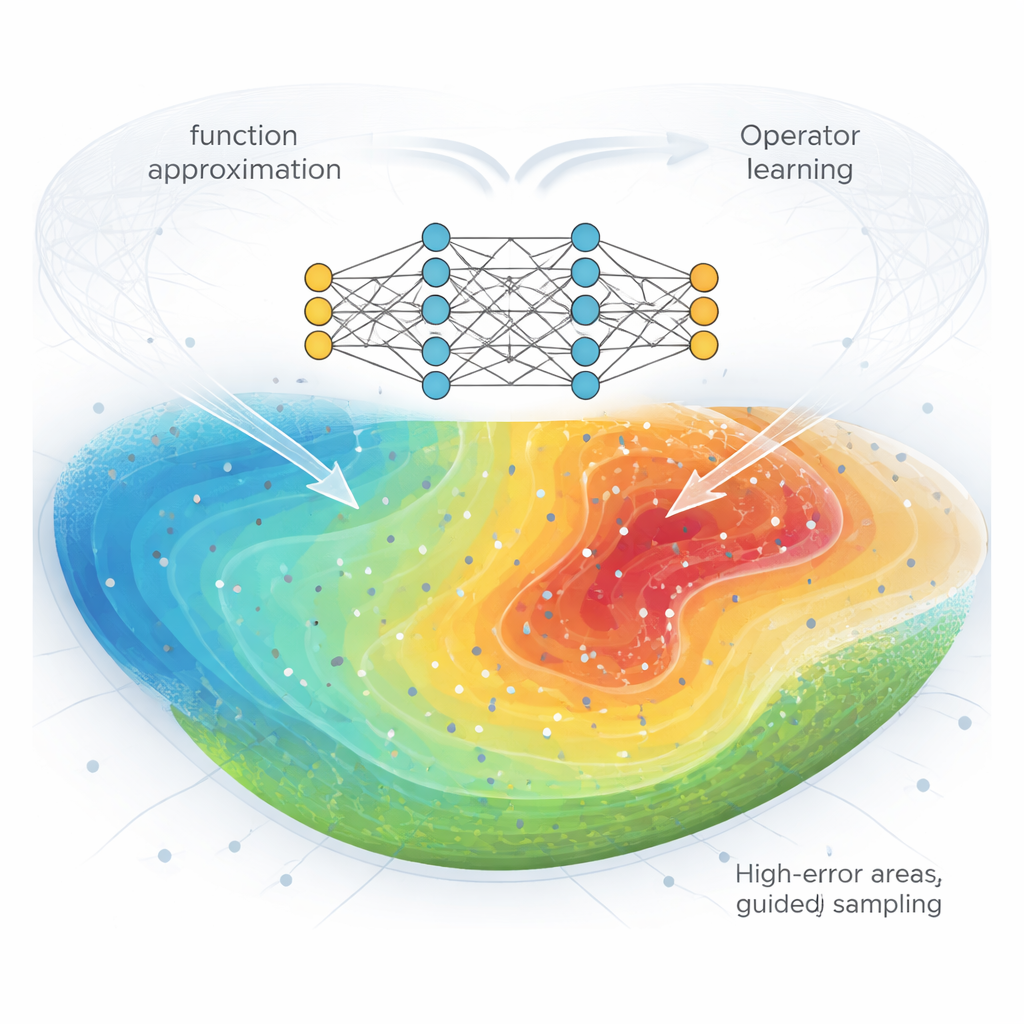

在科学机器学习中,神经网络要么被训练成再现单个方程的解(如物理信息神经网络,PINNs),要么学习从输入到解的整体映射(称为算子学习)。在这两种情况下,网络的表现都由“残差”来评判——即它在空间-时间各点上违背基方程的程度。标准训练把所有点一视同仁,最小化平均误差。这对简单问题有效,但对于具有陡峭梯度、移动波前或局部结构的方程,低平均误差可能掩盖在关键区域的严重错误。研究者为此提出了将更多训练点放在残差大的位置的经验规则,但迄今这些规则多为启发式、缺乏严格依据。

自适应关注的统一方案

作者构建了一个变分框架,将这些启发式方法转化为有原则的处方。关键思想是把采样和加权视为关于应当重点关注哪种空间(以及训练样本)上的概率分布的选择。他们引入了一族“势函数”,将残差变换为新的目标函数。不同的势函数对应不同的优先级:指数势会驱动网络减少单点的极大误差,而二次势则强调降低整个域内误差的离散或方差。从数学上看,优化这些变换后的目标会自然地导致在当前残差大的区域更频繁地采样。所得方法称为变分残差注意(vRBA),它涵盖了许多现有的自适应方案,并为设计新方案提供了清晰路径。

扩展到学习完整物理映射

现代 AI 求解器越来越多地旨在学习不仅是单一解,而是整个算子:即从初始条件或外部驱动到完整时空场的映射。这是 DeepONet、傅里叶神经算子(FNO)和时序条件 U‑Net 等神经算子架构的目标。这里的挑战加倍:不同输入函数之间存在差异,同时每个样本在空间和时间上也有变化。作者通过结合两层自适应把他们的框架扩展到这种乘积情形。首先,他们在每个样本内对空间点重新加权,使残差高的区域更重要。其次,他们利用累积残差优先重采样那些最难学习的整个训练样本。这种混合方案可以直接插入流行的算子学习模型中,而无需重新设计其架构。

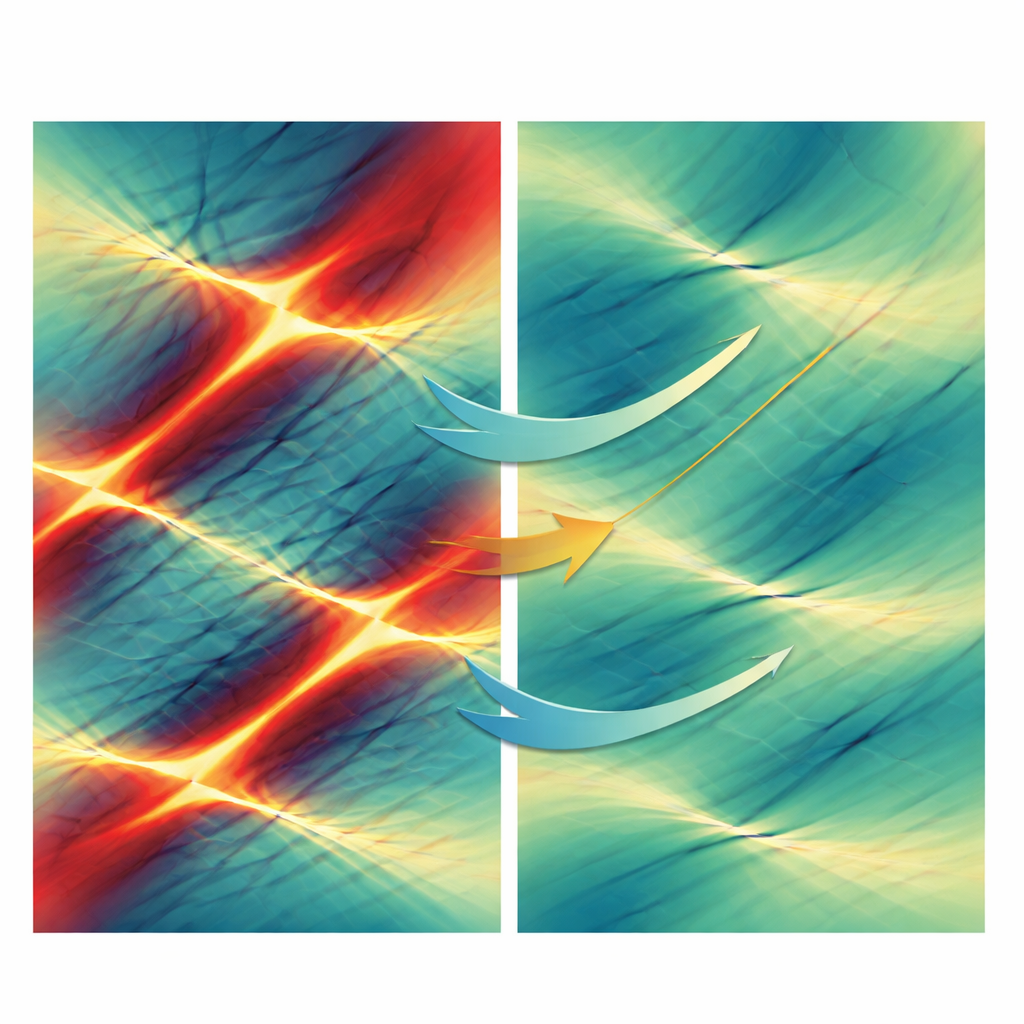

更清晰的细节、更慢的误差积累

在大量基准测试中,vRBA 方法始终优于传统训练。对于 PINNs,团队测试了经典的非线性方程,如 Allen–Cahn 方程、Burgers 方程和 Korteweg–De Vries 方程。其中一些问题因内部尖层或相互作用的波脉冲而常常击败标准 PINNs。采用 vRBA 后,相同的网络收敛更快并达到显著更低的误差;在基线方法基本失败的困难案例中,自适应方法能恢复出精确解。对于算子学习,他们将 vRBA 应用于液体中的气泡增长、高压冲击管流、二维湍流和波传播。在这些情形中,主要收益不仅是更好的最终误差,而是随时间误差累积明显变慢,这对将模型输出反复作为自身输入的应用至关重要。

净化学习信号中的噪声

作者将这些改进归因于两个主要效应。首先,通过改变训练点的采样或加权方式,vRBA 降低了估计损失时的统计噪声:随机小批量点能更可靠地反映网络整体表现。这直接减少了离散化误差,即连续理想目标与实际使用有限点集之间的差距。其次,该方法改善了驱动学习的梯度的信噪比,使域内不同区域对参数应朝哪个方向移动达成更一致的“意见”。因此,网络能够更早摆脱训练中缓慢、犹豫不决的阶段,进入误差快速下降的阶段。该框架还澄清了何时激进策略——强烈惩罚最大残差——会有益,何时可能使训练不稳定。

对未来科学 AI 的意义

对非专家而言,结论是:更聪明地关注 AI 求解器出错的位置,可以使其成为更值得信赖的科学与工程工具。该工作不是依赖反复试验的经验规则,而是提供了一个指导神经网络朝问题中最有信息量部分(无论是冲击前沿、细微振荡还是长期行为)移动的数学蓝图。随着科学模型规模增大并被用于安全关键场景,这类基于原则的误差减少与学习稳定化策略将是把强大神经网络转变为可靠科学仪器的关键。

引用: Toscano, J.D., Chen, D.T., Ooomen, V. et al. A variational framework for residual-based adaptivity in neural PDE solvers and operator learning. npj Artif. Intell. 2, 32 (2026). https://doi.org/10.1038/s44387-026-00084-4

关键词: 物理信息神经网络, 算子学习, 自适应采样, 科学机器学习, 偏微分方程