Clear Sky Science · zh

对大型语言模型估计不确定性的评估

为什么关于风险的模糊词很重要

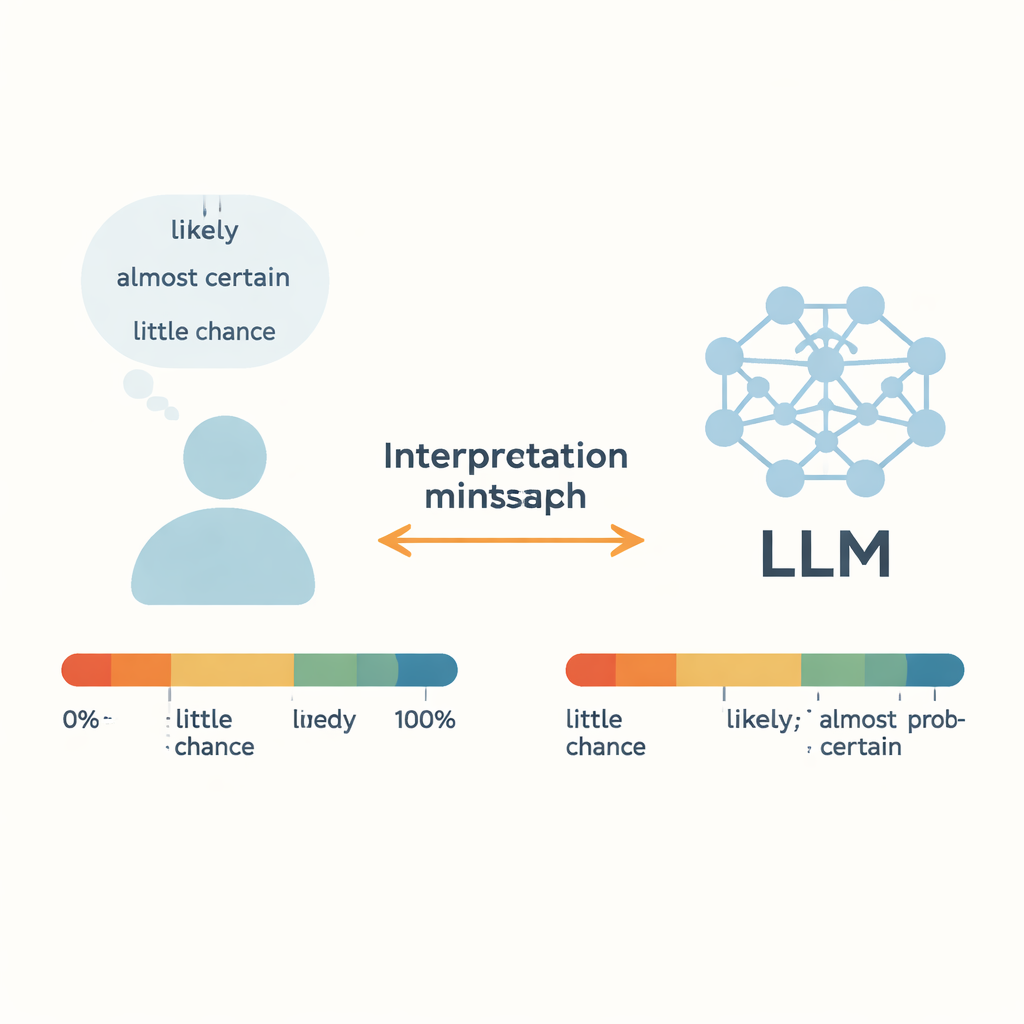

当医生说一种治疗“很可能”有效,或气象预报员警告飓风“几乎没有可能”,我们依赖这些模糊词来做出实际决策。如今,诸如在线聊天机器人之类的大型语言模型(LLM)也开始使用相同的词汇。这项研究提出了一个简单但关键的问题:当人工智能说“可能”时,它的意思与我们相同吗——它能否可靠地把原始数字转化为日常的不确定性用语?

把日常不确定性放到显微镜下

作者关注“估计概率的词语”(WEPs)——像“几乎确定”、“很可能”和“几率很小”这样人们用来代替精确百分比的术语。早期工作可以追溯到20世纪60年代的情报分析人员,通过调查试图把这些词与数值概率联系起来。本研究将这些人的判断与五种现代LLM的输出进行了比较,包括GPT-3.5、GPT-4、Meta的Llama模型,以及一个名为ERNIE-4.0的中文系统。针对17个常见的不确定性词语,每个模型以英文或中文接收简短的故事式提示,并被要求以0到100%的数值概率作答。通过在许多语境中重复这一过程,作者为每个词和每个模型构建了完整的概率分布,然后将其与人类调查数据进行了比较。

人类与人工智能在何处说相同的语言

对于最强烈的表达——例如高端的“几乎确定”和低端的“几乎不可能”——LLM与人类意外地非常一致。人类和模型都倾向于把这些短语聚集在狭窄的高概率或低概率区间内,这表明这些强烈词语在不同语境中具有相对稳定的含义。“大约对半”的情况也是如此,大多数人和模型都把它视为大约50/50的概率。统计检验显示,在这些特定词语上,人类分布与模型分布之间没有显著差异,这意味着LLM可以以类人精度把握近乎确定或近乎不可能的清晰情况。

含义悄然分歧的地方

模糊的、中间态的词语讲述了不同的故事。对于像“很可能”、“可能”、“我们怀疑”和“几率很小”等表达,模型的数值解释与人类判断存在显著差异。尽管GPT-4总体上比GPT-3.5更强,但它在这些词上经常表现出更大的差距。作者认为,这可能是因为此类词汇混合了两层含义:概率感和说话者的态度或立场。在真实对话中,“很可能”可根据语气和语境显得谨慎或自信,而“我们怀疑”可能表达怀疑态度而非精确概率。LLM在互联网上大量、混合体裁文本上训练,可能对许多冲突用法取平均,模糊了这些微妙差别。结果是一个隐含的不匹配:人类和人工智能可能对相同句子附上不同的数值。

性别、语言和文化的回响

研究人员还测试了性别措辞和不同语言如何影响这些概率词。当提示提到“他”或“她”而不是中性主语时,GPT-3.5和GPT-4经常给出更不变、更加“锁定”的概率估计,有时甚至塌缩为单一点值。这表明模型可能从训练数据中的刻板印象吸收了僵化模式,尽管总体上男性和女性提示的平均值相似。比较英文和中文提示时,GPT模型在解释相同不确定性词语时显示出明显移动。主要在中文文本上训练的ERNIE-4.0在许多词上更接近中文使用者,但仍有高估或低估某些短语的情况。这些发现强调,人工智能谈论不确定性的方式不仅取决于所选词语,还取决于其训练中嵌入的语言和文化模式。

人工智能能把数字转成通俗的疑虑吗?

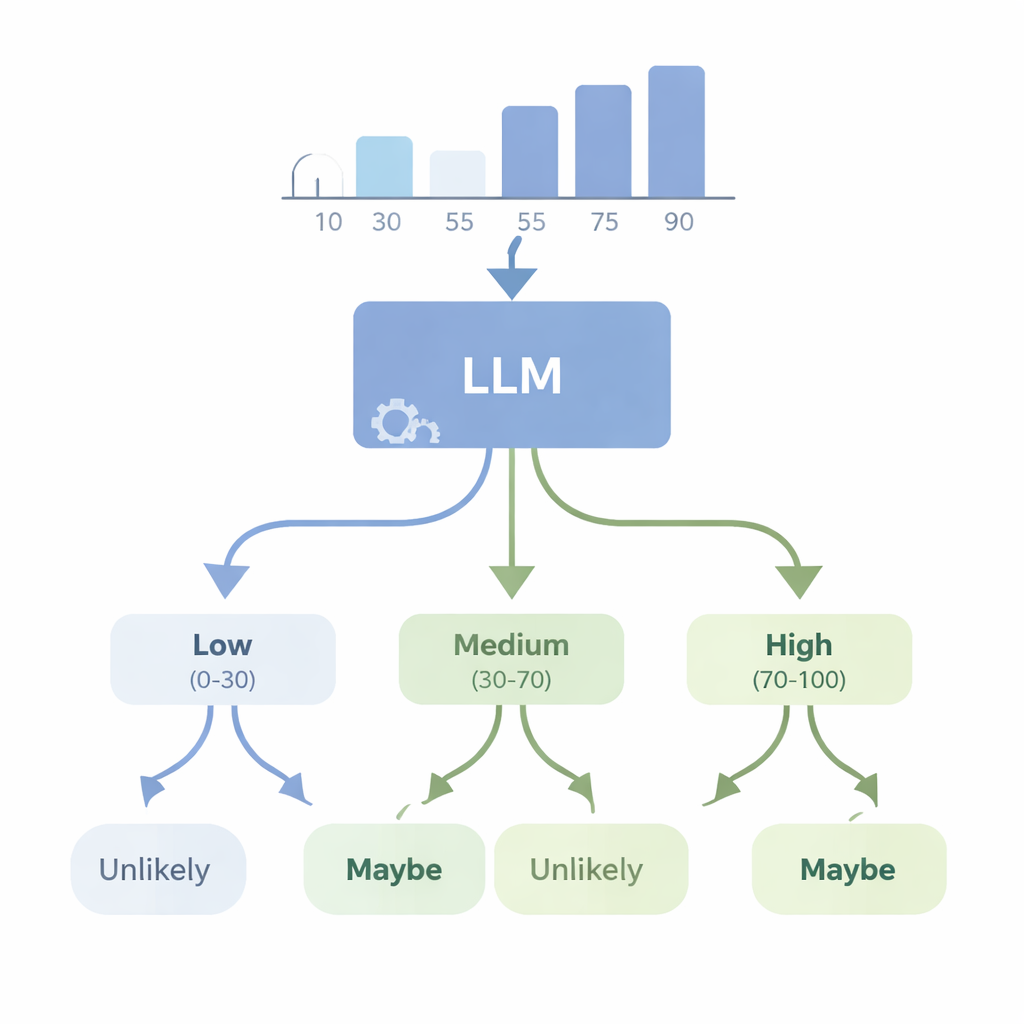

在第二组实验中,作者考察了相反的问题:像GPT-4这样的先进模型能否从数值数据出发,选择合适的不确定性词?他们向模型输入简单数据集——例如身高或考试成绩列表——并要求它为关于未来结果的陈述挑选最合适的WEP(例如“几乎肯定”、“很可能”、“也许”、“不太可能”或“几乎不可能”)。随后他们用四个新的“连贯性”评分评估GPT-4,这些评分检查当概率上升或下降、描述互补事件时,以及在受控方式改变基础数字时,其用词是否合乎逻辑。GPT-4的表现远好于随机猜测,并且常能跟踪可能性的粗略变化,但在连贯性上远未完善。在一些测试中,它在不同置信水平下几乎相同的回应,这表明它有时将这些词视为宽泛标签,而不是与实际数据精细对应的刻度。

这对现实世界决策意味着什么

对读者而言,信息应是谨慎而非恐慌。LLM已经能够模仿我们最强烈的确定性与不可能性的表达,且常能将数据概括为合理的“很可能”或“不太可能”陈述。但本研究表明,对于许多日常不确定性词,其内部校准并不完全符合人类直觉,且从数字到语言的映射可能不一致。在医学、政策或科学传播等领域——在这些领域中我们措辞风险或置信的细微变化可能产生重大影响——模型的“可能”不一定与您的“可能”相同。作者主张,为了安全使用这些系统,我们必须把不确定性词当作一套需要仔细对齐、测试并可能用明确数字支持的共享代码本,而不是默认认为人类与机器的含义相同。

引用: Tang, Z., Shen, K. & Kejriwal, M. An evaluation of estimative uncertainty in large language models. npj Complex 3, 8 (2026). https://doi.org/10.1038/s44260-026-00070-6

关键词: 不确定性 语言, 大型语言模型, 概率 词语, 人机沟通, 风险 解释