Clear Sky Science · zh

对急性精神科护理中机器学习预测攻击性行为的公平性分析

这对真实的人为何重要

医院正求助于人工智能来识别哪些患者可能变得具有攻击性,希望在不诉诸创伤性约束的情况下预防伤害。但如果这些预测工具不公平,它们可能会加剧已经影响谁被视为“危险”的不平等。该研究提出了一个紧迫的问题:当机器帮助决定精神病房中谁是高风险时,它是否对所有患者一视同仁?

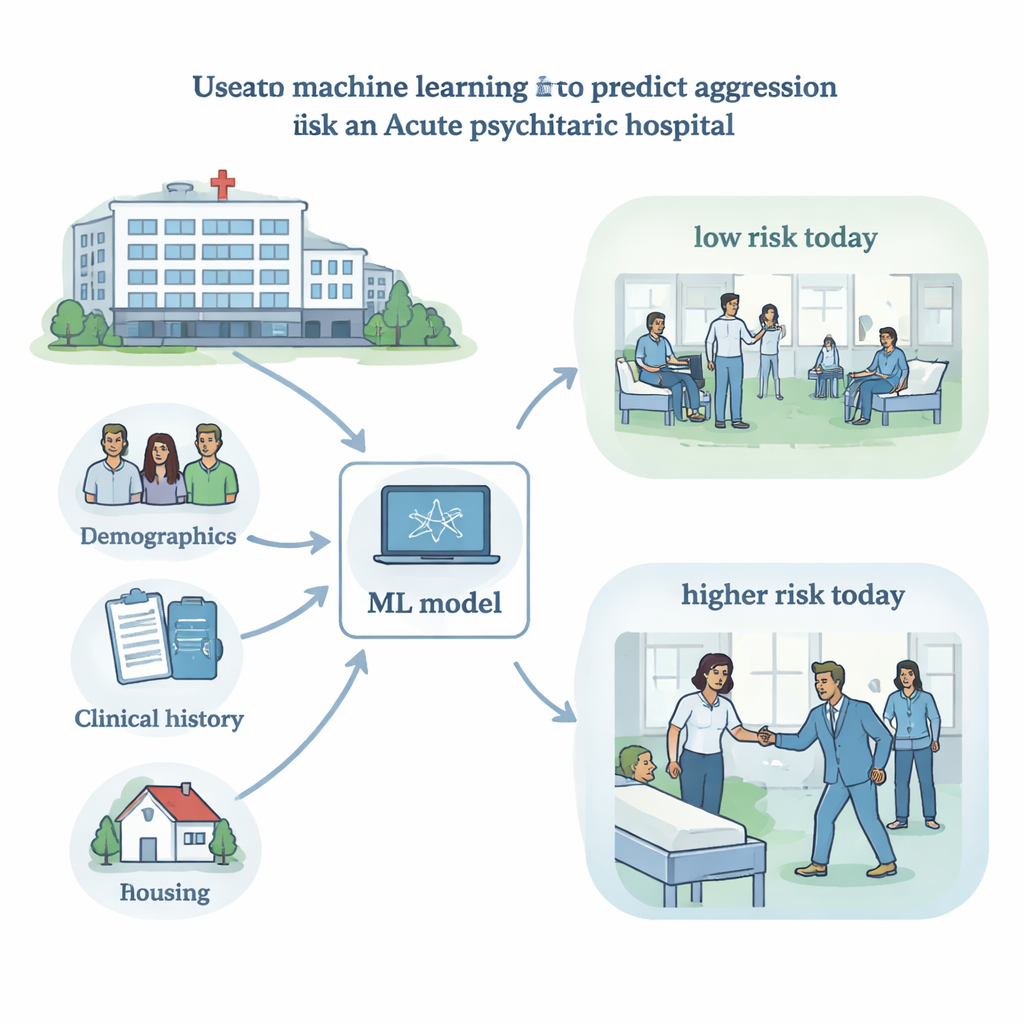

使用医院数据标记短期风险

研究人员分析了2016至2022年间一家大型加拿大精神卫生医院在急性精神病病房治疗的超过17,000名患者的记录。在住院期间的最多三天内,工作人员每天记录一份标准床边清单——情境攻击性动态评估(DASA),该量表评估诸如易怒或言语威胁等可能预示即将发生攻击的行为。研究团队将这些评分与入院时收集的信息(如诊断、年龄、性别、种族或族裔、住房状况以及来院方式)结合起来,训练了一个机器学习模型,以预测患者在接下来的24小时内是否会牵涉到攻击性事件(包括使用约束或隔离)。

预测工具的总体表现如何

表现最好的系统使用了一种流行的机器学习方法——随机森林。在保留的测试数据上,它在较大程度上能正确区分高风险日子的排序,取得了约0.81的曲线下面积(AUC),与精神病学中类似工具相当。然而,攻击性事件很少见——每发生一天事件大约有33天没有事件——因此模型仍错过了许多真实事件并产生了一些误报。重要性度量显示,瞬时的临床因素,尤其是DASA条目如易怒和近期既往事件,对预测的贡献最大,而不仅仅是人口统计学因素。这意味着模型捕捉到了有临床意义的预警信号,但仅凭性能指标无法揭示它是否对所有人同样可靠。

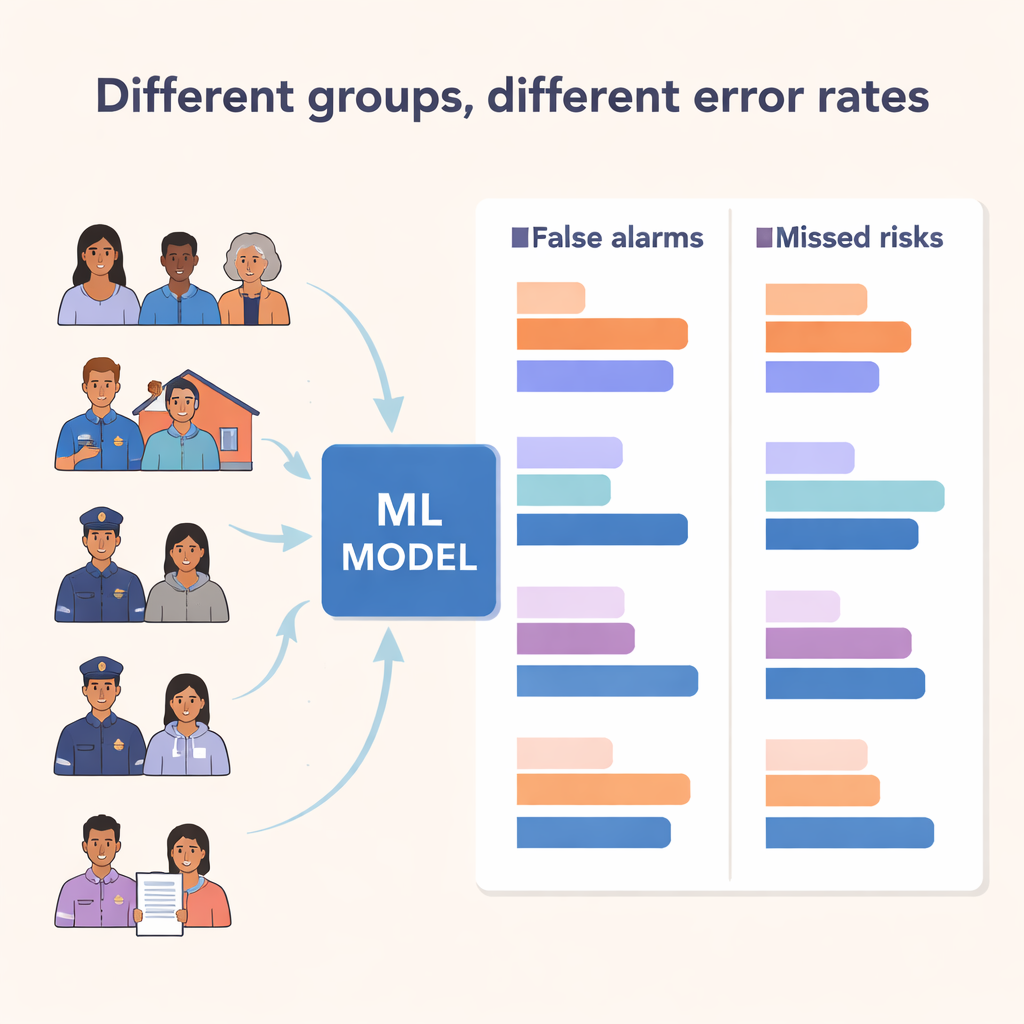

不同群体之间的错误率不均等

研究的核心是公平性检验。团队关注两类错误:假阳性——模型标记为有风险但并未发生事件;以及真阳性——模型正确预测了事件。按一种常用标准“等化机会”(equalized odds),公平的模型应在各群体间具有类似的假阳性率和真阳性率。相反,研究人员发现了较大差异。中东和黑人患者、男性、被警察带来医院的人以及无家可归或居住在支援性住房者的假阳性率更高。一些群体——例如被警察带来或住房不稳定者——既有更高的检测率也有更高的误报,表明模型对这些人群被调得更加敏感。其他群体,如黑人患者,面临令人担忧的组合:更多的误报以及较差的正确识别真实风险的能力。

当身份交叉时,差距加大

由于人们的经历由多种特征共同塑造,研究人员还考察了重叠身份,特别是种族或族裔与性别的组合。在此情形中,最大的警示出现在中东男性,他们拥有所有群体中最高的假阳性率,而中东女性则没有。黑人和原住民男性相比同族女性也面临更高的假阳性率。这些模式呼应了精神卫生护理中广为记录的不平等现象,例如某些有色群体和男性中更高的警务介入率、被强制入院率和误诊率。机器学习系统并未创造这些不平等,但它从浸透着这些不平等的数据中学习——并有可能在临床决策中放大它们。

这对未来精神病学中的人工智能意味着什么

作者主张,在任何预测工具投入实践之前,公平性分析必须被视为核心的安全检查,而非可选项。他们指出,技术性的“去偏”方法——例如调整训练数据或为不同群体设置不同警报阈值——可以提供帮助,但如果底层记录本身已反映出不平等对待和强制性做法,这些方法也有限。最终,决定何为“公平”模型不仅是一个数学问题;这是一个需要患者、临床医生和社区参与的社会与伦理问题。该研究表明,尽管机器学习可以帮助识别短期攻击风险,但若不对公平性进行严格测量、讨论并加以应对,它也可能在不声不响中复制结构性的种族主义、性别歧视和住房不平等。

引用: Wang, Y., Sikstrom, L., Xiao, R. et al. Fairness analysis of machine learning predictions of aggression in acute psychiatric care. npj Mental Health Res 5, 16 (2026). https://doi.org/10.1038/s44184-026-00194-6

关键词: 算法公平性, 精神科攻击性, 医疗中的机器学习, 健康不平等, 风险预测模型