Clear Sky Science · zh

用 AI 架起多模态桥梁:多模态生物医学成像中的人工智能进展综述

看得比眼见更多

现代医学在很大程度上依赖图像——从 X 光片与磁共振成像(MRI)到组织的显微镜切片——以理解体内发生的情况。本综述解释了人工智能(AI)如何将多种不同类型的医学影像编织成一个更丰富的疾病图景。对于非专业读者来说,其吸引力显而易见:这些进展可能带来更早的癌症检测、更精确的诊断,以及针对个体而非平均患者的治疗方案。

为何一张图像已不够

每种成像技术只展示故事的一部分。放射学工具如 CT、MRI 和超声揭示器官的形态与结构,而核医学扫描例如 PET 则突出肿瘤的代谢活性。在显微镜下,病理学家观察细胞如何排列,光谱学方法则读出组织的化学指纹。光学方法如光学相干断层成像(OCT)可以放大眼睛或皮肤的微层结构。单独看时,这些“单视图”快照可能错过重要线索;但将它们结合起来,就能把肿瘤的外观、行为与驱动它的分子联系起来,为医生提供更完整的疾病理解。

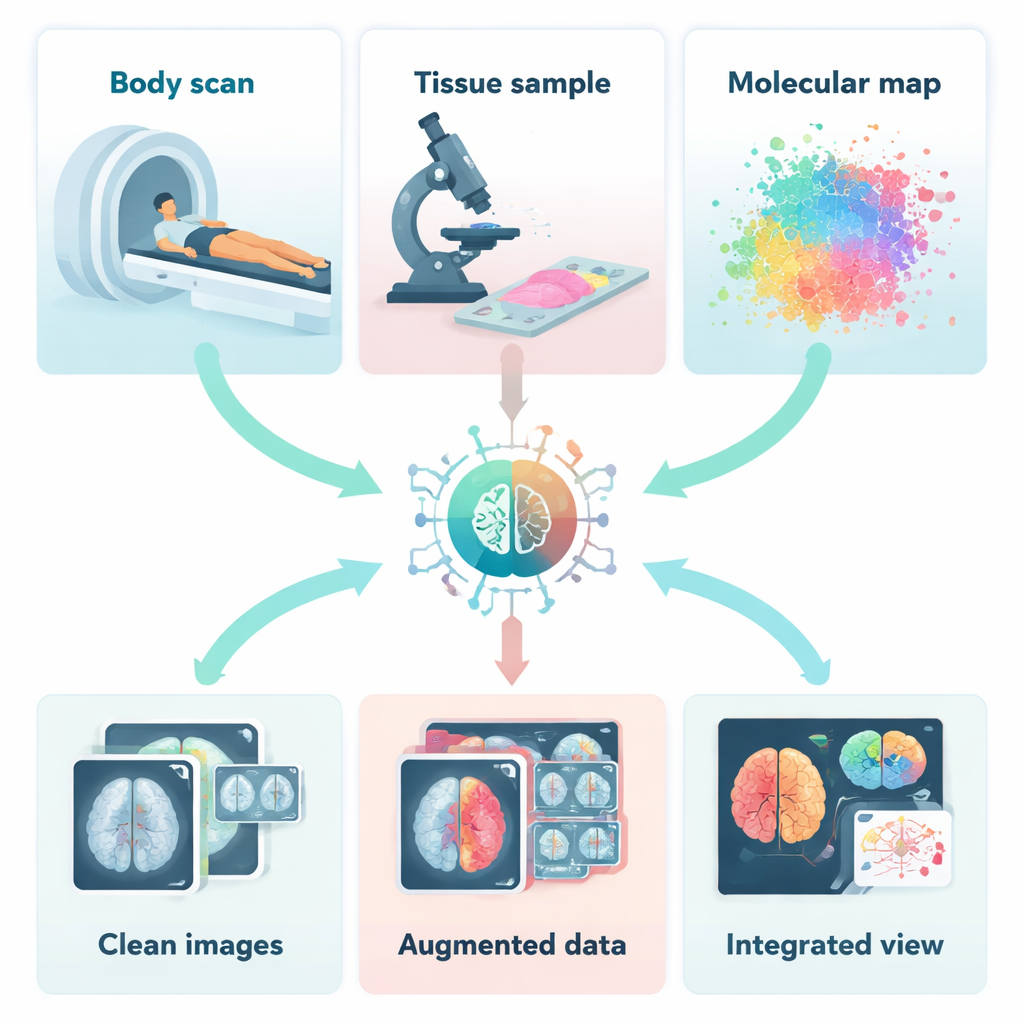

AI 如何清理并补充医学图像

在将不同图像合并之前,必须对它们进行清理、对齐,有时甚至从头生成。作者描述了 AI 如何帮助去除扫描中的噪声和运动模糊、从低剂量 CT 或 PET 图像中恢复细节,以及校正可能干扰医生和计算机判断的伪影。深度学习系统可以从示例中学习干净图像应有的样貌,然后按此恢复新扫描。其他 AI 模型生成逼真的合成图像,以“扩充”小型数据集或填补缺失的扫描类型。这对罕见疾病尤其重要,因为用于训练诊断工具的真实样本可能非常少。

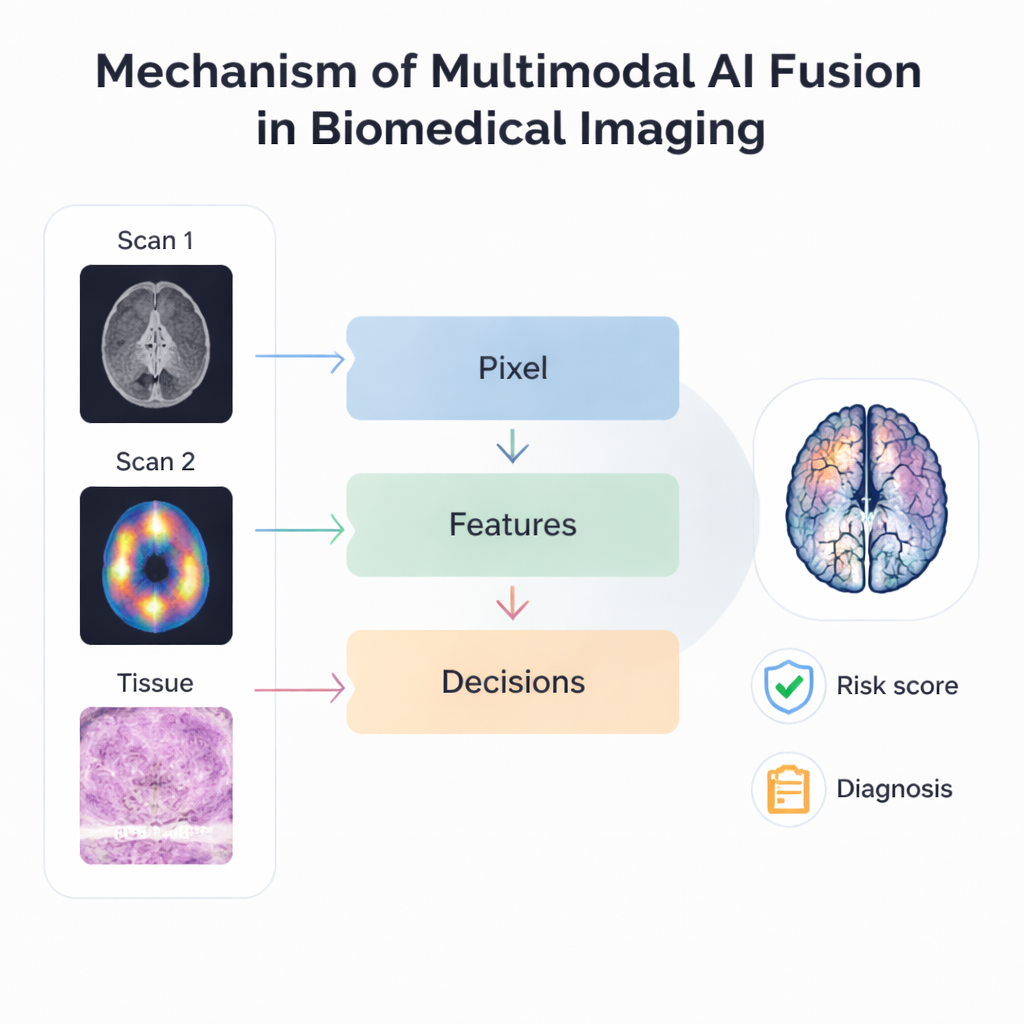

将不同视角融合为一个完整叙述

综述的核心在于 AI 如何实际融合多种成像来源。在最基础的层面上,基于像素的方法将 MRI 与 PET 等扫描叠加,使结构与功能在一张更清晰的图像中同时显现。更先进的方法则从每种模态中提取关键模式或“特征”,并融合这些特征而非原始图像,从而对分辨率和对齐差异更具鲁棒性。后期或“决策级”融合更进一层,让各自独立的 AI 模型分析不同图像,然后对它们的预测进行投票或平均。分层系统结合了多种思路,分阶段堆叠不同的融合步骤,以便在一个框架内处理从微小细胞细节到器官范围变化的所有信息。

从更好的图像到更好的护理

这些融合技术已经在许多临床场景中进行尝试。多序列 MRI 的结合可改善脑肿瘤分割;乳腺X线摄影、超声与 MRI 的联合可提高乳腺癌检测与风险预测。将数字病理切片与放射影像联系起来,有助于在无需额外检测的情况下预测肿瘤基因特征与患者生存率。AI 还支持“数据驱动影像学”,即将扫描中微妙的模式与基因表达或患者结局相关联,带来更准确的预后评估和更优的治疗选择。新的基础模型与多模态大型语言模型旨在跨任务与成像类型泛化,甚至将图像与书面临床记录连接起来,朝着能够适应多种疾病和不同医院的通用工具迈进。

信任、公平与前路

尽管前景令人振奋,作者强调仍存在重要挑战。医学图像在不同医院、设备和患者群体之间差异很大,如果不加以谨慎处理,可能使 AI 变得脆弱或产生偏见。许多强大模型像黑盒一样运作,使临床医生难以理解某一决策的原因。综述讨论了突出哪些图像区域对预测影响最大、以及设计更公平、更透明系统的努力;还指出了关于隐私、数据共享和大模型高计算需求的伦理问题。展望未来,作者设想专门的 AI “代理”持续监测成像、可穿戴传感器与健康记录,实时协助临床医生并帮助协调长期护理。对患者而言,关键在于:在负责任地开发与部署这些技术的前提下,将多种医学图像与 AI 结合,可能带来更快的答案、更个性化的治疗,并最终改善治疗效果。

引用: Doan, L.M.T., Shahhosseini, K., Verma, S. et al. Bridging modalities with AI: a review of AI advances in multimodal biomedical imaging. Commun Eng 5, 30 (2026). https://doi.org/10.1038/s44172-026-00602-x

关键词: 多模态生物医学成像, 医学人工智能, 图像融合, 放射学与病理学, 精准医学