Clear Sky Science · zh

用于跨模态乳腺癌理解的解剖引导视觉提示调优

为常见癌症提供更智能的筛查

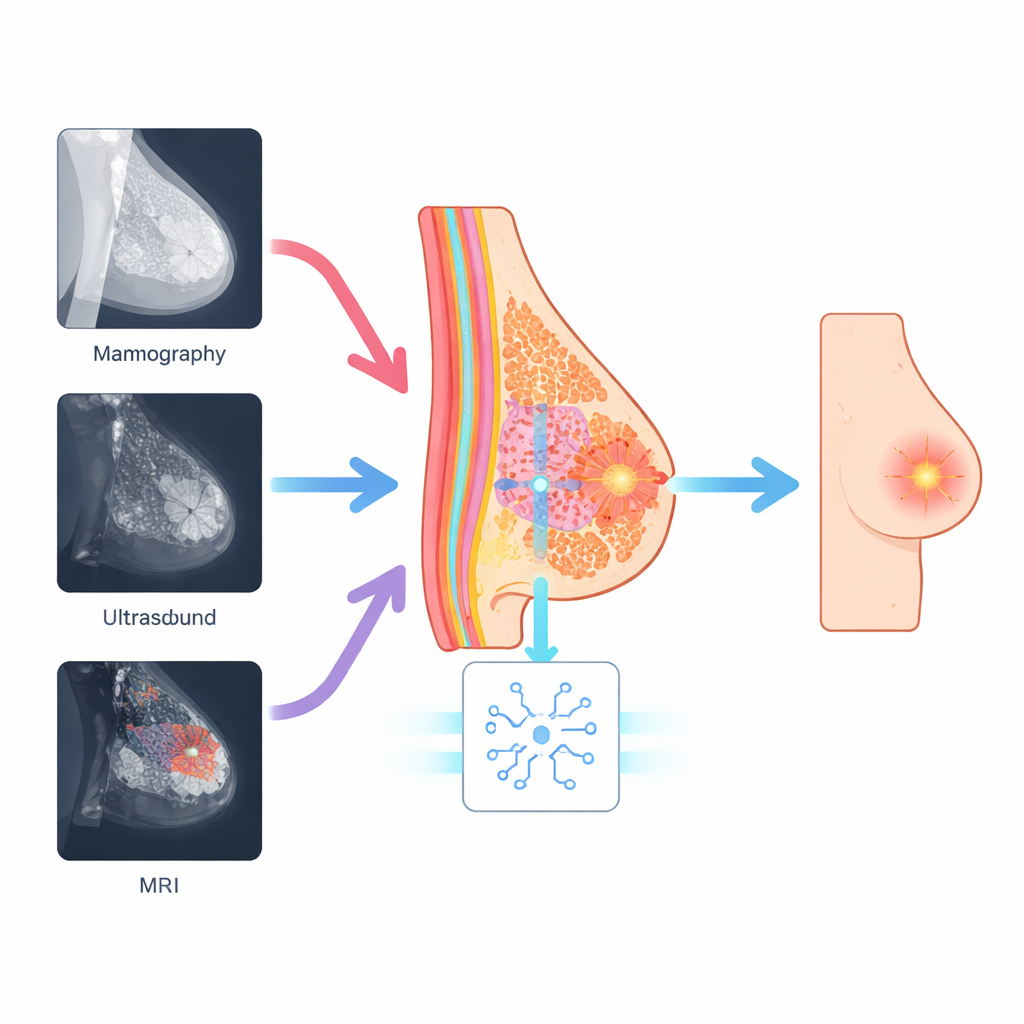

乳腺癌是女性癌症死亡的主要原因之一,医生越来越依赖计算机程序来辅助解读复杂的医学影像。但乳腺X线钼靶、超声和磁共振成像以截然不同的方式呈现乳腺,这使得现有人工智能系统在不同设备和医院之间保持可靠性变得困难。本研究提出了一种新的人工智能方法,它更多地“考虑”乳腺的解剖结构,而不仅仅依赖每幅图像的亮度模式,从而实现对可疑区域更准确、更一致的检测。

为什么不同的扫描会让计算机困惑

钼靶摄影、超声和MRI各自基于不同的物理原理来观察乳腺。在超声图像上看似明亮的斑点,可能在钼靶上表现为微弱的阴影,或在MRI上呈现为发光的斑块。许多现代AI系统,包括强大的视觉变换器和视觉—语言模型,主要从整体图像外观中学习。它们常常漏掉微钙化点或不规则边界等微小但重要的细节,而且当从一种扫描仪或医院迁移到另一种环境时,性能可能急剧下降。训练条件与真实临床环境之间的这种差距限制了医生对这些工具的信任。

以乳腺自身作为引导

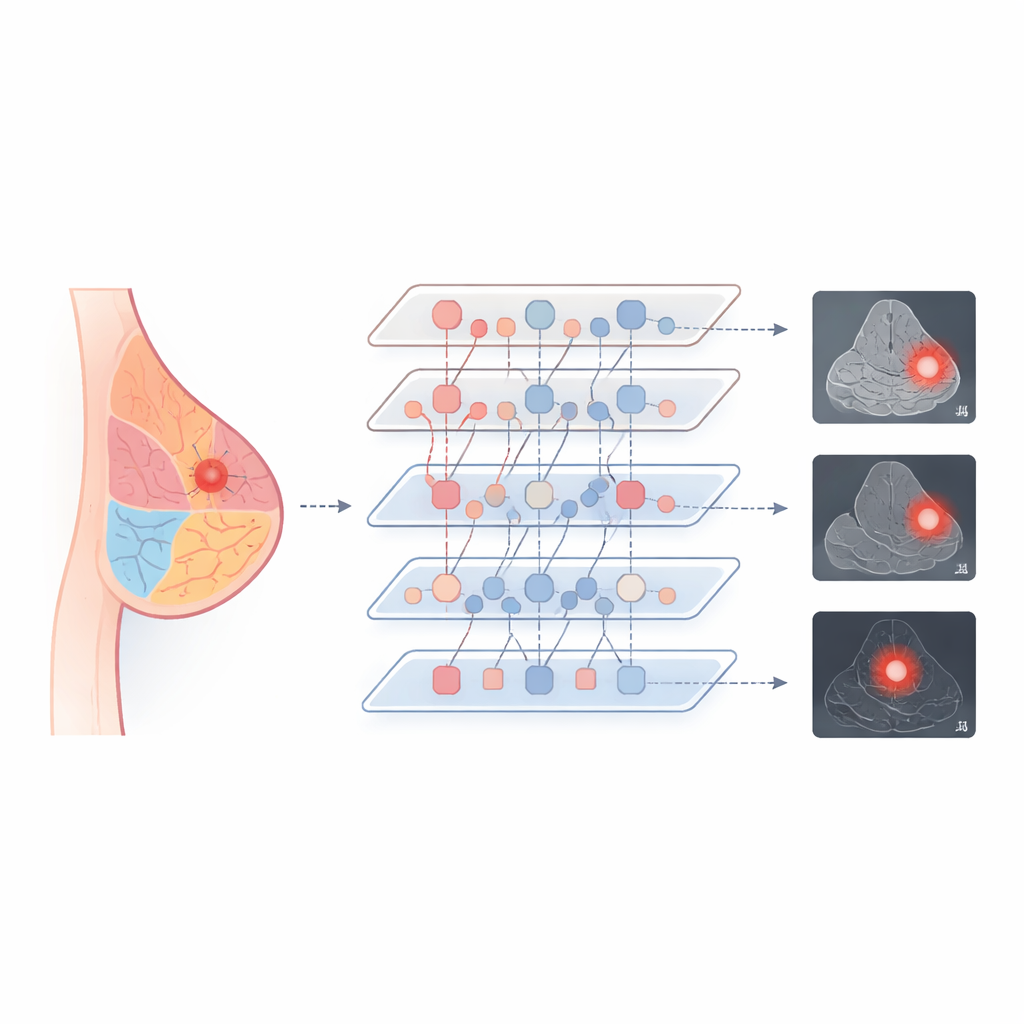

研究人员认为,尽管图像外观不同,但乳腺的实际生物学特征在不同扫描之间并不改变。每幅图像中仍包含以可识别模式排列的腺体组织、脂肪和导管结构。他们的方法称为解剖引导视觉提示调优(Anatomy-Guided Visual Prompt Tuning,A-VPT),将这种基础的乳腺地图直接构建到AI模型中。系统不是调整数百万个内部权重,而是添加一小组额外的“提示”信号,告诉网络当前查看的是哪些组织区域。这些提示由粗略的解剖地图或学到的组织线索生成,并逐层注入到被冻结的预训练变换器中。实际上,模型不断被提醒导管、腺体和脂肪的位置,从而能够在正确的上下文中评估可疑区域。

教同一系统掌握多种影像“语言”

为使模型在多种影像类型上工作,团队设计了一种训练方案,迫使AI无论以何种方式扫描都对相似组织做出相似的处理。他们将从钼靶、超声和MRI中提取的脂肪、腺体和导管区域的内部特征对齐,使它们在一个共享空间中相互靠拢。当存在文本报告时,系统还将这些组织模式与简短的描述性短语关联起来,将视觉特征与医学语言绑定。在处理过程中,专门的交互模块允许解剖提示与图像特征双向交换信息,并通过门控步骤控制每一层中解剖信息的影响强度。这种组合帮助模型聚焦于正确的结构,同时保持稳定和高效。

更轻量却更高的准确性

作者在三个涵盖全部三种模态的知名乳腺影像数据库上测试了A-VPT。与传统深度网络和几种流行的大模型微调方法相比,他们的方法在将病变分类为良性或恶性以及勾画病变边界的评估中都取得了最高分。尤其在将一种扫描类型的知识用于解释另一种扫描类型(例如在钼靶上训练然后在超声上评估)时表现优异——这是旧方法常常失败的场景。值得注意的是,A-VPT在取得这些结果的同时仅更新了不到2%的模型参数,这降低了计算需求并使其更容易在真实医院中部署。模型“关注”位置的可视化显示它集中在现实的腺体和肿瘤周围区域,表明其决策与放射科医师的判断相一致。

这对患者和临床意味着什么

简言之,这项工作表明,让AI系统了解基础解剖结构可以使它们更聪明且更易解释。通过将推理锚定在乳腺的真实结构上,A-VPT在不同影像方法下更善于发现和勾画肿瘤,所需调整更少且行为更透明。如果进一步验证,这一策略可能在从大型医疗中心到小型诊所的多样化场景中支持更一致的筛查与诊断,并可扩展到肺、肝等其他器官。最终,具备解剖感知的AI有望成为更早且更可靠癌症检测的重要伙伴。

引用: Zhao, S., Meng, Q., He, Y. et al. Anatomy-guided visual prompt tuning for cross-modal breast cancer understanding. npj Digit. Med. 9, 240 (2026). https://doi.org/10.1038/s41746-026-02417-8

关键词: 乳腺癌影像, 医学人工智能, 视觉变换器, 跨模态学习, 解剖引导提示