Clear Sky Science · zh

大型语言模型与医疗专业人员在诊断与分诊中的独立与协同性能

这对你下一次就诊有何意义

当你在网上聊天机器人中输入症状或向某款 AI 应用询问可能的病因时,你正在使用与医院里医生测试的相同类型技术:大型语言模型(LLM)。本研究提出了一个简单但至关重要的问题:这些工具在诊断疾病和判断病情紧急程度方面,实际表现如何,与真实的医疗专业人员相比如何——以及当两者协同工作时会发生什么?

研究者如何做出宏观评估

作者没有在单一诊所测试某一聊天机器人。相反,他们综合了 2020 年至 2025 年间全球 50 项不同研究的证据。这些研究涵盖了许多专科,从眼科和脑部影像到急诊护理。每项研究中,医生和一个或多个 LLM 得到相同的真实病例或精心设计的病例描述。LLM 要提出可能的诊断或决定患者需要多快就医,医生也做出相同判断。在部分研究中,还向医生展示了 AI 的建议,以观察这是否能提升其表现。

AI 单独表现如何?

在所有研究中,AI 工具常常能够在其诊断列表中包含正确诊断,但在被要求只选择一个答案时,通常仍不如医生。当仅计算首选诊断时,LLM 平均比医疗专业人员准确率低约 11%。随着允许选项数量增加,这一差距缩小并最终消失——当允许列出十个可能诊断时,AI 系统至少与医生一样有可能将正确答案包含在内。对于分诊决策——判断病例紧急程度及所需护理层级——总体上 AI 与人类表现相似。然而,各个模型和测试设置间结果差异很大,这表明有些工具比其他工具更可靠。

医生把 AI 当作队友会怎样?

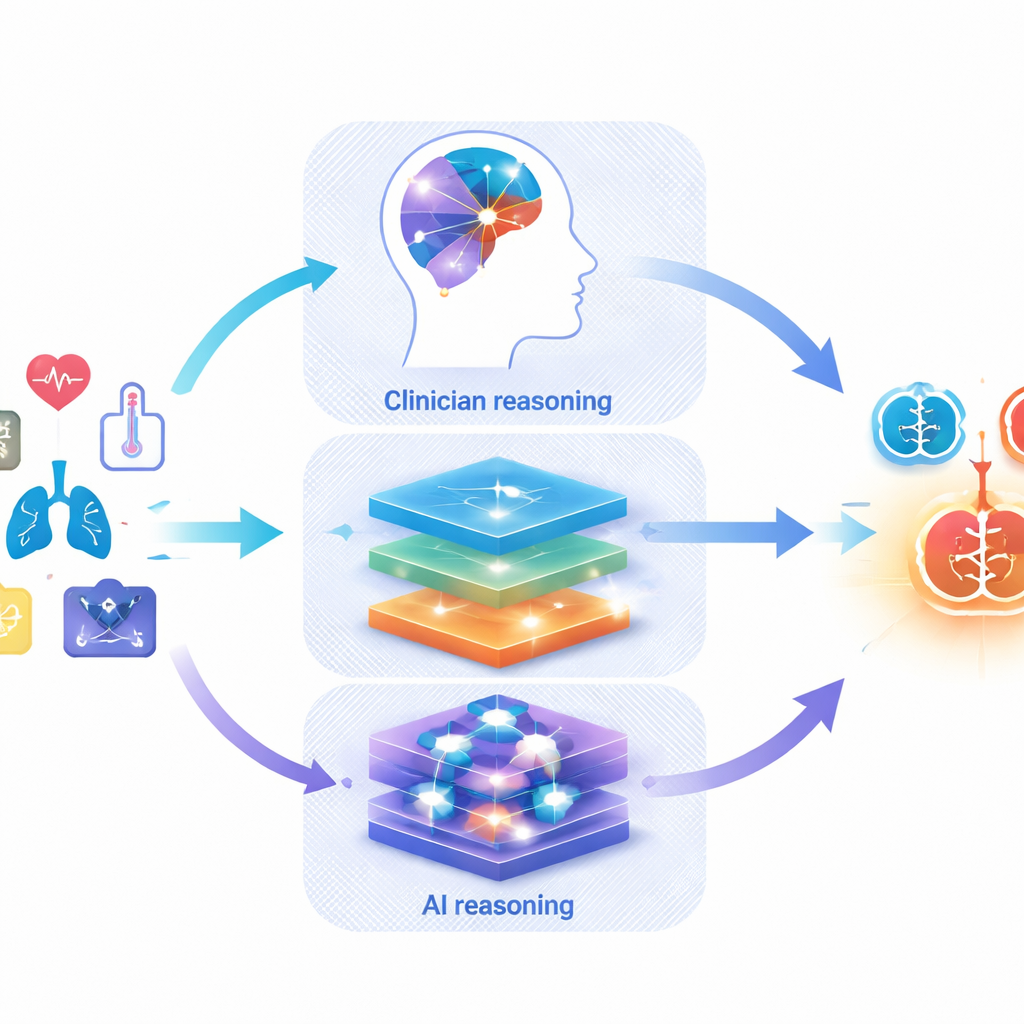

九项研究直接考察了协作情形:医生先独立完成任务,然后在 LLM 辅助下重复。这方面的结果令人鼓舞。在 AI 支持下,医生的总体准确率提高了,尤其是在允许给出多个可能诊断时。例如,在 LLM 辅助下,他们在较短候选诊断列表上的准确率提高了约 10%–40%,具体取决于考虑的选项数量。这表明 AI 作为头脑风暴的伙伴尤其有用,能扩大可能性范围并促使临床医生考虑一些不那么明显的疾病,而最终决定仍由人类专家做出。

为何当前结果可能比现实更乐观

尽管数据看起来令人鼓舞,作者警告说大多数现有研究还远非完美。许多研究依赖于整洁的教科书式病例摘要或为教学挑选的罕见病例,而非患者在真实门诊中呈现的混乱、不完整的病史。只有少数研究使用了实时患者。关于如何选择病例、如何配置 AI 工具以及如何评判答案的细节经常缺失。诸如影像或皮肤照片等视觉信息使用较少,当仅测试图像时,有经验的临床医生明显优于 AI。研究者还强调,初级与专家级临床人员对 AI 建议的反应可能不同,数据隐私、隐藏偏见以及对机器建议的过度信任等问题在日常实践中仍大多未被检验。

这对患者和医疗未来意味着什么

总体而言,研究表明当前的聊天机器人和 LLM 还不能取代你的医生,但它们可能很快成为有价值的助手。明智使用时,它们可以帮助生成更广泛的可能诊断名单并支持更准确的决策,尤其是在医生保持主导并将 AI 视为第二意见而非最终裁决时。然而,在将这些工具纳入常规护理之前,作者认为需要更好设计的真实世界试验、更清晰的报告标准,以及围绕安全、公平和隐私的强有力保障。对患者而言,这意味着 AI 终有可能帮助你的医疗团队更全面地思考并更快速地行动,但任何值得信赖的系统都必须像新药或医疗器械一样经过严格测试。

引用: Chen, M., Wu, Y., Ma, J. et al. Independent and collaborative performance of large language models and healthcare professionals in diagnosis and triage. npj Digit. Med. 9, 222 (2026). https://doi.org/10.1038/s41746-026-02409-8

关键词: 医疗诊断 人工智能, 临床分诊, 大型语言模型, 医生 与 AI 协作, 数字健康 安全性