Clear Sky Science · zh

人类与大型语言模型在临床医学中的协作:系统综述与荟萃分析

这对日常医疗为何重要

医生越来越多地求助于被称为大型语言模型的强大AI聊天机器人,以帮助他们分析复杂病例、撰写病历并解读医学检查。本研究提出了一个简单但关键的问题:当医生与这些工具合作时,患者究竟能否从中受益?通过汇总来自最佳可得试验的结果,作者表明答案比宣传更为复杂——有时这种协作有益,有时作用有限,少数情况下甚至可能成为阻碍。

研究者考察了什么

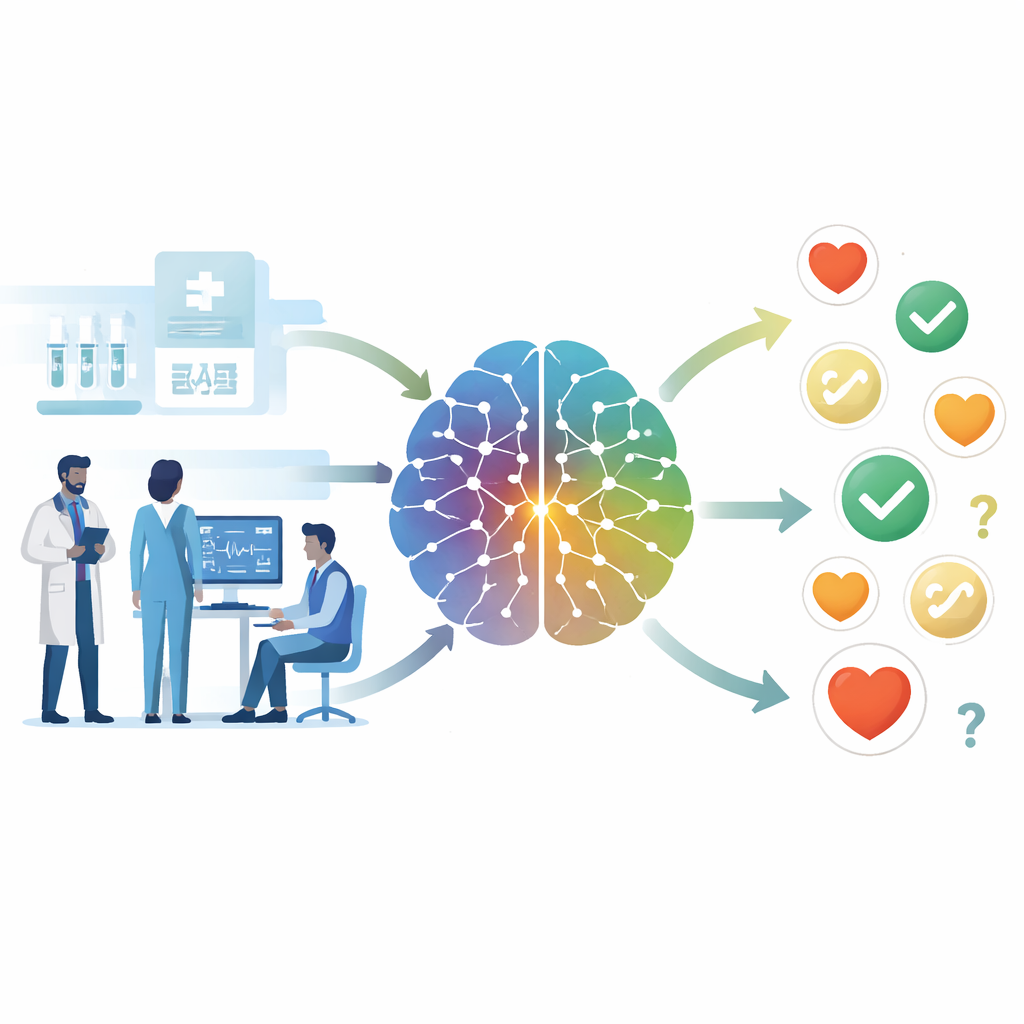

研究团队系统检索了主要医学数据库中那些记录临床医生在有或没有基于大型语言模型(如GPT‑4)的AI系统辅助下工作的研究。纳入标准要求研究将“医生+AI”的工作流程直接与仅由医生进行的常规护理进行对照,有时也与AI单独工作的表现作比较。临床任务涵盖了一系列真实问题:判断重症患者可能的病因、解读脑部影像、撰写与阅读门诊记录,以及决定如何处理胸痛等常见主诉。总体上,10项同行评审的试验构成了分析的主干,另有少数预印本仅用于检验结论的稳健性。

医师—AI团队的表现如何

在这些研究中,将医生与AI配对在某些诊断与管理质量指标上显示出小幅但可察觉的改进。在两项使用详细评分系统评估病例决策的随机试验中,医师—AI团队的得分约比单独医生高出五个百分点。简而言之,如果单独工作的医生在大约100项关键决策中出现错误,加入AI可能大致防止其中约五项错误。然而,作者强调可用数据很有限:仅有一两项试验贡献了这些估计值,且现实世界中可能结果的范围足够广,既包含无效益的情形,也可能在其他环境中出现伤害。

速度、记录与隐藏的错误

很多人希望AI能为医生节省时间。这里的证据并不令人兴奋。当研究者合并了三项测量任务耗时的试验时,他们发现总体上并没有显著的时间节约。在一些模拟练习中,医生在有AI辅助时稍微快一些;而在一项真实门诊研究中,访问时长的净效应几乎为零,尽管某些亚组观察到小幅收益。关于文档的结果也是“混合”的。AI辅助经常使病历看起来更清晰、结构更好,并帮助非专科医生更好地理解眼科等技术性报告。然而,当研究者核对事实时,发现大约三分之一的AI辅助记录仍包含错误。这种看起来更好但仍可能出错的分裂状态带来了明显的安全隐患。

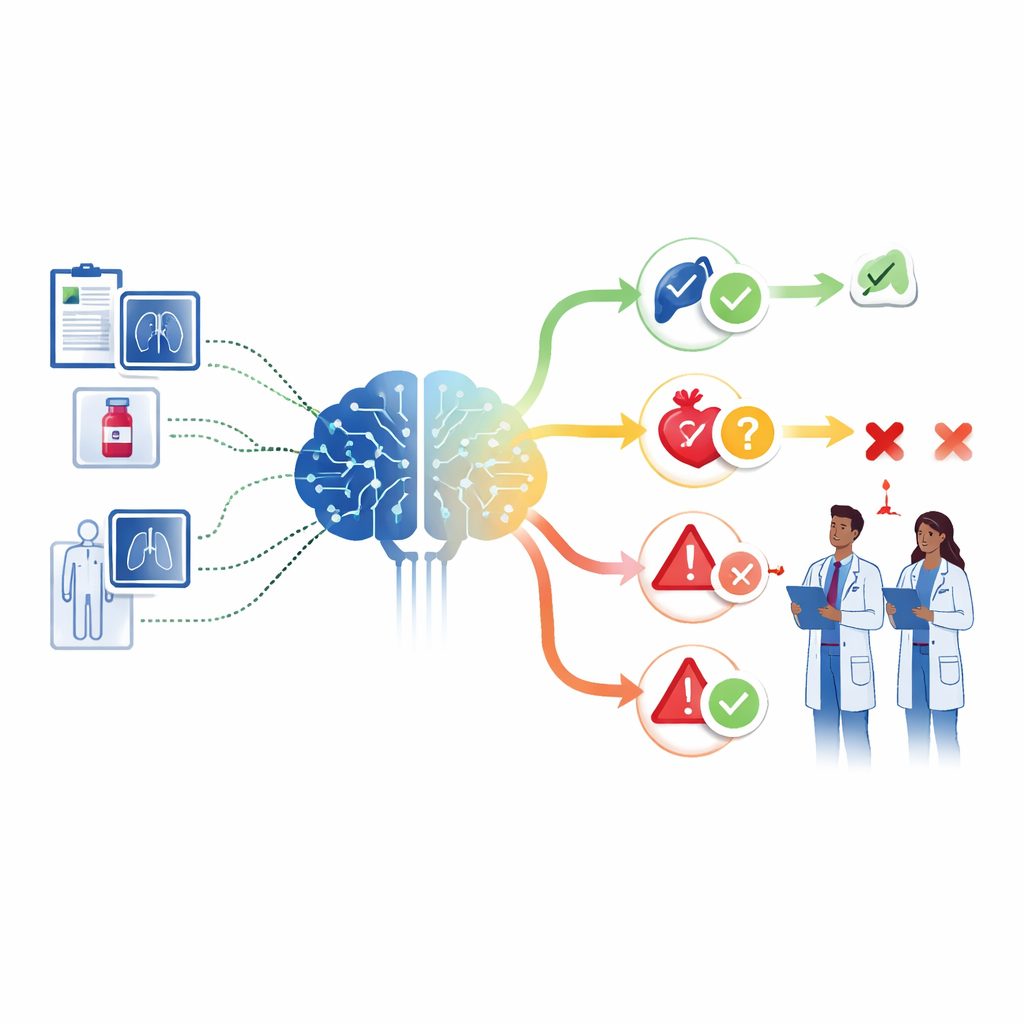

何时协作不如机器单独表现

一个引人注目的发现来自那些也测试AI单独表现的试验。在一项关于重症患者的研究中,AI单独的表现与医师—AI团队相当,且优于许多单独工作的医生。在另一项研究中,AI生成的检测报告明显劣于人类专家所做的报告,无论是否将AI作为助手使用。合起来,这些结果揭示了作者所称的“协作悖论”:仅仅将人类插入流程并不能保证优于表现强劲的AI,并且在某些情形下,协作反而可能削弱双方的优势。建议如何呈现建议、医生对其的信任或不信任程度,以及该工具如何嵌入日常工作流程等因素,都会影响协作是助力还是障碍。

这对医师—AI团队的未来意味着什么

总体而言,这篇综述描绘的是谨慎的希望而非已实现的革命。医师—AI团队可以在某些决策评分上带来适度改进,并使医学写作更易读,但它们并不可靠地节省时间,且仍会产生令人担忧的若干事实性错误。作者认为,卫生系统应当逐步推广这些工具,并配备侧重于发现错误而非仅提高效率的强有力保障措施。他们还呼吁开展更大规模的真实世界临床试验,在繁忙的医院和门诊中测试AI辅助,而不仅限于受控的案例模拟。在获得此类证据之前,最安全的路径是将大型语言模型视为强大但会出错的助手——并设计工作流程,使临床医生充当批判性审查者和把关人,而非被动接受AI建议的人。

引用: Wang, G., Zhang, K., Jiang, J. et al. Human–large language model collaboration in clinical medicine: a systematic review and meta-analysis. npj Digit. Med. 9, 195 (2026). https://doi.org/10.1038/s41746-026-02382-2

关键词: 人类–人工智能协作, 临床决策支持, 大型语言模型, 诊断准确性, 医疗文档