Clear Sky Science · zh

利用大型语言模型扩展医疗器械监管科学

这对患者和医生为何重要

现代医学正迅速充斥着使用人工智能来解读影像、追踪生命体征并辅助医生决策的“智能”设备。仅在美国,就已有一千多种此类工具获得食品和药物管理局(FDA)的清晰或批准。每台设备都会留下复杂的报告和安全记录。如今,这些信息大多仍靠人工筛查,速度慢、成本高,且很快跟不上现实变化。本文探讨了大型语言模型——即支持高级聊天机器人的那类人工智能——是否能可靠地大规模阅读这些文档,并将其转化为可用数据,帮助监管者、研究人员和公众了解这些设备的构造质量与运行安全性。

过多复杂文档的问题

每一款基于 AI 的医疗器械都伴随着详尽的决策摘要、安全报告和召回通知。这些文档篇幅长、术语密集,常包含表格、图像和不一致的格式。以往研究表明,要回答诸如设备在获批前如何被测试、或故障发生时具体出了什么问题等基本问题,需要由专家团队逐页阅读数百份 PDF。简单的搜索工具和模式匹配可以找出显而易见的细节,如识别号,但在需要判断力的更深层问题上则力不从心,例如研究是否在多家医院开展,或设备是否确实导致了患者受伤或死亡。随着支持 AI 的设备数量激增,这种人工方式已无法跟进。

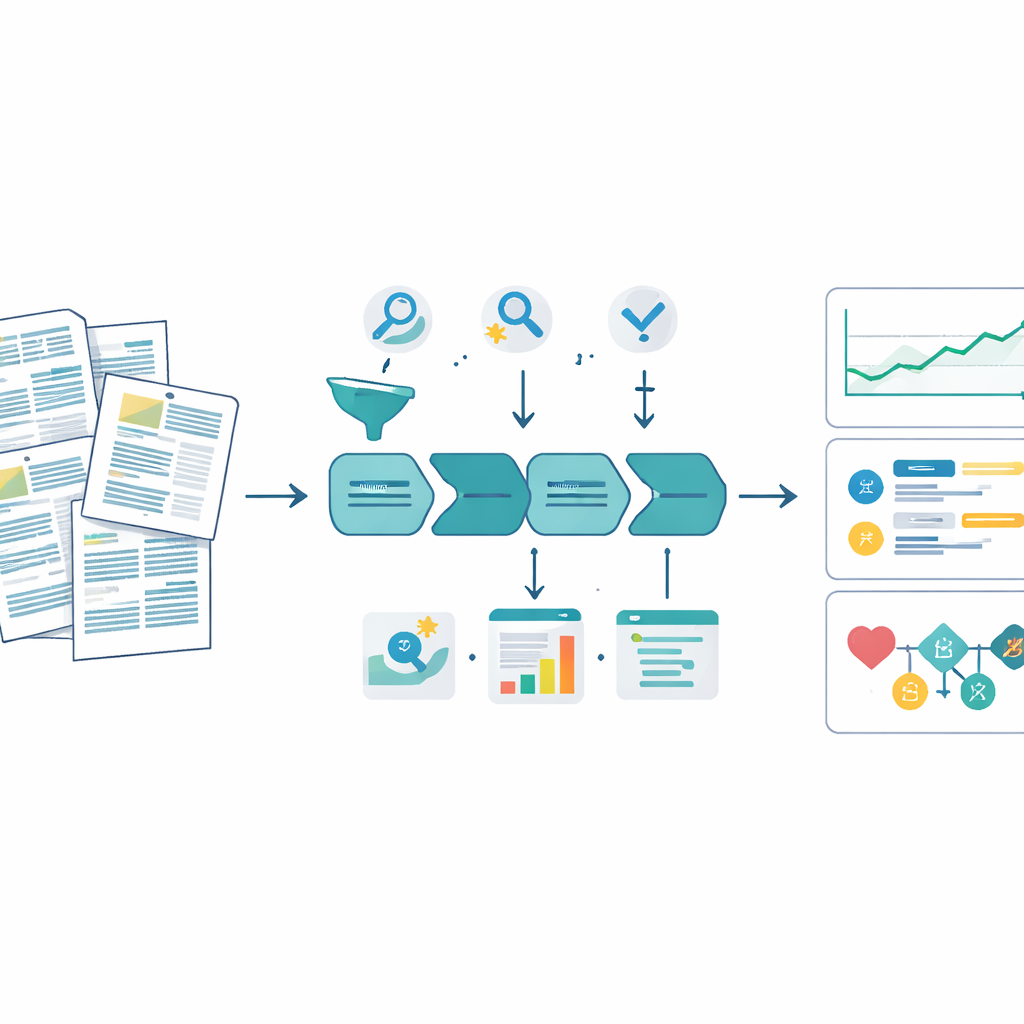

像专家一样阅读的 AI 流程

作者构建了基于最先进大型语言模型的通用流程来应对这一挑战。首先,他们汇集了截至 2025 年中期公开可得的 1,247 款 AI 或机器学习设备的 FDA 决策摘要和安全报告,以及 1,852 起相关不良事件报告,清理 PDF,并在需要时使用光学字符识别。随后,与其一次性要求模型回答宽泛问题,他们将任务拆分为更小、明确定义的子任务。针对每类文档,模型接收基于官方 FDA 指南的详细指令以及人工标注示例。模型被要求逐步推理,并以严格的结构化格式输出答案,将自由文本转换为清晰字段,如“研究中心数量”、“安全事件类型”或“设备变更类型”。

在真实监管问题上检验准确性

为了评估该系统是否可信,团队进行了三项案例研究,这些问题之前的研究者已花数月进行人工审查。首先,他们重新审查了设备获批前的测试情况,询问试验是否为前瞻性(向前收集数据)以及是否涉及多家医院。将模型输出与专家标签比较后,他们发现一致率常在 80% 至 90% 以上,可与人工注释者之间的一致性相媲美。其次,他们用模型重新标注描述故障、伤害或死亡的安全报告,并对问题发生的原因进行分类。当人工审阅者在不知道来源的情况下比较制造商原始编码与模型建议时,他们在大多数情况下更偏好模型的选择,尤其是在死亡与故障等敏感类别上。第三,研究者将获批前文件中的细节与后期安全报告相连接,以探索哪些早期选择——例如选择有召回历史的前代设备或进行重大硬件更改——与未来问题风险较高存在统计关联。

这些发现对安全与监管的启示

在验证后,该流程使团队能够将这些分析从几十台设备扩展到已知的全部 AI 支持医疗工具。例如,他们发现三十年来前瞻性临床评估一直相对罕见,约占十分之一左右,而多中心试验的提及则显著增加。在安全报告中,模型发现文本描述的问题类型与提交给 FDA 的代码不一致的模式——例如将硬件故障标为图像质量问题。将获批前特征与后期安全事件关联后,发现前代设备已有召回或不良事件历史的设备,出现新报告的风险明显更高;而有临床测试支持的设备风险趋于较低。尽管这些结果具有探索性,但它们展示了现在可以常规提出、而不再是一次性项目的问题类型。

局限、保障措施与前路

作者强调,他们的方法并非十全十美,也不应取代专家判断。约 80% 的准确率可能足以用于分析宏观趋势,但不足以用于针对单一设备或患者做出决策。性能会因设备类型和年份而异,且底层 FDA 文档和安全数据库的质量仍是主要瓶颈。尽管如此,这项研究表明,精心设计的语言模型系统能够在数天内将大量非结构化监管文本转化为结构化、可审计的数据,而非花费数年。对于普通读者而言,结论是:驱动消费者聊天机器人的相同 AI 技术,也可以帮助监管者和研究者追踪 AI 医疗设备的构建、测试和监测,从而可能更快发现问题,并提供更好的证据以制定更安全的规则和产品。

引用: Li, H., He, X., Subbaswamy, A. et al. Scaling medical device regulatory science using large language models. npj Digit. Med. 9, 221 (2026). https://doi.org/10.1038/s41746-026-02353-7

关键词: 人工智能医疗器械, 监管科学, 大型语言模型, FDA 安全报告, 健康技术监督