Clear Sky Science · zh

一种将视觉变换器与Swin变换器集成并结合大语言模型解释的甘蔗叶病诊断方法

为何发现生病的甘蔗叶很重要

甘蔗是糖料、生物燃料和许多农村生计的支柱作物,但其叶片容易受到多种疾病的侵害,悄然削减产量。农民通常依靠目视检查,这既耗时又不稳定,也难以在大片田地中推广。本文探索了现代人工智能如何自动读取叶片照片,高精度检测多种甘蔗病害,并将这些预测通过语言模型转化为面向农户的通俗建议。

如何将叶片照片转为可用数据

研究者使用来自Kaggle的公开甘蔗叶片图像集合构建系统,包含近两万张彩色照片。每张图像属于六类之一:健康或五种常见病害之一,包括细菌性疫病(Bacterial Blight)、花叶病(Mosaic)、红腐病(Red Rot)、锈病(Rust)和黄叶病(Yellow Leaf Disease)。这些照片在真实农田条件下拍摄,因此包含变化的光照、阴影和杂乱背景。为准备数据,团队去除了重复和损坏的图像,然后在保持各病种比例一致的前提下将数据集划分为训练、验证和测试集。在训练阶段,仅对训练集图像进行了旋转、翻转和缩放等增强,以模拟不同的相机角度和距离,从而提高系统鲁棒性,同时不夸大测试表现。

观察叶片的两种互补方式

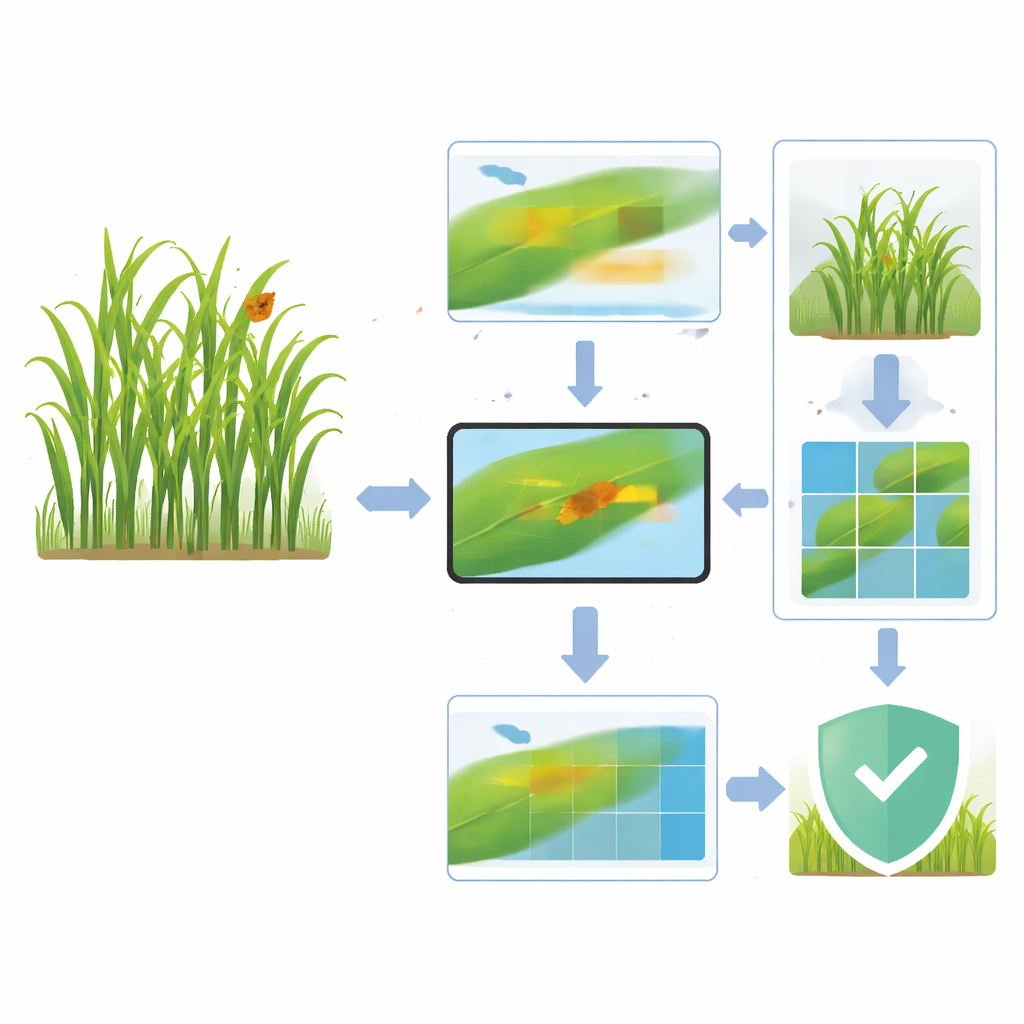

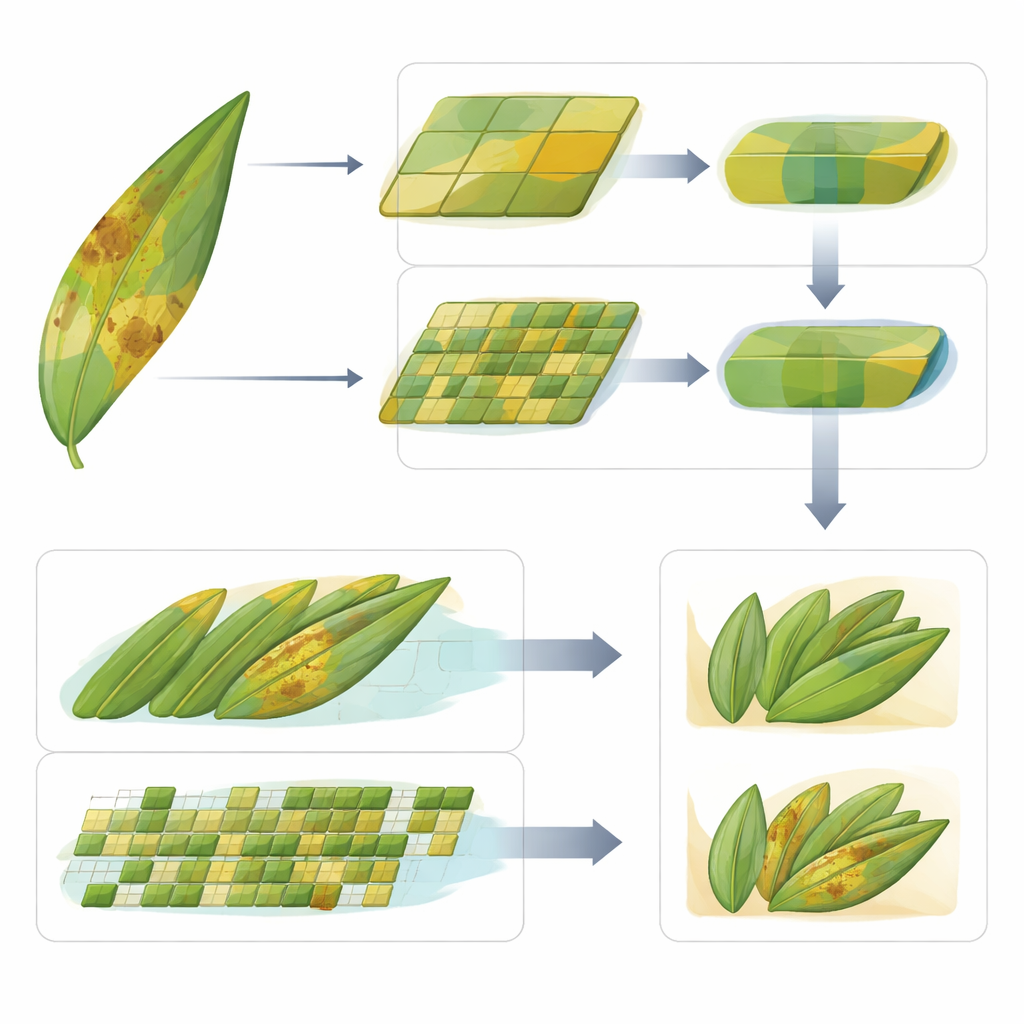

研究核心是一个将两种先进视觉模型(变换器)组合的“集成”方法。一种是视觉变换器(Vision Transformer,ViT),将每张图像视作一组补丁,并一次性学习跨整个叶片的模式。这种全局视角适合检测以大面积、弥散性色变表现的病害。另一种是Swin变换器,它以较小的重叠窗口在图像上滑动,逐层构建对细纹理和小斑点的理解。局部聚焦有助于识别表现为微小病斑、条状或点状的病害。ViT对广泛的颜色变化更为敏感,而Swin则关注小而聚集的细节——二者分别对应田间真实叶片病征的两种表现方式。

两种模型如何协同工作

作者没有构建复杂的新网络,而是以一种简单透明的方式结合ViT和Swin。每个模型先分别处理同一张叶片图像并输出针对六个类别的概率分数。然后对这些分数进行平均,不引入额外的可训练权重,最终由最高的合并概率决定诊断结果。这种平均策略在平衡各模型优势的同时,避免在规模虽较大但仍代表特定区域和条件的数据集上产生过拟合。实验显示,用传统卷积网络代替Swin会丢失关键的局部细节,而仅使用ViT又会错过细微线索——这说明性能提升来自全局注意力与局部注意力的真实协同,而非简单地堆叠更多模型。

系统在实践中的表现如何

在近三千张的独立测试集上,该集成模型达到约97%的准确率,且在所有六类上的精确率、召回率和F1得分同样很高。它优于强力的卷积基线如ResNet、EfficientNet、MobileNet和DenseNet,以及单独的ViT和Swin模型。混淆矩阵显示,大多数错误发生在视觉上相似的病种之间,例如黄叶病与花叶病,但总体误分类率仍然很低。各类的受试者工作特征曲线几乎接近完美,表明该集成在区分健康与病害叶片及不同病害类型方面高度自信且一致。

将预测转化为农户友好的指导

为超越单纯标签,作者将图像集成器与托管于线上平台的大型语言模型(LLM)相连接。一旦对叶片照片完成分类,预测出的病名会被发送至LLM,LLM返回一段关于可能症状和常规管理建议的简短说明,面向农民和推广人员。基于Hugging Face平台构建的网页界面允许用户上传叶片图像、查看预测病害并在几秒钟内阅读AI生成的指导。作者强调这些建议属于参考性内容,应由农艺专家核实,因为LLM有时会生成过于自信或不完整的建议。不过,语言层使系统对非专业用户更为易用。

对未来智能农业工具的意义

通俗地说,这项研究表明,将两种“看”同一片叶子的方式结合起来——一种看整体、一种看细节——可以形成一个非常可靠的数字侦察员来检测甘蔗病害。ViT与Swin的集成既捕捉到广泛的症状,也识别出细微特征,而附加的语言模型则将技术性预测翻译为人类易懂的建议。尽管这些模型仍需在更多地区、光照条件和设备上进行测试,且语言输出需要专家审校,但该工作指向可行的手机或平板工具,能够帮助农民及早发现问题、减少盲目判断,并支持更精准的病害处理,不仅对甘蔗,也有望推广到其他作物。

引用: Saritha, M., Rasane, K. An ensemble of vision and swin transformers with LLM-based explanations for sugarcane leaf disease diagnosis. Sci Rep 16, 10707 (2026). https://doi.org/10.1038/s41598-026-45453-w

关键词: 甘蔗病害检测, 视觉变换器模型, 精准农业, 植物叶片成像, 人工智能决策支持