Clear Sky Science · zh

混合进化—梯度训练提高长期时间序列预测能力

为什么更好的长期预测很重要

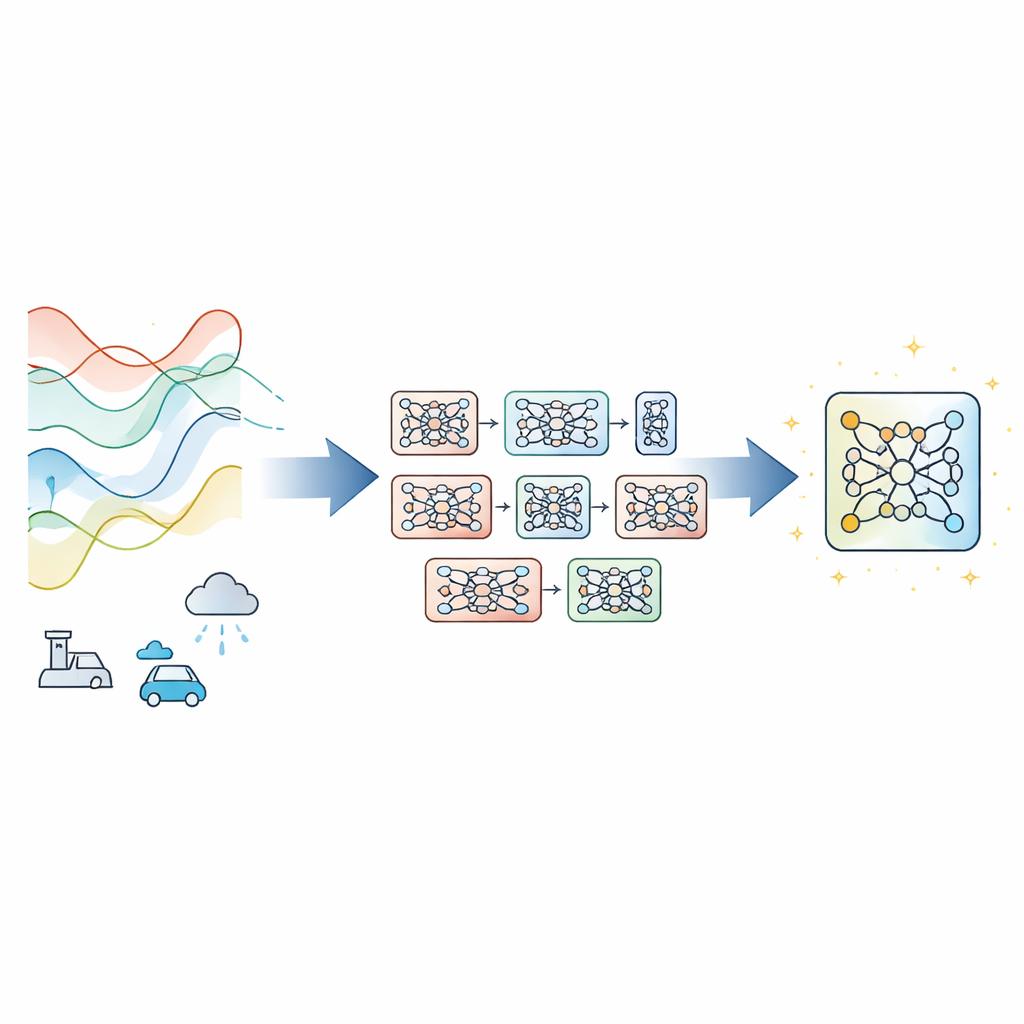

从用电需求和公路交通到汇率和本地天气,我们的生活由随时间演化的系统塑造。准确地预测这些模式,提前几天或几周,可以节约能源、减少拥堵并提升企业韧性。但展望越远,当今的人工智能工具就越难应对不断变化的条件、噪声测量和有限的计算预算。本文提出了一种新的训练方法,使预测模型即便在世界不稳定时仍能保持准确性和稳定性。

从多个模型中学习,而不是只学一个

大多数现代时间序列预测器依赖单一深度神经网络并用梯度下降训练——一种通过逐步调整参数以减小误差的标准方法。当数据表现一致时,这种方法效果很好,但在条件漂移、测量噪声或训练时间受限时可能失效。作者并未发明新的网络结构,而是提出了带有梯度精炼的进化引导模块融合(EGMF‑GR),这是一种可套用到现有架构的训练框架。关键思想是维护一个小规模的“种群”模型,它们结构相同但从不同随机初始化出发。在训练过程中,这些模型以不同方式尝试拟合数据,而任何时刻表现最好的模型都会用于引导其它模型的改进。

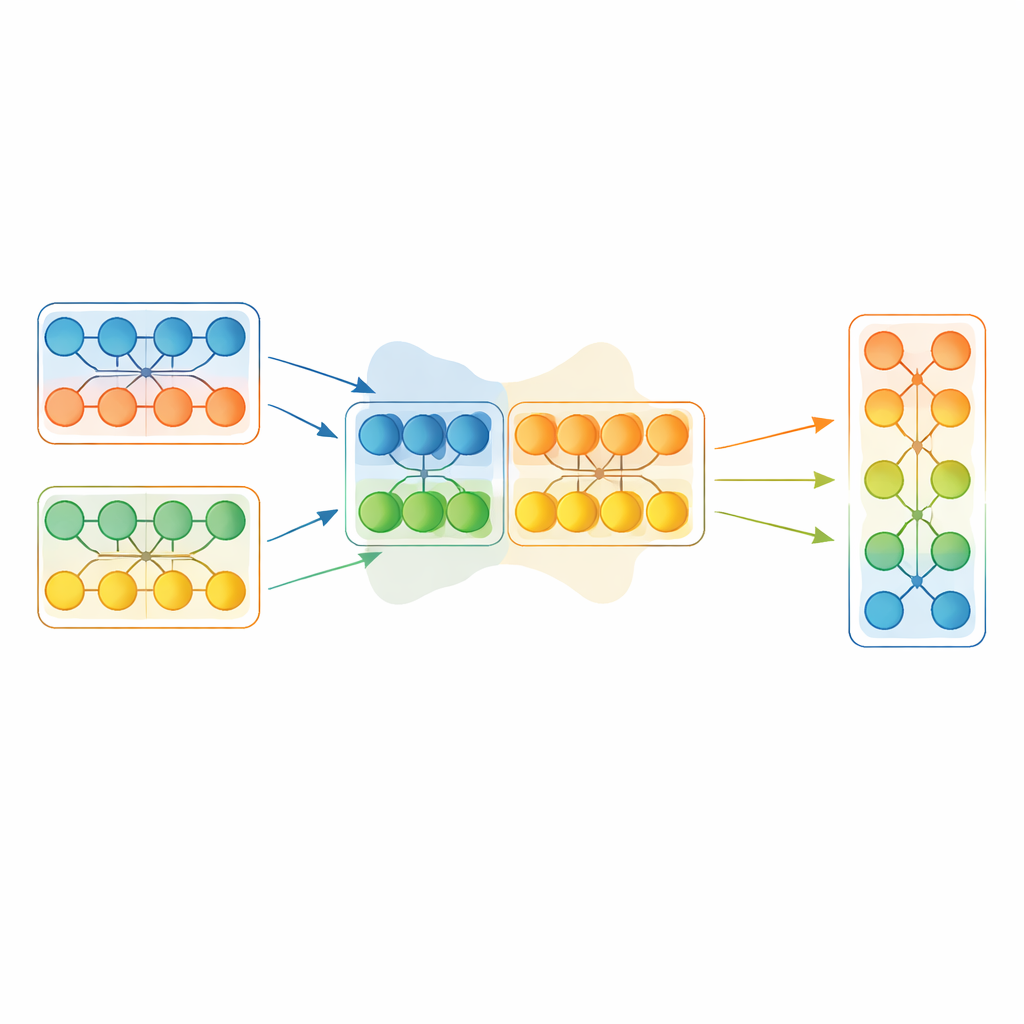

借用优良部件,同时保留有用的多样性

EGMF‑GR并不是整体复制获胜模型,而是在模块层面操作——网络内部重复的构建块,例如层的堆叠。对于种群中的每个模型,框架将对应模块与当前最佳模型的模块对齐,并在处理相同输入批次时比较它们的内部信号。它使用若干简单的差异度量,既捕捉活动模式的形状,也衡量其幅值。这些按模块计算的差异随后被汇总,只有那些相对于同侪表现出明显异常的模块才会被考虑更新。发生更新时,落后模块通过它与最佳模型对应模块参数的加权混合并加入少量随机扰动来被推向更优的方向,以保留多样性。

让梯度在大动作后进行整理

不同网络部件的混合可能引入突变。为避免破坏训练稳定性,每个融合后的模型都会在训练数据上进行短暂的常规梯度下降阶段。这个精炼步骤让网络在新的内部配置下平滑地重新适应,同时保留借鉴来的知识。总体流程交替进行:基于一段留出数据选出当前的最佳模型,有选择地将该领头模型的模块融合到种群其余成员中,然后对所有模型短暂地用梯度微调。关键的是,该方法还同步内部的记账状态,例如某些层使用的运行平均值,这些在更简单的模型合并方案中常被忽视,但却可能极大影响稳定性。

在多种真实信号上证明了收益

为验证该框架,作者将EGMF‑GR应用到若干流行的预测骨干网络,包括类Transformer模型和近期的一种基于卷积的设计,而未改变它们的核心结构。他们在八个公开基准上评估性能,覆盖能源使用、交通流量、汇率和天气,并在从几小时到数天的多个预测时域上进行测试。在严格匹配昂贵反向传播更新预算的条件下,该混合训练在大多数模型—数据组合作用中持续降低预测误差并平滑训练行为,特别是在高维或噪声严重的场景中。团队还将其方法与常见的单模型技巧(如指数移动平均和随机权重平均)进行比较,发现基于种群的模块融合在简单的权重平滑之外带来了额外收益。

在条件恶化时保持可靠性

真实系统很少像教科书示例那样干净,因此作者还在更严苛的场景下测试了鲁棒性:人为破坏的输入、缺失的数据片段,以及底层动力学突然变化的时期。EGMF‑GR在输入噪声或部分缺失时明显有帮助,这表明从当前最佳模型借用稳定的模块行为可以抵消局部故障。在突发的制度转变期间,优势则较小,这暗示过度对齐有时会减缓对新模式的适应。这指向未来的改进方向:当环境高度不稳时,应该降低融合强度。

这对日常预测工具意味着什么

简而言之,这项研究表明,训练多个相互协作的相同预测模型版本,并只让它们共享那些确实表现更好的部分,可以在不重设计模型的前提下,使长期预测更准确且更稳定。EGMF‑GR像一种有纪律的团队运动:成员偶尔采用彼此最强的策略,然后各自稍作练习以适应当前的比赛。对于从业者而言,这提供了一种即插即用的训练策略,能够增强金融、能源、交通和气候等领域现有的预测系统,尤其在数据杂乱和计算预算紧张时更显价值。

引用: Zhao, L., Chen, Z., Wu, N. et al. Hybrid evolutionary-gradient training improves long-term time series forecasting. Sci Rep 16, 10697 (2026). https://doi.org/10.1038/s41598-026-45017-y

关键词: 时间序列预测, 进化式训练, 神经网络, 模型融合, 分布漂移