Clear Sky Science · zh

GWKNN:一种结合G度量重构与灰狼优化器的增强型k近邻算法

为当今数据洪流打造更智能的模式识别

从医疗影像到银行交易,现代生活产生着海量数据。许多信息需要自动归类:健康或患病、欺诈或正常、垃圾邮件或真实邮件。k近邻(KNN)算法是这类任务的经典工具:它通过参考最相似的历史样本为新样本打标签。然而,随着数据集愈发庞大、复杂且不平衡,这一简单思路开始出现不足。论文提出了GWKNN,一种改进的KNN,旨在更聪明地利用点间距离并更公平地对待稀有但重要的样本。

为什么简单的相似性度量不足以应对现实

传统KNN假设数据点的所有特征贡献相同,并用标准的直线距离衡量相似性。在低维且样本分离良好的情况下这通常可行,但现实世界的数据往往高维、噪声多且包含不同类型的信息。此时常用距离可能产生误导,使算法选择到无助的邻居。同时,许多数据集存在类别不平衡:常见类别占据主导,而像早期疾病这类稀有但关键的类别则样本稀少。KNN在近邻间投票时,主类往往淹没少数类,导致偏差甚至危险的决策。

教算法一种更好的距离观

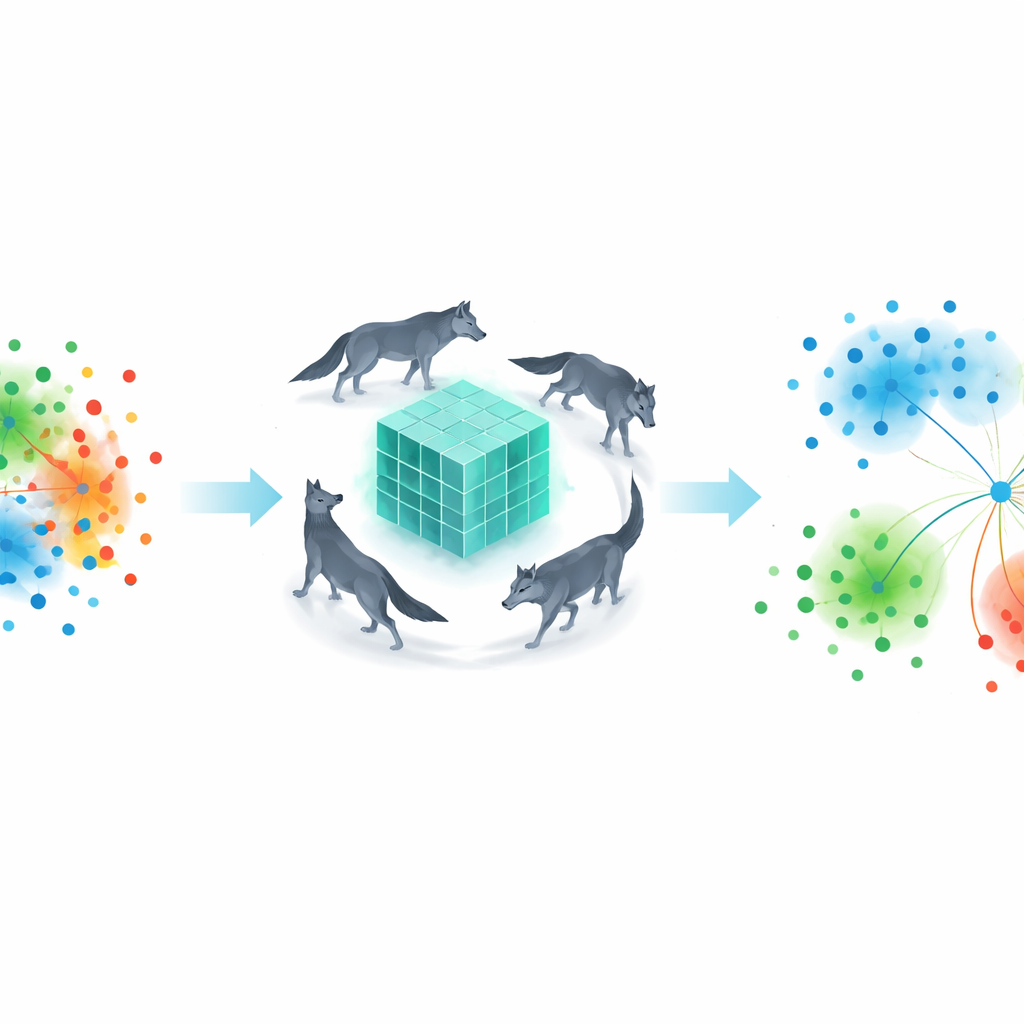

GWKNN的第一个重要创新是学习型距离度量。作者不再固守传统直线规则,而是让算法发现能够最好地分离类别的点间距离。他们将其编码为一种灵活的“G度量”,通过重塑空间使有信息的特征更重要、冗余特征影响更小。为调整该度量,方法借鉴了灰狼的捕猎行为。一个称为灰狼优化器的群体智能过程探索多种拉伸与压缩数据空间的方案,保留那些在降低分类错误同时保持数学稳定性的方案。经过多次迭代,虚拟“狼群”收敛到一种距离规则,使得即便在高维、纠结的数据集中,相似点也能更可靠地聚集在一起。

让稀有样本的声音更响亮

第二项改进针对投票偏差。标准KNN只是简单统计k个邻居中各类的数量并取多数。GWKNN则根据各类在整体训练数据中的出现频率对每一票赋予权重。出现较少的类别获得更强的权重;出现频繁的类别权重较弱。一个小的平滑项防止极其稀有的类别过度主导决策。这样,如果一个新样本靠近少数类样本和许多数类样本,少数类信号不会被自动淹没。该方案计算简单但效果显著:它促使分类器更多关注稀有但重要的模式,提升少数类的公平性和召回率。

将新方法付诸检验

为验证GWKNN在实践中的效果,作者在来自著名UCI库的12个基准数据集上进行了评估。这些集合涵盖金融数据、医学测量、手写体、植物种子,以及若干高维的癌症与基因表达数据集,包含二类和多类问题。他们比较了四种KNN版本:基础版本、仅使用新距离度量的版本、仅使用新投票权重的版本,以及同时结合两者的完整GWKNN。他们还将GWKNN与七种常用分类器对比,包括支持向量机、决策树、随机森林、逻辑回归、朴素贝叶斯和神经网络。在重复的训练—测试划分中,他们不仅跟踪平均准确率,还观察结果波动情况。

结果:更准确且更稳定

综合的GWKNN方法在多数数据集上取得了最好或并列最好的表现,尤其是在高维且类别分布不均的案例上。在相对简单的任务中,各方法表现都不错,提升幅度有限,但GWKNN仍倾向于略微提高准确率并降低波动。在具有数千个特征的复杂基因表达数据集中,优势更为明显:学习到的距离度量帮助算法构建更有意义的邻域,权重投票则提升了对少数类的识别。跨所有数据集的统计检验证实,GWKNN的排名显著优于标准KNN和一些传统模型,表明其改进并非偶然波动,而是在不同数据条件下的稳健提升。

这对日常数据决策意味着什么

对非专业读者而言,结论是:GWKNN将一个非常直观的想法——“参考相似的历史案例”——加以改进,使之更契合现代数据的混乱现实。通过以数据驱动的方式学习相似性并在投票时提升稀有类别的影响力,该方法旨在在准确性和公平性之间取得更好平衡。尽管这种额外的复杂性带来了更高的计算成本,尤其针对极大和高维的数据集,但GWKNN在那些少数类正确分类至关重要的任务(如早期疾病检测或欺诈识别)中展现出强大潜力。该工作展示了如何以优化和公平性的洞见升级经典算法,以跟上当今信息规模与复杂度的步伐。

引用: Guo, Z., Liu, G., Liu, W. et al. GWKNN: an enhanced k-nearest neighbor algorithm with G metric reconstruction and Grey Wolf Optimizer. Sci Rep 16, 8857 (2026). https://doi.org/10.1038/s41598-026-41851-2

关键词: k近邻, 距离度量学习, 类别不平衡, 群体智能, 数据分类