Clear Sky Science · zh

大脑与大型语言模型中的预测、句法与语义落地

你的大脑如何猜测下一个词

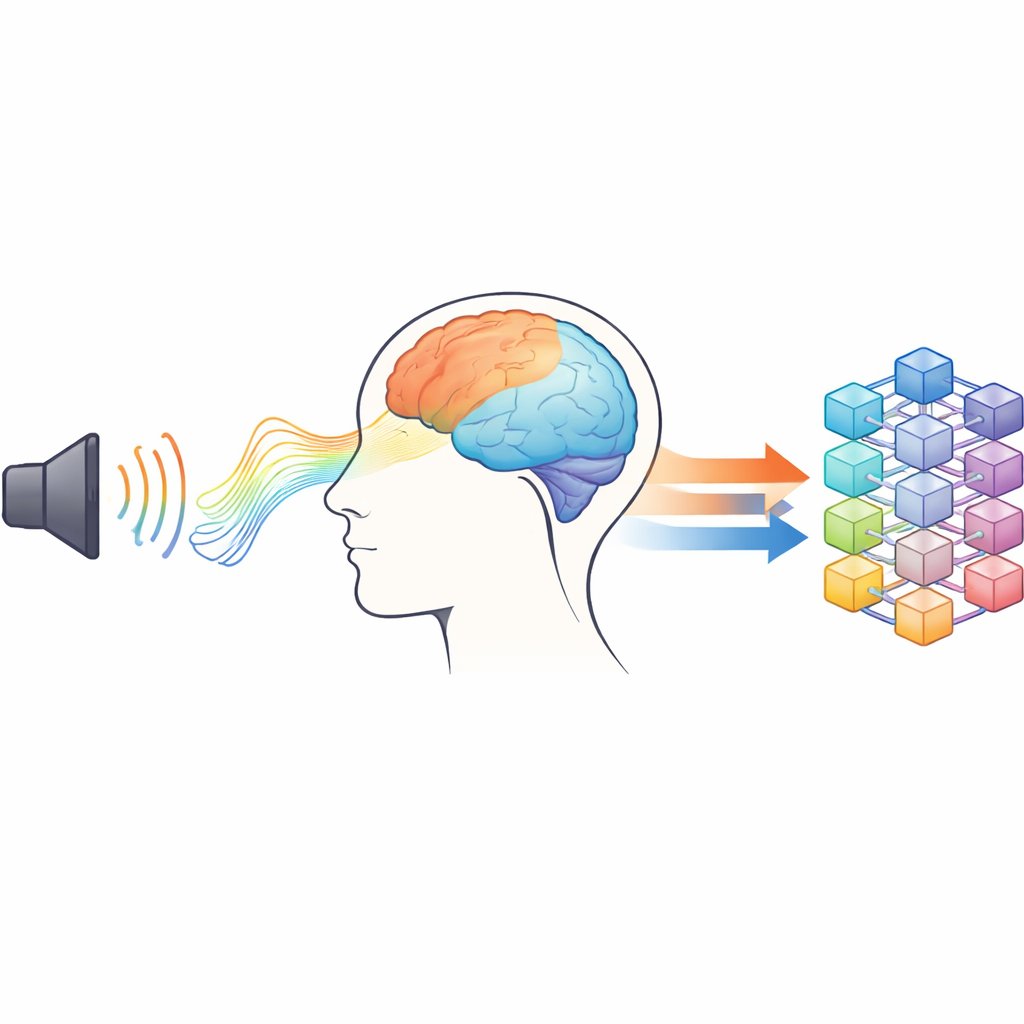

当你听故事时,常常感觉轻松就能跟上——但在表面之下,你的大脑不断地猜测接下来会出现什么。与此同时,像大型语言模型(LLM)这样的现代人工智能系统也通过预测即将出现的词来生成流畅的文本。这项研究把这两个世界联系起来,探讨人类大脑如何实时预期词语,以及这些过程与先进的人工智能模型的运作方式有何相似与不同。

在实验室里听故事

为研究自然语言理解,研究者超越了人为的词表或孤立的短句。相反,29名年轻成年志愿者在听大约50分钟的德语科幻有声书时记录了他们的大脑活动。研究同时使用了两种互补技术:脑电图(EEG),记录头皮上的微小电压变化;和脑磁图(MEG),检测由大脑活动产生的磁场。结合起来,这些方法可以在毫秒精度下追踪大脑对每个词的反应,同时参与者跟随连续的故事情节。

追踪不同类型的词

有声书被自动切分为单个词并按语法类型标注:名词(例如“planet”)、动词(例如“run”)、形容词(例如“dark”)以及专有名词。对于故事中的每个词,科学家截取了该词发出前后的一段短时间窗口的EEG和MEG信号,然后在每个词类内对这些片段求平均。结果显示出不同词类可靠的电和磁“指纹”,其中包含与意义和句子结构相关的已知成分。重要的是,研究组发现名词的活动在词真正开始之前就开始累积,表明在语境中大脑对这类词特别有准备。

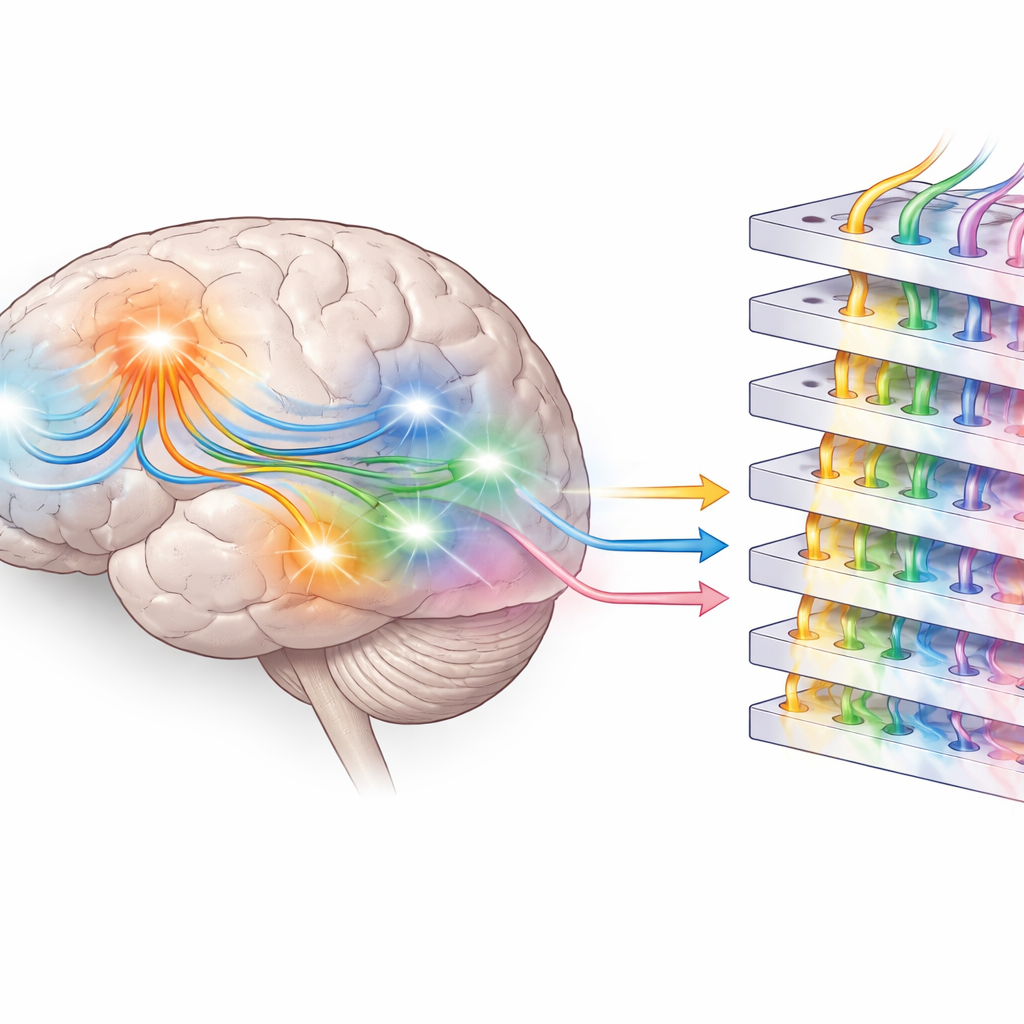

意义与动作相遇的地点

为了确定这些信号在大脑中的来源,研究者使用计算模型估计头内部MEG和EEG模式的可能起源。名词不仅激活颞叶的经典语言区域;它们还涉及与感觉运动系统部分相兼容的区域,靠近参与运动和躯体感觉的脑区。相较之下,动词则呈现出不同且更受限的模式。这支持“具身”语言的观点:理解一个词——尤其是具体名词——部分地重新激活与感知和动作有关的网络,将意义建立在过去的感觉经验上,而不仅仅是抽象规则。

比较大脑与大型语言模型

研究团队随后使用Meta的Llama 3.2语言模型作为计算参考。首先,他们通过将有声书的前文输入模型并询问其对真实下一个词的概率来测试“语义预测”。结果显示名词对模型来说最容易预测,呼应了名词在构建故事中所处的核心角色。接着,研究者通过检查Llama内部的激活或嵌入来探索“句法预测”。即使没有额外训练,模型的隐藏层也自然而然地根据随后词的语法类型对词进行分组,而且一个简单的探测网络常常能够判断下一个词的词类。跨层观察到,专有名词和名词的内部结构变得更加分明,呼应了大脑活动模式中角色逐渐分化的现象。

两种面向词语的准备状态

综合来看,这些发现表明大脑至少在两个层面上为即将到来的语言做准备。在颞区,词发作前的活动似乎反映一种语法或“句法”准备——关于某类词在句中何处更有可能出现的知识。在更加额前和感觉运动区,准备模式似乎承载着更丰富的“语义”期望,这些期望与意义和经验相关,尤其针对名词和专有名词。大型语言模型虽然仅通过预测下一个词进行训练,但会发展出自身的分层内部结构,在一定程度上反映了这些区分,然而它们缺乏与物理世界的直接落地。通过将高速的大脑记录与最先进人工智能的分析相结合,这项工作有助于澄清人类在日常听觉中如何预期词语,以及当今机器在逼近这种人类语言理解核心特征方面走了多远。

引用: Kölbl, N., Rampp, S., Kaltenhäuser, M. et al. Prediction, syntax and semantic grounding in the brain and large language models. Sci Rep 16, 8728 (2026). https://doi.org/10.1038/s41598-026-41532-0

关键词: 语言预测, 大脑与人工智能, 大型语言模型, 语义落地, EEG MEG 语言