Clear Sky Science · zh

用于医疗人工智能的随机泊松嵌入隐私框架,结合安全同态加密的联邦学习

在教机器的同时保护医疗机密

医院正在收集大量 X 光影像,这些影像可帮助医生更早、更准确地发现如 COVID‑19 之类的疾病。但这些影像也高度隐私化,严格的隐私法规使得将数据汇总到一个地方以训练强大的人工智能(AI)工具变得困难。该研究展示了一种方法,使医院能够在不向任何人交出原始影像的情况下,共同构建一个共享的 X 光诊断系统,旨在在保持患者数据安全的同时仍获得一流的准确率。

为何共享医疗数据如此困难

现代 AI 依赖大而多样的数据集,但医院通常将影像保存在本地,并且通常不愿意或法律上无法将其发送到中央服务器。将所有数据复制到一个大数据库的传统做法存在泄露和网络攻击的风险,破坏公众信任并可能违反法规。即便是较新的方法——在所谓的“联邦学习”设置中医院共同训练共享模型——也并非绝对安全:技巧高明的攻击者有时可以从模型更新逆向推测出患者影像。同时,医疗数据通常分布不均且杂乱,有些医院在特定疾病病例上远多于其他医院,这可能使训练不稳定并降低可靠性。

一个永不共享原始 X 光的协作网络

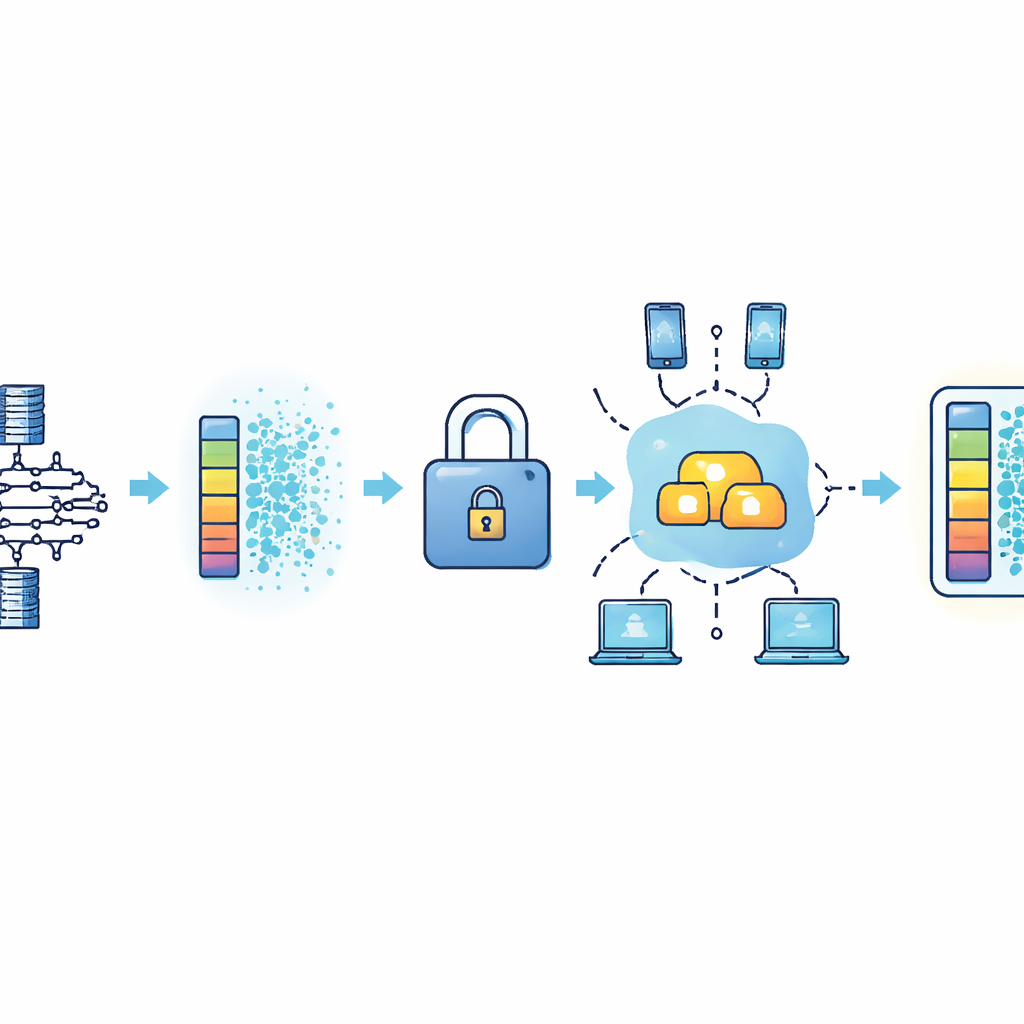

作者设计了一个以强大图像识别模型 ResNet‑50 为核心的联邦学习框架,用于将 COVID‑19 与正常胸部 X 光 区分开来。每家医院在本地影像上训练自己的一份模型副本,所有 X 光都留在本地。医院不传送图片,而只发送描述其本地模型应如何更新的数值更新。中央服务器对这些更新进行平均以形成改进后的全局模型,然后将该模型返回给每家医院。重复这一循环使共享模型在不暴露单个扫描的情况下受益于所有参与者的综合经验。

额外隐私层:数字“静态”和加密锁箱

为防止攻击者从模型更新重构患者影像,该框架在联邦学习之上叠加了两种隐私技术。首先,每家医院向其模型更新中添加经精心校准的随机噪声,有点像在无线电信号中加入静态,使得个别声音更难识别但整体信息仍然可用。其次,在更新通过网络传输之前,它们使用一种允许服务器在密文状态下进行相加的加密方法进行加密——类似于在封闭信封中对数值求和。只有受信任的密钥持有者可以解锁合并结果,中央服务器从未以明文形式看到任何一家医院的更新。这些步骤共同旨在阻碍逆向工程患者数据的尝试,同时保留共享模型的有用性。

系统测试

研究团队在平衡的 COVID‑19 与正常胸部 X 光图像集上评估其框架,模拟若干医院作为独立训练站点。他们比较了三种设置:将所有数据汇集的传统集中式训练、没有额外保护的标准联邦学习,以及他们的隐私增强方法。尽管增加了噪声和加密,但受保护系统仍达到惊人的高分——约 99.6% 的准确率,且精确度、召回率和 F1 值均同样强劲——与汇总训练和未保护的联邦版本相当或更好。通信轮次、训练损失和计算时间的测量显示,随着站点协作,准确率稳步提高,而加密带来的额外时间成本则保持在适度范围内。切除实验(将系统的部分功能打开或关闭)证实了所选噪声水平及加密加压缩策略在仅带来小幅性能权衡的情况下提供了强有力的隐私保护。

这对未来医疗意味着什么

对非专业读者而言,关键结论是这项工作展示了一种实用方法,可以在不暴露原始影像或削弱隐私法规的情况下,从多家医院的 X 光中训练 AI。通过将高性能的图像模型与数字“静态”和加密聚合相结合,该框架表明医院可以共同构建准确的诊断工具,同时将病历留在本地,避免被窥探。虽然该方法在相对较小的数据集上进行了测试并专注于 COVID‑19 X 光,但相同的思想可以扩展到其他疾病、影像类型,甚至是如金融等其他敏感领域。简言之,该研究指向了一个强大 AI 与严格医疗隐私可以相互促进而非对立的未来。

引用: Gomathi, R., Saranya, K., Mahaboob John, Y.M. et al. Stochastic Poisson-embedded privacy framework for federated learning with secure homomorphic encryption in medical AI. Sci Rep 16, 10931 (2026). https://doi.org/10.1038/s41598-026-41469-4

关键词: 联邦学习, 医学影像, 数据隐私, 同态加密, X 光诊断