Clear Sky Science · zh

口腔病理学诊断中人类与人工智能的比较:ChatGPT、Grok 与 MANUS 的对比研究

这对你下一次牙科就诊意味着什么

当牙医在口腔中发现可疑病变时,决定其是良性还是危险的最终结论通常来自在显微镜下研究组织的专家。此项工作细致、耗时,并且在世界很多地区专家不足。本研究提出了一个及时的问题:现代人工智能系统能否以接近人类专家的准确度解读这些口腔组织的显微图像,从而使诊断更快、更一致并更广泛可及?

研究者要测试的内容

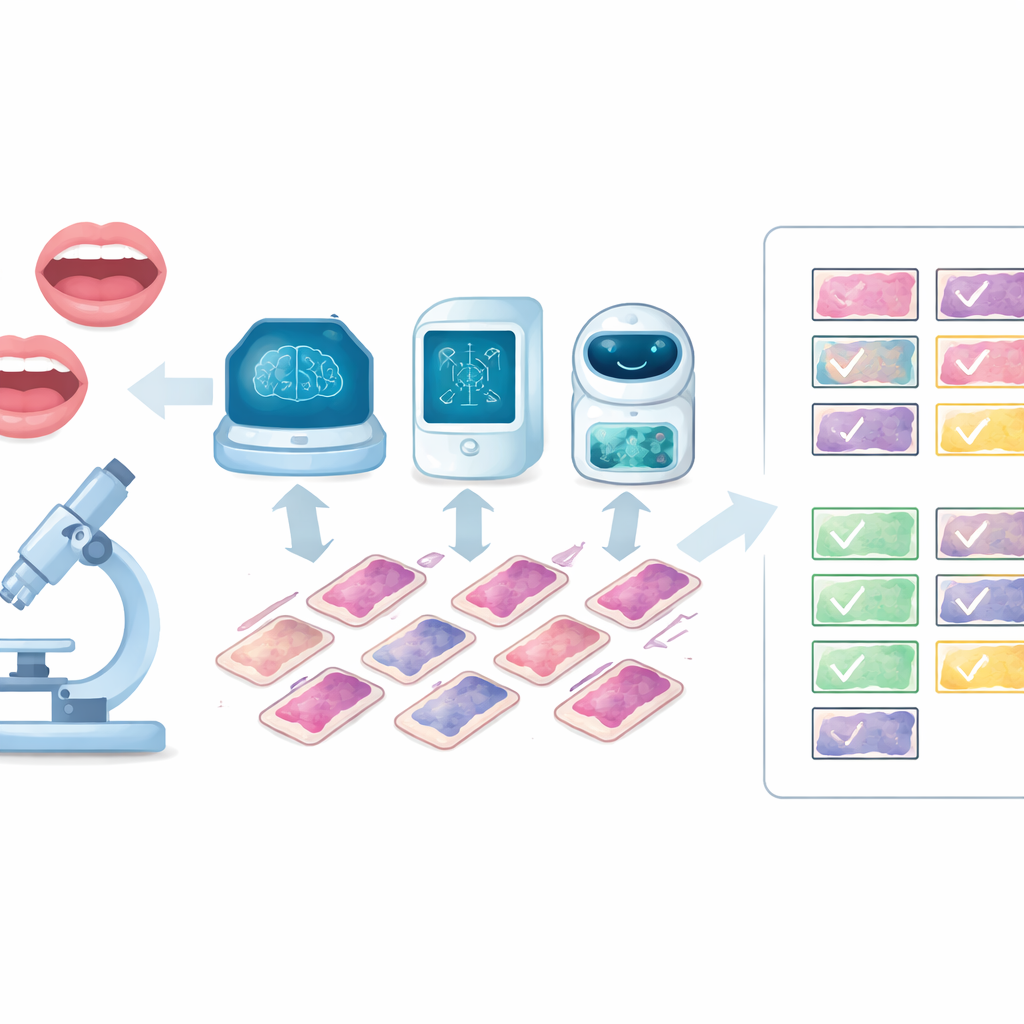

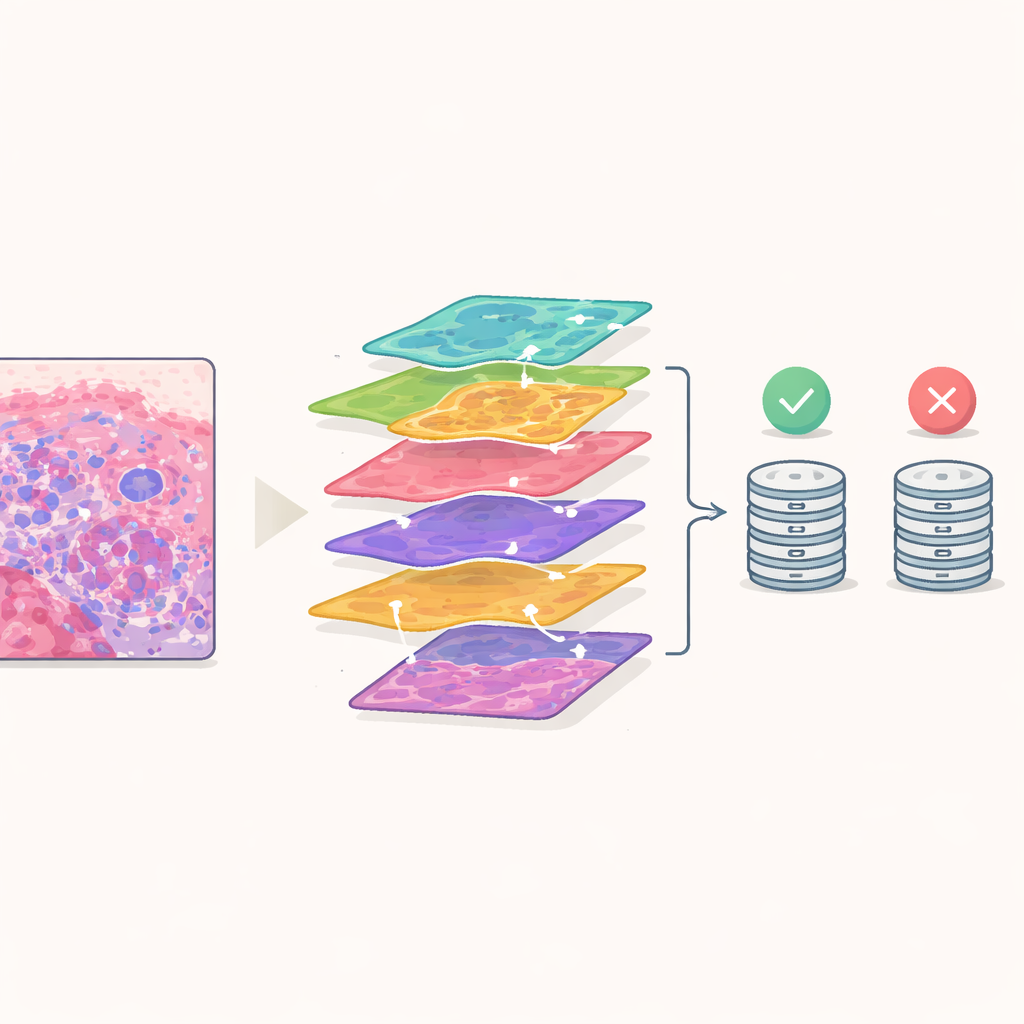

研究团队聚焦于三种以同时理解图像与语言见长的先进计算程序:ChatGPT、Grok 及一款名为 MANUS 的医学系统。研究没有使用真实患者数据,而是选用了来自一本标准口腔疾病教科书的 100 张清晰高质量显微图像。每张图像展示不同类型的病变,涵盖早期癌前变化、肿瘤、囊肿和反应性增生等。两位经验丰富的口腔病理学家首先对每张切片达成一致诊断,建立了一个强有力的人类对照标准,以便与机器结果比较。

对比测试如何进行

将 100 张切片中的每一张以相同的简短说明和相同的数字图片同时提交给三种 AI 系统。模型被要求像病理专家出具报告时那样,给出最可能的单一诊断。为检验系统随时间是否保持稳定,研究者在两周后用相同的切片和指令重复了整个过程。同时,两位人类病理学家在不查看 AI 输出的情况下独立阅片,然后就分歧进行讨论直至达成最终意见。这些专家意见被视为可用的最佳答案。

机器与人类的表现如何

三种 AI 工具的表现都令人瞩目。在第二轮测试中,Grok 正确识别了 100 个病例中的 97 个,MANUS 为 96 个,ChatGPT 为 94 个。两位人类专家的得分略高,正确分类了 98 张切片。ChatGPT 在两轮中几乎给出完全相同的答案,显示出极强的内部一致性,而 MANUS 与 Grok 也表现出稳健且稳定的性能。系统彼此之间在大多数病例中达成一致,这表明不同的 AI 设计在面对同样高质量图像时仍能得出非常相似的判断。

AI 与专家思维的契合度

匹配正确答案只是部分考量;计算机是否倾向于与人类的推理模式一致也很重要。在这方面,MANUS 与病理学家决策的契合度最高,即使其在原始准确率上并未超过 Grok。Grok 虽然总体上略微更准确,但在少数复杂病例中有时会得出与专家不同的选择。三种系统的大部分错误都出现在即便是受过训练的眼睛也会感到视觉上混淆的切片上——组织变化重叠或在两种情况之间呈边缘化表现。尽管如此,模型之间并无重大性能差距,且三者与人类的总体一致性被作者描述为中等到显著程度。

这对未来医疗可能意味着什么

该研究表明,现今的多模态 AI 系统已能作为口腔疾病显微诊断中的可靠辅助工具。它们并不能替代病理学家——后者仍保持最高的总体准确率并提供不可或缺的临床判断——但可以作为快速的第二读片者,支持新专家的培训,或在牙科病理服务匮乏的地区提供专家级协助。因为研究使用的是精心挑选的教科书图像,而非真实世界中更杂乱的样本,作者强调还需要在更大、更多样化的临床样本以及加入患者信息的条件下进行更多测试。如果这些进一步验证确认了早期的良好迹象,AI 有望使口腔疾病的诊断对全球患者而言更加准确、一致且可及。

引用: Alshammari, A.F., Madfa, A.A. & Anazi, B.A. Human versus artificial intelligence in oral pathology diagnosis: a comparative study of ChatGPT, Grok, and MANUS. Sci Rep 16, 11057 (2026). https://doi.org/10.1038/s41598-026-40792-0

关键词: 口腔病理学, 数字病理学, 人工智能, 大型语言模型, 组织病理学诊断