Clear Sky Science · zh

在胶质瘤分级预测中使用偏差缓解技术平衡公平性与性能

为何以公平对待肿瘤很重要

当医生使用人工智能来辅助诊断脑肿瘤时,人们可能会以为计算机是中立的。但如果用于训练这些工具的数据反映了现有的健康不平等,软件就可能在不知不觉中对某些患者不公平。此研究考察了用于预测胶质瘤严重程度的机器学习系统——胶质瘤是成人常见的一类脑肿瘤——如何无意中倾向于某些种族或性别群体,并测试了在不显著牺牲准确性的前提下使这些预测更公平的实用方法。

脑肿瘤与计算机辅助

胶质瘤的生长速度和可治疗性从较慢、较易控制的类型到侵袭性强、预后差的癌症不等。正确分级这些肿瘤至关重要,因为分级指导外科、放疗和药物治疗。研究人员使用了一个包含839名成年患者的公共数据集,这些患者被确认为低级别胶质瘤或侵袭性胶质母细胞瘤(glioblastoma)。对于每位患者,数据包含年龄、性别、种族和肿瘤中20个常见基因标志物。他们用这些特征训练了三种标准预测模型——逻辑回归、随机森林和梯度提升——来区分两类肿瘤等级,然后既检验模型的整体准确性,也评估模型对不同患者群体的对待情况。

寻找隐藏的不平衡

为探查公平性,研究组聚焦于两个“受保护”特征:种族(白人 vs. 非白人)和性别(男性 vs. 女性)。数据集中本身存在偏斜——超过90%的患者为白人,且男性明显多于女性。作者采用了组级公平性度量,比较不同群体获得正确“高级别”预测的频率,以及模型对各组犯错的频率。三种模型的总体准确度都相当高,其中逻辑回归表现最好。但在这种成功的表象之下,公平性检查显示非白人患者的结果总体上比白人差,尤其是在正确识别低侵袭性肿瘤方面。相比之下,男女间的表现更为平衡,只存在较小的差异。

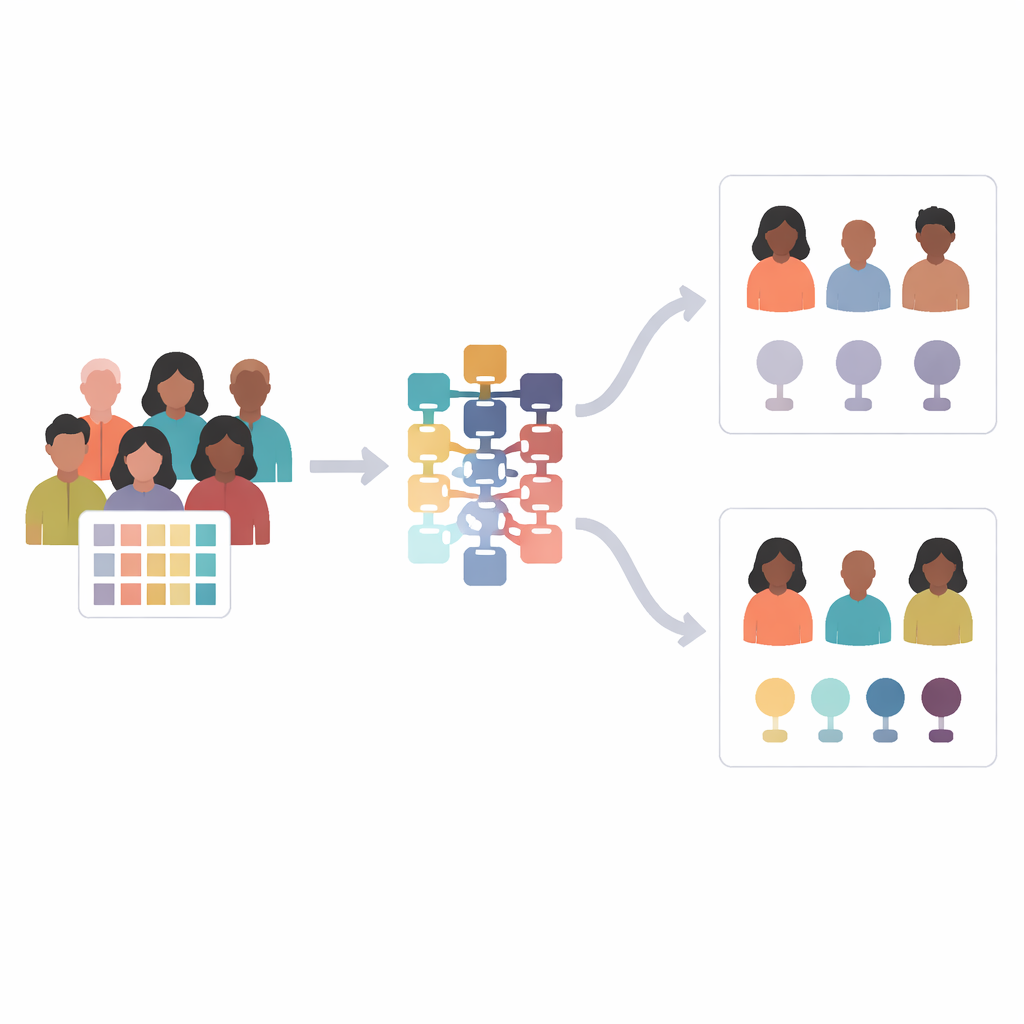

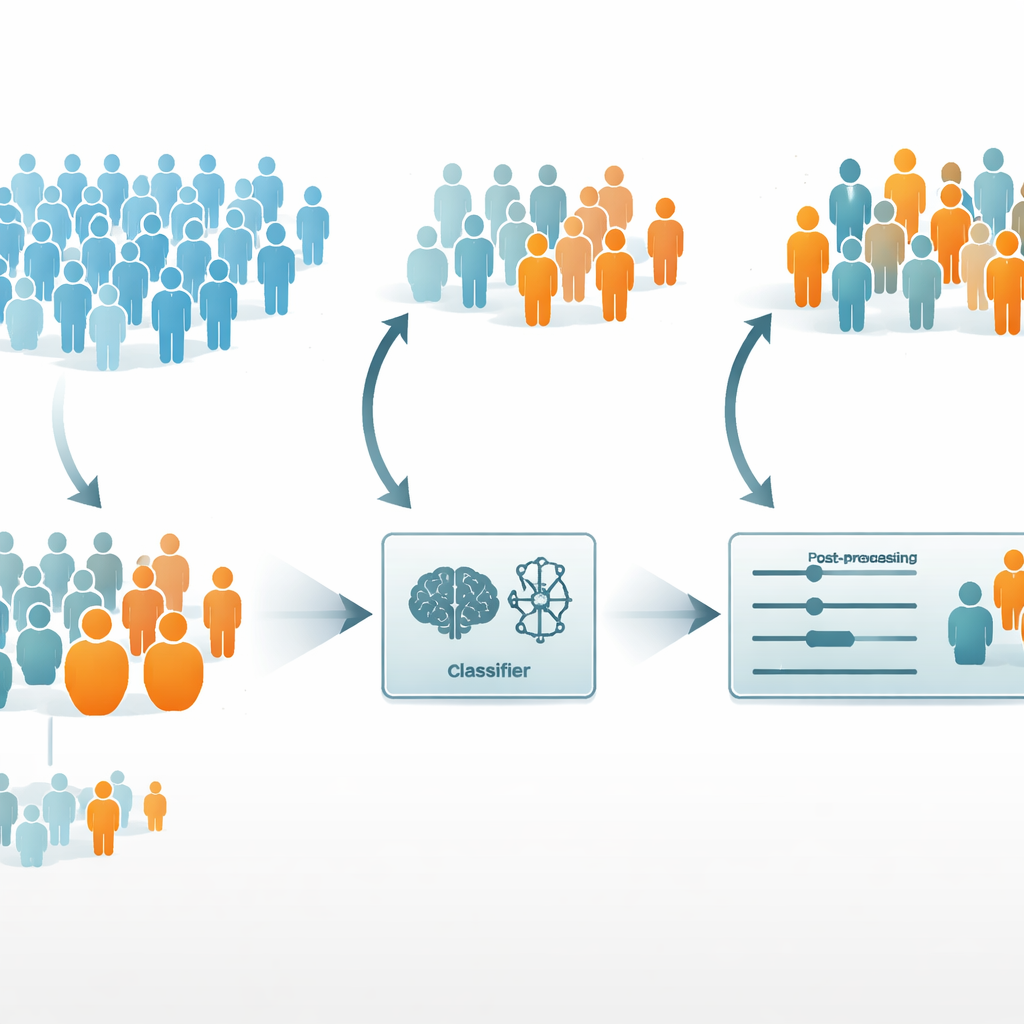

尝试修正偏差

研究人员接着探讨是否可以在不严重削弱模型医疗实用性的情况下改善公平性。他们选择逻辑回归作为基模型,因为它在三者中既最准确又最公平。他们尝试了两种常见的去偏方法。一种称为重加权的“预处理”方法在训练时给予代表性不足的患者更高的权重,以便模型更多关注这些患者。另一种为“后处理”方法——等化机会(equalized odds)——保留已训练模型,但调整其输出,使各组的错误率更为接近。

调整模型后发生了什么

针对性别,两种策略总体上都有帮助:女性的预测质量有所提高,男女之间的差距大幅缩小。针对种族——数据不平衡更严重的情形——情况则更为复杂。重加权有时适得其反,微弱地降低了非白人患者的表现,且根据某些度量甚至增加了不公平性。相比之下,后处理方法在大幅减少种族间错误率差距的同时保持了模型的总体高准确性,尽管它确实稍微降低了多数群体的性能。作者还表明,对于规模远小的非白人群体,公平性指标具有统计不稳定性——仅改变一个人的预测就可能显著改变公平性得分——因此这些结果必须谨慎解读。

这对患者和医生意味着什么

研究得出结论:并没有免费午餐——在医疗人工智能中改善公平性往往伴随性能上的权衡,最佳修正方法取决于数据偏斜的程度以及优先的公平目标。在这个脑肿瘤的例子中,训练后调整模型输出是使不同种族和性别间的治疗建议更均衡的最务实方法,同时保持了强大的预测能力。这项工作强调,在将人工智能部署到医疗领域时,尤其是针对像胶质瘤这样严重的疾病,应常规进行公平性检查,并且存在可使这些工具更公平的方法——但必须慎重选择并解读这些方法的结果。

引用: Sánchez-Marqués, R., García, V. & Sánchez, J.S. Addressing the balance between fairness and performance in glioma grade prediction using bias mitigation techniques. Sci Rep 16, 9785 (2026). https://doi.org/10.1038/s41598-026-40555-x

关键词: 胶质瘤分级, 医疗人工智能公平性, 算法偏差, 脑肿瘤, 偏差缓解