Clear Sky Science · zh

教育领域可解释的人工智能:将教育领域知识整合到深度学习模型以改进学生成绩预测

为何更聪明的学生预测至关重要

学校越来越多地借助人工智能来识别可能遇到困难、需要额外支持的学生。但当这些系统像封闭的黑箱一样运作时,它们可能会凸显出奇怪的模式——例如把一个青少年的情感生活比作学习时间看得更重要——这会让教师和家长无法判断是否应信任结果。本文展示了如何构建一个学生成绩预测系统,该系统不仅能更准确地预测数学成绩,而且还能以与几十年教育研究相符的方式“推理”。

从原始数据到风险警报

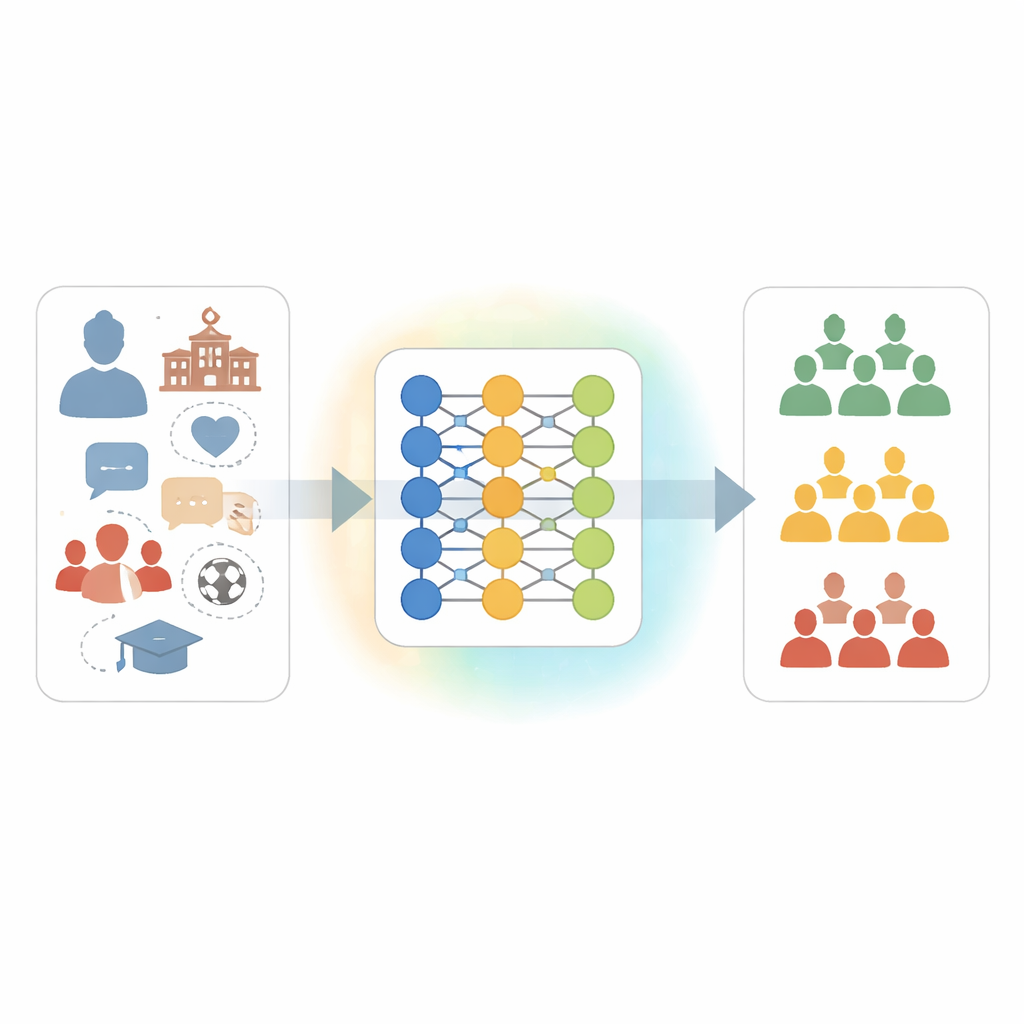

研究人员使用了一个知名的公开数据集,包含395名葡萄牙高中生,每名学生由30条信息描述。这些信息从基本人口统计(年龄、性别、家庭人数)到与学校相关的细节(学习时间、缺勤、补习)以及社会生活和福祉方面(家庭关系、自由时间、与朋友外出)不等。目标是预测每个学生的期末数学成绩,并将他们分成三类实用组别:可能不及格、正常水平或表现优秀。研究团队训练了一个称为人工神经网络(ANN)的深度学习模型,以捕捉这些因素之间的细微模式。

当黑箱出错时

尽管原始的人工神经网络达到了相当的准确率,但深入检查暴露出令人不安的情况。作者使用一种现代解释技术(称为SHAP)来分析模型最依赖哪些特征。部分最强的信号与已有的教育研究结论相冲突。例如,学生就读的学校、他们的恋爱状况以及外出频率被赋予异常重要的影响,而有研究支持的因素(如父母的教育程度、母亲的职业、早期托儿经历、家庭规模和每周学习时间)却被赋予意外较小的权重。这些不匹配表明该ANN可能在依赖这个特定数据集的特殊性,而非教育工作者认为有意义或公平的关系。

教会网络教育者已知的知识

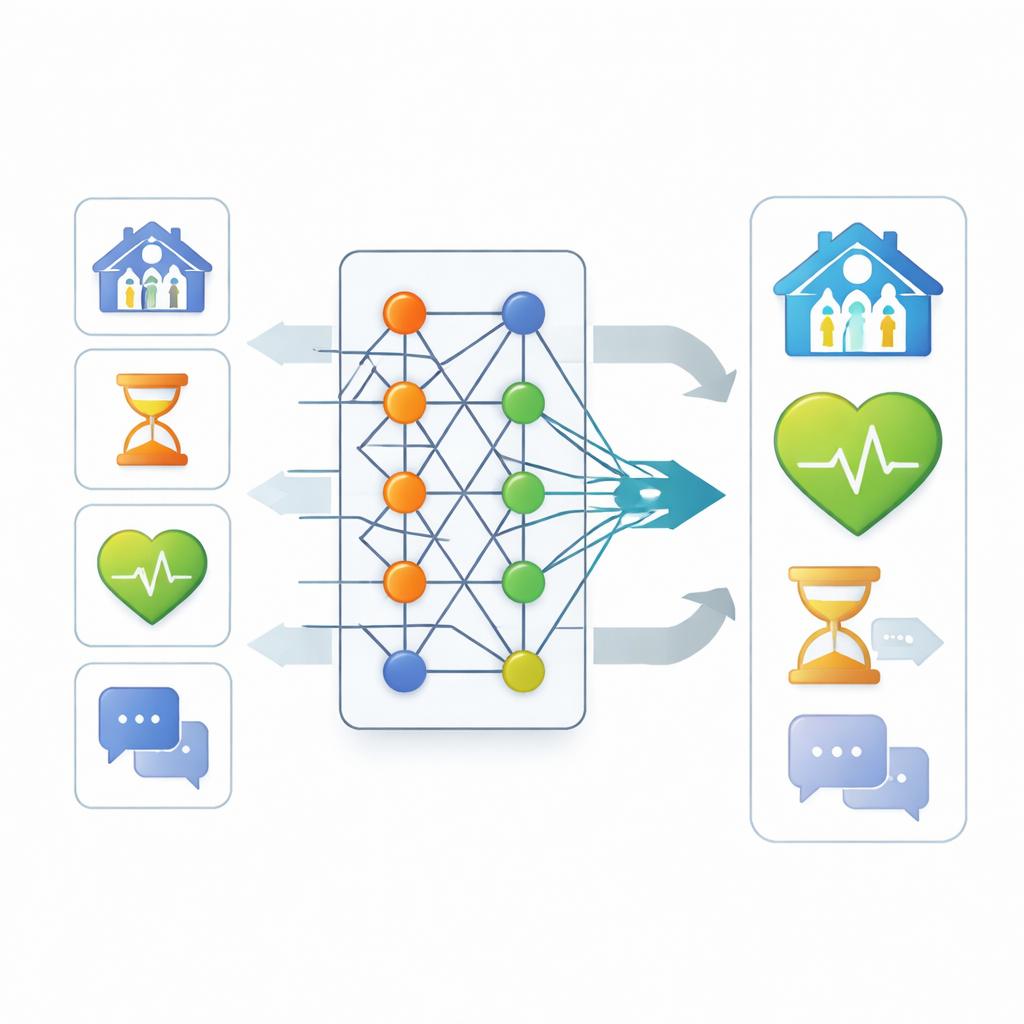

为使模型与教育洞见重新对齐,作者提出了一种新的训练策略,称为学生表现预测解释(SPPE)算法。首先,他们查阅教育文献,将特征大致分为两类:一类是与学业成绩持续相关的特征(如学习时间、父母教育水平和升学意愿),另一类是较弱或不确定的预测因子(例如恋爱状况或一般性的家庭关系评分)。在训练过程中,SPPE引导神经网络增加对第一类特征的依赖,同时削弱对第二类的依赖。其做法是监控每个特征对预测的贡献,并在网络学得的重要性模式偏离这些领域知识时,加入温和的惩罚项。

更清晰的解释与更精准的预测

在SPPE调整后,模型的内部推理发生了变化,更符合教育者的预期。学习时间、父母背景、家庭规模和早期入学的重要性上升,而学校身份、外出和恋爱状况的重要性变得不那么主导。同样重要的是,这种重新对齐并没有以牺牲准确率为代价——相反还能提升准确度。在预测学生属于哪三个成绩区间时,改进后的网络正确分类了大约三分之二的学生,而原始模型仅略高于三分之一。精确率、召回率和综合的F1分数等标准指标均显著上升,统计检验也证实这些提升不太可能是偶然所得。作者还显示出相同的SPPE策略能改善多种其他神经网络结构,表明该方法具有稳健性,而非一次性技巧。

这对课堂和人工智能意味着什么

对于教育工作者和政策制定者而言,这项研究提供了一种方法,避免在准确但不透明的模型与透明但弱势的模型之间的尴尬抉择。通过将人类专业知识织入学习过程,SPPE产生的预测既更可靠也更容易说明:学习投入和长期教育志向比学生恰好就读哪所学校更重要。尽管该研究聚焦于葡萄牙的一个数学数据集,但更广泛的信息是:可解释且受知识引导的人工智能可以支持更好、更公平的学生支持决策——前提是从一开始就融入本地情境和专家判断。

引用: Qiang, M., Liu, Z. & Zhang, R. Explainable AI in education: integrating educational domain knowledge into the deep learning model for improved student performance prediction. Sci Rep 16, 9515 (2026). https://doi.org/10.1038/s41598-026-40538-y

关键词: 学生成绩预测, 可解释的人工智能, 教育数据挖掘, 教育中的神经网络, 领域知识整合