Clear Sky Science · zh

基于颜色空间融合变换器的菊花分类

为什么花的产地和颜色真的很重要

菊花不仅仅是秋季花束里的漂亮花朵。在中国,它们还是经典的草药和重要的经济作物,但其药用功效和市场价格在很大程度上取决于品种和生长地。如今,要区分不同的药用菊通常需要专家的目光、化学检测或基因分析——这些方法既慢又昂贵,也难以在田间使用。本研究提出了一种基于相机的办法,仅通过图片就能让计算机快速且准确地对菊花进行分类,方法的关键是在一种新的方式下非常仔细地观察颜色。

以相机的方式看花

大多数数字照片以红、绿、蓝(RGB)的混合来存储颜色。这对于显示很有效,但并不总是与人类对亮度和微妙色差的感知一致,尤其在光照变化时。作者把常见的菊花头部RGB图像——尤其是花的背面,因其包含丰富的结构和色彩线索——转换为另一种颜色空间LAB。在LAB中,一个通道表示亮暗变化,而另外两个通道描述颜色沿红-绿和黄-蓝方向的差异。通过同时在这两种系统中工作,该方法既保留了原始照片的细节,又捕捉到了在人类感知上更稳定的色彩差别,从而更好地区分相似花朵。

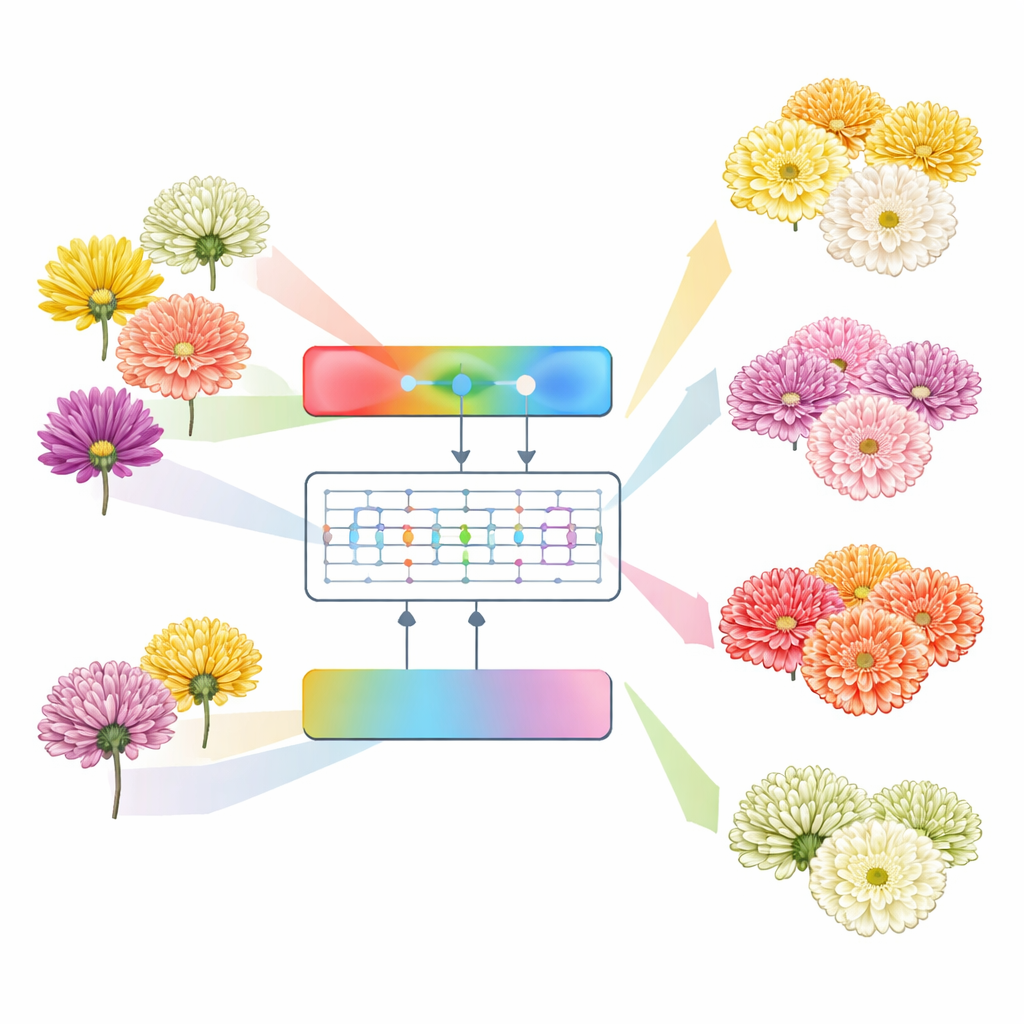

同一朵花的两条并行视角

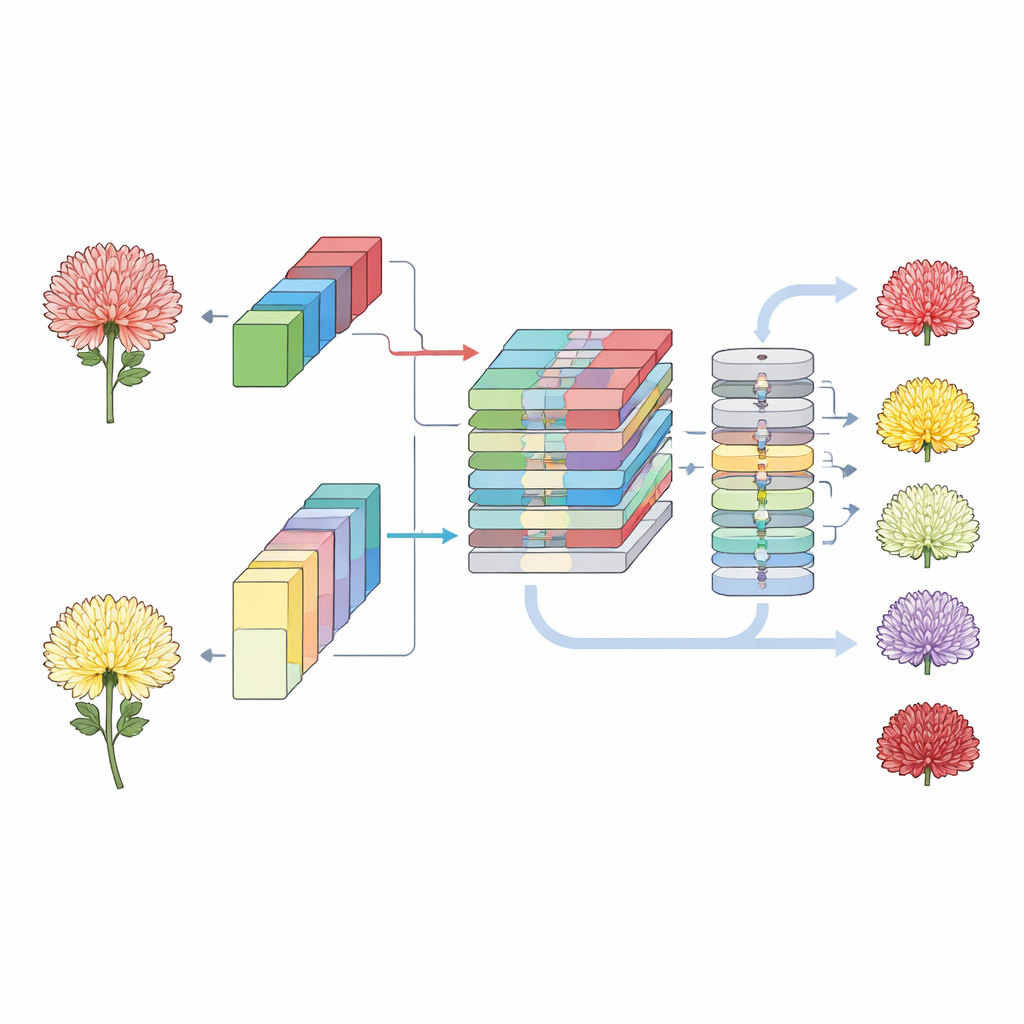

为了充分利用这些互补视角,研究者设计了一种“多路径”网络——本质上是两条并行的专家通道。一条通道研究每张图像的RGB版本,另一条分析LAB版本。每条通道由现代卷积模块构成,这是一类擅长提取边缘、纹理和形状的深度学习结构。浅层关注花瓣轮廓和小纹理模式,而更深的层则概括更广泛的结构。在若干阶段,网络通过堆叠它们的特征图来融合各通道所学到的信息。这使模型能够在更清晰的RGB轮廓与在光照上更稳健的LAB色彩结构之间权衡,将二者组合成对每朵花更丰富的内部表征。

让注意力机制发现关键细节

在并行通道将花朵图像提炼为紧凑特征图之后,第二类模型接管工作:视觉变换器。变换器最初为语言任务发明,擅长捕捉长程关系,现在在图像分析中也越来越重要。在这里,融合后的菊花特征被切成许多小补丁并输入变换器,变换器使用“注意力”机制决定哪些补丁对于区分品种最为重要。这种全局视角帮助网络将花瓣基部的微妙色差与花盘更外侧的图案联系起来,从而对每朵花的类型和产地做出更可靠的判断。

将系统付诸测试

研究团队收集了大量图像:超过9,000张来自18个菊花品种和15个产地的正反面照片,其中某些品种——如杭白菊——在许多不同产地都有样本。他们在该数据集上训练并评估模型,并将其与在图像识别中广泛使用的若干知名深度学习架构进行了比较。结果引人注目:在处理背面视图图像时,该新方法在他们自建的菊花数据集上达到了约96–97%的准确率,在一个标准的公开花卉图像基准上则超过99%。它优于多种强劲对手,包括纯卷积网络和纯变换器模型,不仅准确率高,而且在多个菊花类别上表现稳定。

这对种植者和药用植物意味着什么

通俗地说,研究表明经过精心设计的图像分析系统可以匹配——在某些情况下甚至超过——更复杂的实验室方法在识别药用菊方面的可靠性。通过将两种颜色表示方法与两类互补的神经网络结合,该方法能够识别出区分产自不同地区的相似花朵的细微视觉线索。这可以支持市场中的快速质量检验,帮助追踪干花头的真实来源,并最终扩展到其他需要精确品种鉴别的药用植物。随着这些工具从实验室走向手持设备或分拣机器,它们有望把专家的“训练有素的眼睛”带到药用植物种植、交易或处方的任何地方。

引用: Jiang, J., Yang, X., Wang, T. et al. Chrysanthemum classification via color space fusion transformer. Sci Rep 16, 9397 (2026). https://doi.org/10.1038/s41598-026-40027-2

关键词: 菊花分类, 植物图像识别, 颜色空间融合, 视觉变换器, 药用草本