Clear Sky Science · zh

使用来自全景图像的伪激光雷达在光照变化下实现鲁棒位置识别

永不在黑暗中迷路的机器人

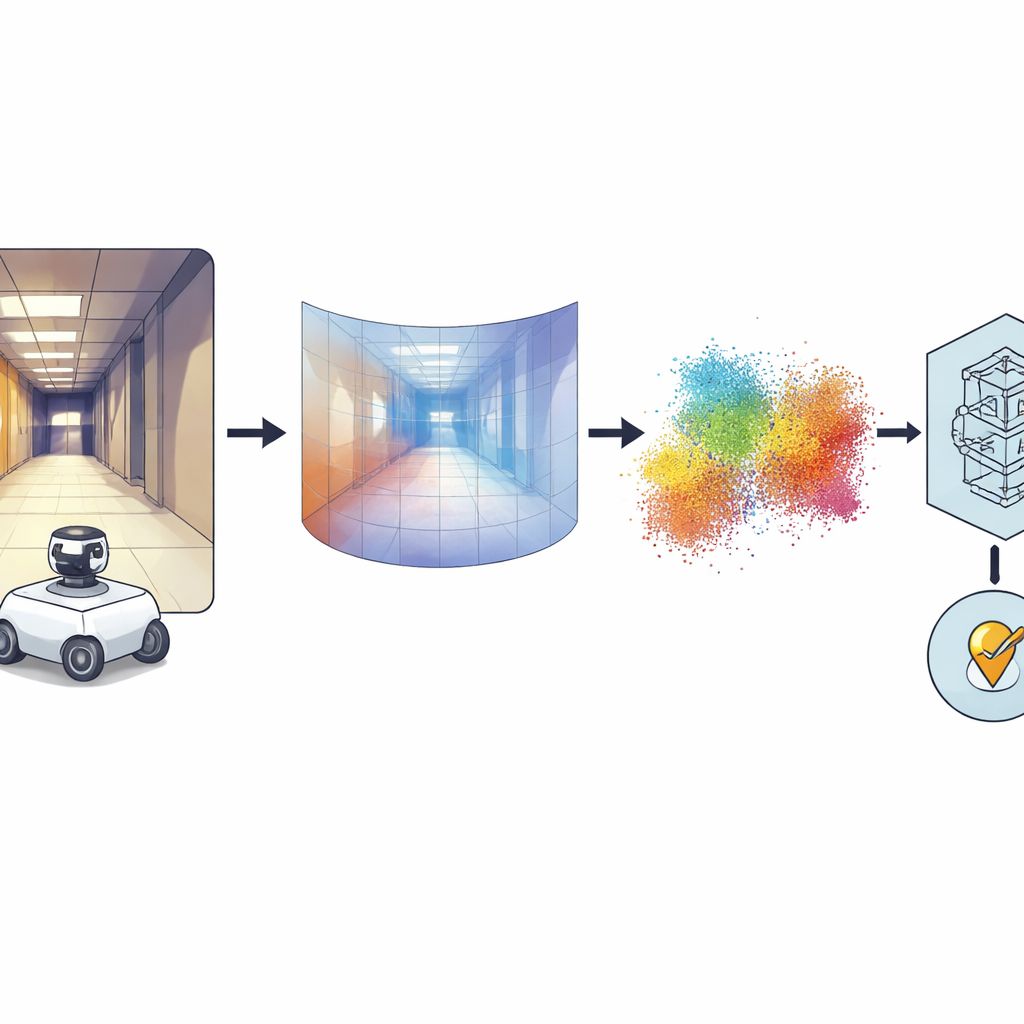

设想一台机器人,无论是在窗外阳光充足的正午,还是在只有几盏灯亮着的深夜,都能识别出自己在建筑中的位置。本文提出了一种新方法,仅用一台相对廉价的相机就能赋予机器人这种可靠的地点感。通过把平面图像转换为三维信息,研究人员使机器人导航对阴影、眩光以及通常会干扰基于视觉系统的其它复杂光照变化的敏感性大大降低。

为什么重复识别同一地点很难

对机器人来说,“位置识别”意味着意识到“我以前来过这里”,从而能够在地图上定位并安全导航。传统系统要么依赖常规相机,要么依赖被称为 LiDAR 的激光测距传感器。相机价格低、能捕捉丰富的颜色与纹理,但在阴天、晴天与夜间场景下视图变化极大。LiDAR 因为直接测量距离而更加稳定,但体积大、价格高。一些机器人把多种传感器结合起来,但这会提高成本和系统复杂度。本文作者走了另一条路:硬件保持简洁,仅使用一台能环视周围的全景相机,并通过软件升级让机器人基于三维结构而非原始外观来推理。

从全景照片到三维形状

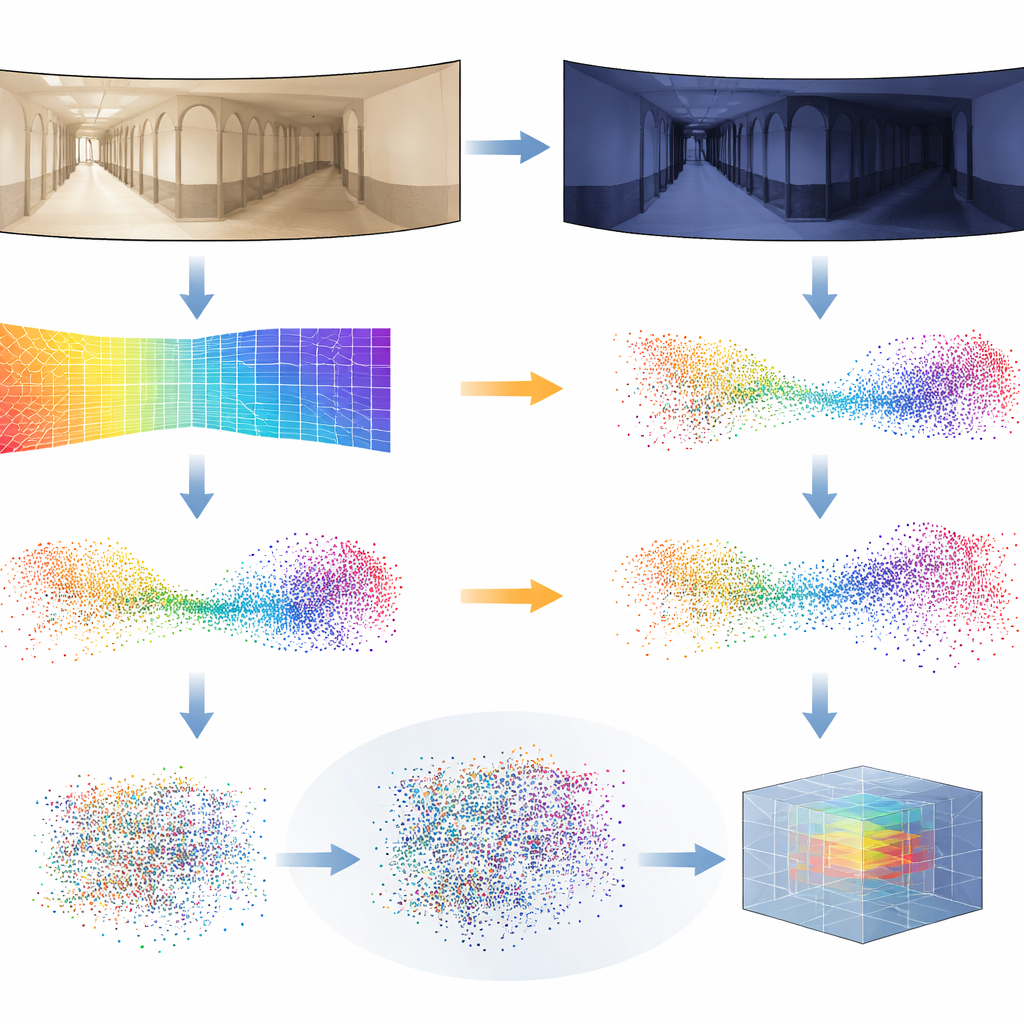

关键思想是把每张全景图像转换为密集的深度图,使每个像素都编码该场景部分到相机的距离。为此,作者依赖一个强大的“基础”模型,称为 Distill Any Depth,它已经从海量图像中学会了推断深度。得到的深度图随后被转换为三维点云——一种虚拟的 LiDAR,或称伪-LiDAR——无需真实的激光扫描仪。额外的处理步骤清理了用于 360 度相机的特殊镜头引入的伪影,从而填补缺失或被遮挡的区域。最后,一个名为 MinkUNeXt 的神经网络(专为直接处理三维点云而设计)将每个点云压缩为捕获场所总体布局的紧凑指纹。

教系统忽略光照诡计

深度估计并不完美,尤其是在光照从一种情形剧烈变化到另一种情形时。为使系统鲁棒,研究人员引入了一种新的训练技巧,称为蒸馏深度变体(Distilled Depth Variations)。他们不信任单一深度模型,而是有意混入来自多个较小、精度较低的深度估计器的预测。此受控“噪声”模拟了在不同光照条件下出现的失真,迫使三维网络学会区分场所几何结构中真正重要的内容和可被忽略的部分。研究者还为每个三维点补充了关于图像边缘和纹理强度的信息——这些特征相对于原始颜色在光照变化下更为稳定。

在现实世界中证明其有效性

为了测试他们的方法,团队使用了要求很高的室内机器人行驶公开数据集。在这些数据集中,机器人在阴天的白昼、强烈阳光下以及夜间多次穿行走廊和房间,同时家具和人员会移动。作者仅用一栋建筑的阴天图像训练他们的系统,然后在所有建筑和光照条件下进行了评估,包括系统从未见过的场景。他们的伪-LiDAR 方法在性能上稳定地与领先的二维图像方法以及其他三维系统相匹配或优于它们,尤其是在最困难的情况下,如夜间运行或迁移到全新环境时。他们还展示了相同的流水线可以与普通前向摄像头配合工作,而不仅限于全景摄像头,只需替换合适的深度到三维的投影即可。

这对未来机器人意味着什么

通俗地说,这项工作表明,机器人仅凭一台相机和巧妙的软件就能获得类似 LiDAR 的环境感知。通过关注三维结构而非易变的光照与颜色细节,系统可以在白天、夜晚和天气变化中可靠地识别地点,同时保持硬件简单且价格可承受。这可能让健壮的室内导航对服务机器人、仓储车辆和辅助设备更为可及,并为未来将深度与更高级的场景理解相结合以实现更可靠自主性的发展铺平道路。

引用: Cabrera, J.J., Alfaro, M., Gil, A. et al. Robust place recognition under illumination changes using pseudo-LiDAR from omnidirectional images. Sci Rep 16, 8817 (2026). https://doi.org/10.1038/s41598-026-39848-y

关键词: 机器人定位, 3D 视觉, 位置识别, 深度估计, 全景相机