Clear Sky Science · zh

使用动态置信传播与自适应归一化校准深度分类器

为何信任人工智能的置信度很重要

现代人工智能系统不仅会告诉我们它们认为图像或传感器读数中有什么——它们还会输出自身的确信程度。这样的自我报告置信度在医疗影像、自动驾驶或工业监测等关系安全的场景中至关重要,因为错误的自信可能带来危险。然而,现有深度神经网络以在错误上过度自信而臭名昭著,而且已有的修正方法在数据不平衡或来自变化环境时往往失效。本文提出了一种新方法,称为具有交替归一化的动态置信传播(DCP‑AN),旨在使 AI 系统的置信度评分在现实且变化的条件下更诚实、更稳定且更高效。

当智能机器过于自信时

大多数流行的深度学习模型的训练目标是预测正确标签,而非评估每个预测有多可靠。因此,网络可能会“确信”某张图片是猫的概率为 99%,但实际上那是一只狗。诸如温度缩放或将预测划分为置信区间等标准校准技术,试图在训练后通过全局调整来修正这一点。然而,这些方法对所有类别和所有样本一视同仁。在现实世界中,数据很少是平衡的:少数常见的“头部”类别拥有大量样本,而稀有的“尾部”类别可能只出现几次。网络往往在常见类别上过度自信,而在稀有类别上不足自信,这种差距是静态的一刀切校正无法弥合的——尤其当数据分布跨域变化时,例如从艺术素描到真实世界照片。

在数据与标签之间共享信息的新方式

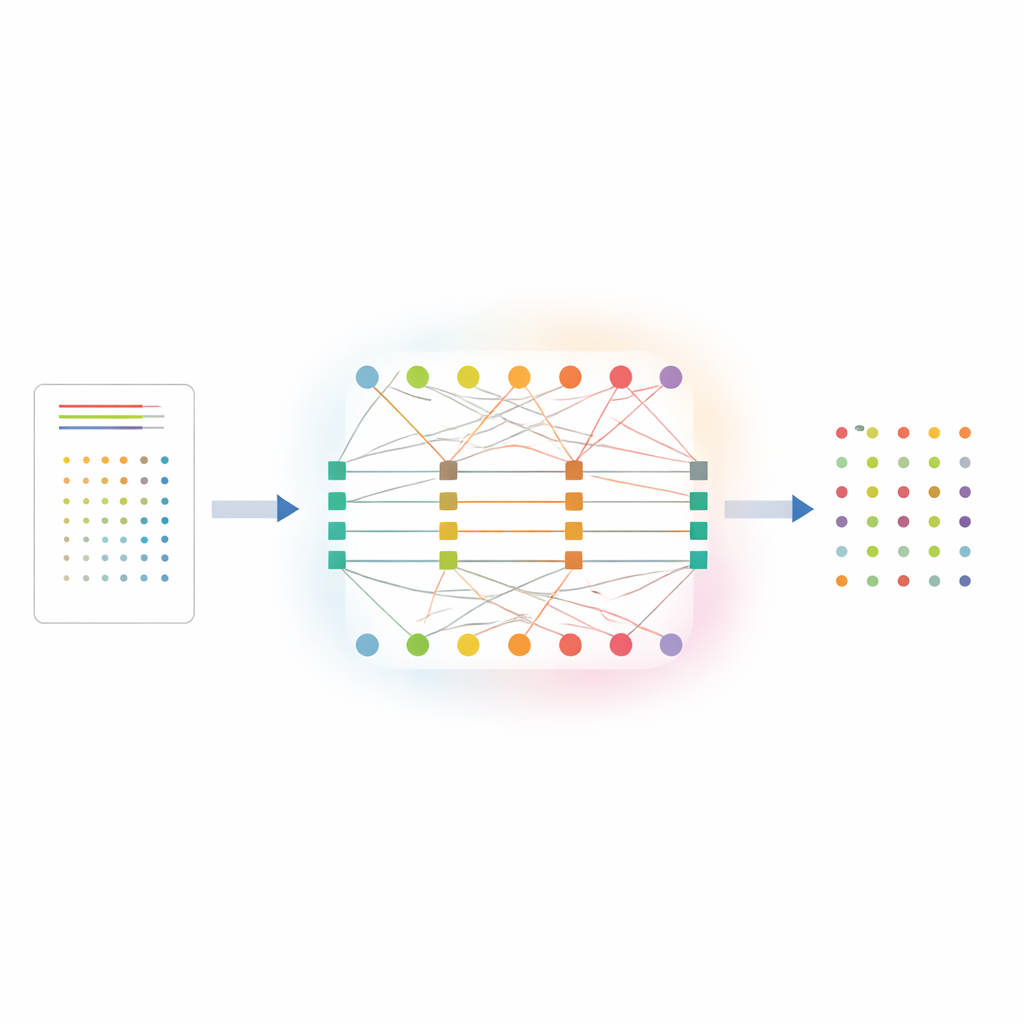

DCP‑AN 通过显式建模置信度应如何在单个样本与其所属类别之间流动来解决这一问题。该方法将样本与类别之间的关系表示为一个两层网络:一层是样本节点,另一层是类别节点,二者通过编码初始预测强度的加权连接相连。然后通过两步交替的过程来细化置信度。第一步,信息从样本流向类别,调整每个类别预测分布的尖锐程度,受该类别当前表现出的不确定性指引。第二步,信息从类别流回样本,根据与早期估计的一致性微调每个样本的置信度曲线。通过有限次数的往复迭代,该系统鼓励样本与标签之间更好的“协作”,使稀有类别获得更清晰的信号,而不会被常见类别淹没。

在需要的地方加大力度

DCP‑AN 的一项关键创新是自适应的“温度场”,它根据局部与全局的不确定性如何表现来改变方法重塑置信度的强度。该方法不使用对所有预测都相同的单一温度值,而是为类别和样本分别计算调整强度,基于随时间变化的不确定性和不匹配度量。对于网络已经较为自信的头部类别,有效温度会适度降低,防止过度平滑并保留清晰区分;对于尾部类别和模糊样本,温度会升高,允许更强的修正,在有理由时提升其置信度并抑制虚假的峰值。这种动态行为来源于有理论依据的更新规则,并被证明在不确定性增加时响应迅速,而在模型已很好对齐时保持稳定。

在任务与硬件上均能可靠改进

作者在若干广泛使用的图像数据集上对 DCP‑AN 进行了严格评估。在一个长尾版本的 ImageNet 上,其中某些类别的图像数量比其他类别多出数百倍,该方法使稀有尾部类别的准确率提高约 10 个绝对百分点,并使常用校准误差指标相比未经校正的基线减少超过一半。在一个将训练于艺术作品的模型迁移到真实世界照片的跨域测试中,DCP‑AN 不仅提高了新域的准确率,还减少了源域与目标域数据之间差距的统计度量。重要的是,这些收益并不以高昂计算代价为代价:在一块现代显卡上运行时,该方法仅增加刚超过一毫秒的延迟和不到半兆字节的额外内存,使其对实时与边缘设备保持实用性。

这对日常人工智能意味着什么

简而言之,这项工作表明我们可以让人工智能系统不仅更聪明,而且在可能出错时更具自知之明。通过让置信度信息在样本与类别之间来回流动,并根据变化的不确定性自适应地调整修正力度,DCP‑AN 提供了更符合现实的概率估计——即便是对稀有事件和跨域变化也是如此。由于其迭代更新具有收敛性的数学保证,且运行开销极小,该框架可以插入现有神经网络中用于医疗、机器人或安全监控等领域。结果是 AI 仍会犯错,但在确信程度上更诚实——这是朝着人们可以安全信赖的系统迈出的关键一步。

引用: He, P., Fu, W., Wang, L. et al. Calibrating deep classifiers with dynamic confidence propagation and adaptive normalization. Sci Rep 16, 10959 (2026). https://doi.org/10.1038/s41598-026-39842-4

关键词: 置信度校准, 深度神经网络, 长尾识别, 不确定性估计, 域自适应