Clear Sky Science · zh

使用同伦与替代模型的超参数优化灵活框架

为何调试人工智能“旋钮”至关重要

现代人工智能系统不仅依赖巧妙的算法和海量数据,还依赖一层出人意料地挑剔的设置,称为“超参数”。这些就是决定模型应有多大、学习速率如何、如何处理噪声数据的旋钮。设置不当可能会把有前景的系统变成失败品。本文提出了 HomOpt,一种在搜索空间巨大且混乱时更高效、更可靠地调整这些旋钮的新方法,对于希望以更少试错让 AI 表现更好的人来说颇具吸引力。

引导搜索的新途径

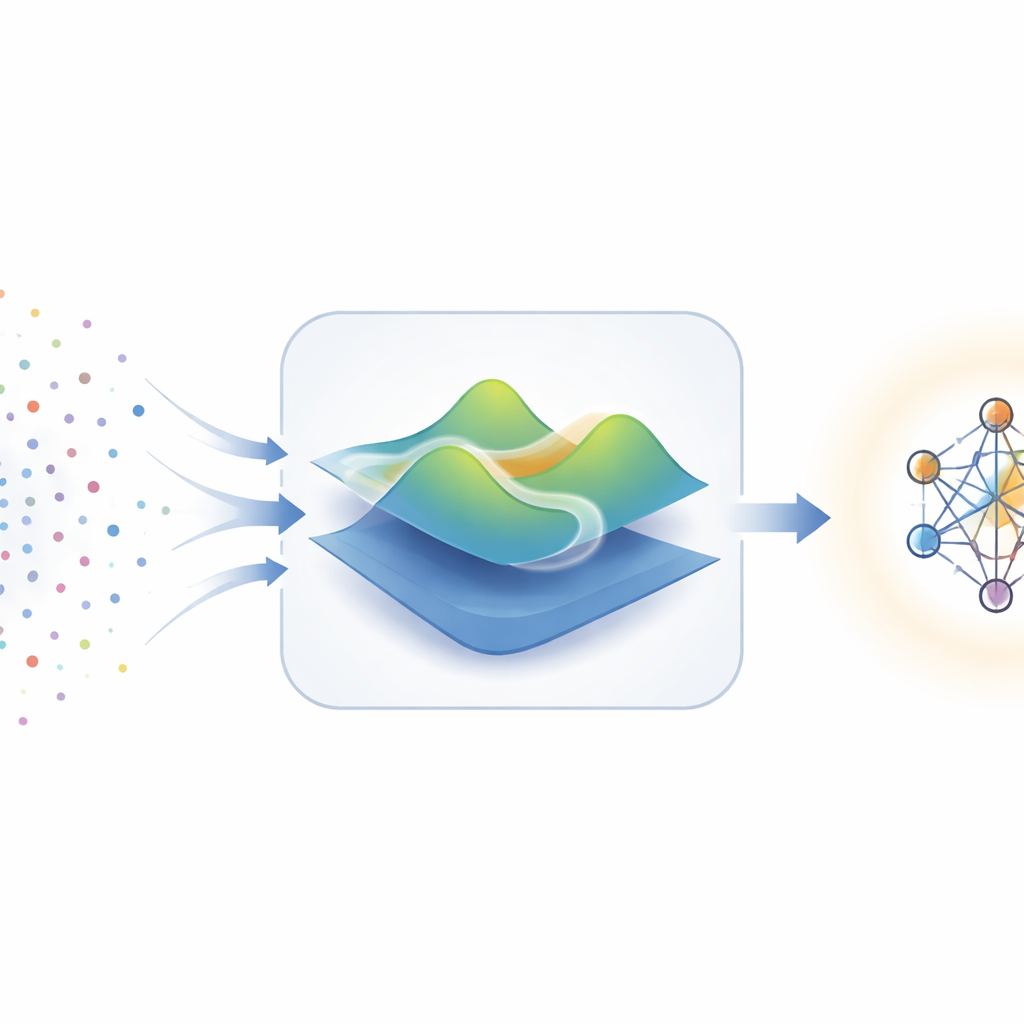

传统的超参数调优方法,如网格搜索或随机搜索,有点像把配方材料随意混在一起希望能做出好味道。更精细的方法,例如贝叶斯优化,试图通过构建一个粗略模型来推断设置如何影响性能,然后用该模型挑选下一组待试参数。但这些方法通常假设性能“地形”是平滑且良性的,而现实问题常常充满怪异、噪声和突变,远非如此。HomOpt 通过反复构建对真实地形的近似替代——称为替代模型(surrogate models)——来应对这一挑战,然后随着更多数据到来,将一个替代模型平滑地转换为下一个,同时追踪在该变换过程中最优解如何移动。

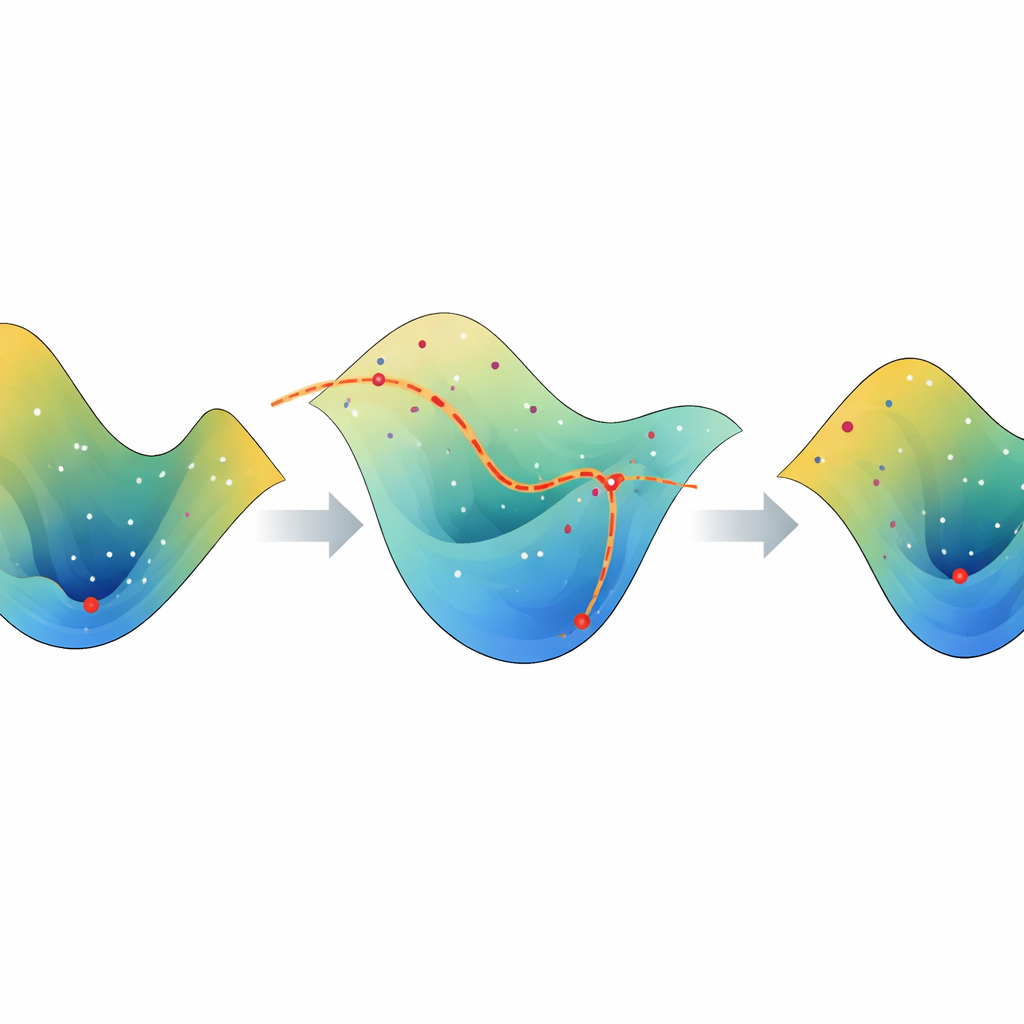

平滑变形模型,而不是重头开始

HomOpt 的关键思想来自一个数学概念——同伦(homotopy),简单来说,就是在不撕裂或跳跃的情况下逐步将一种形状变换为另一种形状。在该框架中,每个替代模型都是不同超参数设置如何影响模型性能的平滑图景。随着新实验结果被收集,HomOpt 构建更新的替代模型,并定义旧模型到新模型之间的连续变换。它不是丢弃已有工作并重新开始搜索,而是追踪旧表面上的最优点在这条变形景观中如何滑动,最终落到新表面上的一个良好点上。这种有引导的运动使搜索更有方向性、减少随机性,从而在更少步骤中更可能找到更好的设置。

适应不同类型数据的灵活工具

为证明该想法在实践中可行,作者在 HomOpt 中接入了两类截然不同的替代模型。首先使用广义加法模型(Generalized Additive Models),其平滑且较易解释,适用于设置与性能之间关系比较平缓变化的情形。其次使用 CatBoost,这是一种强大的集成方法,适合诸如图像识别等复杂、高维的问题。HomOpt 并不绑定于某一种替代模型;相反,它把替代模型视为可插拔组件,以匹配任务的难度和结构。该框架能处理连续、离散和类别型设置,并可在常见搜索策略之上运行,例如随机搜索、贝叶斯优化或基于树的方法,作为精化层而非替代品。

将方法付诸测试

研究者在多样的基准上评估了 HomOpt。在来自公共表格数据集的经典机器学习任务上,他们对支持向量机、随机森林、逻辑回归、多层感知机和梯度提升树等模型进行调优。他们还研究了具有挑战性的开放集识别问题(系统必须应对此前未见过的类别),使用了一种称为极值机(Extreme Value Machine)的专用分类器。最后,他们在针对 CIFAR-10 和类 ImageNet 数据集的神经架构搜索表上测试 HomOpt,那里的可能设计空间尤其庞大且崎岖。在许多这些场景中,HomOpt 要么加速了朝良好解下降的过程,要么在最终性能上优于单独使用底层方法,且常常使用更少的昂贵模型评估。

对日常 AI 实践的意义

对从业者而言,主要信息是 HomOpt 提供了一种结构化途径,使超参数调优变得更聪明,而不仅仅是更彻底。通过不断精炼对性能地形的近似图景,并平滑地追踪其最优点随图景改进而如何移动,该方法减少了无效搜索并更好地利用每一次模型运行。由于它可配合多种损失度量、模型类型和搜索策略,HomOpt 可以作为现有优化工具的通用附加组件。简单来说,它有望在相同计算预算下产出更准确、更鲁棒的 AI 系统——且能从小型表格问题扩展到大型复杂的视觉任务。

引用: Abraham, S.J., Maduranga, K.D.G., Kinnison, J. et al. A flexible framework for hyperparameter optimization using homotopy and surrogate models. Sci Rep 16, 9412 (2026). https://doi.org/10.1038/s41598-026-39713-y

关键词: 超参数优化, 替代模型, 同伦方法, 自动化机器学习, 神经架构搜索