Clear Sky Science · zh

AsynDBT:用于高效大模型情境学习的异步分布式双层调优

为什么更聪明的提示对日常 AI 至关重要

大型语言模型如今驱动着许多人每天使用的聊天机器人、搜索引擎和写作助手。但要得到有用的答案,仍然在很大程度上取决于我们如何表述问题以及向模型展示了哪些示例。本文提出了一种在多台设备上自动改进这些提示和示例的新方法,同时保护每位用户的数据隐私。其结果是一个能更准确、更高效响应的 AI 系统,特别是在电信网络维护等专业任务上表现突出。

通过示例教会 AI,而不是重训练

与不断重训庞大模型不同,日益流行的做法是在“当下”通过在提示中提供少量精心选择的示例来教模型——这一过程称为情境学习。例如,要将影评归类为正面或负面,你可以向模型展示一小组带标签的示例,然后要求它标注一条新影评。问题在于,示例的选择和指令的具体措辞会显著改变模型的表现。手工寻找好的组合既慢又昂贵,而且由于隐私规定,不同机构之间通常无法共享原始数据。

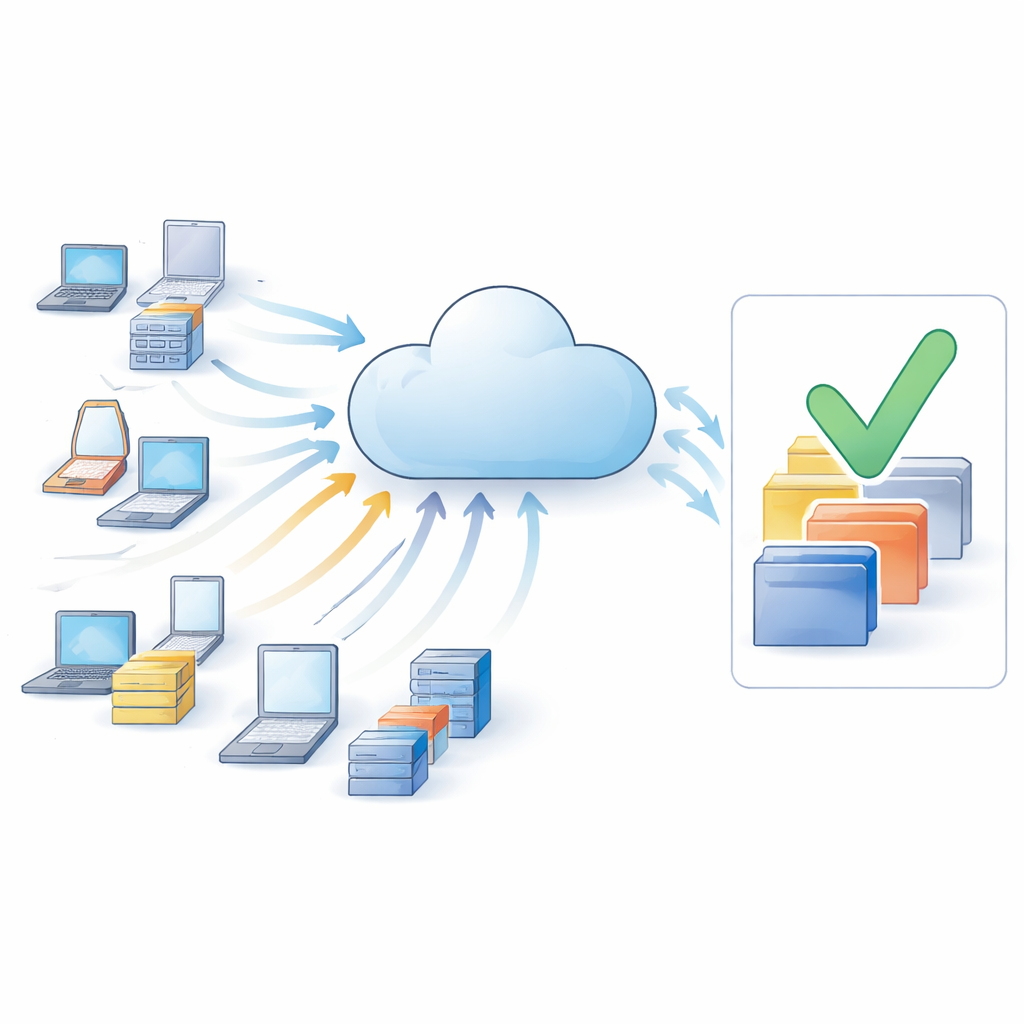

在不共享私有数据的情况下协作

为绕过数据共享壁垒,作者基于联邦学习构建方案,在这种设置中,许多独立设备或组织将数据保存在本地,但通过中央服务器协作。每个工作节点——例如电信基站或公司服务器——都与相同的云端语言模型交互,但从不上传原始文本。相反,它仅返回关于不同提示和示例选择效果的反馈信号。一种称为 AsynDBT(异步分布式双层调优)的新算法协调这些工作节点,使它们在尊重隐私并应对网络迟滞或不稳定的情况下,共同改进共享的提示策略。

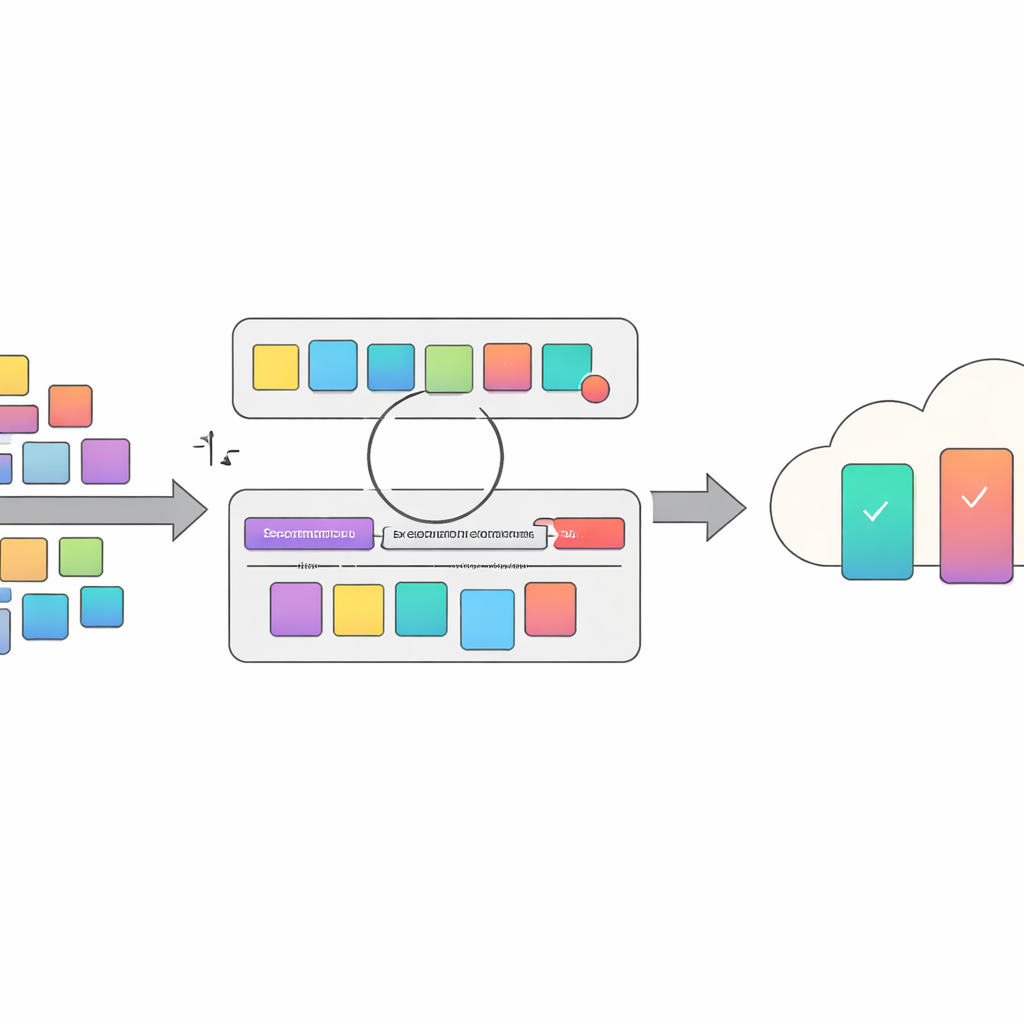

优化问题描述与示例两方面

论文的一个关键思想是将提示设计视为一个双层优化问题。在下层,系统调整附加到任务说明后的短文本片段——措辞的微小改变可以促使模型进行更好的推理。在上层,它决定应包含哪些带标签的示例作为演示。这两层相互作用:不同的示例集需要不同的提示调整,反之亦然。AsynDBT 将这种关系数学化,并采用高效的近似方法,使得每个工作节点能够逐步更新其本地选择,而中央服务器在下层决策上保持一致的全局视图。

应对慢响应设备和恶意参与者

在真实网络中,一些设备响应迟缓或掉线,形成会阻塞标准同步训练的“拖后腿者”。AsynDBT 则采用异步工作方式:服务器在收到一部分工作节点的汇报时就更新变量,而不必等待所有节点。该方法还防护可能发送误导性更新的节点,无论是恶意还是出于错误。通过将正则化技术与稳健的聚合规则相结合,算法减少了被投毒或低质量示例选择对全局策略的影响,从而在受到攻击时仍能保持系统稳定可靠。

在语言和电信任务上证明了效益

研究人员在六个文本分类问题上测试了 AsynDBT,其中包括一个苛刻的 5G 网络数据集,模型仅使用电信标准片段作为上下文就要判断专业术语是否相关。与多种现有的提示和示例选择方法相比,该新方法在几乎所有任务上都取得了最佳或次佳的准确率。尤其在 5G 任务上,相对于最强的基线方法,准确率提高了约十个百分点。同时,异步设计使训练时间比类似的非分布式集中方法大约减少了 40%。

这对未来 AI 工具意味着什么

对非专家而言,结论是更好的提示和更聪明的示例选择可以在不更改底层模型的情况下显著改善 AI 系统的表现。AsynDBT 提供了一种自动化、保护隐私的方式,在众多协作设备间实现这些改进,从而为电信运维、客户支持和其他专业领域带来更准确、更高效的语言工具。展望未来,作者计划将他们的框架与基于图的知识检索结合,使提示还可以利用最新的事实信息,进一步减少幻觉并在高风险场景中提高 AI 助手的可信度。

引用: Ma, H., Dou, S., Liu, Y. et al. AsynDBT: asynchronous distributed bilevel tuning for efficient in-context learning with large language models. Sci Rep 16, 9381 (2026). https://doi.org/10.1038/s41598-026-39582-5

关键词: 情境学习, 提示优化, 联邦学习, 大型语言模型, 隐私保护人工智能