Clear Sky Science · zh

在共焦自适应光学扫描激光眼底镜图像中使用合成数据与深度学习实现自动化视锥细胞检测

更清晰的活体眼部观察

逐个观察眼睛的感光细胞可能会彻底改变医生检测和跟踪致盲性疾病的方式。但目前,专家必须在放大很多倍的视网膜图像中手工精确标注这些细胞,这一过程既缓慢又带有主观性,难以扩展到成千上万的患者。本研究展示了如何用逼真的“假”眼图像训练计算模型,让它们自动识别这些细胞,从而为更快速、更可靠的眼部检查以及新疗法的更好评估打开了大门。

微小细胞为何重要

眼后部排列着光感受器——将光转化为大脑可解读信号的专门细胞。尤其是视锥细胞,对于清晰的中央视力和颜色识别至关重要,其丧失是许多视网膜疾病的标志性表现。一种强大的成像技术——自适应光学扫描激光眼底镜(AOSLO)可以在活体人眼中捕捉到这些细胞的详细图像。然而,在医生和研究人员能够测量视锥密度或跟踪随时间的变化之前,必须首先在图像中准确定位每个视锥。手工标注不仅极其耗时,而且不同人员之间可能存在差异,限制了其在常规诊所和大规模临床试验中的实用性。

从人工规则到数据驱动学习

早期的计算程序尝试通过遵循固定规则来自动检测视锥:例如查找具有特定大小或间距的亮点。这些基于规则的方法在来自健康眼睛的干净图像上可能效果不错,但当图像有噪声、略微模糊或来自患病患者时,往往表现不佳。深度学习提供了不同的策略。神经网络不是靠人工设计规则,而是从示例中直接学习模式。问题在于,这些模型通常需要大量已由专家仔细标注的图像——而这正是AOSLO成像中稀缺且昂贵的数据类型。

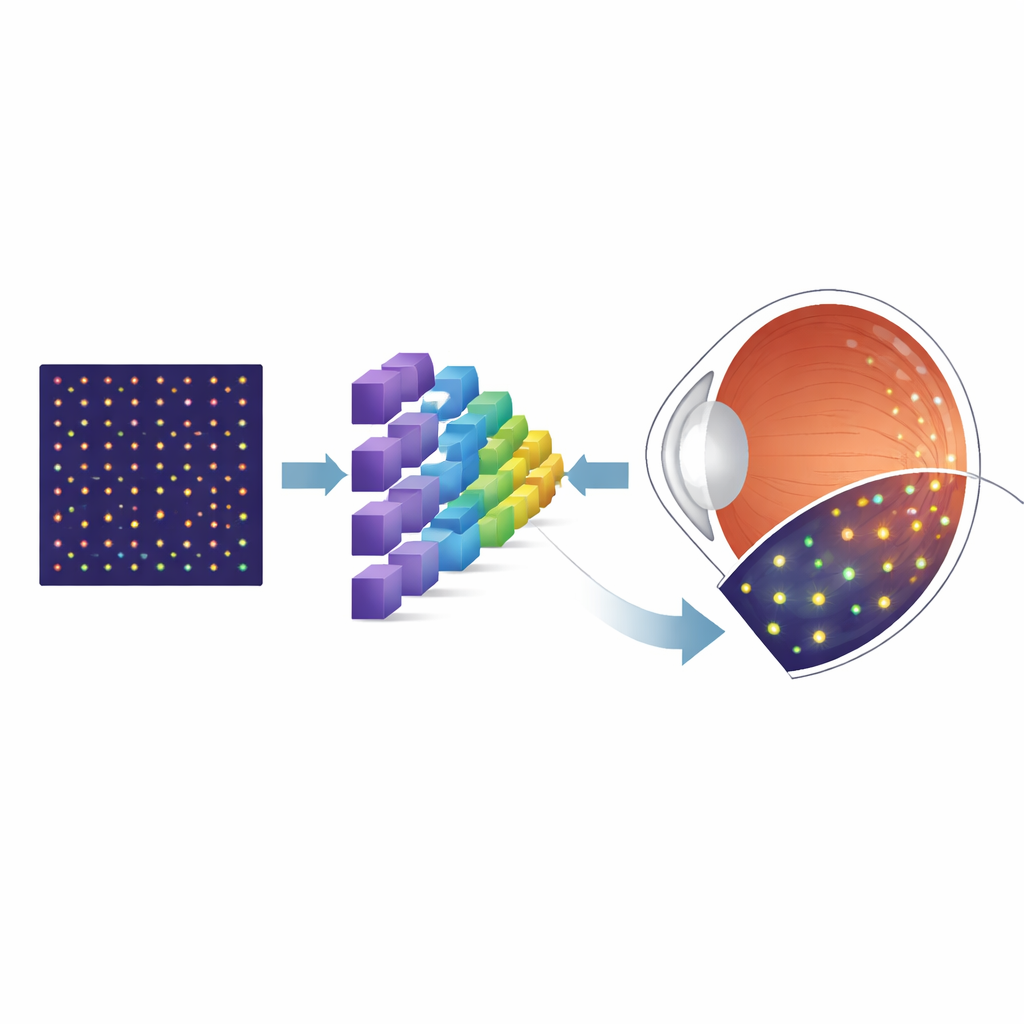

构建虚拟训练场

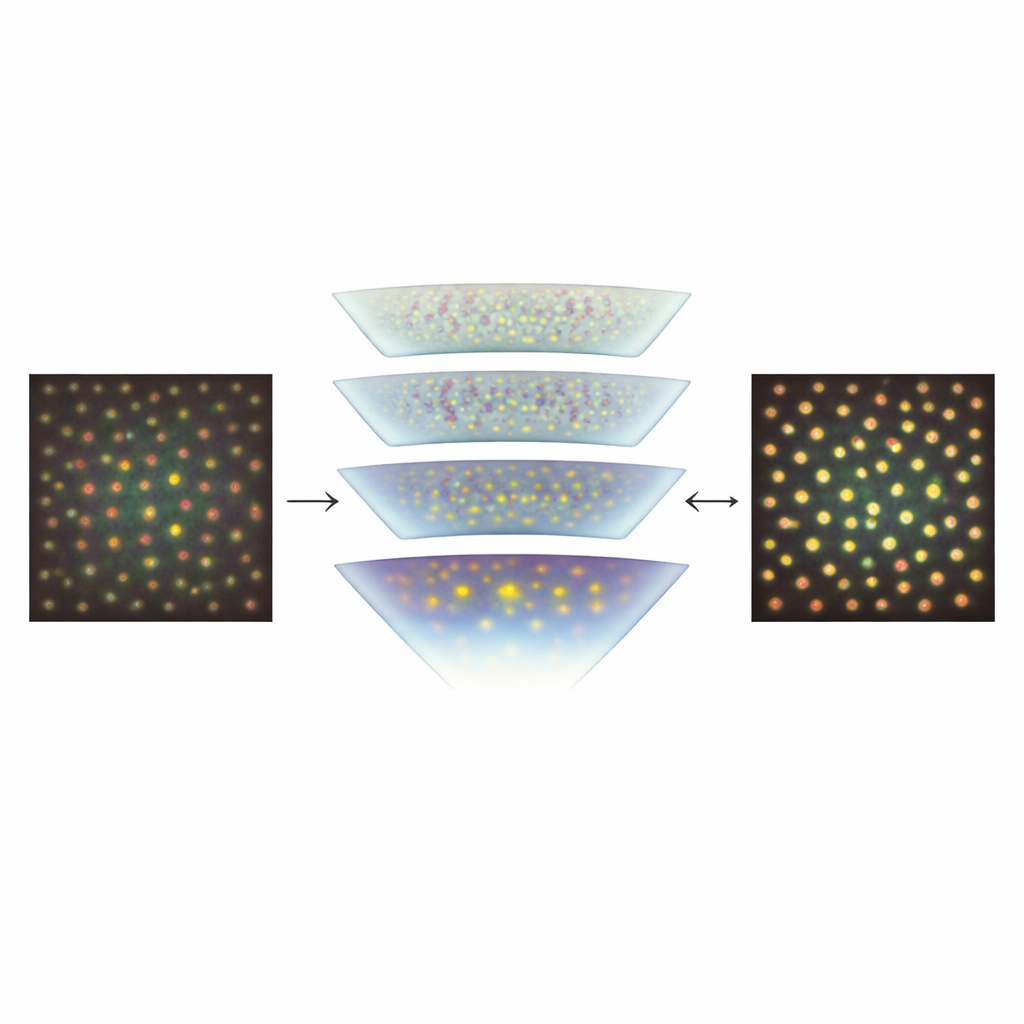

为绕过标注真实图像的短缺,研究人员转向了一个名为ERICA的仿真工具,它能够生成逼真的类AOSLO视锥镶嵌图像,并提供每个视锥的完美“真实标签”。他们创建了大量这样的合成图像,覆盖视网膜的不同位置,同时系统性地改变影响真实图像的关键缺陷,例如随机噪声和细微光学模糊。随后,他们训练了一种专门的神经网络架构,称为U-Net,将每张输入图像转换为一个概率图,显示视锥最可能出现的位置。在这一步使用合成数据进行初始训练后,团队又使用一个规模小得多的来自知名公共数据集的真实AOSLO图像对模型进行了微调,最后在另一个实验室的独立图像上进行了测试,以评估模型的泛化性能。

计算机与人类专家的匹配程度

团队将其自动化方法与繁复的人工标注及两种领先的视锥检测算法进行了比较。使用预测与人工标注重叠的标准衡量指标,新型U-Net在公共数据集上的表现达到了或接近了专家标注者和这些对比自动方法的水平。关键是,当在另一套由不同仪器采集、且拍摄位置距视中心不同的图像上测试时,模型仍然表现良好。这表明大量覆盖多种视觉条件的合成数据训练,帮助网络学习到了可迁移到真实世界图像的特征,而不是对某一特定相机或患者群体过拟合。

对未来眼科护理的意义

对非专业人士而言,核心结论是:一个主要在“虚拟”眼图像上训练的计算程序现在可以在高分辨率视网膜扫描中以接近人类专家的可靠性识别真实的视锥细胞。通过使视锥检测更快、更客观,并更容易跨不同扫描仪和诊所应用,这一方法有望将精细的视网膜成像转变为用于以细胞水平跟踪疾病的常规工具。从长远看,类似的以合成数据为驱动的方法可以扩展到检测其他细胞类型并模拟与疾病相关的细胞丧失,从而支持更早的诊断、更好的进展监测以及对旨在保护视力的新疗法的更精确评估。

引用: Shah, M., Young, L.K., Downes, S.M. et al. Automated cone photoreceptor detection using synthetic data and deep learning in confocal adaptive optics scanning laser ophthalmoscope images. Sci Rep 16, 8313 (2026). https://doi.org/10.1038/s41598-026-39570-9

关键词: 视网膜成像, 视锥细胞, 深度学习, 合成数据, 自适应光学