Clear Sky Science · zh

视频大型语言模型在干眼科普视频质量评估中的基准评测

这对普通观众为何重要

短视频应用正在迅速成为人们获取健康建议的首选渠道,包括干眼等眼部问题,全球数以亿计的人受其影响。但在有用的片段之外,质量低下或误导性的视频同样易于传播且难以由医生全面监管。本研究探讨了能“观看”视频的新型人工智能系统是否能自动检测这些健康视频的质量,并说明了目前这些工具为何尚不足以替代专家判断。

干眼与健康视频的兴起

干眼不仅是小小的困扰;它可以导致视力模糊、疼痛,影响工作和日常生活。随着这一疾病在老年人和重度屏幕使用者中越来越常见,许多人上网寻找解释和自我护理建议。像 TikTok 这样的平台上有大量关于干眼的短视频,但其开放性意味着任何人都可以发布内容,无论是否具备医学背景。错误或夸大的建议可能延误正确治疗或鼓励不安全的家庭疗法,因此迫切需要可靠的方法来大规模检查视频质量。

研究者如何测试 AI 视频审查器

研究团队使用一个新的、中立的账号并遵循严格规则,收集了185个中文干眼主题的 TikTok 视频,仅保留原创、具教育性的片段。随后两位眼科专家使用三种常见的医学教育研究工具对每个视频评分。一种工具评估视频的易懂性以及是否清楚地提出了观众可以采取的具体步骤。第二种工具给出从差到优的整体质量等级。第三种工具将质量细分为若干方面,例如信息呈现的流畅度、准确性、附加元素(如动画)的使用情况,以及内容与视频标题的一致性。

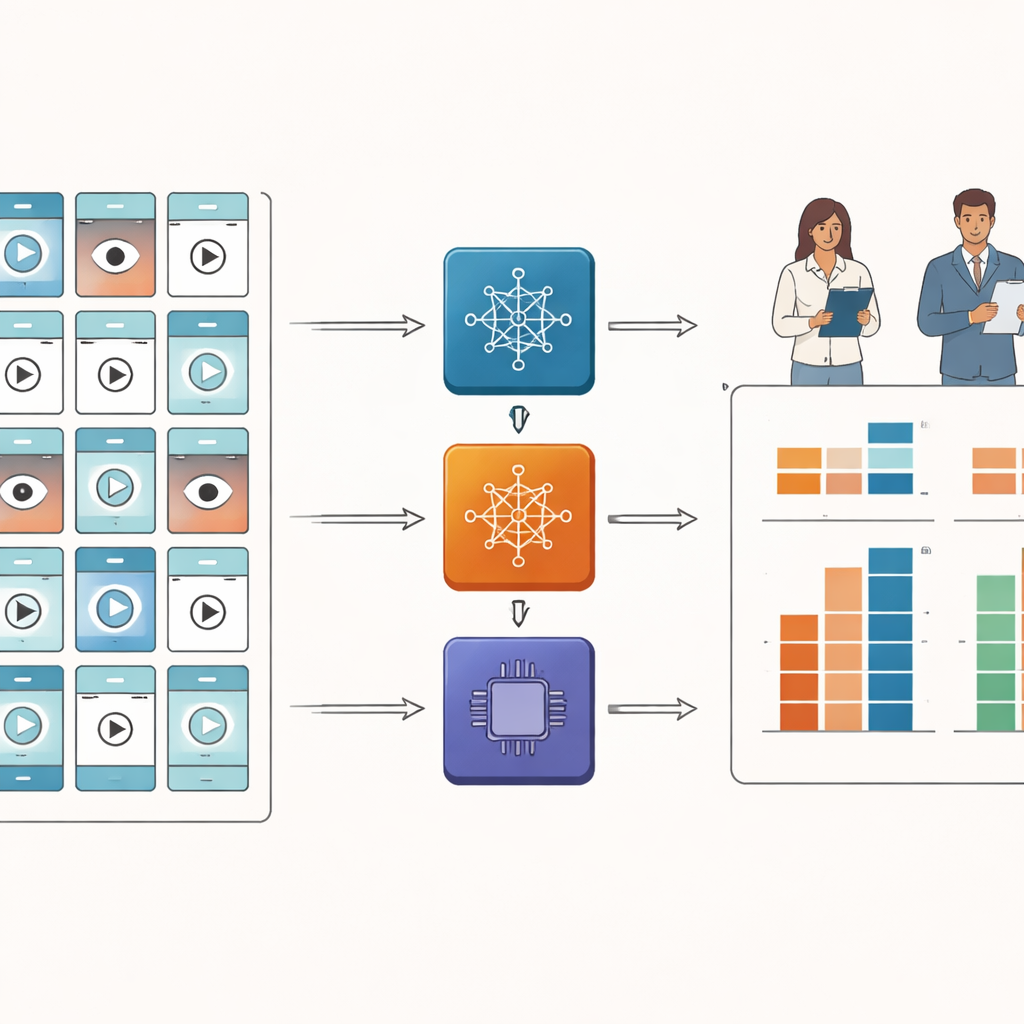

把“看视频”的 AI 模型拿来检验

接着,研究者将相同的视频输入三种先进的“视频大型语言模型”——这些 AI 系统旨在逐帧解析视觉信息并回答关于所见内容的问题。他们为每个模型设计了详尽指令,使其尽可能模仿医生的评分工具。关键问题是 AI 与人类专家是否会给出相似的评分。为衡量这一点,团队使用了标准的可靠性统计量,该统计量捕捉两位“评判者”之间在趋势和具体数值上的一致程度。

AI 做对了什么——以及错在哪里

人工评分者之间的一致性总体较高,表明他们的评分稳定且可信。相比之下,三种 AI 系统在大多数方面与专家的一致性较差。没有一种模型能够可靠地与医生匹配总体视频质量或像标题与内容一致性等具体特征。一种模型倾向于给出比专家更高的评分,另一种倾向于给出更低的评分,只有一种偶尔处于中间位置。相对较好的例外是“可操作性”——视频是否清楚地告诉观众该做什么——其中两种模型达到了中等水平的一致性,但仍不足以支持现实世界的决策。

为何当今的 AI 存在不足

作者提出了若干解释。被测试的 AI 系统主要在日常场景和通用视频任务上训练,而非针对严谨构建的健康教育内容进行训练。许多科普视频大量依赖口头讲解、字幕、图表和类比,而不是戏剧性的动态画面,但本研究中的模型仅分析了视觉帧,没有听取音频或读取标题及其他描述性信息,而这些正是人类用来判断相关性和准确性的依据。因此,大量含义并未传达到 AI,尤其是关键细节以口述形式提供而非可见呈现时。中文科普中常见的比喻性语言也可能使按字面解析的系统产生混淆。

这对患者和平台意味着什么

这项工作提供了早期路线图,而非现成的安全网。它展示了熟悉的健康信息质量清单可被转化为供“观看”视频的 AI 模型执行的指令。但也清楚表明,目前的通用系统尚不足以在无人工监督的情况下为医疗视频打分或监管错误信息。通过公开他们的评估框架和带注释的视频数据集,作者希望推动更好、更专业的模型发展,这些模型能结合视觉、声音和额外上下文,并能跨疾病和语言工作。目前,观众应继续将短健康视频视为起点而非医疗建议,平台也不应仅依赖 AI 来保证信息可靠性。

引用: Zhou, S., Huang, M., Wei, J. et al. Benchmark evaluation of video large language models in quality assessment of science popularization videos for dry eye. Sci Rep 16, 8756 (2026). https://doi.org/10.1038/s41598-026-39444-0

关键词: 干眼疾病, 健康视频, 人工智能, 错误信息, TikTok