Clear Sky Science · zh

通过知识图谱感知对比学习和受限本地大模型推理进行患者地址解析

整洁患者地址为何重要

每一次就诊记录背后都有一行看似平凡的文字:患者的家庭住址。它远非单纯的文书细节——这些地址支撑着疾病地图、应急规划以及诊所和救护车布局的决策。然而在许多医疗记录系统中,地址以混乱、不一致的文本形式存储,充斥着缩写、拼写错误和缺失信息。本文介绍了AddrKG‑LLM,一种新方法,能将这些难以处理的地址文本转化为清晰、可靠的记录,同时保护敏感信息的隐私。

凌乱住址的问题

当地址任意输入时,人们常常省略区县、调换词序,或使用官方地图不能识别的地方俗称。早期的计算方法按字符或简单词表比较字符串,仅在输入已经整洁完整时有效。较新的深度学习系统在理解上下文上更智能,但仍会被罕见表达绊倒,而且需要大量计算资源。近来大型语言模型在理解和生成文本方面表现出色,然而在自由输出时它们也容易“幻觉”出并非数据中存在的细节——在医疗领域这是不可接受的风险,因为病历必须精确且可审计。

从混乱到有序的两步路径

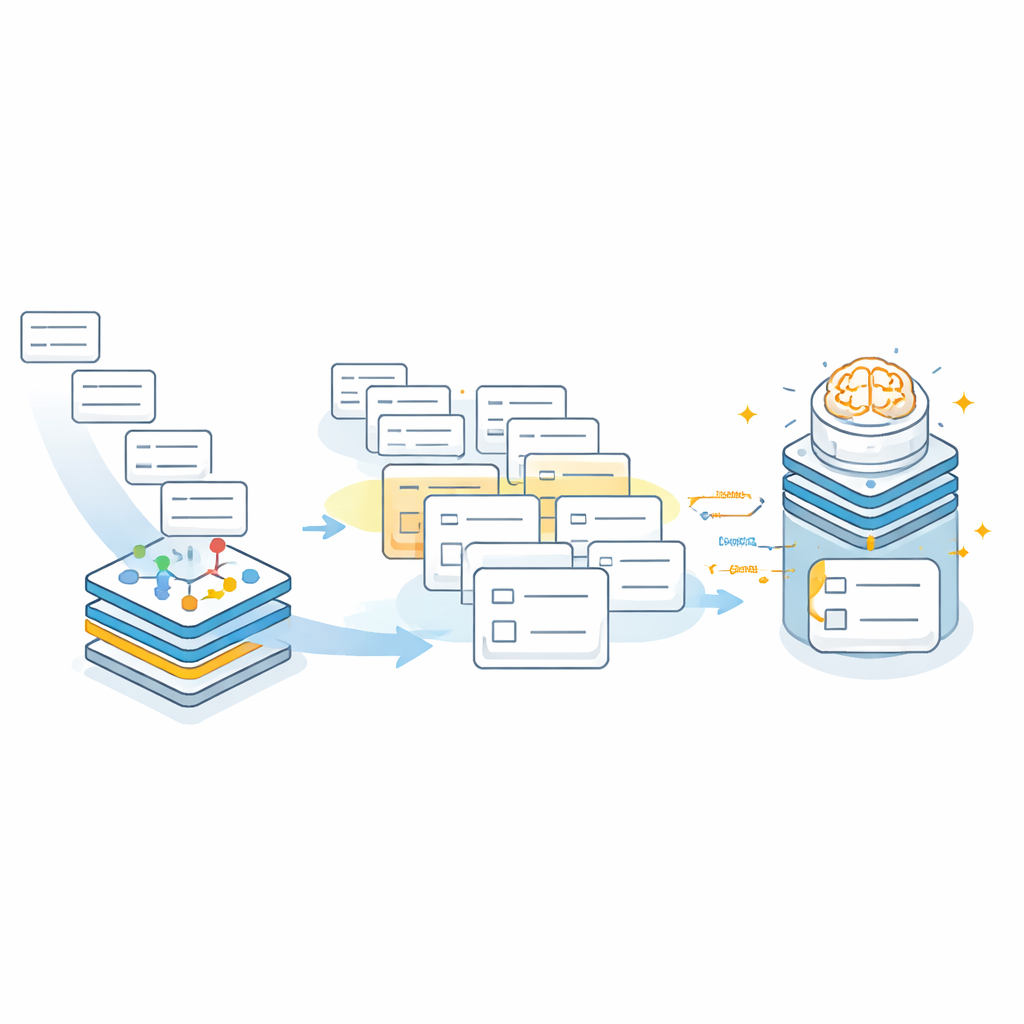

研究人员将AddrKG‑LLM设计为两阶段流水线,通过在语言模型周围增加结构和约束,而不是让其单独工作。首先,对输入的患者地址进行清洗,去除高度标识性的细节如楼号、房间号和联系电话,有助于保护隐私。剩余文本被转换为捕捉其含义的稠密数值表示。同时,团队构建了一个知识图谱——一种地图式网络,编码城市、区县、街道与小区之间的官方关系。利用称为对比学习的技术,训练系统使得指向同一现实社区的地址在共享空间中靠得更近,而不相关的地点则被推远。这样系统就能快速为每条新病人记录检索出一小组可能的地址候选项。

将人工智能拴在短链上

在第二阶段,大型语言模型在一个精心围定的搜索空间内运行。模型不再凭空编造地址,而是接收原始清洗后的文本以及由知识图谱建议的一小组候选社区。提示语明确指示模型只能从这些候选项中选择,并以固定的JSON结构输出,分别填入城市、区县、街道或乡镇以及小区等字段。如果没有候选项匹配——例如真实小区未被检索到——模型被指示返回空值而非猜测。这种“先拒绝”的行为大幅降低了听起来合理但错误的条目进入医院记录的风险。

实际效果如何?

团队在一万条脱敏的真实医院地址上测试了AddrKG‑LLM,这些地址反映了现实世界的噪声:缩写、缺区、拼写变体,甚至完全无效的条目。他们将该系统与经典的字符串匹配工具、深度学习序列标注模型、以自由形式使用的一般用途语言模型以及一家商业地址标准化服务进行了比较。在要求地址所有字段同时完全正确的严格评价指标上,AddrKG‑LLM优于所有这些基线,在一个强大的基于BERT的模型基础上将整体准确率提高了超过十二个百分点。增益在缩写和部分缺失地址上尤其明显,因为知识图谱内建的层级关系有助于填补空白。作者还探讨了不同语言模型规模和不同检索候选数量下的性能变化,展示了医院如何在速度与准确性之间为自身需求进行权衡。

对日常医疗的意义

对非专业读者而言,关键是AddrKG‑LLM提供了一种在将重要但凌乱的患者地址数据清理干净的同时,仍把控制权牢牢掌握在人手中的方法。通过将地图式知识图谱与在医院服务器上本地运行且受限的语言模型结合,该框架能提供更准确、一致的地址,而无需将敏感细节发送到外部云服务或允许AI自由发挥。其结果是一个实用工具,通过确保每位患者都能被可靠地定位在地图上,从而增强疾病监测、改进资源规划并支持更安全、高效的医院运营。

引用: Li, J., Pan, X. & Jia, Y. Patient address parsing via KG-aware contrastive learning and constrained on-prem LLM inference. Sci Rep 16, 8003 (2026). https://doi.org/10.1038/s41598-026-39348-z

关键词: 患者地址解析, 健康数据质量, 知识图谱, 大型语言模型, 医疗信息学